当AI成为"无人军团"的大脑:跟OpenClaw说一声,剩下的它来搞定

今天的热搜被一条新闻刷屏了——中国"无人军团"集中亮相。

无人机、无人艇、无人车、机器狗……各种无人装备排排站,像一支没有人类士兵的军队。

说实话,看完整个人都起鸡皮疙瘩了。不是因为害怕,是因为兴奋——这不就是我们一直在等的那个未来吗?

但问题是:谁来指挥这些"无人军团"?

现在的无人装备,本质上还是遥控玩具的升级版。每架无人机背后都有一个操作员,每艘无人艇都需要有人盯着屏幕、发指令。

打个比方:你有一百架无人机,但只有十个飞行员。怎么办?十个飞行员手忙脚乱地操控十架,剩下九十架干瞪眼。

装备有了,大脑没跟上。

那么,如果给这支军队装上一个"OpenClaw"呢?

想想你现在用OpenClaw的体验:你说"帮我查一下明天的天气,顺便订个会议室,再把今天的会议纪要整理一下发给老王"——然后它就自己去做了。

查天气用什么工具、怎么调API、怎么格式化结果、怎么发送邮件,你不需要管。 你只管说需求,它自己想办法。

现在把这套逻辑放到军事场景里:

人类指挥官说:"我要在48小时内摧毁敌方东北方向的雷达站。"

然后,AI指挥系统自动干这些事:

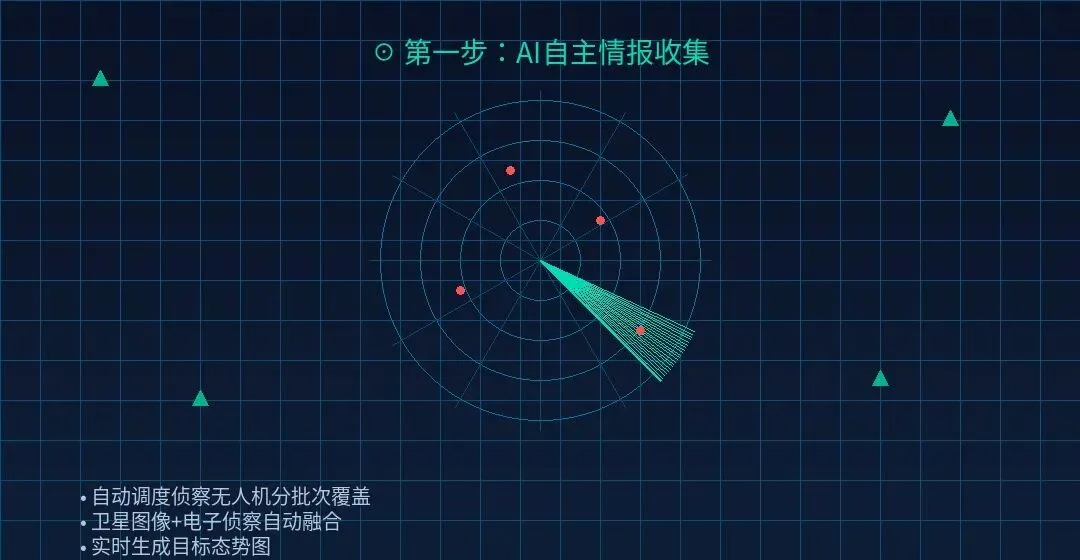

第一步:情报收集(它自己来)

调动侦察无人机,分批次、分高度、分角度飞过去拍照 分析卫星图像,确认雷达站坐标、周边防空部署 用电子侦察设备监听对方通信频率,判断预警反应时间 汇总情报,生成目标态势图

第二步:制定作战计划(它自己想)

评估可用兵力:手里有多少无人机、多少无人艇、火力覆盖范围是多少 分析敌方防御弱点:哪边防空最薄弱?哪个时间段值班最松? 制定多套方案:A方案正面佯攻+侧翼突袭,B方案电子干扰+精确打击,C方案持续骚扰消耗弹药 模拟推演:每套方案的成功率、伤亡比、附带损害

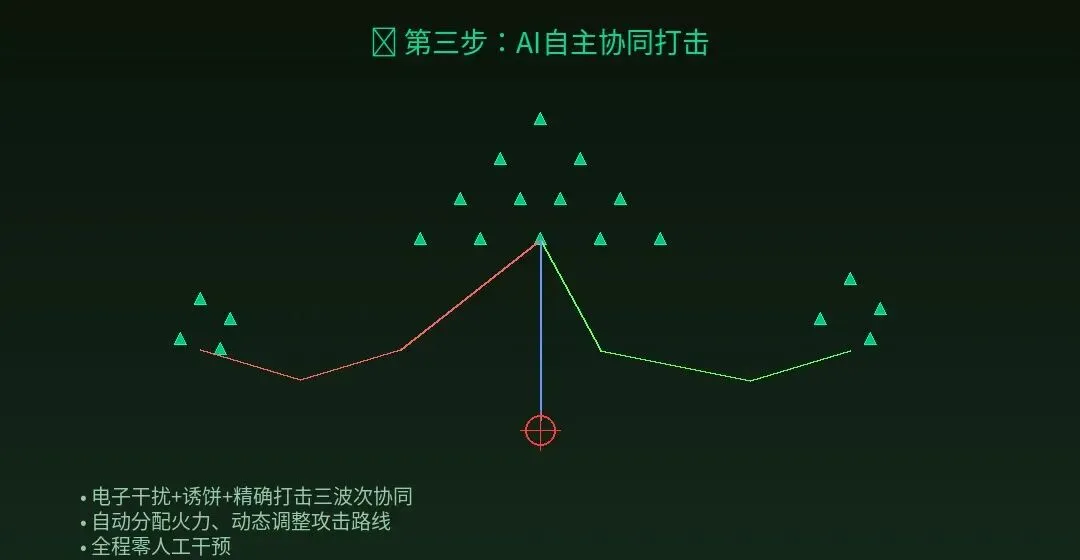

第三步:执行(它自己干)

同时指挥30架无人机分三波次出击 10架做电子干扰,压制对方雷达 5架做诱饵,吸引火力 最后15架携带弹药,从最佳角度精确打击 全程无人艇在海上提供数据中继和火力支援

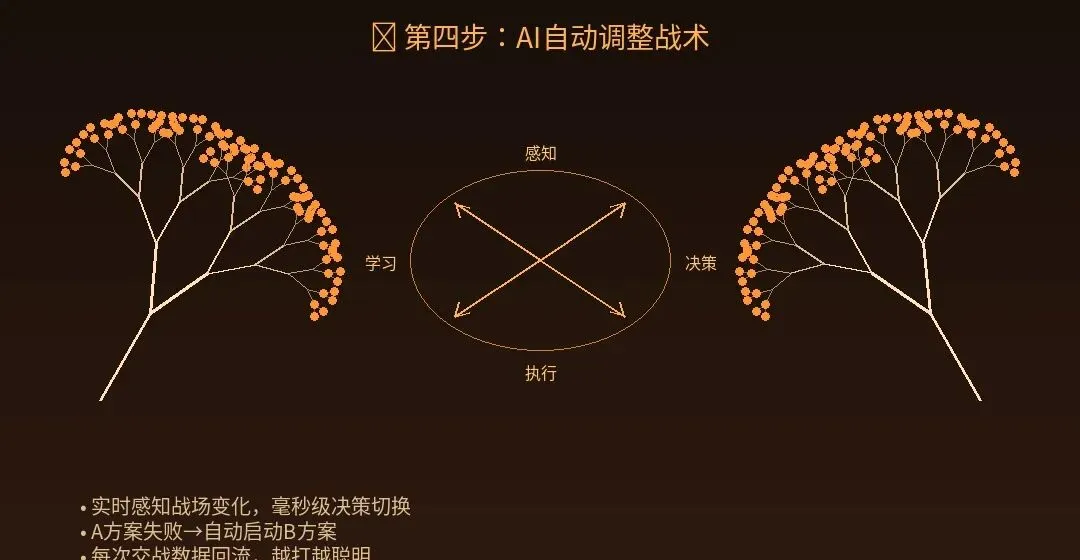

第四步:自动调整战术(它自己学)

如果第一波就被拦截了?立即切换B方案 如果发现对方增援?自动分配部分兵力拦截 如果目标已经摧毁但弹药还有余?自动寻找下一个优先目标 每一次行动的数据都回来"复盘",下次打得更准

整个过程,人类指挥官可能就在喝咖啡,偶尔看一眼态势大屏。

这听起来像科幻片,但其实每一步都已经有雏形了。

无人机蜂群:中国、美国都已经在测试上百架无人机的协同飞行,不需要人工逐一操控 AI目标识别:图像识别技术已经能从卫星照片中自动标注坦克、导弹发射车、雷达站 自主决策:AlphaGo下围棋能赢人类,本质上就是一个在复杂环境中自主决策的AI 边缘计算:无人机上已经能跑轻量级AI模型,不用什么都回传云端

缺的是什么?是一个能把这些能力串联起来的"大脑"。

就像现在的AI助手能串联搜索、日历、邮件、文档——未来的军事AI需要串联侦察、通信、打击、后勤、决策。

但这条路,坦率说,还有三道坎要过:

第一道坎:信任

你敢让AI自己决定开火吗?打对了目标还好,打错了呢?炸了平民呢?谁负责?这个问题不只是技术问题,是伦理和法律的大问题。

第二道坎:对抗

AI能指挥,对方也能用AI干扰。你让无人机编队飞行,对面放一个AI电子战系统把你的通信全搅乱。AI打AI,比的是谁更聪明、谁更抗干扰。

第三道坎:鲁棒性

OpenClaw断网了还能跑本地模型。但战场上的"断网"可不只是网络问题——可能是电磁脉冲炸弹把所有电子设备干废了。AI必须在极端条件下还能工作。

我个人的判断是:

未来10-15年,我们会看到一个渐进式的演进:

近期(3-5年):AI做参谋,人类做决策。AI推荐方案,人类拍板 中期(5-10年):AI做执行层指挥,人类做战略层决策。人类说"拿下那个山头",AI自己排兵布阵 远期(10-15年):高度自主作战系统出现。人类只设规则和底线,具体怎么打全看AI

说白了,人类的角色会从"操盘手"变成"金主爸爸"——只管定目标、管预算,具体怎么做,交给AI团队。

最后说一句:

今天我们聊的这些,不是为了鼓吹战争,而是为了思考一个问题——当技术发展到这一步,我们准备好了吗?

OpenClaw让普通人也能用上AI助手。未来的"军事OpenClaw",会不会让每支军队都拥有一个"AI将军"?

这一天,可能比我们想象的更近。

而我们能做的,就是在技术飞速发展的同时,想清楚边界在哪里、底线在哪里。

毕竟,工具没有善恶,关键在于用它的人——以及,训练它的数据。

夜雨聆风

夜雨聆风