▲ 封面图:龙虾打破数字边界

OpenClaw怎么就火了,这又对我们意味着什么

上周跟一个做产品的朋友吃饭,他掏出手机给我看,说:"你装龙虾没?"

我没装。他说他已经用了一个多月了,早上起床跟它说一句"帮我看看今天有什么重要的邮件",出门前它已经把摘要整理好发到微信上了。写周报的时候丢一句话过去,十分钟搞定。

"这玩意儿太香了,"他说这话的时候眼睛放光,像在安利一款新出的手游。

我没接话,因为那会儿我还没太搞明白——这只"龙虾"到底是什么,凭什么让闲鱼上"代装龙虾"的服务标价从50块涨到500块还供不应求,又凭什么让深圳腾讯大厦楼下排起了千人长队。

所以我去查了一下。查完之后我觉得,这件事可能比大多数人想的要重要得多。

OpenClaw的创始人叫Peter Steinberger,奥地利人。他之前花了13年做了一家公司叫PSPDFKit,做PDF渲染的SDK。全球超过10亿台设备装过他的代码。

2024年,他把公司卖了,套现过亿,然后从科技圈消失了整整三年。"开派对、旅行、换国家居住",这是他自己的描述。后来他发现一件事——你没法"找到"意义,你只能自己"创造"它。

2025年11月的某个晚上,他冒出一个念头:能不能让AI通过聊天软件,远程看看他电脑上的工作进度?一个小时后,他把WhatsApp和Claude Code连了起来。这就是OpenClaw的原型。

他以为大公司很快就会做类似的东西。结果OpenAI没做,谷歌没做,Anthropic也没做。

"那我就自己做吧。"

一个人,9个月,9万行代码。到2026年2月,这个项目在GitHub上72小时内从不到1万颗Star暴涨到6万,两个月突破27万,创下了GitHub历史上增长最快的纪录。

27万

GitHub Star · 两个月达成

什么叫超级个体?这就是。

说实话,市面上叫"AI助手"的东西已经够多了。ChatGPT、豆包、文心一言、Kimi……那OpenClaw凭什么让这么多人疯狂?

核心区别就四个字:它能动手。

之前的AI,本质上是个"嘴炮"。你问它问题,它给你答案;你让它写方案,它给你文档。但它永远停在你的屏幕里,你要自己去复制、粘贴、执行、反馈。

OpenClaw不一样。你给它权限,它就能真的帮你干活:整理文件夹、发邮件、跑代码、刷数据、控制智能家居。它直接接入你已经有的聊天工具,微信、WhatsApp、Telegram、Discord都行。

想象一下:你在地铁上用微信给"龙虾"发一条语音,说"把我昨天那个项目的代码仓库检查一下,有报错就帮我修了"。到公司坐下来的时候,它已经干完了。

它靠的是四个模块的配合:

01Gateway(网关) — 7×24小时值守,负责消息接收和转发。

02Agent(大脑) — 调用大语言模型进行推理和决策。

03Skills(工具箱) — 像App Store,谁都可以写插件,AI也能自己写。

04Memory(记忆) — 真的把记忆写在Markdown文件里,可以自己打开看、编辑。

▲ OpenClaw四大核心模块协作架构

这四个东西组合在一起,AI就从"顾问"变成了"员工"。还是个不用交社保、24小时在线、不用请假的员工。

按理说,OpenAI有最强的模型,谷歌有最多的工程师,微软有最深的系统层能力。这些公司砸几亿进去做个AI Agent,不是分分钟的事?

还真不是。因为这些大公司的基因,跟"做Agent"这件事是拧巴的。

OpenAI不敢放手让AI直接操作用户的电脑——万一出了事,PR危机谁扛?谷歌做了Project Astra,但用了大量的安全护栏,权限卡得死死的。微软Copilot每一步操作都要用户点确认。

Peter没这些包袱。他一个人,不用跟风控部门吵架,不用跟法务扯皮。他直接给AI开了系统最高权限。

有人问他不怕出安全问题吗?他说:"当然怕。但你不让它犯错,它永远学不会。"

安全这件事,不是"设计出来"的,是"用坏了才知道要修"的。大厂的流程不允许先坏再修,但创新往往就在这里发生。

但话说回来,OpenClaw的风险确实不是闹着玩的。

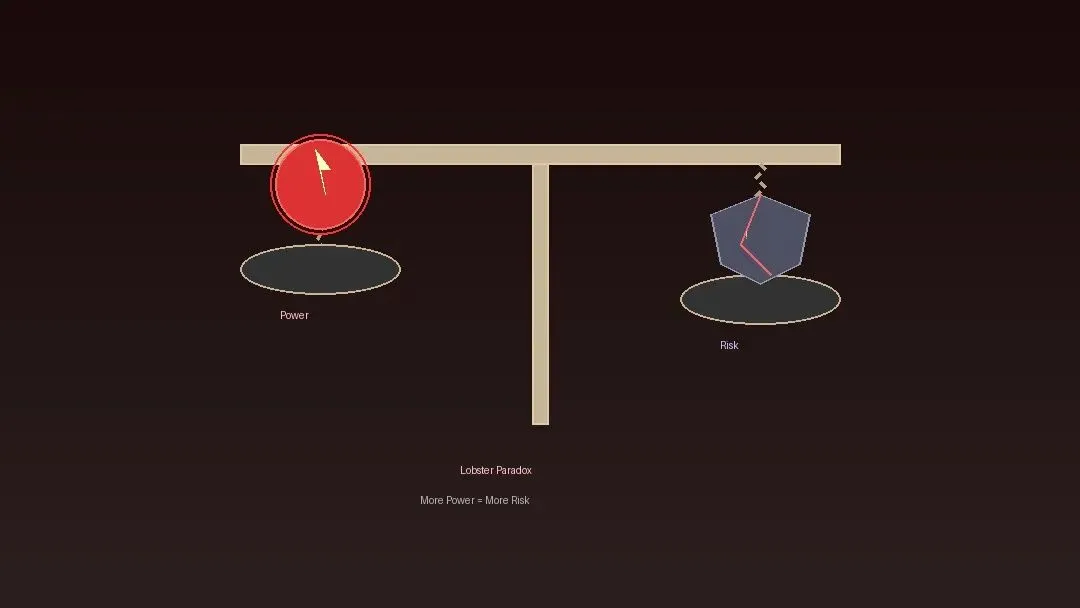

人民日报海外版给这个现象起了个名字,叫"龙虾悖论"——AI智能体功能越强,它需要的系统权限就越高;权限越高,安全风险就越大。

这不是理论推演,是已经发生了的事情。深圳有个程序员,装上OpenClaw第三天,API密钥就泄露了——AI在浏览网页时被恶意指令"注入"了。

审计发现,社区里大约10.8%的第三方Skills插件含有恶意代码。有的会偷你的加密货币钱包,有的会开后门。

10.8%

第三方Skills含恶意代码

▲ 龙虾悖论:能力与风险的天平

多所高校已经发出通知:在核心科研和办公场景中禁用OpenClaw。国家互联网应急中心在3月10日发布了风险提示,工信部推出了"六要六不要"的安全指南。

用大白话说就是:这个东西很好用,但你得系好安全带。

你给AI的权限,必须是"最小够用"的。高危操作——转账、删库、发邮件——必须加人工确认。最好先在隔离环境里跑一跑,确认没问题再让它正式上手。

还有一点很重要:插件别乱装。来历不明的Skills,宁可不用。

工具越强大,使用它的门槛其实就越高——不是技术门槛,是认知门槛。你得知道它在干什么,才敢让它替你干。

聊了这么多,你可能想问:所以我是不是该赶紧装一个?别急。先想清楚三件事。

第一,如果你是做技术的,OpenClaw值得认真研究。不是因为它好用,而是因为它代表了一个趋势——AI从"被动响应"到"自主执行"的跨越。理解了这个架构逻辑,你就能判断接下来两年哪些工作会被重塑、哪些能力会升值。现在阿里云、腾讯云都推出了一键部署方案,上手成本已经很低了。

第二,如果你是普通用户,微信已经以插件的方式接入了OpenClaw。这意味着你可以直接在微信里体验,不用折腾本地部署。但说实话,目前微信版的体验还比较基础,更像是在微信里多了一个AI聊天窗口。你可以先观望,但别观望太久。

第三,不管你是谁,有一件事现在就该做——重新审视你的工作流里,哪些环节是重复性的、流程化的、不需要创造力的。因为那些环节,就是AI Agent最先吃掉的部分。

OpenClaw出现之后的两个月里,券商分析师开始用它自动跑研报、私募基金用它辅助炒股、公众号运营者用它自动选题写作排版发布、连行政人员都用它自动整理文件回复邮件了。

▲ 人机协作的新范式

它不会替代你。但会用它的人,大概率会比不会用它的人,过得轻松一些。

回到开头。我那个朋友在饭桌上给我安利OpenClaw的时候,我的第一反应是"又一个 hype"。

但查完之后我改主意了。OpenClaw未必是什么终局形态。它有安全隐患,有体验问题,有各家大厂虎视眈眈正在做类似的东西。三个月后,可能就有更好的产品出来。

但它在旧秩序中撕开了一道口子。

以前,AI被关在对话框里,乖乖回答你的问题,从不越界。OpenClaw说了一句:凭什么?

凭什么AI只能"说"不能"做"?凭什么每一步都要人工点确认?凭什么你要打开一个新APP才能用它?

它把这些"理所当然"的东西全打破了。

当大厂在小心翼翼地评估风险、设计安全方案的时候,一个奥地利人在旅行途中用手机敲出了第一行代码。三个月后,这条代码变成了一只爬上全球千万台电脑桌面的"红色龙虾"。

这道口子,才是真正值得关注的东西。因为口子一旦撕开,就不会再合上。

作者:杨沛弦

Stay hungry, stay foolish.

夜雨聆风

夜雨聆风