最近几天,我陆续把这几个框架都跑了一遍。有些是真的惊喜,有些是真的踩坑踩到怀疑人生。这篇文章不做产品介绍,只说我真实的工程判断——你能用、能进生产、成本扛得住的,才算数。

1️⃣ 先聊聊这波热潮是怎么来的

我知道你可能已经看了很多"OpenClaw 生态全景图",绝大多数都在讲"哪个产品有哪些功能"。但我想先聊一个更本质的问题:

这波热潮,到底是真需求,还是资本催熟的泡沫?

答案是:两者都有,但比例没你想的那么悲观。

真实需求是存在的。自动化办公、RPA 替代、私有流程编排——这些痛点早就在那里压着,只是之前没有合适的工具去撬动。Prompt → Workflow → Agent 的演进,第一次让普通工程师觉得"这个东西我能做出来"。

但热潮本身,有相当大的成分来自于原版 OpenClaw 的"半成品属性"。

原版框架的架构是干净的,但工程化极度不足——没有完整 UI,没有生产级可观测性,没有企业级权限体系。这个空白,给了国内团队巨大的二次封装空间。于是我们看到了一个奇特的景象:一个"未完成"的开源框架,催生了一整个生态。

国内厂商的路径几乎如出一辙:接入 UI + 接入大模型 + 包一层工作流 → 快速产品化。"低门槛 Agent Builder"成了所有人的切入口,因为门槛低、出货快、PPT 好看。

一句话:这波爆发,本质是"工程产品化 + Agent 需求落地"的共振,而不是框架本身多成熟。

理解了这一点,你在看各家产品的时候就不会被表面的功能数量迷惑了。

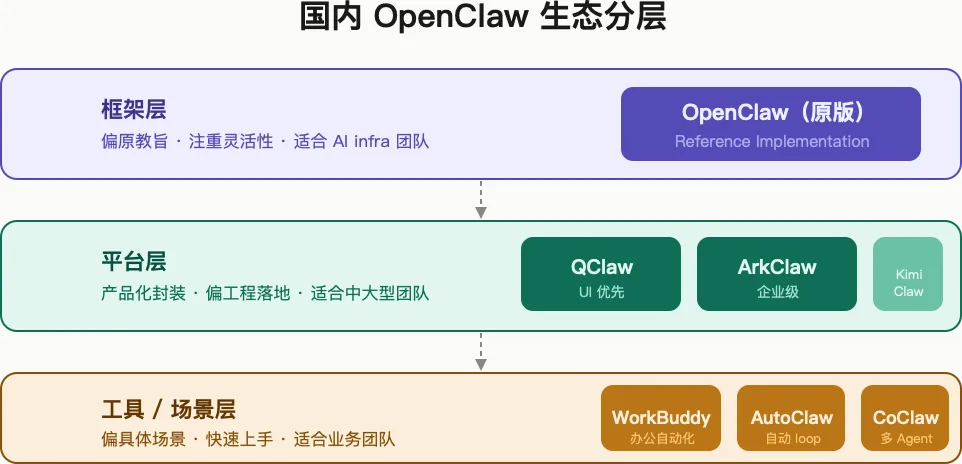

先建立一个认知框架

在拆每个产品之前,我想先给整个生态分个层。很多人选型踩坑,根本原因是在错误的层级找解决方案——业务团队去用框架层的东西,技术团队去用只适合 Demo 的 UI 工具。

| 层级 | 定位 | 代表产品 |

|---|---|---|

| 框架层 | 偏原教旨,注重灵活性 | OpenClaw(原版) |

| 平台层 | 产品化封装,偏工程落地 | QClaw / ArkClaw / KimiClaw |

| 工具/场景层 | 偏具体场景,快速上手 | WorkBuddy / AutoClaw / CoClaw |

你在哪一层有需求,决定了你该看哪个产品。后文所有评测都围绕这个分层展开。

2️⃣ 评测怎么做的?

在看结论之前,我想先把评测方法摊开来说——不然你没法判断我的结论值不值得参考。

很多评测文章的问题是:维度设计得太"产品化",结果把 Agent loop 跑得稳不稳、生产成本可不可控这种真正重要的事情给漏掉了。

我的评测维度是这样设计的:

| 维度 | 说明 | 为什么重要 |

|---|---|---|

| 入门成本 | 是否开箱即用 / UI / 文档 | 决定团队 adoption 速度 |

| 长期成本 | Token / infra / 运维复杂度 | 决定能否真的进生产 |

| 核心能力 | Agent loop / memory / tool use | 是否是真 Agent |

| 可控性 | prompt 控制 / 行为边界 | 防"失控执行" |

| 安全性 | 权限 / 沙箱 / 审计 | 企业级必须项 |

| 可扩展性 | plugin / skill / API | 能不能二开 |

| 工作流能力 | DAG / 条件分支 / 状态管理 | 能不能替代 RPA |

| 观测与调试 | logs / trace / replay | 出了问题能不能查 |

| 模型耦合度 | 是否绑定某模型 | 有没有供应商锁定风险 |

其中有几个维度,我觉得值得多说几句。

入门成本≠"是否简单",而是"是否可复制"

这是我见过最容易被误判的维度。

很多人看到"有 UI"就觉得"低门槛",但这两件事根本不等价。真正的入门成本评估,应该问的是:你能不能在没有原团队介入的情况下,独立复现一个稳定运行的 Agent?

能复现,才叫低门槛。不能复现,有再漂亮的 UI 也没用。

长期成本:这是最容易被低估的维度,没有之一

我见过太多团队在 Demo 阶段兴奋无比,上了生产之后被账单打懵。

长期成本的构成:

- Token 成本:多轮 Agent loop 下,一次任务的 token 消耗可能是单次问答的 5–20 倍。这不是在吓你,你可以自己算。

- 工具调用成本:frequency 一高,function call 的计费就变得不可忽视。

- Infra 成本:向量库(Milvus/Weaviate)、Redis、异步 worker——这些隐性 infra 开销,很多人在选型阶段根本没算进去。

很多 OpenClaw 分支在 Demo 阶段看起来很美,但进了生产之后成本曲线是指数级往上走的。

Agent 核心能力:这里藏着最多的"伪 Agent"

这是我最想认真说的一个维度,因为市场上充斥着伪装成 Agent 的工作流工具。

判断一个系统是否是真 Agent,我看四个能力:

- Planning:有没有显式的任务规划步骤?还是拿到任务直接执行?

- Memory:能不能做短期上下文管理 + 长期记忆持久化?

- Tool Use:工具调用的稳定性,而不只是"能调用"——失败了怎么处理?

- Reflection:执行失败后有没有自我纠错和重试机制?

没有稳定 tool loop 的,不算真正 Agent,只是 Prompt 编排器。

这条标准很直接,但它会淘汰掉市面上大概一半的产品。

可控性:这是国内落地最真实的卡点

我和不少甲方技术负责人聊过,他们卡住不推 Agent 的原因,十有八九不是"能力不够",而是"不知道它会做什么"。

具体来说: - 能不能限制工具权限(只读,不能写) - 执行路径能不能解释(这一步为什么这么做) - 有没有 Human-in-the-loop(关键节点让人审批)

企业不会接受一个"不可控的智能体",哪怕它再聪明。 这不是保守,这是常识。

3️⃣ 逐个拆解:好的说好,烂的说烂

OpenClaw(原版)|框架层

定位:Reference Implementation,工程师的乐高积木

说实话,原版 OpenClaw 的架构是这七个里面我最喜欢的。干净,逻辑清晰,没有多余的抽象层。

但喜欢归喜欢,我没法推荐大多数团队直接用它——工程化太不足了。没有 UI,没有监控,没有权限体系。拿到原版之后,你基本上需要从零开始搭自己的产品层。

这不是批评,这是设计定位的问题。OpenClaw 更像是 PyTorch——能力天花板极高,但它只给你矩阵运算,不给你神经网络。你得自己造网络。

适合谁: - AI infra 团队,对框架有完全控制权 - 想长期自建 Agent 系统、不想被任何平台锁定的团队

不适合谁: - 想要开箱即用的团队(你会很痛苦) - 没有足够工程资源的创业公司(投入产出比不划算)

QClaw|平台层

定位:UI 优先,快速上手

QClaw 是这几个里面上手最顺滑的,这一点我承认。UI 设计很用心,模板够多,非技术用户跟着走两步就能出一个 Demo。

但问题也在这里——它的天花板,就是 Demo 层。

核心问题:抽象层太浅。一旦你的业务逻辑超出了预设模板的范围,你会发现它给你的"自定义空间"其实非常有限。更重要的是,它的 Agent 能力更像是工作流的壳,而不是真正的 Agent loop。

我测试的时候有个感受:用 QClaw 做出来的"Agent",本质上是一个"有条件分支的 Prompt 序列"。不是 Agent,是 Prompt 编排器。

QClaw 本质是"Agent UI 化",不是 Agent 基建。

适合谁: - 非技术背景的业务团队 - 需要快速出 Demo、验证场景可行性的阶段

不适合谁: - 想认真做 Agent 系统的工程团队(早晚要重写)

ArkClaw|平台层

定位:工程化最认真的分支

坦白讲,ArkClaw 是这次评测里给我惊喜最多的产品。

它的架构设计明显比其他分支想得更深——有相对完整的权限体系,日志和执行路径的可解释性比同类产品强,扩展接口的设计也比较合理,二开的时候不会打架。

上手成本是比 QClaw 高一些,这是真话。但这个成本是值得的——你付出的学习成本,换来的是更强的工程控制力。

如果我现在要在团队里推一个"能进生产的 OpenClaw 分支",ArkClaw 是我第一个会认真评估的选项。

ArkClaw 是目前最接近"可进生产"的分支之一,适合认真做的团队。

适合谁: - 中大型技术团队,需要构建内部自动化系统 - 对稳定性、安全性有明确要求的场景

WorkBuddy|工具层

定位:办公自动化,场景导向

WorkBuddy 的定位非常明确——它就是要解决那些让你每天重复操作、机械到想辞职的工作。飞书、企微、Excel 处理这些场景,它做得是真的顺手。

问题是,一旦你想在这个基础上做更多,墙就来了。它的通用性很弱,架构上也没有给"超出预设场景"留出足够的空间。

我的理解是:WorkBuddy 卖的是"解决方案",而不是"平台"。买之前想清楚,你买的是什么。

WorkBuddy 是"Agent 应用",不是 Agent 平台。是工具,不是基础设施。

适合谁: - 需要解决具体重复性工作的业务团队 - 不需要深度定制,ROI 要求明确

KimiClaw|平台层

定位:Kimi 生态的深度绑定版

说 KimiClaw 之前,我要先说一件事:如果你的团队恰好重度依赖 Kimi 的长文本处理和中文理解能力,KimiClaw 可能真的挺适合你。模型层的优势它确实能传导到产品体验上。

但这里有一个我觉得很值得警惕的点:你以为你在选框架,其实你在选模型。

KimiClaw 的能力边界,本质上就是 Kimi 模型的能力边界。框架层的东西非常薄。一旦你想切换模型,或者 Kimi 的某个能力不符合你的需求,迁移成本会很高。

供应商锁定不是故事,是真实存在的工程风险。

KimiClaw 的上限取决于模型,而不是框架本身。你买的是模型能力,框架只是包装。

适合谁: - 业务强依赖 Kimi 模型的团队 - 不在乎模型切换灵活性的场景

CoClaw|工具层

定位:多 Agent 协作,方向正确但不够稳

CoClaw 是这次评测里最让我纠结的产品。

方向上,它是完全正确的。多 Agent 协同、Planner/Executor/Critic 角色分离——这是 Agent 架构未来必然走向的地方。CoClaw 在国内的同类产品里,算是最早认真探索这个方向的。

但工程稳定性真的是个问题。我在测试复杂任务的时候,遇到了不少让人哭笑不得的情况——两个 Agent 互相等待、任务链断掉之后没有合理的恢复机制、调试的时候完全不知道发生了什么。

这不是功能不够,是工程还不成熟。

CoClaw 在"未来方向上正确,但工程上不成熟"。现在用于研究,等一等再看生产。

适合谁: - 研究团队、前沿探索 - 对稳定性有容忍度、愿意踩坑的工程师

AutoClaw|工具层

定位:自动 loop,类 AutoGPT 风格

AutoClaw 大概是这七个里面最"极客"的一个。给它一个目标,它会自己想、自己做、自己迭代——听起来很酷,用起来……嗯。

我测试的时候,它成功完成了一些让我眼前一亮的任务,也干了一些让我当场冷汗的事。Token 消耗飙升到我没预料到的程度,执行路径走偏之后完全不知道怎么拉回来,可控性几乎为零。

如果你只是想玩一玩、看看 Agent 的自主性边界能到哪里——AutoClaw 是个不错的玩具。但如果你想用它做任何跟生产沾边的事,我只有一句话:别。

AutoClaw 更像"Agent 极客玩具"。很酷,但距离生产还很远。

适合谁: - 极客式实验 - 研究 Agent 自主性边界的场景

4️⃣ 横向对比:一张表说清楚

简化一下选型路径:

- 想做基础设施、长期自建 → OpenClaw / ArkClaw

- 想快速做产品、验证需求 → QClaw / WorkBuddy

- 想探索多 Agent 未来 → CoClaw / AutoClaw

- 强依赖 Kimi 模型 → KimiClaw

5️⃣ 往后看:这个生态会走向哪里?

1. 会收敛到统一范式吗?

会。而且收敛方向我觉得已经比较清晰了——从"Prompt Flow"走向"Stateful Agent Runtime"。

演进路径大概是这样:

Prompt → Workflow → Agent → Multi-Agent → Agent OS

现在大多数产品卡在 Workflow → Agent 的过渡带上,有些卡得还挺用力。谁先跨过这条线,谁就能在下一轮竞争里站稳。

2. 三个我认为比较确定的趋势

趋势一:从 UI Builder → Agent Runtime

"拖拽流程图"这件事,上限很低。下一个阶段的 Agent 系统应该是状态驱动 + 事件驱动的——Agent 有自己的运行时状态,而不是被流程图框死。

这是本质性的架构升级,不是功能迭代。

趋势二:从单 Agent → 多 Agent 协作

Planner / Executor / Critic 的角色分离已经是业界共识了,参考 CrewAI 和 AutoGen 的设计。国内产品会跟,但多 Agent 的工程难点不在于"能跑起来",而在于协同稳定性和调试可观测性。这两件事,目前没有一个产品做得让我满意。

趋势三:从 Demo 工具 → 可观测系统

这是我觉得最被低估、也最值得投入的方向。

Trace、Replay、Evaluation——这三件事是 Agent 系统进入企业生产的必要条件。不是加分项,是门槛。

谁先做好"可观测性",谁就最有机会真正进入企业。 我对这个判断挺有信心的。

3. 会被替代吗?

会被部分替代,但不会消失。

OpenClaw 系列解决的是"中间层编排"问题,它不是模型层,也不是 infra 层,而是介于两者之间的任务编排层。这个需求不会消失——具体形态会演变,更底层的 Agent 框架可能会蚕食一部分市场,但编排的价值会长期存在。

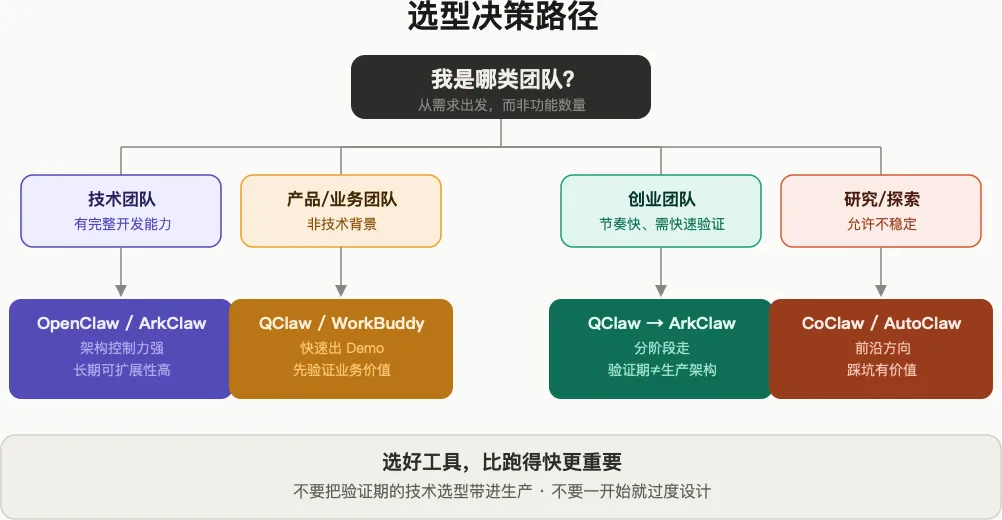

6️⃣ 最后,给你一个决策路径

你是技术团队,有开发能力

首选 OpenClaw 自建,或者 ArkClaw。不要怕前期投入高,长期来看架构控制力和可扩展性的价值会显现出来。

你是产品 / 业务团队

QClaw 或者 WorkBuddy,别犹豫。不要在工程细节上花太多精力,先验证业务价值。

你是创业团队

我的建议是分阶段走:早期用 QClaw 快速验证方向,等产品跑通了,再迁移到 ArkClaw 或者自建。不要一开始就过度设计,但也不要把验证期的技术选型带进生产——这两件事我都见人犯过。

你是研究 / 前沿探索方向

CoClaw 和 AutoClaw 值得认真看,允许不稳定,允许踩坑。这两个方向代表的是 Agent 架构的未来,提前积累认知是有价值的。

这个生态现在还很乱,但乱的地方往往有机会。选好工具,比跑得快更重要。

下一篇我打算专门写 Agent 可观测性体系的建设——这是目前国内做得最差、但最值得投入的方向,希望能踩过的坑都给你写清楚。

有问题或者不同意见,评论区见。

夜雨聆风

夜雨聆风