为什么你的AI训练成本总是降不下来?

很多人在使用OpenClaw进行AI训练时,都会面临成本控制的难题。选择云端服务还是本地部署?要不要购买高端GPU?如何在不牺牲效果的前提下省钱?这些都是值得深思的问题。

其实,只要掌握正确的方法,你完全可以做到既保证训练效果,又大幅降低成本。今天就给大家分享5个实用的省钱技巧。

技巧一:充分利用本地硬件资源

不要小看你现有的硬件设备。很多用户的电脑已经具备一定的GPU能力,只是没有得到充分利用。OpenClaw支持在消费级显卡上运行,虽然速度比专业服务器慢,但对于日常学习和调试来说已经完全够用。

你可以先在本地完成模型的基础训练,等到需要大规模训练时再考虑云端资源。这样可以将前期成本降到最低。

技巧二:巧用间歇性训练策略

训练AI模型并不需要24小时不间断运行。合理安排训练时间,选择电价较低的时段进行训练,可以节省不少费用。

另外,很多云服务商提供预留实例,比按需实例便宜高达60%。如果你有稳定的训练需求,预留实例是更好的选择。

技巧三:模型压缩

大模型固然效果好,但开销也大。通过模型压缩技术,你可以将大模型的知识迁移到更小的模型中,既保持了大部分效果,又大幅降低了推理成本。简单来说就是细化功能,将复杂的工作分割成一小块一小块进行处理。

OpenClaw支持多种模型压缩方案,你可以根据实际需求选择合适的压缩比例。一般情况下,经过压缩的模型可以达到原模型90%以上的效果,但推理速度提升数倍,成本也相应降低。

技巧四:善用开源模型和预训练资源

从头训练一个模型成本很高,但利用开源社区的预训练模型可以大大降低成本。很多高质量的生图、文字、视觉语音的开源模型已经经过了大量数据的训练,千问、豆包等等,你只需要接入并进行微调即可。

OpenClaw支持对接多种开源模型框架,你可以充分利用这些资源,避免重复造轮子。

技巧五:精细化资源管理与监控

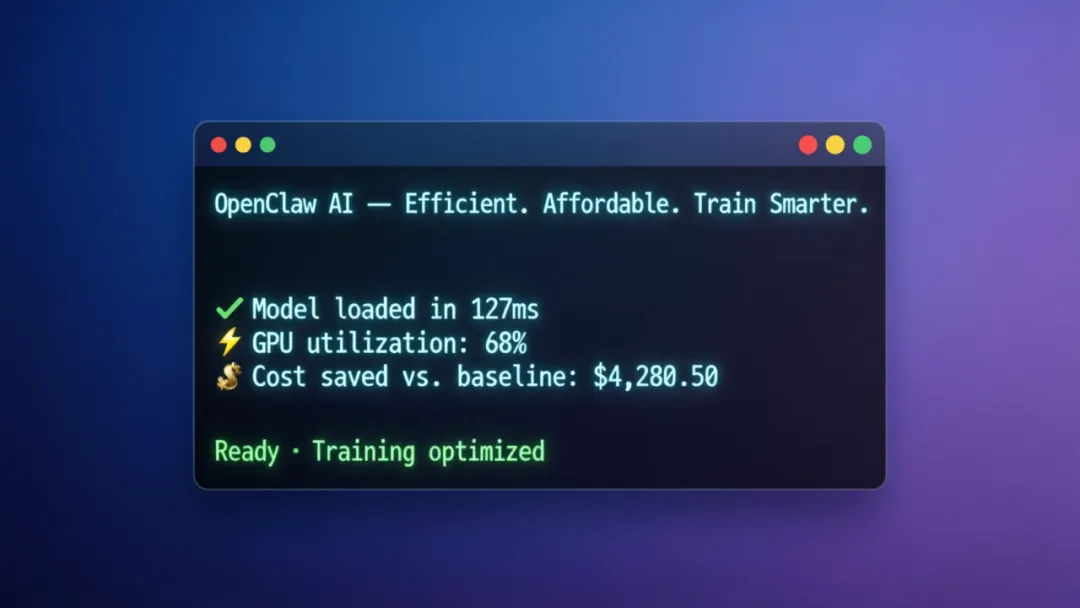

很多成本浪费来自于资源管理不当。设置合理的超时时间、及时释放闲置资源、监控GPU利用率,这些都是容易被忽视但非常重要的细节。

建议使用OpenClaw的资源监控功能,随时了解训练资源的消耗情况,及时调整资源配置。

总结

AI训练的成本控制是一个系统工程,需要从硬件选择、资源调度、模型优化等多个维度综合考虑。掌握以上5个技巧相信可以帮助你在使用OpenClaw时更好地控制成本。

个人使用建议购买云服务器,按需购买更省钱。

希望这些建议对你有所帮助!有需要本地部署操作手册的可以留言。

夜雨聆风

夜雨聆风