说实话,这个工具不是我"问"出来的,是"搜"出来的。

前两天我在 OpenClaw 里问:"有没有小红书数据采集的工具?"

AI 给我推荐了一堆网页抓取方案、Python 爬虫教程,绕了一大圈。

后来我用 find-skills 搜了一下 xiaohongshu,给我罗列出了一堆工具,最终对比需求告诉我最适合的结果——xiaohongshu-cli,一个现成的 CLI 工具。

我当时就愣住了。

为什么 AI 不直接告诉我?

答案是:AI 不一定知道你有什么 skill 可用。你得自己搜。

这个坑,今天先给你填了。

这是晨念拆解 AI 实战的第 **44 篇笔记。

今天分享这个我"搜"到的宝藏工具——xiaohongshu-cli。

一个命令行工具,直接把小红书创作者后台的数据扒下来,还能自动同步到飞书表格。

先看效果——我跑了一把,145 篇笔记的数据,几分钟全部吐出来。

说白了,原理是这样的

这个工具本质上是模拟你登录小红书创作者后台,然后把数据 API 的接口给封装成了命令行。

你只需要敲几个命令:

xhs my-notes --page 0 # 查看笔记列表

xhs whoami # 查看账号信息

数据就吐出来了:

笔记标题 点赞数、浏览数、收藏数 评论数、分享数 发布时间、笔记类型

整个过程,5 分钟搞定。

别问为什么。照做就行。

开搞前,先备好这几样弹药

- 小红书创作者账号

:需要有 creator.xiaohongshu.com 的登录权限 - Python 环境

:推荐用 pipx 安装,干净省事 - 一台电脑或服务器

:本地电脑最简单,服务器环境需要手动配置 Cookie

Step 1:发现工具——find-skills 搜索(重点!)

这个步骤很多人会跳过,但恰恰是最关键的。

别直接问 AI。

AI 不一定知道你装了哪些 skill,也不一定会主动帮你搜索。

自己动手搜:

如果你用的是 OpenClaw,可以直接用 find-skills 命令:

clawhub search xiaohongshu

返回结果:

名称:xiaohongshu-cli

来源:https://github.com/jackwener/xiaohongshu-cli

版本:0.6.4

作者:jackwener

💡 踩坑预警:这就是我开头说的坑——问 AI 问了一圈没结果,自己搜一下秒找到。以后找工具,先搜再问,别反过来。ClawHub 里的工具都是有人验证过的,省得你浪费时间试错。我昨天试了三个 GitHub 仓库,两个报错一个跑不起来,最后还是 ClawHub 指的路靠谱。

Step 2:安装工具——pipx 一键搞定

pipx 是 Python 的包管理工具,专门用来装 CLI 工具。

没有 pipx?先装:

# macOS

brew install pipx

# Linux

sudo apt install pipx

然后一行命令装好 xiaohongshu-cli:

pipx install xiaohongshu-cli

装完验证:

xhs --version

输出 0.6.4 就对了。

Step 3:认证登录——三种方式任选

这是最关键的一步,也是最容易踩坑的地方。

方式 1:浏览器 Cookie 提取(本地电脑推荐)

如果你用的是 Chrome 或 Edge,直接运行:

xhs login

工具会自动从浏览器里提取你登录小红书时的 Cookie。

不用扫码,不用手动复制,丝滑。

💡 踩坑预警:这个方式只能在本地电脑用。如果你在服务器上跑,没有浏览器,就只能用方式 3。我一开始以为服务器也能用,结果报错

No browser found,卡了十分钟才反应过来。

方式 2:二维码扫码登录

xhs login --qrcode

会弹出一个二维码,用小红书 App 扫一下就行。

但这个方式有个问题——服务器环境没法显示二维码。

方式 3:手动配置 Cookie(服务器环境必用)

服务器没有浏览器,也没法扫码。

但好消息是——手动配置 Cookie 反而更稳定。

Cookie 配置文件位置:~/.xiaohongshu-cli/cookies.json

必需字段:

{

"a1": "你的 a1 值",

"webId": "你的 webId 值",

"web_session": "你的 web_session 值"

}

怎么获取这些值?

打开 Chrome,登录 creator.xiaohongshu.com 按 F12 打开开发者工具 切到 Application 标签 左侧找到 Cookies → creator.xiaohongshu.com 找到 a1、webId、web_session这三个字段,复制值

把值填进 cookies.json,保存。

文件权限记得改成 600:

chmod 600 ~/.xiaohongshu-cli/cookies.json

不然别人能看到你的登录信息。

💡 踩坑预警:Cookie 有效期大约 7 天。过期后会报

Cookie expired,需要重新获取。我第一次用的时候没注意这个,结果一周后数据采集突然失败,排查半天才发现是 Cookie 过期了。

Step 4:采集数据——一行命令搞定

认证成功后,直接跑:

📱 使用方式

在对话中说:

- "同步小红书数据"

- "发送小红书周报"

或者

xhs my-notes --page 0

输出示例:

标题:XXXXXXXXXXX,源头工厂直发

ID:note_123456

点赞:23

浏览:1567

收藏:12

评论:3

分享:1

类型:normal

时间:2026-03-28

想看更多页?继续加 page 参数:

xhs my-notes --page 1

xhs my-notes --page 2

最多支持 20 页。

💡 踩坑预警:别一次性跑太多页。小红书有频率限制,连续请求太多会触发验证码。工具自带了 1.5 秒间隔,但你自己别手贱疯狂并发。上次有个朋友一次性跑 50 页,结果账号被限流了一天。

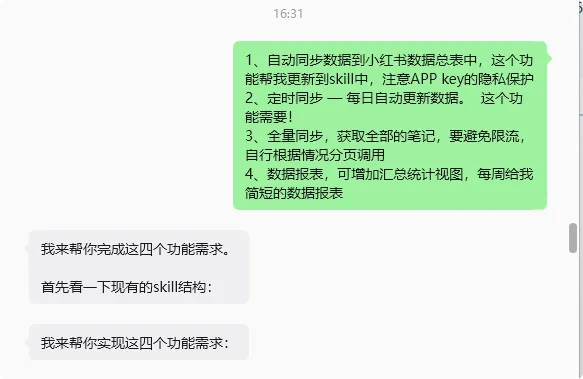

Step 5:进阶改造——自动同步到飞书表格

采集下来是一堆 JSON,手动整理太累。

晨念做了个升级——自动同步到飞书多维表格。

飞书表格结构

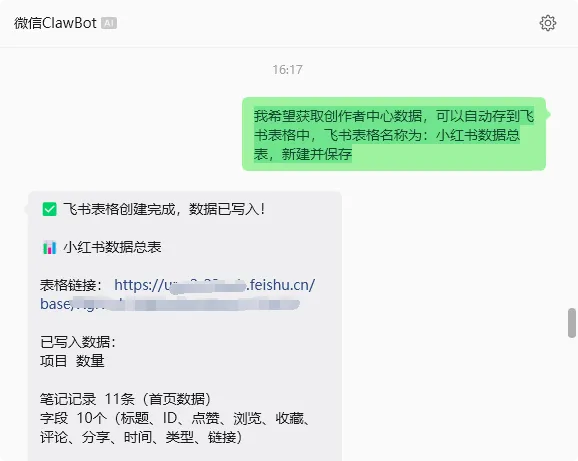

一句话,openclaw就帮我创建好了

我希望获取创作者中心数据,可以自动存到飞书表格中,飞书表格名称为:小红书数据总表,新建并保存

字段如下:

自动同步功能实现

openclaw自己就会动手写一个简单的脚本:

#!/bin/bash

# 同步小红书数据到飞书

# 采集数据

xhs my-notes --page 0 > notes.json

# 调用飞书 API 写入

python3 sync-to-feishu.py notes.json

飞书写入模块用 feishu_bitable_create_record 就行。

定时任务

想让数据每天自动更新?配置 crontab:

# 每日 09:00 快速同步

0 9 * * * /path/to/sync-notes.sh

# 每周一 10:00 全量同步

0 10 * * 1 /path/to/sync-notes.sh --full

我现在每天早上 9 点自动跑,打开飞书表格就能看到最新数据。

省了半小时手动统计的时间。

跑起来!

验证一下有没有跑通:

xhs status

看到 Logged in 就说明认证成功了。

然后跑:

xhs my-notes --page 0

数据吐出来就对了。

恭喜,跑通了!

常见报错排查

Not logged in | ||

403 Forbidden | ||

Cookie expired |

两个坑,总结一下

- 找工具的坑

:别只问 AI,AI 不一定知道你有什么 skill 可用。先搜再问,用 clawhub search或find-skills自己搜。 - Cookie 的坑

:有效期 7 天,过期要重新配置。服务器环境手动配 Cookie 更稳定。

老规矩:完整的飞书同步脚本和 crontab 配置模板,晨念已经打包好了。

关注公众号「晨念AI笔记」,后台回复【小红书数据】,直接发你。

去跑。别在数据统计上浪费时间了。

夜雨聆风

夜雨聆风