经过多天测试,目前可以跑通,需要进一步优化,最终能帮助完成日常工作。

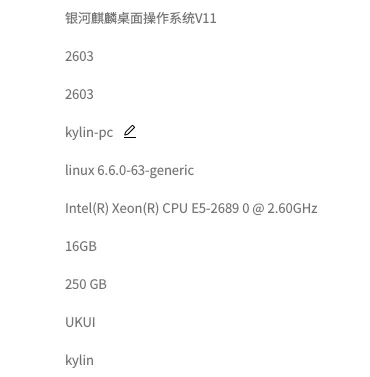

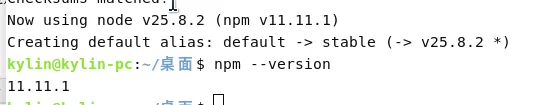

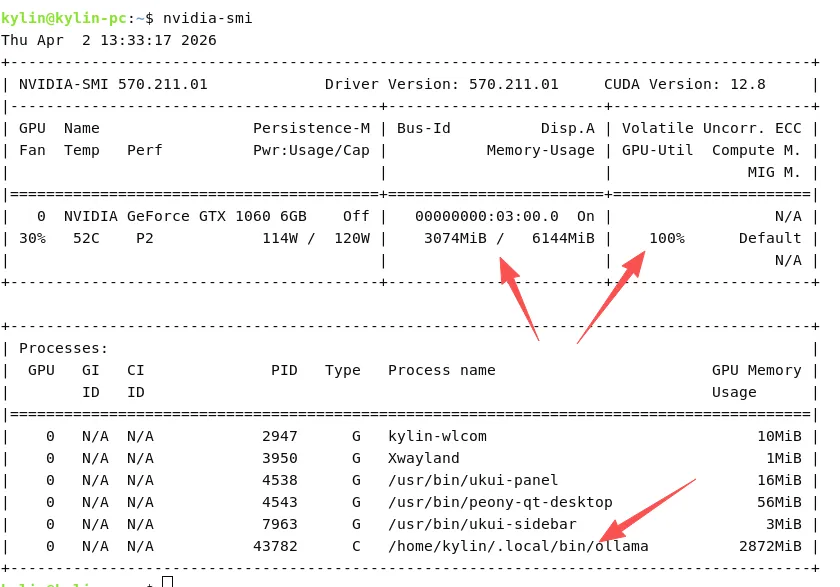

硬件环境

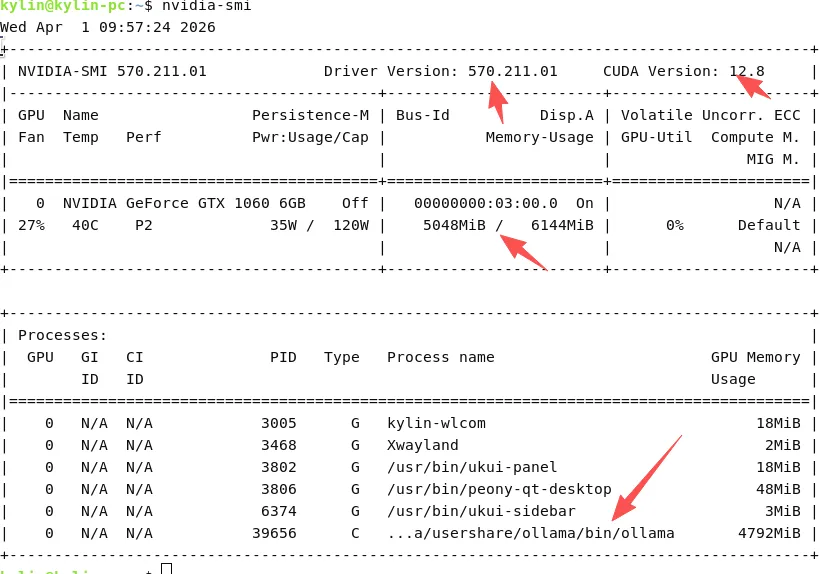

Nvidia 1060 6G

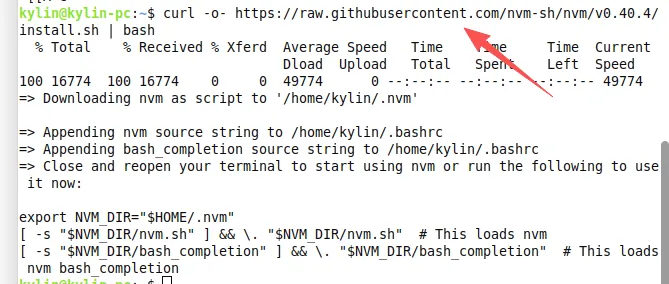

安装nvm环境

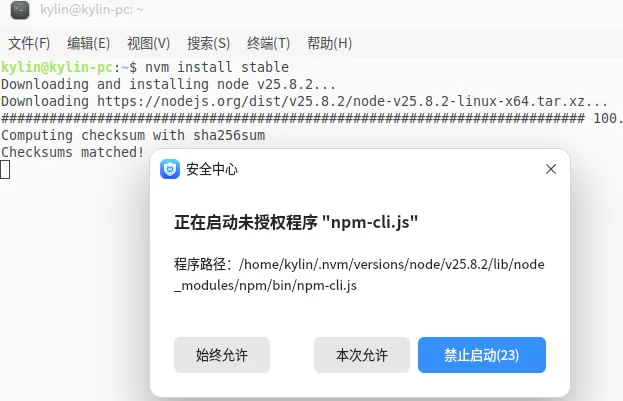

由于银河麒麟桌面操作系统V11对系统进行安全防护,因此在安装OpenClaw前需要先安装nvm环境。在桌面右击鼠标选择“打开终端”,并输入命令行:

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.4/install.sh | bash

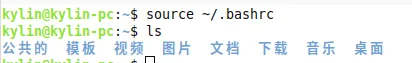

使nvm生效

安装完成后,需要让nvm立即生效,“打开终端”执行以下命令“source ~/.bashrc”。。

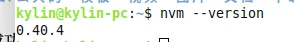

验证nvm安装是否成功

执行命令“nvm --version”,若输出nvm版本号,例如“nvm--version0.40.4”,说明安装成功。版本号以您安装的为准!

nvm基础使用

输入命令“nvm install stable”,安装最新稳定版Node.js。

安装ollama ,尝试跑本地模型用户目录免安装(不碰系统目录,最稳)

将 ollama 放在用户目录或其他可写位置,并添加到 PATH:

1. 创建用户本地 bin 目录

mkdir -p ~/.local/bin

3. 添加执行权限

chmod +x ~/.local/bin/ollama

4. 将 ~/.local/bin 添加到 PATH

echo 'export PATH="$HOME/.local/bin:$PATH"' >> ~/.bashrc

source ~/.bashrc

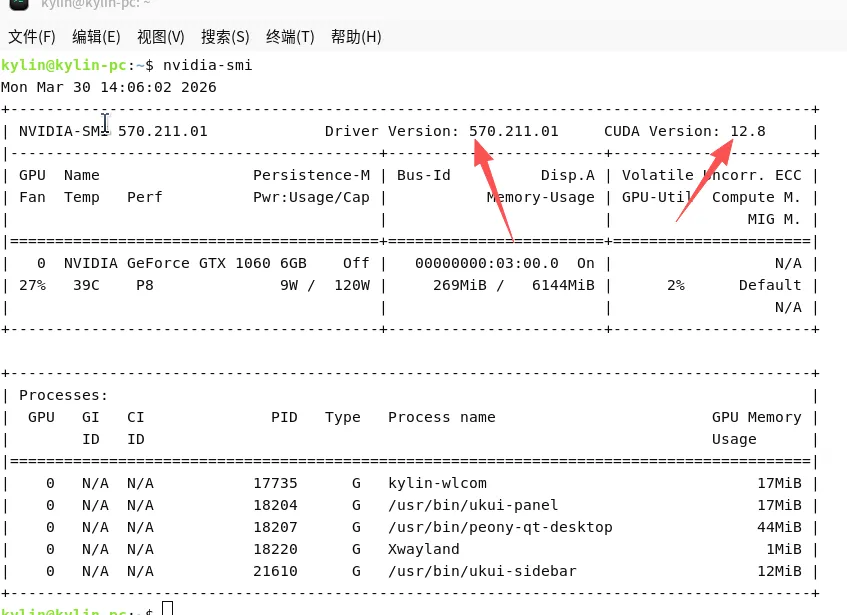

5. 验证ollama --version

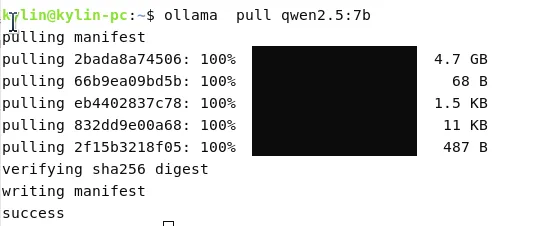

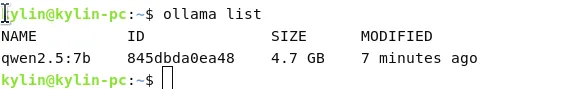

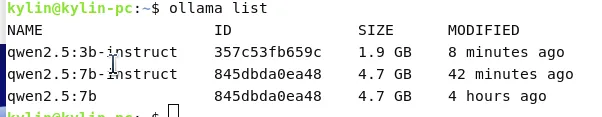

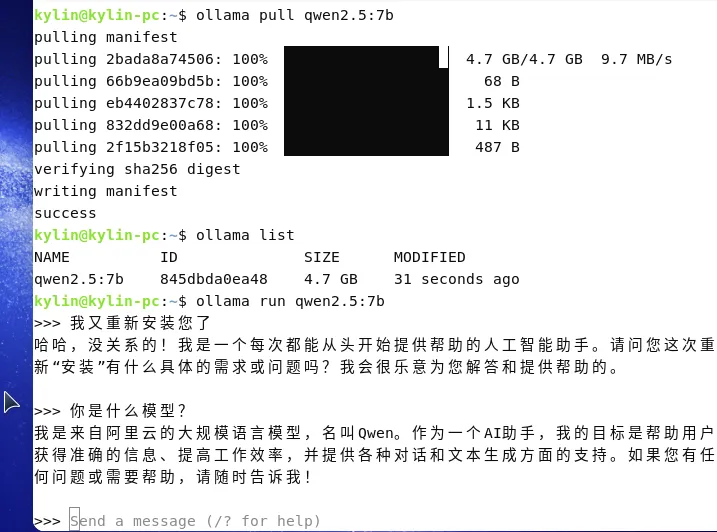

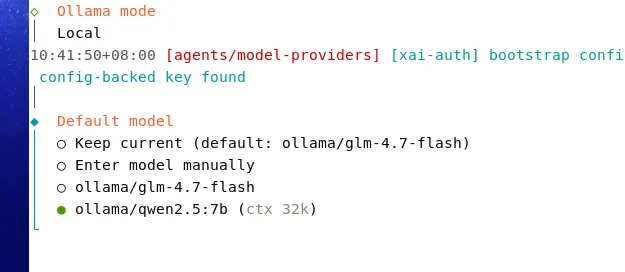

下载qwen2.5:7b或者3b模型

ollama serve

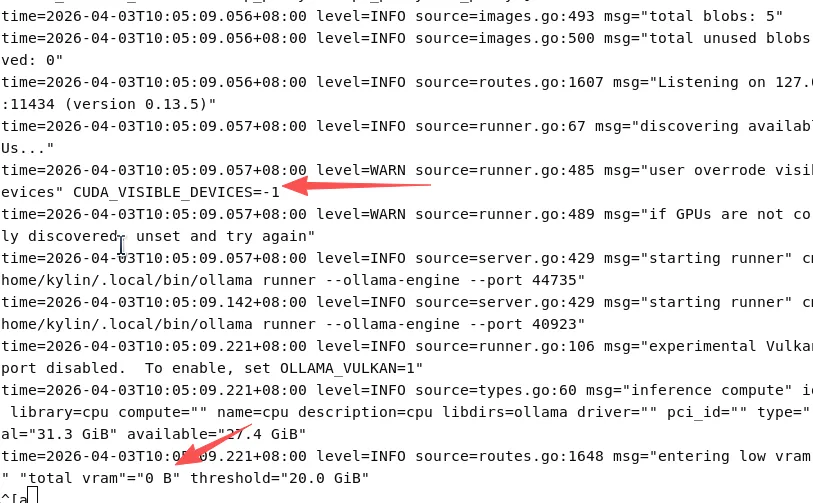

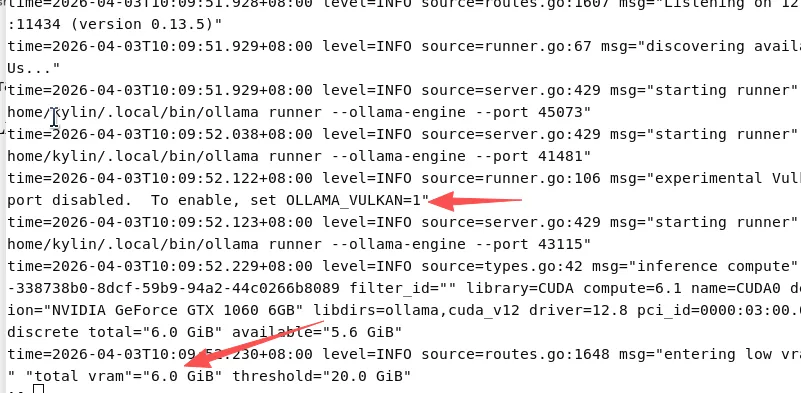

这个环境变量设置为-1导致系统无法检测到 GPU,所以现在只能使用 CPU 进行推理(显示 "total vram=0 B")

unsetCUDA_VISIBLE_DEVICES

输入命令“npm install -g openclaw@latest”全局安装最新版

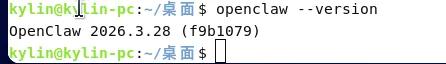

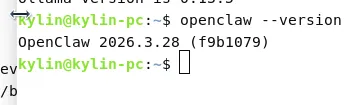

输入命令“openclaw --version”验证安装。输入命令“openclaw onboard --install-daemon”启动配置向导(安装后台守护进程)。

输入命令“openclaw --version”验证安装。

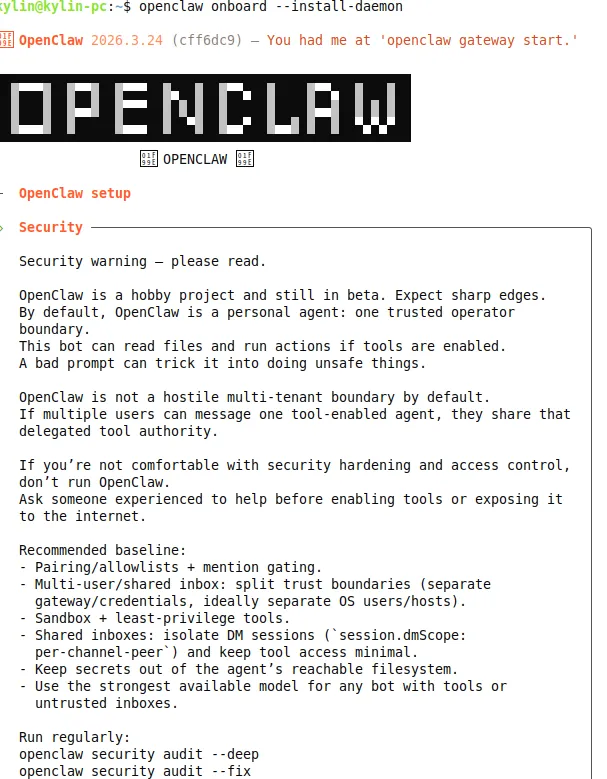

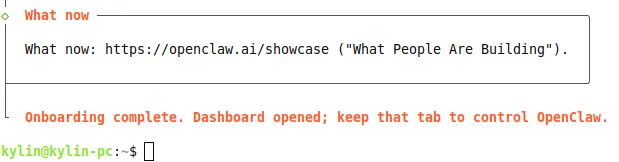

输入命令“openclaw onboard --install-daemon”启动配置向导(安装后台守护进程)。

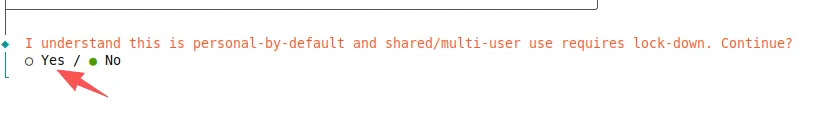

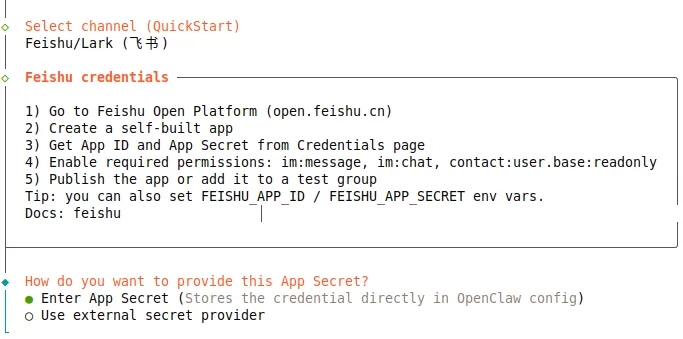

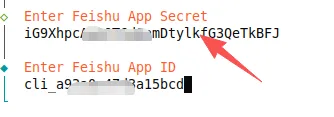

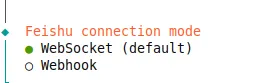

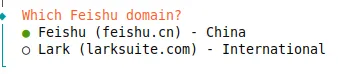

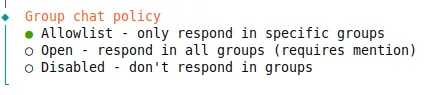

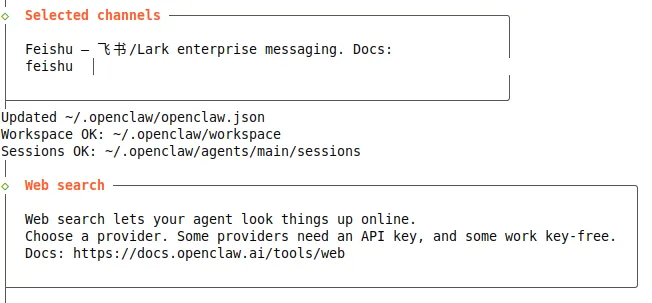

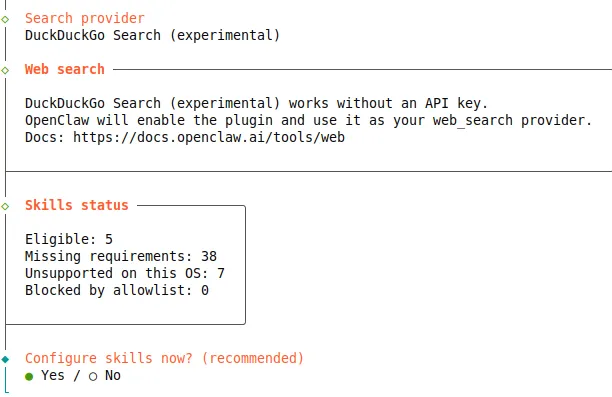

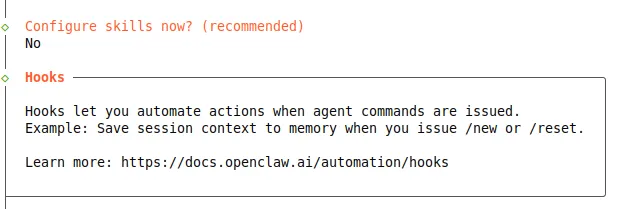

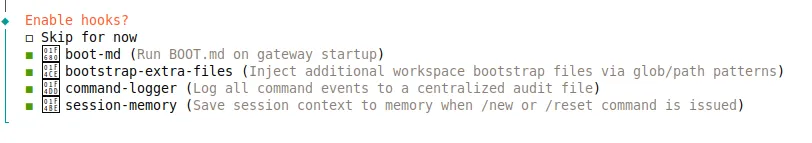

根据终端提示进行问题回答及能力项配置

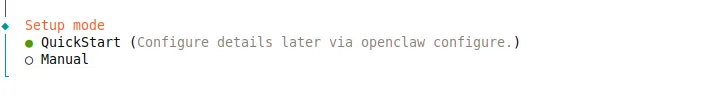

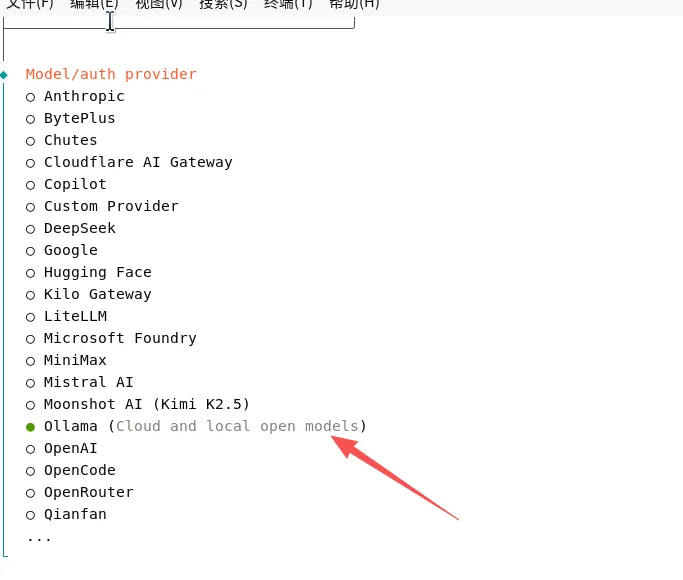

选择引导模式

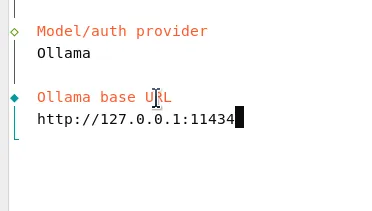

模型选择,推荐选择国产大模型或者本地部署

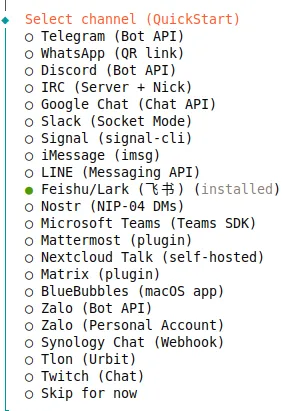

通讯软件选择

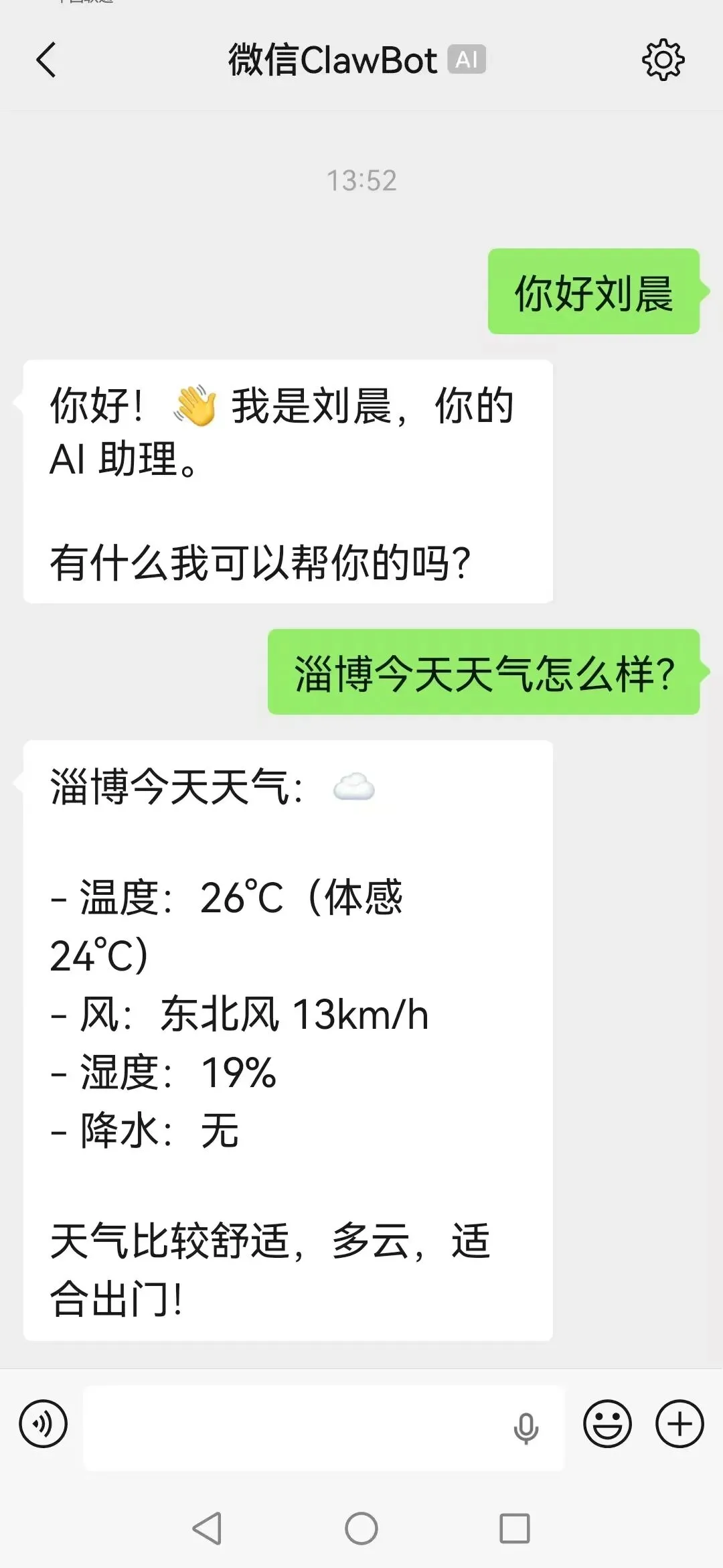

安装后验证与使用

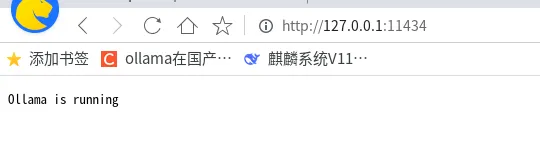

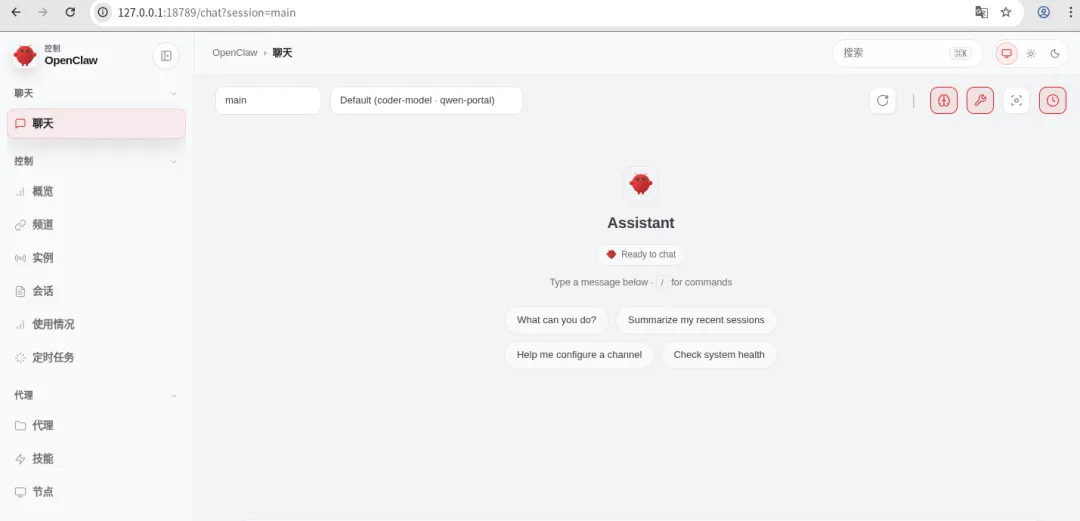

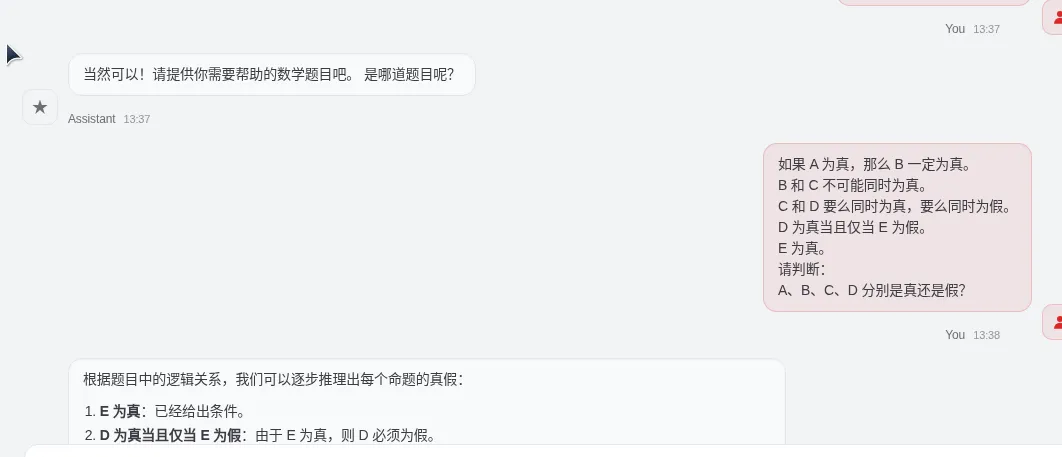

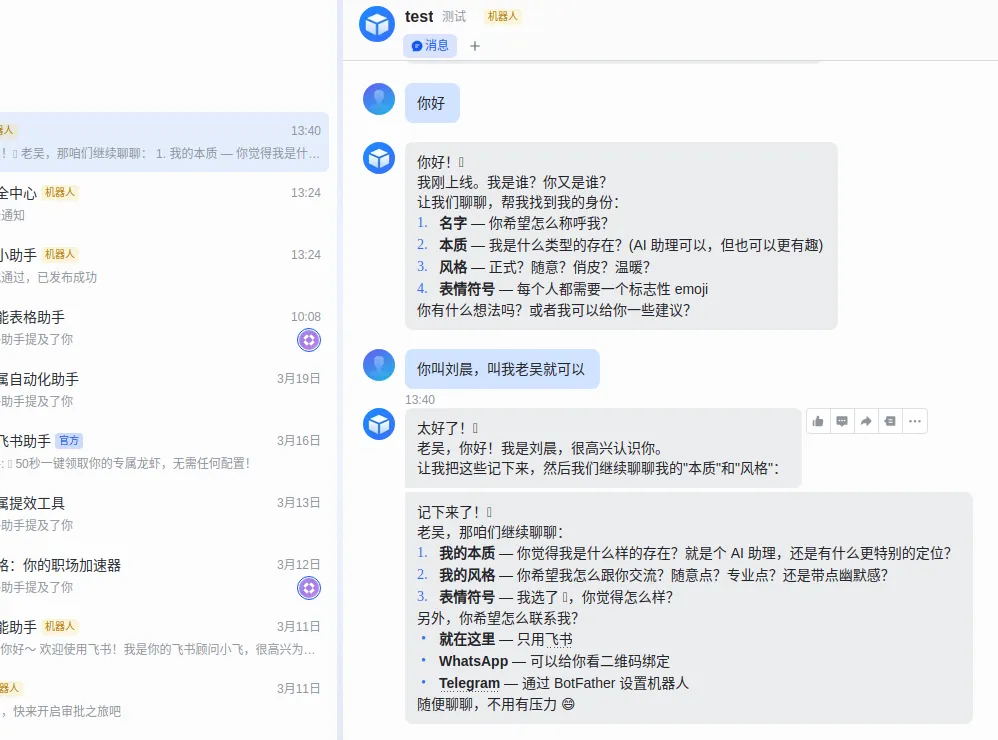

访问web面板(谷歌浏览器打开)

http://127.0.0.1:18789

启动后即可通过浏览器与OpenClaw进行聊天互动,并执行相关命令

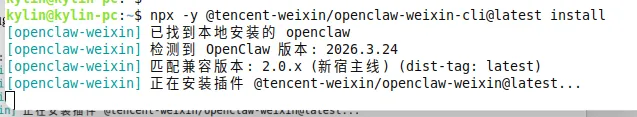

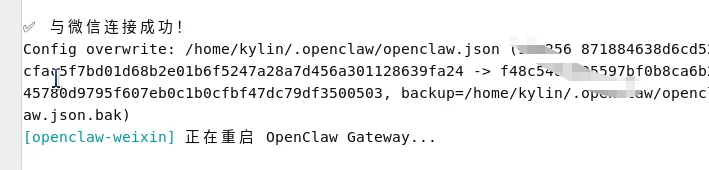

对接微信:

npx -y @tencent-weixin/openclaw-weixin-cli@latest install

夜雨聆风

夜雨聆风