从CPU到大模型,从内存到上下文窗口——硅谷顶级研究者们发现,我们正在用自然语言重新发明计算机

···

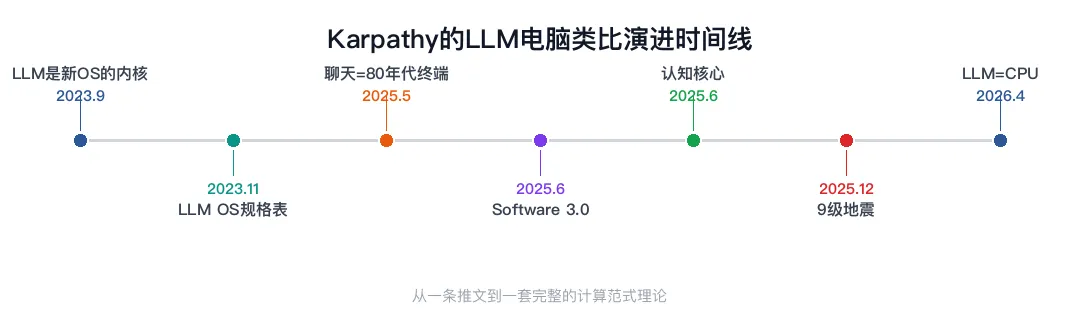

2023年9月,前特斯拉AI总监Andrej Karpathy发了一条推文,在整个AI圈引发震动:

“更完整的图景正在浮现——LLM不是聊天机器人,而是一种新型操作系统的内核进程。”

—— Andrej Karpathy,2023年9月

两年后的2025年底,他在年度回顾中更加确信地写道:LLM是下一个重大计算范式,类似于1970年代、80年代的计算机,我们将看到类似的发明浪潮——个人计算、微控制器(认知核心),以及智能体互联网。

而就在几天前(2026年4月1日),他把这个类比浓缩成了两行:

这不是一个人的一时灵感,而是一个持续进化了两年半的核心洞察。它精准地捕捉到一个越来越多人隐约感受到、却没人说清楚的事实:今天的AI系统,正在沿着计算机60年前走过的路,重新走一遍。

只不过这一次,最基本的计算单元不再是0和1,而是人类的自然语言。

···

一、一张表看懂:AI系统 = 新一代计算机

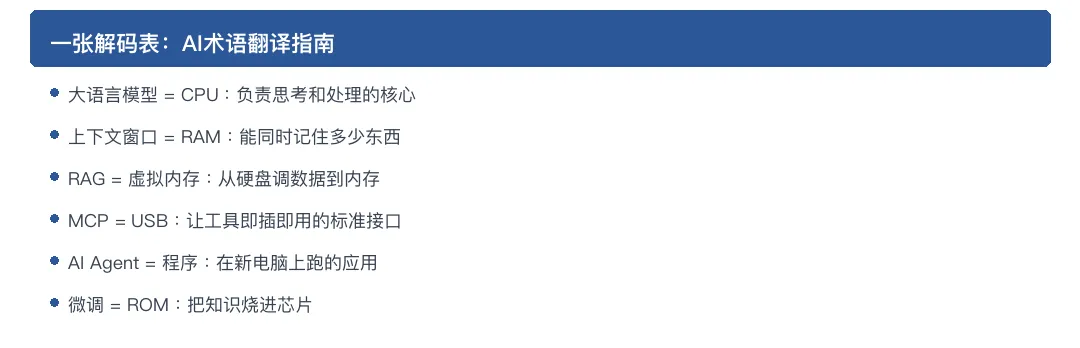

先看一张对照表。如果你用过电脑(当然你用过),那你已经具备理解现代AI架构的全部背景知识:

我们确实在用自然语言重新构建冯·诺依曼架构。

···

二、CPU:大模型是新的处理器

传统计算机的CPU执行指令、处理数据、协调一切。在AI系统中,大语言模型扮演的正是这个角色。

Karpathy在2023年11月甚至给"LLM电脑"写了一份硬件规格表:

“LLM OS 配置:OpenAI GPT-4 Turbo,256核处理器(批处理大小),主频20Hz(token/秒),内存128K token。”

—— Andrej Karpathy,2023年11月

这不是玩笑。传统CPU的核心数对应AI系统的并行处理能力(批处理大小),时钟频率对应生成速度(token/秒),指令集对应模型能理解的提示格式。研究者Beren Millidge甚至提出了一个新的性能单位:NLOP(自然语言操作/秒)——GPT-4大约跑在1 NLOP,GPT-3.5 Turbo大约10 NLOP。

区别在于:CPU处理的是二进制比特,LLM处理的是人类语言。这意味着你不需要学编程语言就能"编程"。英语(或中文)就是新的编程语言。

···

三、内存:上下文窗口就是RAM

你电脑的内存(RAM)决定了它能同时处理多少数据。打开太多Chrome标签页,电脑就卡了——因为内存不够用。

大模型的上下文窗口(Context Window)扮演着完全相同的角色。它决定了AI在一次对话中能"记住"多少信息。早期的GPT-3只有2K token的上下文(大约1500个汉字),相当于上世纪80年代Commodore 64电脑的64KB内存,勉强够用,但捉襟见肘。

今天的前沿模型已经把上下文窗口扩展到128K(Claude)甚至100万token(Gemini)。这就像从64KB内存一路升级到16GB,能同时处理一整本书的内容。

但内存永远不够用。这在传统计算机和AI系统中都是真理。

传统计算机的解决方案是虚拟内存:当RAM不够时,把暂时不用的数据换到硬盘上,需要时再换回来,让程序以为自己有无限的内存。

AI系统正在重新发明同样的技术。UC伯克利的研究团队在2023年发表的MemGPT论文中,明确将这套机制命名为"虚拟上下文管理",把当前不需要的信息存到外部数据库,需要时再检索回上下文窗口。我们熟知的RAG(检索增强生成),本质上就是AI版的"从硬盘读取数据到内存"。

···

四、USB:MCP是AI世界的万能接口

还记得USB出现之前的日子吗?打印机用并口,鼠标用PS/2口,相机用FireWire,手机用各家专属充电线。每换一个设备就要找一根不同的线,驱动程序还经常装不上。

2024年之前的AI工具集成就是这种状态。要让Claude读你的文件?写一套自定义代码。让GPT查数据库?再写一套。每个AI模型对接每个工具都需要单独开发适配器。

MCP(模型上下文协议)就是AI世界的USB。 它由Anthropic在2024年底提出,迅速被整个行业采纳。有了MCP,工具开发者只需要按标准协议实现一个"MCP服务器",任何支持MCP的AI应用都能直接使用它,就像USB设备插上就能用。

业界直接把MCP称为"AI的USB-C"。架构上一一对应:

▪宿主应用(Claude桌面版、VS Code)= 你的电脑

▪MCP客户端(智能体)= 设备驱动程序

▪MCP服务器(Slack、数据库、浏览器)= 外设

原本M×N的集成噩梦,变成了M+N的标准化生态。

···

五、智能体:在AI电脑上运行的程序

前面的类比都是"硬件层"的。但一台电脑光有CPU和内存没有用,你还需要程序。

在传统计算机上,程序是一段预先编写好的指令序列,操作系统负责调度它们的执行。在AI系统中,智能体(Agent)就是程序。它接收一个目标("帮我订一张下周二去上海的机票"),然后自主规划步骤、调用工具、检查结果、修正错误,直到任务完成。

这也解释了为什么2024-2025年"AI Agent"成为最热的关键词。它不是一个独立的新发明,而是这台"LLM电脑"上自然而然会出现的东西:有了处理器(模型)、内存(上下文)、硬盘(向量数据库)、外设接口(MCP),下一步当然是在上面跑程序。

而这台电脑的操作系统是什么?Wix工程团队的技术文章给出了一个精妙的回答:系统提示词就是AI的内核。它定义了模型的基本行为规则和安全边界,用户的输入运行在"用户空间",工具调用相当于"动态链接库"。

···

六、我们正处在AI的"1960年代"

Karpathy在2025年的一次演讲中做了一个更宏大的类比:今天的AI产业格局,和1960年代的计算机产业惊人地相似。

1960年代,计算机是昂贵的大型机,由IBM等少数厂商垄断,用户通过简陋的终端远程访问。今天的大模型也是如此:训练一个前沿模型耗资数亿美元,由少数几家公司运营,用户通过API或聊天界面远程调用。操作系统的格局也在重演——GPT和Claude像Windows和macOS(闭源、商业化),LLaMA和Mistral像Linux(开源、社区驱动)。

Karpathy把软件的进化概括为三个时代:

▪Software 1.0:人类用代码写逻辑

▪Software 2.0:神经网络从数据中学习逻辑

▪Software 3.0:用自然语言指挥AI执行任务

如果这个"1960年代"的类比成立,那么接下来会发生什么?

Karpathy自己已经在沿着这条时间线往前看了。2025年5月,他发推说:

“"聊天"式的LLM交互,感觉就像在用80年代的电脑终端。GUI还没有被发明出来。”

—— Andrej Karpathy,2025年5月

同年6月,他进一步描绘了"个人电脑"时代的雏形:

“LLM认知核心的竞赛——一个数十亿参数的模型,最大限度地牺牲百科知识来换取能力。它常驻在每台电脑上,作为LLM个人计算的内核。”

—— Andrej Karpathy,2025年6月

历史告诉我们:大型机之后是个人电脑,个人电脑之后是互联网,互联网之后是智能手机。每一次,计算变得更便宜、更普及、更贴近每个人的日常生活。AI大概率会走同样的路——从今天的云端大模型,走向每个人口袋里的个人AI。Karpathy所说的"认知核心",也许就是AI时代的"个人电脑"。

···

七、9级地震

对于身处这场变革中心的程序员来说,这种"重走一遍"的感受已经不是比喻,而是切肤之痛。2025年底,Karpathy发出了他有史以来传播最广的一条推文(5.6万点赞,1680万次浏览):

“我从未如此强烈地感到自己作为程序员落后了……有一个全新的可编程抽象层需要掌握——智能体、子智能体、提示词、上下文、记忆、权限、工具、插件、技能、MCP……某种强大的外星工具被分发了下来,但它没有说明书,所有人都得自己摸索怎么用,而由此引发的9级地震正在撼动整个行业。”

—— Andrej Karpathy,2025年12月27日

注意他用的词:"可编程抽象层"。这恰恰是计算机科学中描述系统架构分层的标准术语。即便在表达焦虑时,他的思维框架依然是:这是一台新电脑,我们正在学习它的编程方式。

···

八、一把解码钥匙

这套类比最大的价值,是给了你一个现成的思维框架。下次再看到AI新闻里的术语轰炸,试着做一次翻译:RAG就是"从硬盘调数据到内存",MCP就是"USB即插即用",Agent就是"在这台新电脑上跑的程序",微调(Fine-tuning)就是"把知识烧进ROM"。

一旦建立了这个映射,AI就不再是一个需要从零学起的陌生领域,而是一个你已经直觉理解了六十年的老故事的新版本。

计算机用了60年从大型机走到智能手机。AI正在以百倍速重走这条路。

而这一次,你不需要学编程,只需要会说话,就能驾驭这台新电脑。

···

上一次人类发明通用计算机,它改变了文明的走向。这一次,计算的基本单元从比特变成了语言。故事才刚刚开始。

夜雨聆风

夜雨聆风