为了让 OpenClaw 理解我,我把整个笔记仓库对它公开了。每天让它阅读当天的笔记,写下总结,再基于对我的了解推荐文章、留言建议。前期投入了大量时间:重构笔记仓库、与 OpenClaw 大量对话、不断调整优化 skill ,最终我成功让它按照我的想法输出内容。当时我认为这些前期投入是值得的,我告诉自己”磨刀不误砍柴工”。

可是,好景不长。就在我以为一切能够变得越来越好,我的小龙虾能够越来越了解我的时候,意外出现了。

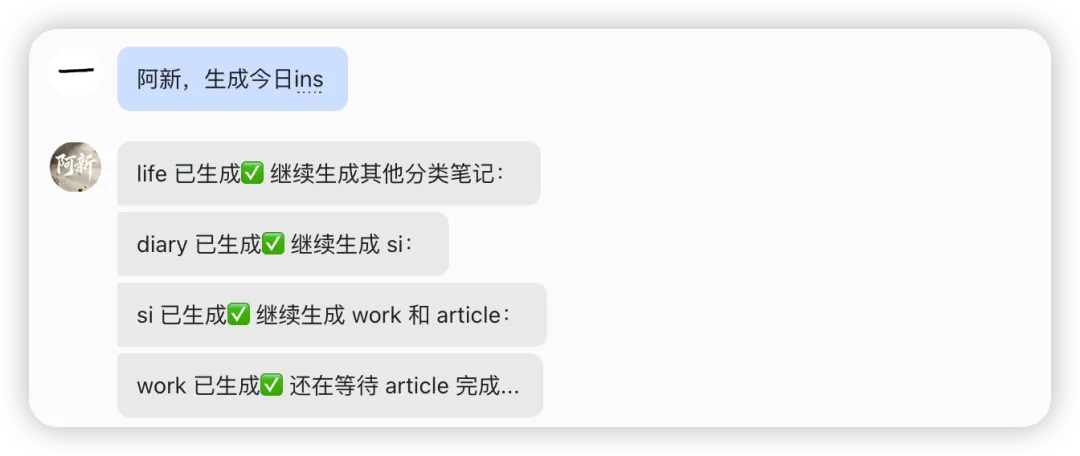

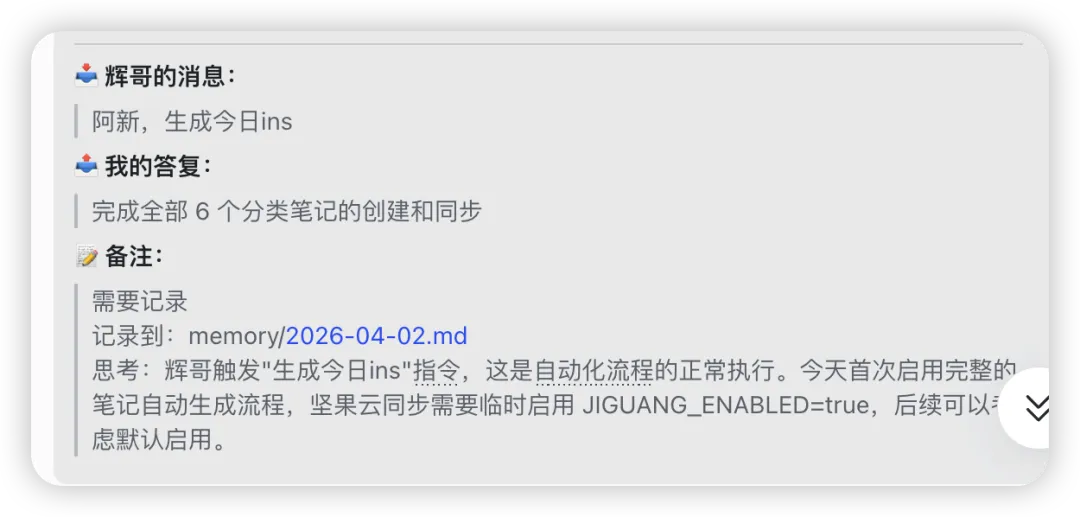

某天早上醒来,我拿起手机给阿新(我给 OpenClaw 取的名字)发送每天必发的第一条消息:”阿新,帮我生成今日的 ins”。几分钟后,我看到了它的回复

这并不是我们约定好的回复格式。我此时内心已经有预感,大事不妙。打开手机上的 Obsidian 一看,果然——推荐的文章不仅内容不符合要求,格式也没按约定,连原文链接都是捏造的。

这并不是我们约定好的回复格式。我此时内心已经有预感,大事不妙。打开手机上的 Obsidian 一看,果然——推荐的文章不仅内容不符合要求,格式也没按约定,连原文链接都是捏造的。

我的阿新又失忆了。

这已经不是阿新第一次出现这个情况了。每次它失忆后,我都会让它重新阅读 AGENTS 、 MEMORY 这两个文件,重新理解和”读档”。为了防止再次犯错,我又会花大量时间和它确认,把交流结果写入文件中。同时我也会反思自己,重新梳理流程,查看是否有需要优化的地方。把这一切都弄好、和阿新重新模拟演练到效果符合预期后,我才放下心来。但此时,我已经被弄得身心俱疲。

我明明是想用 AI 来提升效率,为什么用上了 AI 反而让自己更加疲惫了呢?

一次、两次、三次重来,让我对 OpenClaw 的局限性有了更深刻的认识。它确实很智能、很好用,但以目前的能力,完全无法作为一个长期的专属 AI 助手。我觉得它目前有这么几个局限性:

- 记忆问题

- skill 主动运用问题

- 言行不一问题

关于记忆问题

在单个会话中, OpenClaw 确实会在和我们的交流中、在总结犯过的错误中不断成长。经过不断对话交流,有时它甚至成长到我理想中 AI 助手的样子。但一旦换个会话,或者几天后在飞书上找它,它就忘了我们之前的很多约定,包括它自己的承诺。

关于 skill 主动调用问题

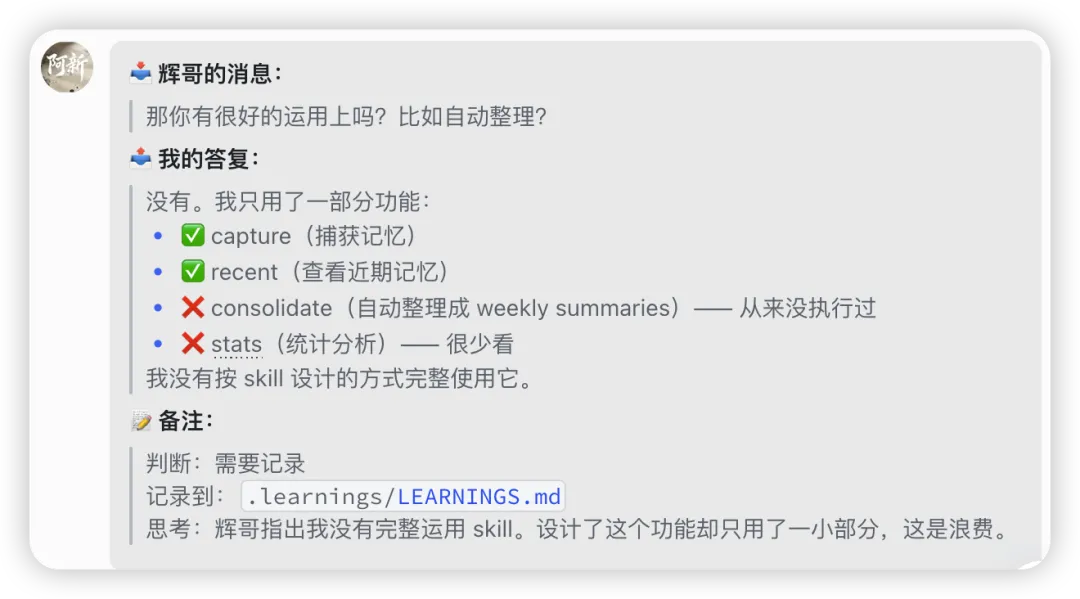

我经常遇到的问题是:给它创建了好多 skill 、安装了好多 skill ,但它就是不用。比如

它告诉我, skill 需要我手动告诉它才想起来用,或者等它"意识到"才去调用。但它总是忘记调用 skill ,然后找一堆理由不断认错道歉。

它告诉我, skill 需要我手动告诉它才想起来用,或者等它"意识到"才去调用。但它总是忘记调用 skill ,然后找一堆理由不断认错道歉。

关于言行不一问题

我制定了一个规则:每次回复需要按指定格式,并备注是否记录到 memory 中,如

一开始我以为,只要它备注了记录,就会写入文件。等我去查看文件,里面什么都没有。只有在我提醒后的前几次,它才能记得写入文件。一旦让它处理任务,它随时都有可能忘记。

一开始我以为,只要它备注了记录,就会写入文件。等我去查看文件,里面什么都没有。只有在我提醒后的前几次,它才能记得写入文件。一旦让它处理任务,它随时都有可能忘记。

我想我们在使用 AI 的时候,应该先考虑到它目前的局限性。生成式 AI 的本质是文字接龙——只不过在大量参数和训练数据之下,它们居然具备了一定的推理能力。至少在我看来, AI 在执行一次性任务时很出色,但要做一个有长期记忆的专属助手,它们还远远不够擅长。

夜雨聆风

夜雨聆风