大家好,我是良许。

最近有个读者问我,为啥Linux装软件总提示缺依赖,而Windows双击exe就能搞定?

这背后,是两套操作系统截然不同的设计哲学,也是历史选择的结果。

历史选择:打包式 vs 复用式

Windows的思路是“大礼包式”打包:装QQ这类软件时,会把所需的dll文件、运行库甚至浏览器内核全塞进安装包。

哪怕安装包动辄几百MB,但用户只需无脑点“下一步”,体验足够顺滑。

Linux则继承了早期Unix“资源复用”的核心思想——当年硬盘按MB计价,浪费是不可接受的。

系统里装一个libssl加密库,所有需要加密功能的软件都能共享,既省空间、易维护,修一个库的bug还能让全系统受益。

但代价也很明显:装Nginx要依赖OpenSSL,OpenSSL又依赖zlib,层层嵌套的依赖像搭积木,缺一块都装不了。

包管理器:解局者也藏新问题

为解决“依赖地狱”,Linux诞生了apt、yum、dnf等包管理器,能自动计算并安装依赖。

可实际使用中,版本冲突仍是高频坑:软件A要libpng 1.5,软件B要1.6,系统只能二选一,要么升级A、要么降级B,甚至两者都用不了。

更麻烦的是,不同发行版包管理器互不兼容,Ubuntu的deb包在CentOS上无法安装,开发者要为不同发行版打包,用户也跟着遭罪。

这还牵扯到链接技术:Linux默认动态链接,程序运行时才调用库文件,虽省资源但库版本一变,程序可能直接失效。

Windows虽也支持动态链接(dll文件),但多数软件会选静态链接或直接打包dll,哪怕浪费空间,却能保证五年后打开软件仍能正常运行。

新时代的折中方案

Linux社区也意识到普通用户的痛点,Snap、Flatpak、AppImage等新工具本质上是学Windows——把依赖全打包进单个文件,一键安装。

但这又回到老问题:装十个Snap应用可能有十个OpenSSL版本,库出安全漏洞时,得等每个应用开发者逐一更新,而非系统一键修复。

Docker容器化更是把“打包环境”做到极致:整个运行环境全封装,彻底告别依赖问题,却带来镜像体积动辄数GB、新手学习曲线陡峭的新问题。

而现在的趋势是两边互相借鉴:Windows推出winget包管理器,Linux推广自包含应用,都在试图找平衡。

没有完美方案,只有场景适配

说到底,这不是技术问题,而是选择问题:要灵活性还是便捷性?

要系统整洁还是开箱即用?

Linux的依赖机制在专业场景是绝对优势:几百台服务器统一升级OpenSSL补丁,包管理器一条命令就能搞定,Windows挨个软件更新的模式根本做不到。

但对普通用户来说,装软件要学命令行、懂依赖关系,门槛太高,这也是Linux桌面市场份额始终难提升的核心原因。

Windows的模式胜在易用,却输在批量管理和维护效率;Linux赢在专业场景的灵活与高效,却在普通用户体验上落了下风。

或许未来两种模式能找到平衡点,但在此之前,我们大概率还得继续和“缺少libxxx.so”的报错较劲。

大家好,我是良许,一个深耕嵌入式12年的老工程师,前世界500强高工。

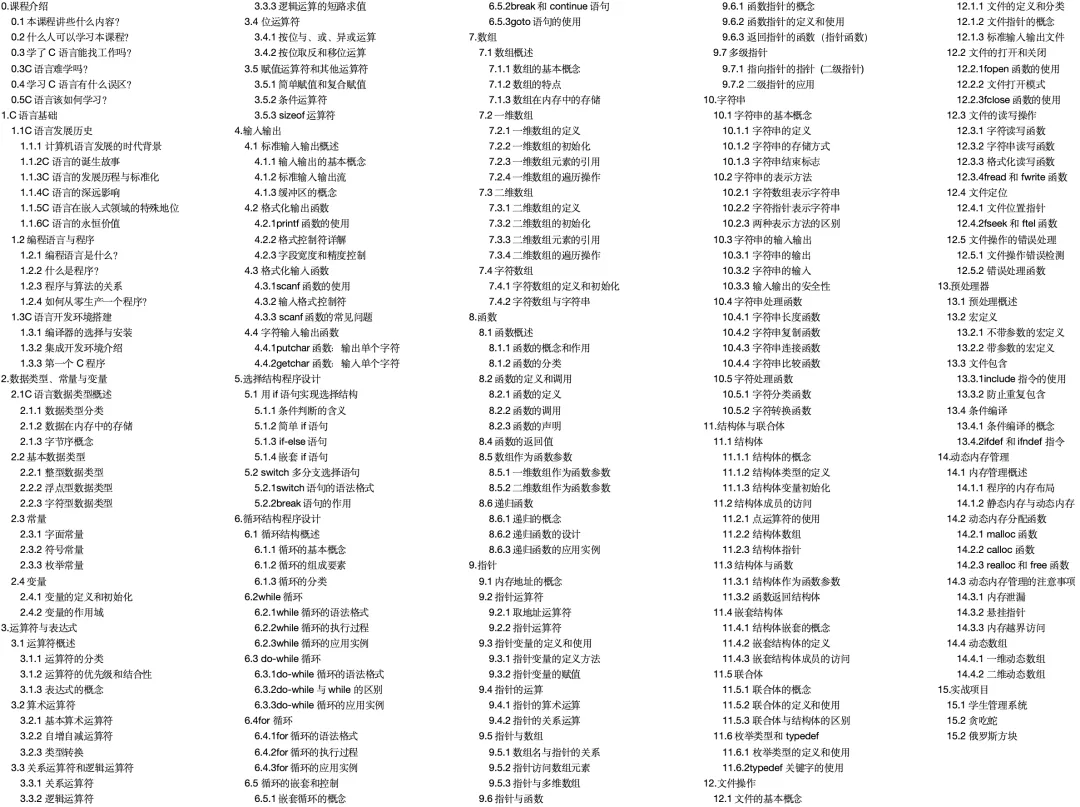

我花了3个月时间,写了一个C语言电子书,以非常通俗的语言跟大家讲解C语言,把复杂的技术讲得连小学生都能听得懂,绝不是AI生成那种晦涩难懂的电子垃圾。

C语言电子书目录如下:

夜雨聆风

夜雨聆风