大家好,我是寂寞的熊猫。

之前写过一篇Claude Code 源码泄露:从 51 万行代码里学到了什么,里面有一个隐藏模块——autoDream,一个在用户空闲时偷偷启动的后台记忆重组机制。

如果 AI 的记忆管理能像人类睡眠一样,有浅睡、深睡和 REM 周期,Agent 的长期记忆质量会不会有质的飞跃?

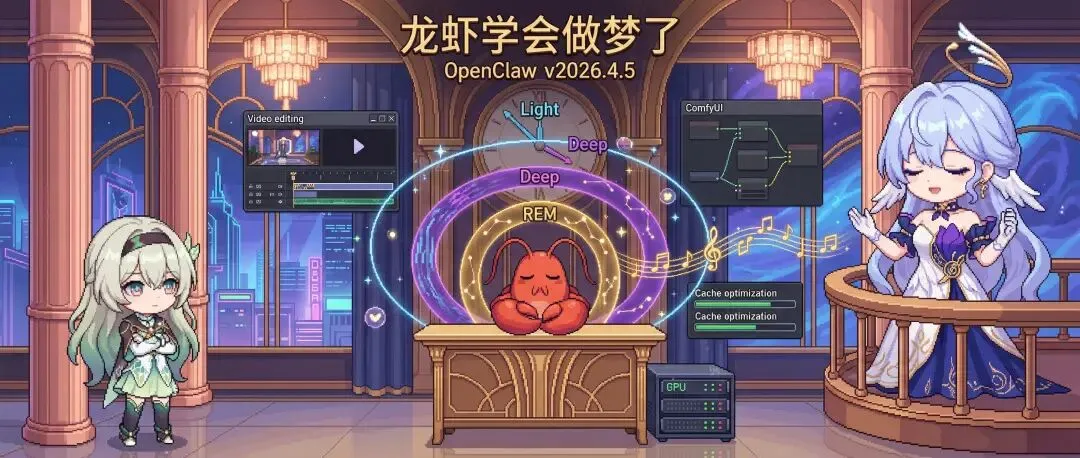

OpenClaw 现在的最新版本 v2026.4.5,里面最核心的新功能就是一个叫 Dreaming 的记忆系统——把 Claude Code 藏在闭源代码里的 autoDream 实现了,而且是透明的、可审计的、用户完全可控的。

这只是这次更新的一部分。完整的 changelog 包含了约 40 项重大新特性和数百项底层优化。

省流版

- Dreaming 记忆系统——三阶段记忆消化(Light/Deep/REM),开源实现了 Claude Code 泄露代码中 autoDream 的核心理念,但完全透明、可观测、用户可控

- video_generate 和 music_generate 变成内置工具——不再是插件,Agent 可以直接调用 xAI、阿里万相、Runway、Google Lyria 等多家服务生成视频和音乐

- ComfyUI 深度绑定——不只是调 API,而是能直接操控本地的 ComfyUI 工作流节点图,配合本地 GPU 跑出完整的媒体生产流水线

- Prompt Cache 大幅优化——6 个 PR 同一天密集合并,缓存前缀稳定性做到字节级,长期运行 Agent 的 token 成本可能降低 30-50%

- 新增 Qwen、Fireworks、StepFun 等提供商——模型解耦继续加速,绑死一家提供商已经不是 OpenClaw 的风格了

Dreaming 是什么功能

在 Claude Code 源码中,我们发现了一个被 Feature Flag 锁死的后台进程 autoDream。它的设计思路是:用户空闲时,系统在后台偷偷扫描、合并、提炼记忆。但这个功能是封闭的、不可观测的。

之前 OpenClaw 的记忆管理是"被动"的——你问了它才记,不问就忘。上下文塞满了就压缩,压缩完继续塞。这种方式有个致命问题:短期记忆膨胀,长期记忆缺失。Dreaming 系统改变了这个逻辑。它模拟了人类睡眠的三个阶段:

第一阶段:Light Sleep(浅睡眠) Agent 空闲时自动扫描近期的 JSONL 会话日志。不做什么复杂分析,就是先把垃圾过滤掉——重复指令、格式错误的操作痕迹、毫无价值的临时数据,统统丢掉。只保留可能有长期价值的偏好变化和重要决策信号。说白了就是"睡前先整理桌面"。

第二阶段:Deep Sleep(深睡眠) 系统把相对时间标记(比如"昨天""上周")转化为绝对时间戳,消除不同时期产生的指令矛盾,然后把新发现的事实安全合并到现有记忆结构里。

一个关键设计是"重放安全"(Replay-safe)——即使发生异常中断,重新执行也会智能对账,不会在 MEMORY.md 里产生重复条目。这个细节说明 OpenClaw 团队在工程上想得很清楚。

第三阶段:REM(快速眼动期) 最有想象力的一步。REM 阶段不只是存储事实,而是试图发现跨度极大的信息之间的隐藏关联,提取"持久性真理"(Lasting Truths)。所有发散性思考被隔离写入独立的 dreams.md 文件,日常默认不召回,但用户可以主动查阅。

和 Claude Code 的 autoDream 对比一下很有意思:

| 维度 | Claude Code autoDream | OpenClaw Dreaming(开源) |

|---|---|---|

| 可见性 | 仅内部员工分析看板 | /dreaming 命令 + Dreams UI,用户随时查看 |

| 记忆存储 | 合并到内部结构 | dreams.md 独立文件,与主记忆隔离 |

| 容错机制 | 未公开 | Replay-safe,中断后重跑智能对账 |

| 配置控制 | Feature Flag 硬编码 | recencyHalfLifeDays、maxAgeDays 可调 |

对长期运行的生产力 Agent 来说,这个变化是根本性的。你的 Agent 不再只是一个"你问它答"的工具——它在你不跟它说话的时候,也在默默消化之前的交互,提取规律,积累经验。

视频和音乐能力集成

v2026.4.5 把 video_generate 和 music_generate 提升为系统级内置工具。

之前做视频和音乐生成靠第三方插件,不稳定、配置复杂、容易断。现在变成了原生能力,系统自动路由到合适的提供商:

- 视频:xAI 的 grok-imagine-video、阿里巴巴 Model Studio 的万相(Wan)、Runway——三个提供商覆盖了不同风格和需求

- 音乐:Google Lyria、MiniMax,加上 Comfy 工作流支持——从纯音乐到带参考曲风都能搞

- 容错设计:部分平台不支持某些参数(比如

durationSeconds),系统不再硬崩溃,而是发出警告继续执行

这不是"加了个视频按钮"那么简单。这是 Agent 从文本交互工具向全栈内容生产平台的定位转变。

ComfyUI 深度集成

这个功能对有本地算力的用户来说是大利好。OpenClaw 引入了针对本地 ComfyUI 的深度媒体插件绑定。不是简单调个 API,而是能直接读取、理解、注入提示词,操控本地的 ComfyUI 节点工作流图。

- 支持 prompt 注入到工作流节点

- 支持参考图像自动上传

- 支持实时测试和进度查看

- 支持结果文件自动下载整理

你可以把它理解成:OpenClaw 变成了一个能自主操控 ComfyUI 的"美术总监"。 如果你有本地算力资源,OpenClaw 可以用本地算力完成从图片到视频的完整生产链。

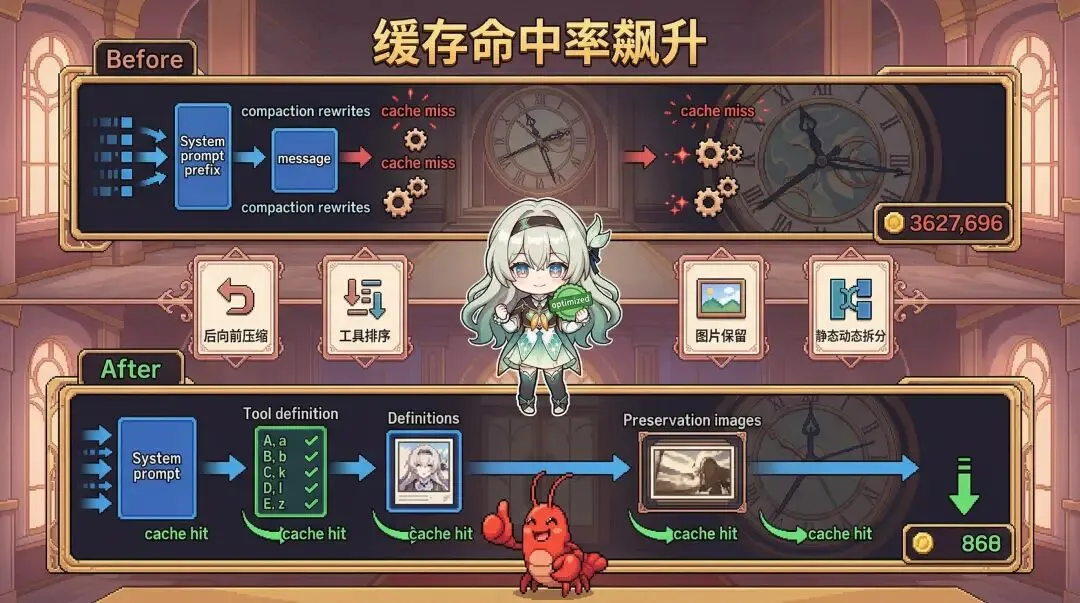

Prompt Cache 优化

这次更新有一组不太起眼但极其重要的改动——6 个 prompt cache 相关的 PR 在同一天(4 月 4 日)密集合并。核心问题是:Agent 每次调用模型时,都要把系统提示词、工具定义、历史会话全量发给模型。如果这些"前缀"每轮都在变,缓存就全废了,每次都要重新算。

OpenClaw 做了几个关键修复:

- 压缩方向从"从前往后"改为"从后往前"——改写最早的消息而不是最新的,保持前缀不变

- 工具列表按名称排序——MCP listTools() 返回顺序不稳定,排序后工具定义变成确定性序列

- 历史图片保留窗口扩大——不再每轮都裁剪历史图片,减少对已发送内容的改写

- 系统提示词拆分静态/动态块——以 transport 为边界,让可缓存部分尽量稳定

这些改动不是什么黑科技,但都是"把正确的事做对"。 对长期运行的 Agent 来说,cache 命中率每提高 10%,token 成本就降一截。如果你的 Agent 是 7x24 小时跑的,这个优化实际省下的钱可能比你想象的要多得多。

新增多个模型适配

v2026.4.5 新增了多个提供商的原生支持:

- Qwen(通义千问):直接用,不用手动配置 OpenAI 兼容接口

- Fireworks AI:高性能推理云,适合需要低延迟的场景

- StepFun(阶跃星辰):国内另一个选择

- Amazon Bedrock Mantle:自动发现推理配置文件 + IAM 认证,AWS 用户的福音

- MiniMax TTS 和 Search:语音合成和搜索也加进来了

同时,配置别名做了一次大清理。旧版的 talk.voiceId、talk.apiKey 等遗留别名被移除,统一的 openclaw doctor --fix 可以自动修复。升级的时候跑一下这个命令,基本不会翻车。

多语言 Control UI

Control UI 新增了简体中文、繁体中文在内的 13 种语言支持。之前全是英文的操作面板,现在对国内用户友好多了。Skills 面板也加了 ClawHub 搜索、详情和安装功能,不用离开 UI 就能发现和装新 Skill。

写在最后

Claude Code 源码中 autoDream 的设计思路,现在 OpenClaw 把这个功能开源实现了。

- 用户可以理解系统在做什么、为什么这么做,而不是盲猜。

- 用户可以调节

recencyHalfLifeDays和maxAgeDays控制记忆衰减速度,而不是被硬塞一个无法调节的默认值。 - 用户可以看到 Agent 记忆如何随时间积累经验。

如果对AI个人提效,以及副业感兴趣,而不只是围观,也推荐加入 IDO 老徐 的知识星球:AI 落地实战 · DeepSeek · OpenClaw。

里面会持续分享 OpenClaw 相关内容、AI 工作流搭建、商业化落地和各种实战避坑经验。

夜雨聆风

夜雨聆风