2026年的今天,本地AI已经不是什么极客玩具了。你不需要懂代码,不需要高配电脑,甚至不需要显卡。一条命令,主流大模型就能在你自己的机器上跑起来,数据永远不离开你的硬盘。

今天拿Ollama 举个例子,它是目前最流行的本地大模型运行工具,没有之一。

为什么选Ollama

市面上的本地AI工具不少,Ollama能杀出来,靠三件事:

第一,对小白友好。不需要配环境、不需要懂Docker、不需要折腾命令行参数。Windows、Mac、Linux全覆盖,下载安装,点两下就完事。

第二,模型生态丰富。主流开源模型基本都能跑:通义千问、Llama、DeepSeek、CodeLlama……想换就换,一个命令搞定。

第三这款AI工具完全免费,所有对话和运算数据都只存在你本地设备,没有任何云端同步流程,是专属于你的私人AI助理,其他人根本没权限查看你的使用内容。

十分钟安装指南

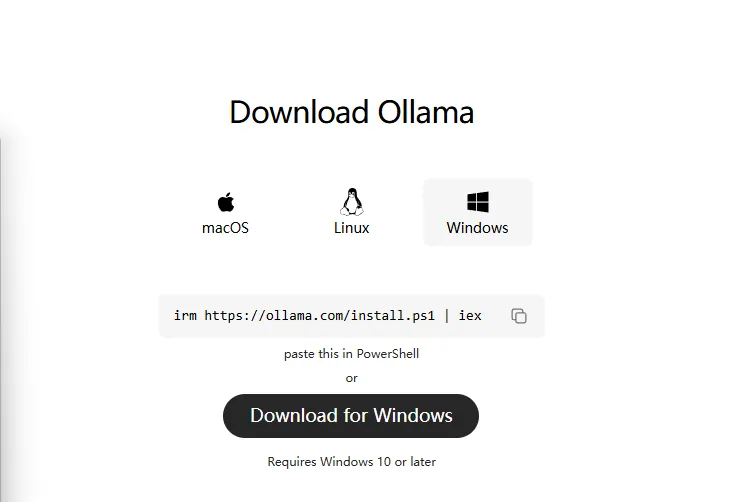

第一步:下载安装

打开https://ollama.com,首页就能看到下载按钮。根据你的系统点击下载,然后一路点"下一步"就行。

安装完成后,命令行里输入`ollama`,如果看到一串帮助信息,说明装好了。

第二步:选一个模型

新手推荐从通义千问(Qwen)开始,这是阿里开源的模型,中文理解能力强,体积也相对较小。

在命令行输入:

>>>ollama run qwen

Ollama会自动下载模型。第一次下载需要等一会儿,取决于你的网速。下载完成后,你就能直接和它对话了。

就这么简单。没有第三步。

接下来跑起来试试

模型加载完成后,你会看到命令行变成了一个对话界面。直接输入问题就行:

>>> 你好,你能做什么?

通义千问会告诉你它能帮你写文案、总结文档、分析数据……基本上和在线AI助手差不多。

退出对话输入`/bye`,或者直接关掉命令行就行。

进阶玩法:换模型、调参数

换模型

如果你想试试别的模型,Ollama的模型库基本涵盖主流开源大模型。常见的有:

- `ollama run llama3` —— Meta的开源模型,英文能力强

- `ollama run deepseek-coder` —— 国产代码专用模型,程序员友好

- `ollama run mistral` —— 欧洲团队开发的轻量模型,小巧快速

想查还有什么模型?去[ollama.com/library](https://ollama.com/library) 看看,主流的基本都有。

调参数

Ollama支持一些基础参数调整,比如上下文长度、temperature(影响随机性)。

ollama run qwen --num-ctx 8192 --temp 0.7

--num-ctx控制上下文窗口大小,数字越大,能记住的对话越长。`--temp` 控制回答的随机性,0到1之间,偏低更保守,偏高更有创意。

日常使用默认参数就够,这步可以跳过。

实用场景举例

光说不练假把式,说几个我自己在用的场景:

场景一:处理敏感文档

有时候需要AI帮忙分析合同、报表,但这些东西不方便上传到在线服务。用本地Ollama就能解决这个问题——文件在你的电脑上,AI也在你的电脑上,数据永远不会离开你的硬盘。

直接把内容复制粘贴给AI就行,它一样能帮你总结要点、找出风险点。

场景二:离线写作助手

出门在外没网的时候,在线AI就用不了了。本地Ollama不依赖网络,随时随地都能跑。

我之前出差,在飞机上改方案,用Ollama跑通义千问帮忙润色,比憋着强多了。

场景三:代码辅助

程序员可以装一个代码专用模型:

>>>ollama run deepseek-coder

用它来写代码、查bug、解释逻辑。虽然比不上Claude这种顶级闭源模型,但胜在免费、离线、不用担心代码泄露。

你可能会问的问题

Q:我的电脑能跑吗?

A:看情况。通义千问、Llama这些轻量版模型,8GB内存的电脑基本能跑。16GB体验更好,能跑更大的模型。如果你想跑7B参数(大约4GB显存)的模型,普通的游戏显卡(GTX 1060以上)就够了。

Q:速度怎么样?

A:比在线AI慢一些,但能接受。问一个问题,等几秒到几十秒不等,取决于模型大小和你的硬件配置。日常用没问题,想追求流畅体验的话,配置高一些会好很多。

Q:数据真的安全吗?

A:Ollama没有任何联网功能(除了下载模型),所有对话都在本地处理。你可以断网运行,数据不会发送到任何服务器。

你平时有没有数据安全的顾虑?或者已经试过本地AI了?评论区聊聊。

夜雨聆风

夜雨聆风