你有没有想过——

为什么 ChatGPT 能写代码、查资料、帮你订机票?为什么 AI 助手越来越像一个"真正的人"?

背后,有一条清晰的技术进化链:LLM → Token → Context → Prompt → Tool → MCP → Agent → Agent Skill。读懂它,你才真正读懂了 AI 的未来。

🧠第一步:LLM是什么?

LLM(大语言模型),是一种基于海量文本训练出来的超大型模型。

底层架构叫做 Transformer——由 Google 在 2017 年的论文《Attention is All You Need》提出。有意思的是,Google 发明了这个架构,但率先把它工程化落地的,是 OpenAI。

2022 年 GPT-3.5 横空出世,让大众第一次感受到大模型的震撼。2023 年 GPT-4 发布,AI 讨论彻底引爆。此后 Claude、Gemini 百花齐放,进入群雄时代。

但 LLM 到底在做什么?说穿了很简单:

它在玩一个超级版"文字接龙"。

你输入一段文字 → 模型预测下一个最可能的词 → 再预测下一个 → 循环往复,直到回答完成。没有"理解",只有"预测"。但预测得足够好,就像真的理解了一样。

🔤 第二步:Token——AI 眼中的"字"

LLM 处理文本的最小单位,不是字,不是词,而是 Token。

你可以把 Token 理解为"半个词":

"今天天气怎么样"这句话,在模型眼里大概只有 4 个 Token。

这意味着什么?模型的处理成本、速度、限制,全都以 Token 计算。 你说的每一句话,都在消耗 Token。

📦 第三步:Context——AI 的"短期记忆"

很多人以为 AI 有记忆,其实没有。

Context(上下文) 是 LLM 每次处理请求时接收的"完整信息包",包含:

• 你本次输入的内容 • 所有历史对话记录 • 系统指令(System Prompt) • 可用工具列表

每次对话,平台都把这一整包内容发给模型,让它"假装"记得之前说了什么。

而 Context Window(上下文窗口) 决定了这个"信息包"的上限:

100 万 Token ≈ 一整部长篇小说的文字量。

当文档超出上限怎么办?就要用到 RAG(检索增强生成)——先把文档向量化存储,提问时只塞入相关片段,大幅节省成本。

💬 第四步:Prompt——驱动 AI 的"咒语"

Prompt(提示词) 是你发给 LLM 的指令,是影响模型输出最直接的因素。

Prompt 分两种:

| User Prompt | |

| System Prompt |

举个例子:如果 System Prompt 设置了"你是一位数学老师,不能直接告诉答案,要引导学生思考",那无论你问什么,模型都会遵守这个隐藏规则。

这也是为什么不同产品里的同一个 AI,表现差异那么大——背后的 System Prompt 不一样。

Prompt 越清晰、越具体,模型表现越好。 这就是所谓"Prompt 工程"的价值所在。

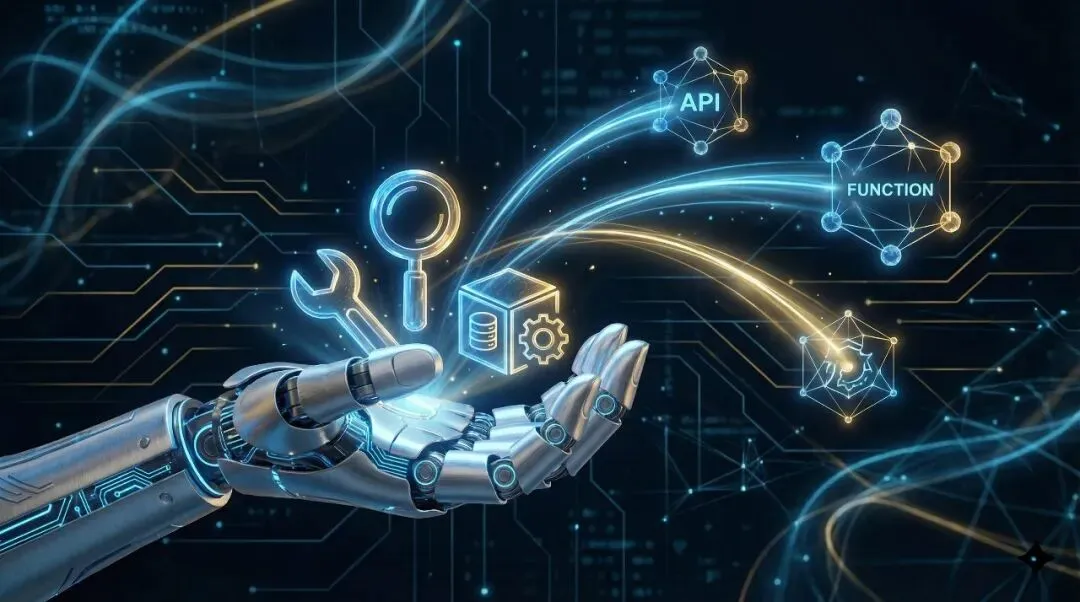

🔧 第五步:Tool——给 AI 装上"手"

LLM 本质上只能预测文字,它做不到:

• 查实时天气 • 调用外部 API • 操作文件系统 • 自主执行代码

Tool(工具) 解决了这个问题。工具调用的流程是这样的:

用户提问 → 平台把问题 + 工具列表 → 发给模型 → 模型"建议"调用某个工具(返回工具名+参数) → 平台实际去执行 → 把结果返回给模型 → 模型整合,生成最终回复注意:模型本身不能执行工具,只能"点菜",真正做菜的是平台。

角色分工清晰:模型负责决策,工具负责执行,平台负责中转。

🔌 第六步:MCP——工具的"Type-C 接口"

工具多了,问题来了:ChatGPT、Claude、Gemini 各有一套接入规范,开发者为同一个工具要写多套代码,维护成本极高。

MCP(Model Context Protocol,模型上下文协议) 就是来解决这个问题的。

一个类比就说清楚了:

MCP = AI 世界的 USB Type-C

统一标准,一次适配,所有支持 MCP 的平台都能用。

工具开发者只需按 MCP 规范写一次代码,就能在所有主流 AI 平台上运行。MCP 如今已是 AI 生态中工具集成的主流标准。

🤖 第七步:Agent——从"回答问题"到"自主完成任务"

普通对话:你问 → AI 答。一问一答,结束。

Agent(智能代理) 完全不同:

你给一个任务 → Agent 自主规划步骤 → 调用工具 → 逐步执行 → 完成任务

举个例子:你说"帮我找附近的本地特产店"

1. Agent 思考:需要先知道我在哪 2. 调用定位工具 → 获得坐标 3. Agent 思考:现在可以搜索了 4. 调用地图搜索工具 → 获得店铺列表 5. 整合结果,输出答案

全程你没有干预,Agent 自己规划、自己执行。这就是从 LLM 到 Agent 的质变。

主流 Agent 产品包括:Claude Code、Codex、Gemini CLI、OpenClaw 等。

📄 第八步:Agent Skill——给 Agent 一份"工作手册"

Agent 能力强,但每次执行复杂任务都要在 Prompt 里写完整的要求,既冗长又难维护。

Agent Skill 就是解决这个问题的设计——它是一份 Markdown 格式的"说明文档",告诉 Agent:

• 能干什么 • 怎么干 • 输出什么格式 • 遇到边界情况怎么办

一个标准的 Skill 文件(SKILL.md)包含:名称、功能描述、执行步骤、判断规则、输出格式。

最妙的是它的懒加载机制:Agent 不会一次性读取所有 Skill,只有当任务触发时,才加载对应的 SKILL.md,大幅节省 Token。

Skill + MCP 工具配合,实现了"行为规范 + 工具能力"的统一封装。

🗺️ 全局概念地图

读到这里,你已经掌握了整条进化链。来一张概念关系图收尾:

LLM(大语言模型) ├── Token:处理文本的最小单元 ├── Context:每次的"短期记忆"信息包 │ ├── Context Window:信息包容量上限 │ └── RAG:超长文档的检索方案 ├── Prompt:驱动模型行为的指令 │ ├── User Prompt:用户输入 │ └── System Prompt:后台隐藏指令 ├── Tool:让 AI 能操作外部世界的函数 ├── MCP:工具的统一接入标准(Type-C 类比) └── Agent:自主规划+多步执行的系统 └── Agent Skill:描述行为的工作手册AI 不是魔法,它是工程。理解这条进化链,你就理解了 AI 为什么越来越强大——以及它还差什么。

你最想深入了解哪个环节?留言告诉我 👇

夜雨聆风

夜雨聆风