从Prompt魔法到Harness缰绳,看懂自主智能体的骨架与灵魂。

在经历了大模型“能说会道”的惊艳期后,产业界的焦点正迅速转向 AI Agent(智能体)。

我们不再满足于一个只会写诗聊天的对话框,而是渴望一个能自动分析报表、操作软件、预订差旅的数字员工。

但理想丰满,现实往往骨感:要么是Agent忘记上一秒说过的话,要么是它自信满满地执行了 rm -rf(强制删除指令),酿成生产事故。

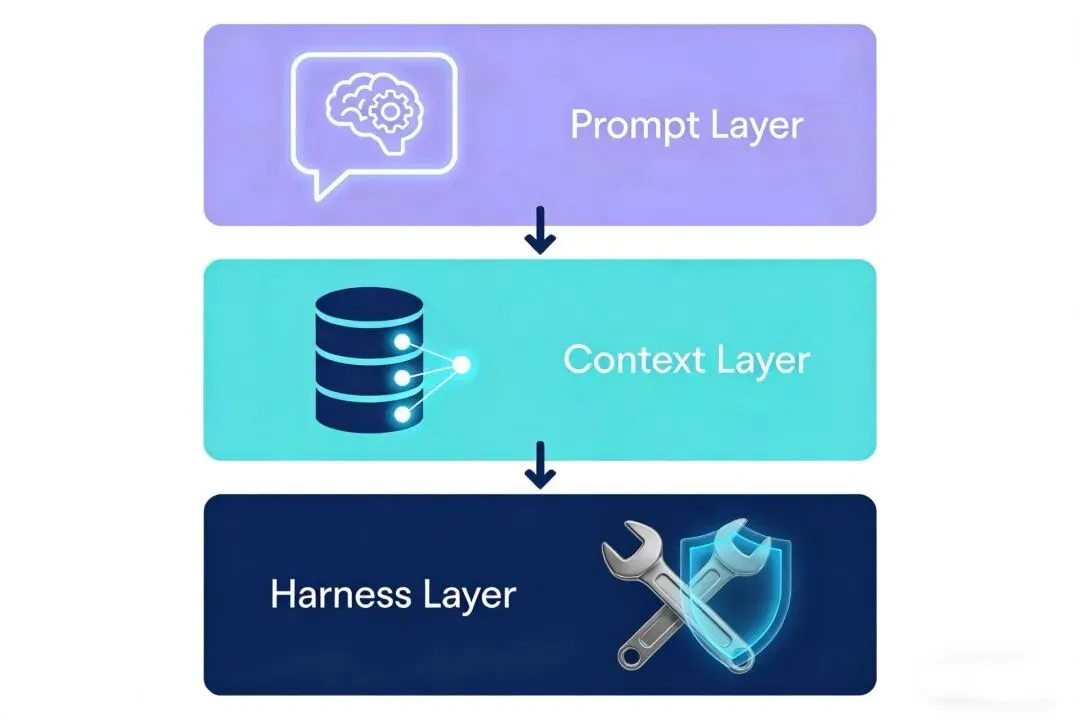

问题出在哪?答案在于架构。一个可靠的企业级Agent,绝非只靠一句精巧的提示词撑着。它遵循着一套严密的三层架构逻辑:Prompt层、Context层、Harness层。

今天,我们用一文深度拆解这三层是如何精密咬合,将“对话玩具”锻造成“生产力工具”的。

第一层:Prompt —— 不仅是问话,更是元指令集

定位:意图映射与角色约束的边界线

很多人把Prompt等同于“提问”,这是巨大的误解。在Agent架构中,Prompt层的本质是一套高度结构化的元指令集。

它决定了Agent以什么身份、什么规矩、什么格式去思考。

这一层核心做三件事:

1. 钉死角色与边界

这是防止模型“胡说八道”的第一道防线。

例如: “你是资深数据分析师,仅依据提供的SQL结果回答,严禁外推。”

2. 强制格式化输出

如果想让Agent接入自动化流程,模型的回答不能是散文,必须是代码能解析的JSON。

例如: 输出必须遵循:{ “thought”: “…”, “action”: “tool_name”, “input”: “…” }

这一步做不好,Harness层根本无法识别指令。

3. 植入思考模板(CoT)

引导模型不要直接蹦答案,而是像人类一样展示 “思考-行动” 轨迹(如ReAct范式)。这既提升了复杂推理的准确度,也为后续的上下文留下了宝贵的审计线索。

💡思考笔记:

Prompt Engineering已死?恰恰相反,它进化成了系统工程。考验的不再是“话术”,而是对模型注意力机制的精确调控。

第二层:Context —— 记忆的水库与过滤网

定位:状态记忆与动态认知环境

大模型本质是无状态的,它处理完一句话就会“失忆”。Context层的作用,就是给Agent造一个短期工作记忆区和外部知识U盘。

如果Prompt定义了“做什么”,Context就记录了 “现在做到哪了” 和 “周围发生了什么”。

这一层管理着三种信息流:

1. 会话滑动窗口

记录最近的对话。这里有一个残酷的物理定律:Context越长,模型越“糊涂”(注意力稀释),且费用越贵。

2. 工具回执单

Agent刚才查了数据库吗?报错了吗?返回的空值是业务正常还是代码Bug?

例如: 代码Agent看到Context里的报错堆栈,才会主动修正代码。若无此记忆,它会反复提交同样的错误代码。

3. 外挂知识库(RAG)

把企业私有文档切成碎片存入向量库,用时检索召回。这是Agent懂行话、不瞎编的唯一路径。

💡 思考笔记:

Context管理的核心矛盾是 “既要马儿跑,又要马儿不吃草” 。高明的架构师必须引入主动压缩与过滤机制——利用小模型做摘要,只喂给大模型最关键的那几KB信息。

第三层:Harness —— 执剑人与缰绳

定位:执行控制与安全沙箱

这是三层架构中最硬核的一层,也是决定Agent是帮手还是杀手的关键分水岭。

“Harness”一词原意是马具/线束,精准描绘了这一层的双重职能:既要像线束一样连通外部世界(工具/API),又要像缰绳一样勒住疯马(防止越权操作)。

Harness的三大权力模块:

1. 工具调用网关

模型输出的是一段自然语言:“查一下明天的天气”。

Harness负责把这句话翻译成函数签名 get_weather(location=‘北京’, date=‘明天’),处理超时重试,再把JSON结果翻译回自然语言还给模型。

2. 流程状态机(防跑偏)

真正的企业流程不是让AI自由发挥的。

例如: 报销流程必须是:提交单据 → 主管审批 → 财务打款。

Harness层通过有向无环图强行锁定路径。如果模型在主管审批环节想去查天气预报?Harness直接拦截:“没这个权限,请回到主任务。”

3. 终极安全护栏

这是Harness的灵魂。

· 代码沙箱: 模型生成的代码在运行前必须扫描,发现 sudo 或 rm -rf,直接熔断。

· 成本熔断: 防止Agent陷入死循环,无限消耗Token烧钱。

💡 思考笔记:

很多人用LangChain感觉Agent不可控,是因为只用了它的Prompt和Context拼接能力,忽视了Harness层的硬编码约束。真正落地的Agent,关键环节必须是确定性代码,模型只负责非关键的语义理解。

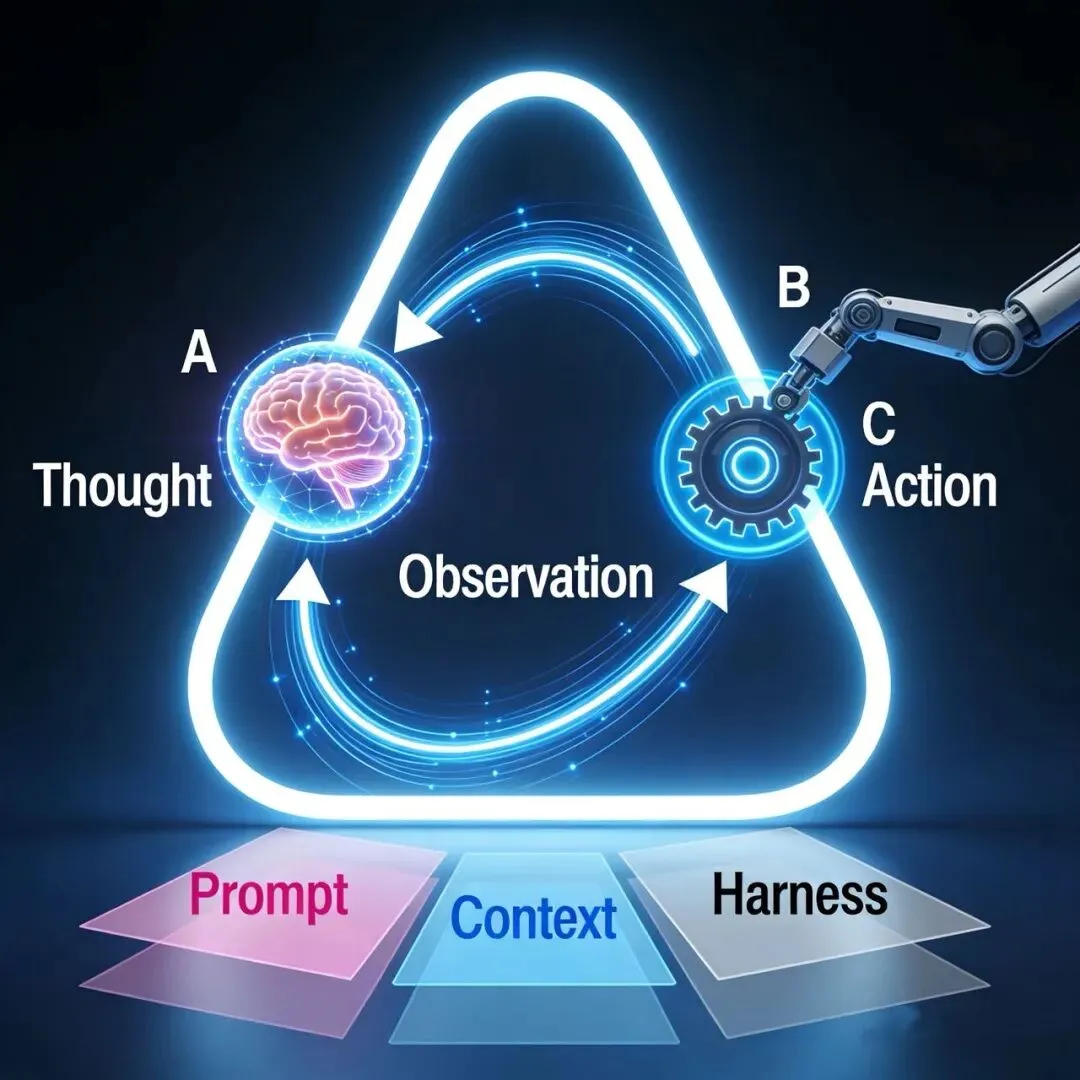

四、三层协同:一部精密咬合的发动机

这三层不是叠罗汉,而是构成了一个不断旋转的反馈飞轮:

1. Prompt + Context 注入:系统Prompt填上Context捞出的记忆数据 → 喂给模型。

2. 推理与触发:模型读到Context末尾,吐出 <调用工具> 指令。

3. Harness接管:解析指令 → 执行工具 → 获得结果。

4. 回流闭环:执行结果作为新的Context节点追加回去 → 回到第1步。

这就是著名的 ReAct(Reasoning + Acting)循环。

结语:从玄学到工程的必经之路

当我们谈论AI Agent时,我们谈论的不再是单点的模型算法,而是分布式系统工程。

· Prompt层 管住了 意图。

· Context层 管住了 记忆。

· Harness层 管住了 手脚与安全。

如果你想做一个“玩具Demo”,或许只需Prompt和Context足矣;但如果你想构建一个能放心托付业务的数字劳动力,请务必在Harness层投入最多的研发精力——那里是Agent的脊梁,也是最后的底线。

关注我,看懂AI落地的底层逻辑。

夜雨聆风

夜雨聆风