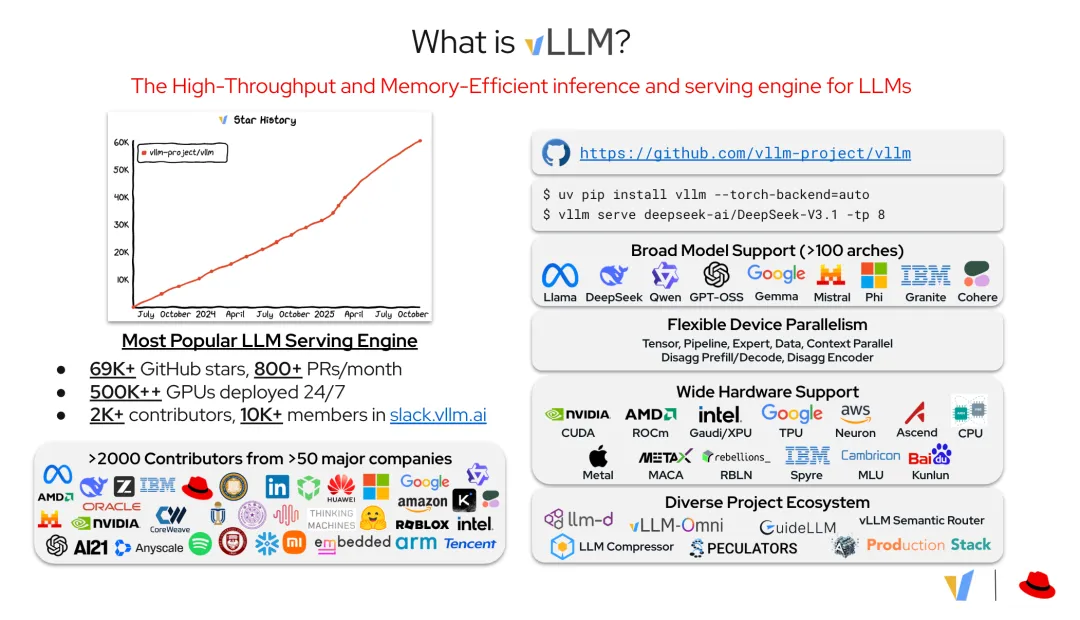

回顾 vLLM Office Hours #42(2026-01-29)

注意这个不是最新一期

2026 年 1 月 29 日,vLLM Office Hours #42 邀请了 Red Hat 与 IBM Research 团队,做了一场很“工程化”的专题:Deep Dive Into the vLLM CPU Offloading Connector。 这期把 CPU Offloading 的使用场景、性能代价、可观测性和后续路线图讲得很清楚,适合正在评估生产落地的团队。

这期最值得关注的 4 个点

CPU Offloading Connector 已经是可实战能力slides 中给出信息:该能力在 vLLM 0.11.0 引入,建议使用 0.14.0+ 版本进行实践验证。 启动方式也很直接:--kv_offloading_size <size_in_GB>。

它解决的是“HBM 不够用,但又不想粗暴扩 GPU”的问题核心思路是把 KV Cache 从 GPU(HBM)扩展到 CPU(DRAM)等更大层级,兼顾容量与成本。

官方给了关键观测指标,不再是“黑盒优化”本期重点提到了监控指标: vllm:external_prefix_cache_hits、vllm:external_prefix_cache_queries、vllm:kv_offload_total_bytes、vllm:kv_offload_total_time。 这意味着你可以量化“命中率、搬运量、搬运时延”,而不是只看吞吐结论。

性能优化不只在算法,也在内存布局分享中提到:vLLM 在 0.12.0 对 KV block 内存布局做了调整,显著提升了 IO 粒度(如多个模型从 KB 级提升到 MB 级),这对 offloading 的实际效率影响很大。

这期议程回顾:先项目更新,再专项深潜。根据视频时间轴,这期结构很清晰:

00:00 开场与议程

03:01 vLLM 是什么

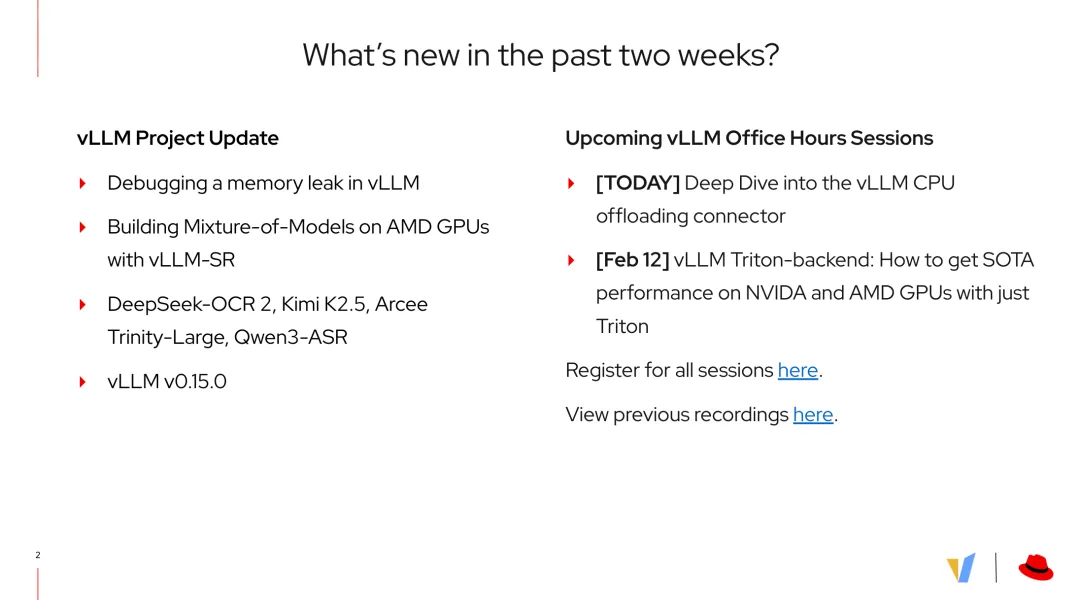

05:56 vLLM 项目两周更新

22:01 CPU Offloading Connector 深入讲解

55:06 Q&A

两周项目更新里,有哪些值得跟进?

本期项目更新里,几个信号很关键:

社区在持续处理核心稳定性问题(如 memory leak 调试)。

新模型和多架构支持继续扩展(含 Kimi、Molmo、Qwen 等相关支持)。

v0.15.0 更新体量很大:slides 给出的数字是 335 commits / 158 contributors / 39 new contributors。

硬件侧继续“全栈推进”:NVIDIA、ROCm、TPU、XPU、CPU 等路径都有实质改进。

如果你是做平台工程,这部分的意义在于: vLLM 的演进已经不是单一硬件优化,而是模型兼容 + 并行策略 + API 能力 + 平台适配同步推进。

Deep Dive 核心:CPU Offloading Connector 到底讲了什么?

1) 为什么是 KV Cache Offloading?

因为 LLM 推理里,KV Cache 决定了多轮对话、长上下文、RAG 场景下的成本与时延上限。

GPU HBM 贵且稀缺,把一部分缓存层级下沉到 CPU DRAM,是更现实的容量扩展方案。

2) 这个连接器的工程定位

slides 给到的关键词是:

默认 offload 到 CPU

支持可插拔后端(pluggable backend)

适合做“更大缓存层级”的过渡与扩展

可用于多实例共享缓存等场景演进

3) 性能代价有多大?

分享里给了一个具体样例:

在某些模型配置下,offloading 额外开销可以做到非常低(示例提到约 0.16%,模型为 Llama-3.1-8B-Instruct 场景)。

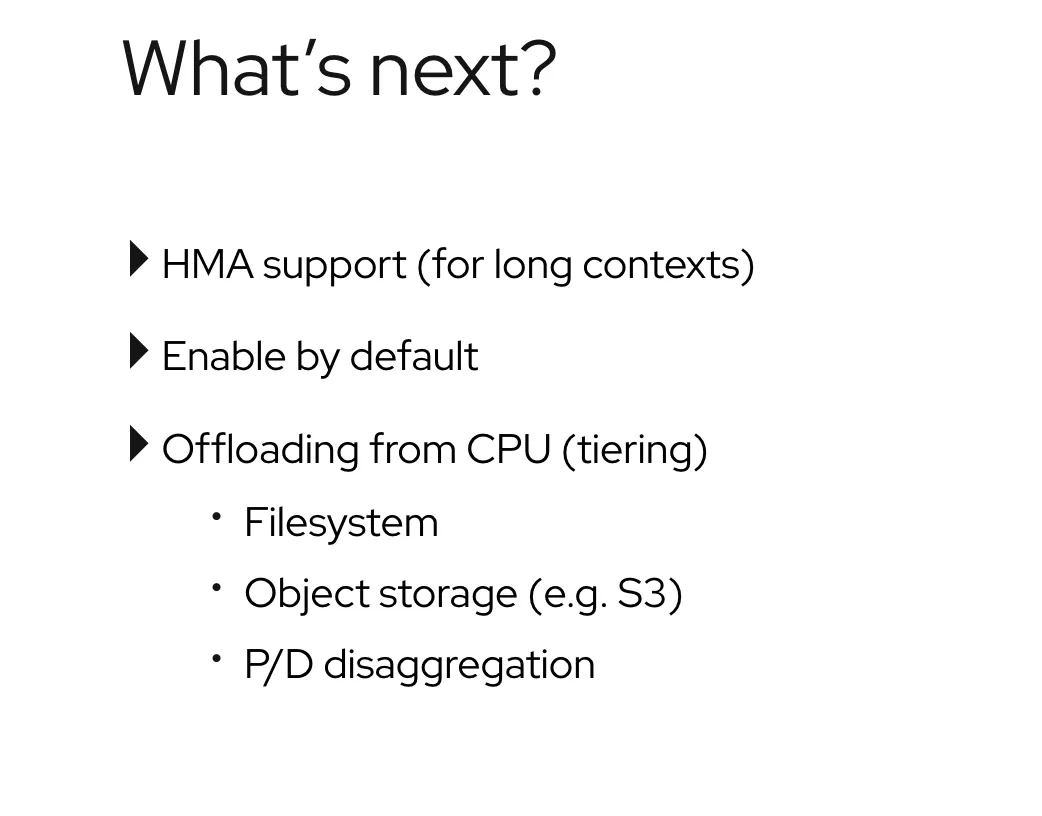

4) 他们还讨论了哪些“下一步”?

slides 的路线图包括:

HMA(更长上下文相关)

默认启用策略探索

从 CPU 再向下扩展分层(如文件系统、对象存储)

与 P/D disaggregation 方向结合

对业务团队的实际启发

如果你在做企业级推理平台,这期可直接转化成 3 条行动建议:

先把可观测性补齐,再谈 offloading 收益先接 Prometheus 指标,确认命中率和搬运开销,再做容量/时延平衡。

从“高价值场景”试点,不要全量一键开启优先在多轮对话、RAG、长上下文这类 KV 压力大的业务试点。

把版本策略和模型策略绑定管理这期材料里多个结论都和 vLLM 版本、模型架构、并行配置强相关;上线时要把版本矩阵列清楚。

结语

这期 Office Hours #42 介绍了26年1月当时的一些社区更新,后半部分是介绍 CPU Offloading, 从概念推进到了可评估、可监控、可落地的工程实践。 如果你在做降本增效、GPU 资源池优化,或者在规划更长上下文支持,这期值得完整看一遍。

参考链接

视频回放:https://www.youtube.com/watch?v=LFnvDv1Drrw&list=PLbMP1JcGBmSHxp4-lubU5WYmJ9YgAQcf3&index=5

本期 Slides(Google Slides):https://docs.google.com/presentation/d/15IPOszlbDDQIHPTivY9LSJFfAv-gFYccA5BqKvUoyJg/

vLLM Office Hours / 活动页:https://www.redhat.com/en/events/ai

夜雨聆风

夜雨聆风