最近一条消息,在AI圈悄悄炸开了锅。

日均调用量已经达到140万亿token。

这不是一个“增长很快”的信号,而是一个更现实的问题:

谁来为这些token买单?

于是你会看到一连串动作几乎同时发生:

DeepSeek连夜上线“分级模式”,把简单任务和复杂推理拆开处理

Anthropic年化收入突破300亿美元,却仍在严格控制算力成本

多家AI平台开始调整免费额度、限制高频调用、甚至隐藏“高成本能力”

一个趋势正在变得清晰:

AI行业,正在从“拼用户规模”,转向“拼算力效率”。

免费,不是消失,而是被"精细化管理"

过去两年,AI产品的逻辑很简单:

尽可能多地吸引用户 → 提供尽可能多的免费能力 → 快速建立使用习惯

但现在,这套逻辑开始出现拐点。

因为AI不是内容平台,它的每一次回答,背后都是真金白银的算力消耗。

特别是复杂推理、多轮对话、长上下文记忆这些能力,它们不是“贵一点”,而是指数级更贵。

这也是为什么DeepSeek要做分级:

简单问答 → 快速模型,低成本处理

复杂推理 → 深度模型,单独计费或限额

说白了就是一句话:

不是所有问题,都值得用“最贵的大脑”。

而用户也会慢慢发现:

以前随便用的能力,现在开始“要额度了”。

真正稀缺的,不是AI,而是"可持续的AI使用权"

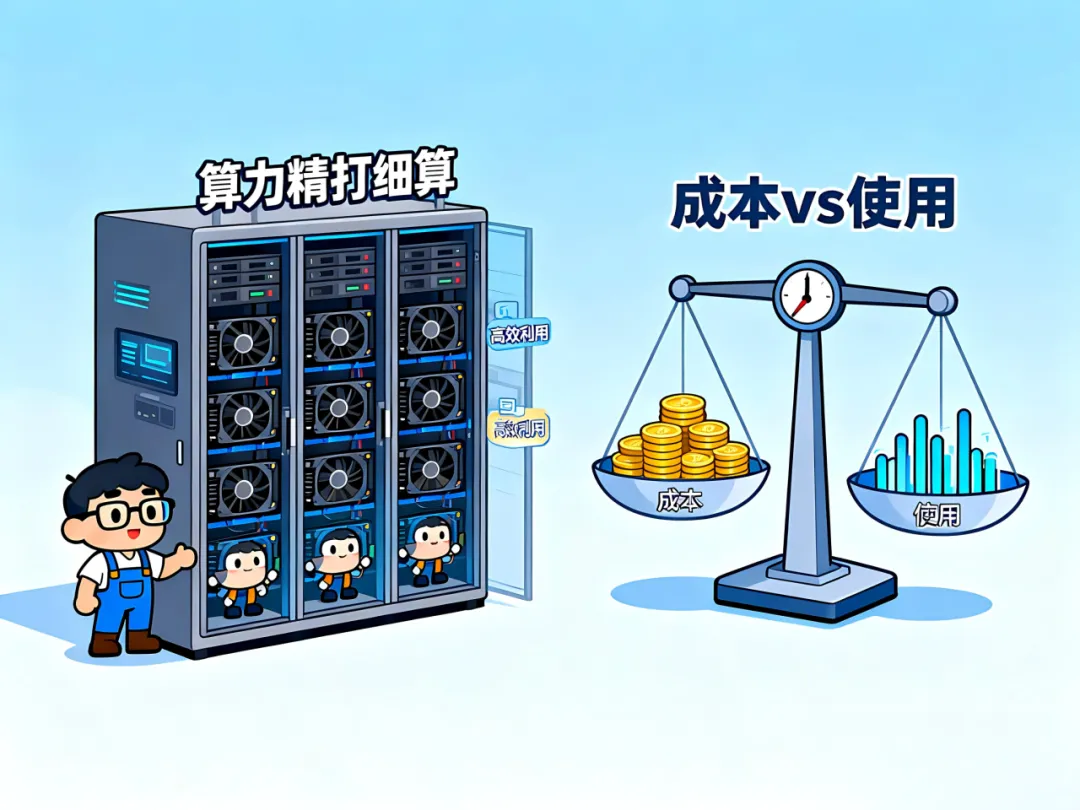

当token开始被精打细算,一个更关键的问题出现了:

未来,我们还能自由地用AI吗?

答案是:可以,但方式会变。

云端AI的本质是“共享资源”;你用的越多,平台成本越高,限制也就越多。

这意味着:

高频用户,会被限流

深度用户,会被收费

长期依赖用户,会越来越受制于平台策略

于是,另一条路径开始变得清晰:

👉 把一部分AI能力,变成自己“本地拥有”

夸连私助 成为新的选择

当行业还在讨论token成本的时候,夸连让用户即开即用、培养自己的端侧专属AI助理:

这件事的意义,不只是“省钱”,而是彻底改变使用逻辑:

不再按token计费

不再依赖网络稳定

不再被平台策略随时调整限制

更重要的是:

你开始拥有“自己的专属AI”。

不是所有AI,都必须"又快又深"

DeepSeek的分级,其实揭示了一个本质问题:

AI不应该只有一种模式。

有些时候,你只需要:

快速提醒

简单整理

即时回应

而有些时候,你真正需要的是:

深度分析

多维推理

长期记忆与持续理解

过去,这两种需求被混在一起,统一按高成本处理。

但未来,更合理的方式是:

👉 用户自己决定:什么时候要“快”,什么时候要“深”。

当行业开始计算每一份token的成本,AI的使用方式,其实也在发生变化。

真正拉开差距的,可能不再是谁“用过AI”,变成了谁拥有一套可以长期使用、不被轻易打断的AI能力。

免费不会消失,但一定会越来越有限。

而“把一部分能力握在自己手里”,正在成为一种更稳的选择。

微信号|浪浪山-卷轴小妖

夜雨聆风

夜雨聆风