梁湘/文

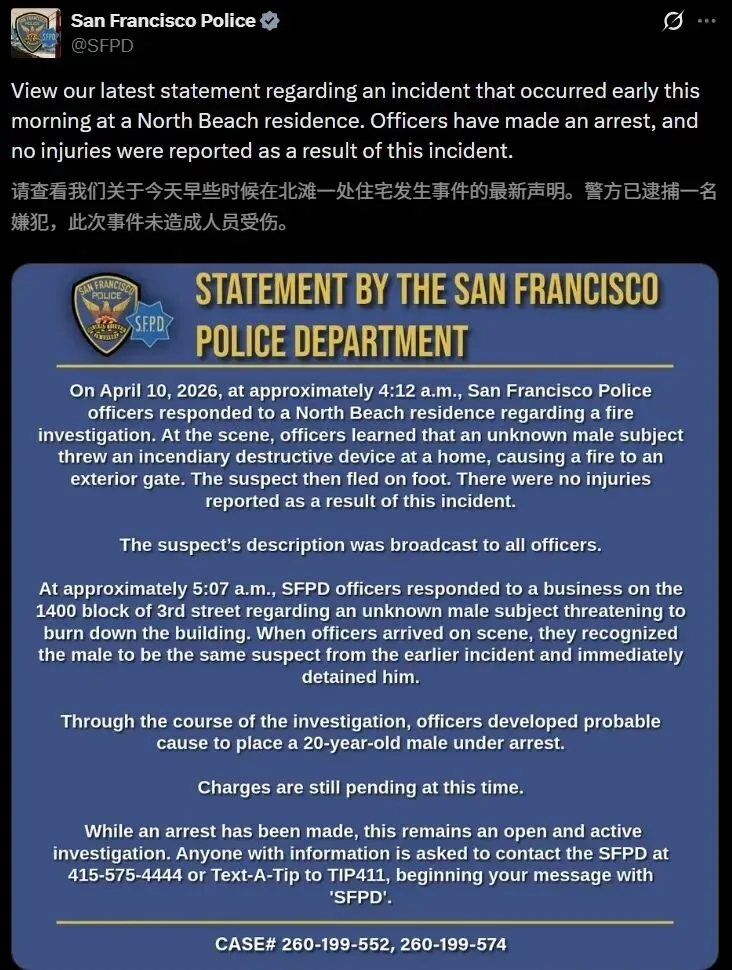

2026年4月10日凌晨,美国旧金山发生了一起针对OpenAI首席执行官山姆·奥特曼(Sam Altman)的连续安全事件。一名20岁男子向Altman的住所投掷燃烧弹后,又前往OpenAI总部大楼外扬言纵火,最终被警方当场逮捕。这起事件因其暴力性质及背后所折射的社会情绪而迅速引发全球关注。

一、事件时间线:连续袭击与快速响应

根据旧金山警方调度记录及OpenAI发布的内部备忘录,整个事件的经过可精确到分钟:

凌晨3:45:一名身份不明的男子接近Altman位于旧金山北海滩(North Beach)附近的住宅,向住宅大门投掷了一枚自制燃烧弹(Molotov cocktail)。根据Altman本人的博客描述,燃烧弹撞击住宅外壁后弹开,并未造成任何人员伤亡,仅导致大门处轻微起火。OpenAI的内部备忘录也证实,燃烧装置落在住宅附近并自行熄灭,仅造成了轻微损坏。

凌晨4:12:旧金山警方接到火情报警后迅速出警。警员抵达现场时,嫌疑人已徒步逃离,火情已被控制,现场无人员受伤。

凌晨5:07:事发约55分钟后,旧金山警方再次接到报警,称一名男子在OpenAI位于第三街(3rd Street)1400号街区的总部大楼外公开叫嚣,扬言要烧毁整栋建筑。警方迅速赶赴现场,确认该男子与早前投掷燃烧弹的嫌疑人为同一人后,当场将其逮捕。嫌疑人年龄约20岁,目前旧金山警方尚未公布其具体身份,案件仍在调查中。

二、嫌疑人信息与动机分析

旧金山警方尚未正式公布嫌疑人的具体身份,仅确认其为一名20岁男性。案件已交由旧金山警局特别调查组(Special Investigations Unit)和纵火调查组(Arson Unit)联合侦办。

关于犯罪动机,警方目前尚未作出官方定论。然而,多家媒体在报道中指出,这起袭击极有可能与公众对OpenAI近期与五角大楼(Department of Defense)合作的高度不满有关。媒体分析指出,Altman和OpenAI已成为那些抗议人工智能对社会构成威胁的人们的攻击目标,而OpenAI向美国国防部提供技术的决定尤其令批评者感到不安,并遭到强烈反对。

三、背景铺垫:OpenAI的“军事化”争议

自2024年起,OpenAI逐步放宽了禁止将AI技术用于军事领域的限制。2026年2月28日,OpenAI宣布与美国国防部达成协议,将其AI模型部署于五角大楼的机密网络中。这一决定在业界引发了广泛争议:

· 内部反弹:协议公布后,OpenAI内部员工和硅谷AI研究者表达了广泛的批评,认为公司接受了允许AI用于“所有合法用途”的条款,等同于向五角大楼让步。

· 外部批评:民间团体对AI军事化应用的担忧持续升温。与此同时,NBC新闻最近的一项民意调查发现,人工智能的受欢迎程度甚至不如美国移民和海关执法局。

· 后续修正:面对反弹,Altman承认协议的公布过程“过于仓促”,并推动修订协议,明确写入禁止AI用于“国内大规模监控”,以及要求武器的使用必须由人类承担责任的条款。

正是这一系列争议,为此次袭击事件提供了最为广泛讨论的背景动因。

四、各方反应

1. OpenAI官方声明

袭击发生后,OpenAI第一时间发表声明,对旧金山警方的快速处置表示感谢。“我们非常感谢旧金山警方的迅速响应以及市政府为保障我们员工安全所提供的支持。”一名发言人在声明中表示,该嫌疑人已被拘捕,公司正在全力协助执法部门进行调查。OpenAI同时向员工确认,所有旧金山办公室在当日正常开放,并已增加大楼周边的警力和安保力量。

2. Sam Altman的回应:个人博客全文

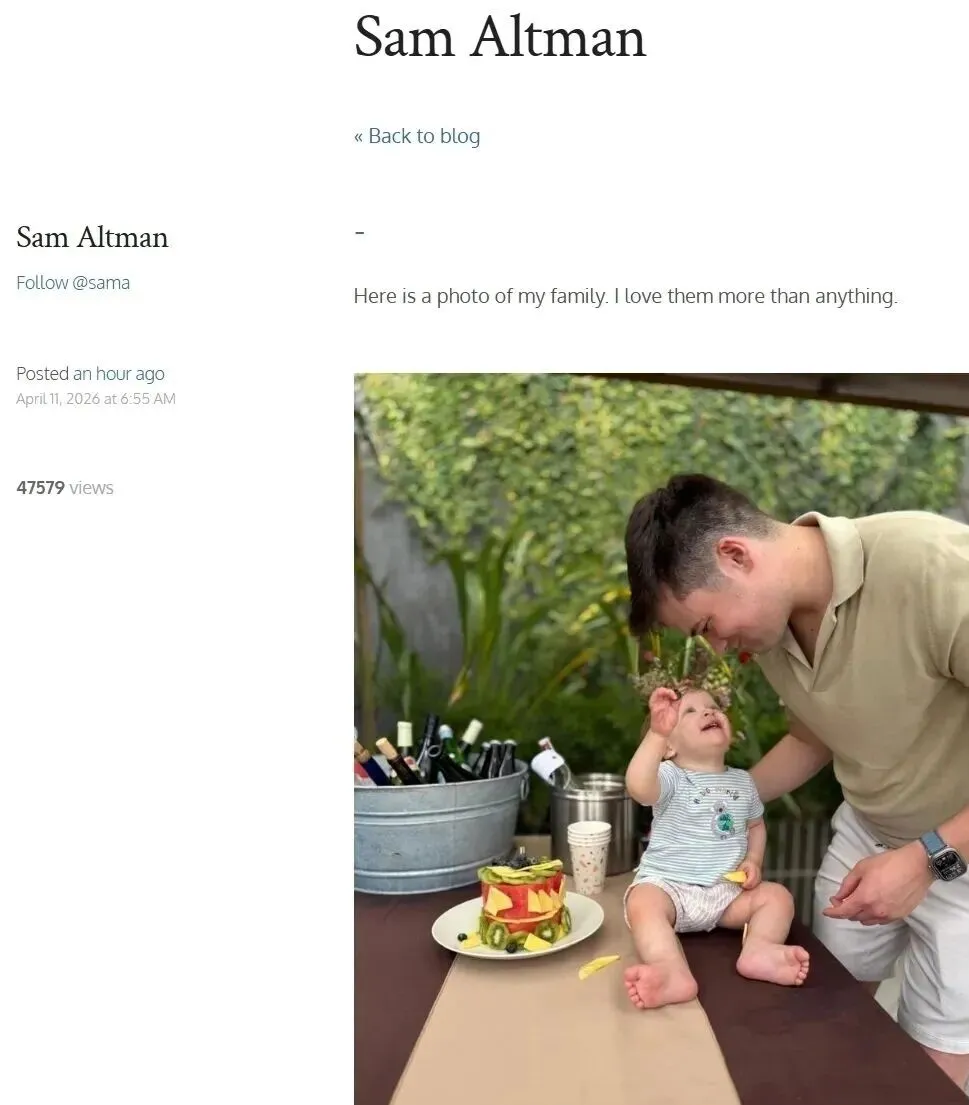

事发后数小时,Altman于4月10日下午在其个人博客上发布了一篇题为《Here is a photo of my family》的长文,以罕见的个人化方式回应了此次事件。

开篇:公开全家福

Altman以一张家庭照片作为开篇。“这是我全家福的照片,我对他们的爱胜过一切。我希望图像拥有力量。平时我们尽量保持私密,但这次我分享一张照片,希望能阻止下一个人向我们家投掷燃烧瓶,无论他们对我有什么看法。第一个人昨晚凌晨3点45分这么做了。值得庆幸的是,它从房子上弹开了,没有人受伤。”

反思文字的力量

“文字也有力量。几天前有一篇关于我的‘煽动性文章’。昨天有人对我说,那篇文章恰逢公众对AI极度焦虑的节点,可能会让我陷入更危险的境地。我当时没当回事。现在我在深夜辗转难眠,怒火中烧,开始意识到自己低估了文字和叙事的力量。”——需要补充的是,Altman随后在社交媒体上承认“incendiary”一词用词不当,“今天是很艰难的一天,我的思路并不清晰”。

核心信念

Altman在博客中系统阐述了他对AI的立场:

· “AI将是有史以来最强大的扩展人类能力和潜能的工具。对这一工具的需求几乎没有上限,人们将用它创造出令人惊叹的成就。世界需要大量的AI,我们必须想办法实现这一目标。”

· “这不会一帆风顺。人们对AI的恐惧和焦虑是有根据的——我们正在见证人类社会很长时间以来、乃至有史以来最大的变革。我们必须做好安全工作,这不仅仅是模型对齐的问题——我们迫切需要一个全社会层面的响应机制来抵御新型威胁,包括出台新政策,帮助我们渡过艰难的经济转型期,走向更美好的未来。”

· “AI必须民主化;权力不能过度集中。未来的控制权属于所有人及其制度。AI需要赋能每个人个体,我们需要集体共同决定未来的方向和新规则。我认为不应该由少数几个AI实验室来决定我们未来的形态。”

个人反思

Altman还回顾了过往的争议事件:“在反思自己在OpenAI第一个十年的工作时,我可以指出很多引以为豪的事情,也有很多错误。我想起了即将与埃隆(Elon Musk)展开的诉讼,想起了当时我在拒绝他想要对OpenAI的单方面控制权时有多么坚持。我为此感到自豪,也为我们当时艰难地走出了一条让OpenAI得以存续的道路、以及后来所取得的一切成就感到自豪。”

“我不为自己回避冲突而感到自豪——这给我和OpenAI带来了巨大的痛苦。我也不为自己在之前与董事会冲突中的处理方式感到自豪——那给公司带来了巨大的麻烦。在OpenAI这疯狂的轨迹中,我犯过很多其他错误;我是一个身处异常复杂情境中的有缺陷的人,每年都在努力变得更好一点,始终为使命而工作。”

呼吁降级对抗

Altman最后呼吁各方降低对抗性。“在我们辩论的同时,应该缓和言辞和策略,尽量减少在更少的家庭中发生爆炸——无论是在比喻层面还是在字面层面。”“我理解反科技情绪,而且很明显,科技并不总是对每个人都有好处。但总的来说,我相信科技进步能够让未来变得无比美好,无论对你我的家庭都是如此。”

五、深度分析:从思想辩论到物理攻击

这起事件之所以震动全球科技界,不仅因为其暴力性质,更因为它可能标志着围绕人工智能的对抗已经从思想和政策的辩论层面,升级为针对个人的物理攻击。

近年来,随着AI技术的飞速发展及其在军事领域的逐步渗透,公众对这一技术的“恐惧与焦虑”情绪持续积累。OpenAI作为全球最具代表性的人工智能企业,其与五角大楼的合作决定,使其成为了这股社会怒火的现实出口。多家媒体将此次袭击视为AI技术引发的社会情绪“溢出”为现实冲突的一个标志性案例。

然而,暴力并非解决问题的方式。正如Altman在博文中所述,公众的恐惧虽有其合理之处,但对技术的讨论应建立在理性和非暴力的基础之上。这起事件为全社会敲响了一记警钟:在加速技术变革的同时,如何建立更为健全的社会对话机制、如何缓解公众对技术发展的焦虑,已成为摆在所有利益相关者面前的紧迫课题。(完)

夜雨聆风

夜雨聆风