当科技大佬们高喊AGI 将拯救世界,谁在替那些被遗忘的人发声?

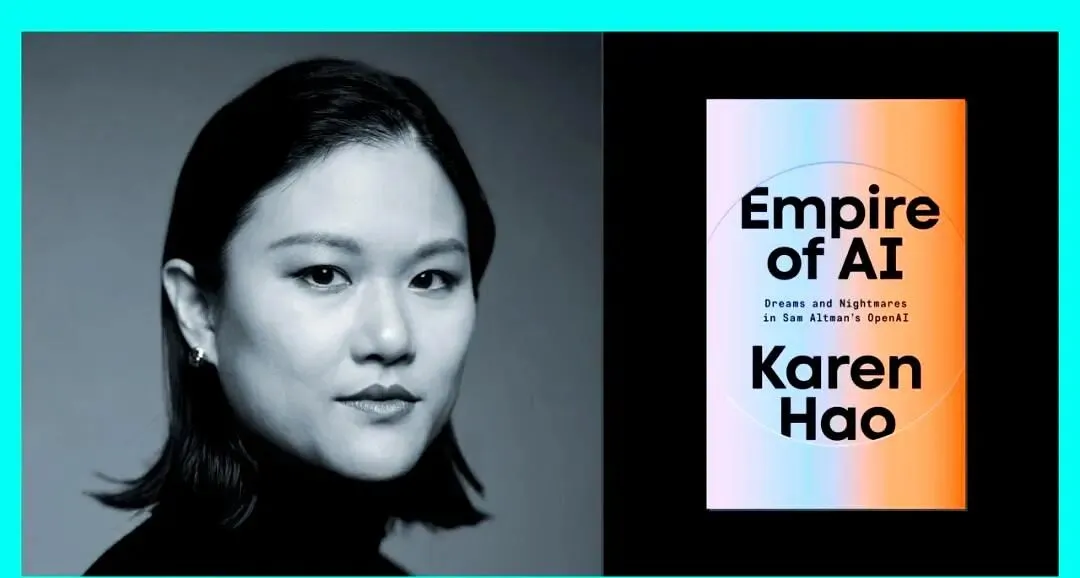

Karen Hao花了两年时间,访谈了300多位AI圈核心人物的闭门访谈,90多位 OpenAI在职与离职员工的深度对话,最终凝结成一部名叫《Empire of AI》的巨著。

作者Karen Hao,《MIT 科技评论》前主笔,华裔。从OpenAI内部一路挖到美国最底层的黑人社区,她把资本最不想让人看到的真相,一个接一个地摆在了台面上。

在她的访谈记录里,你会发现这五个扎心的真相。

▌真相一 AI 最先"替代"的,不是最苦最累的岗位

你有没有注意到一个现象:那些喊着要被 AI 取代的,往往不是工厂流水线上的工人,而是律师、金融分析师、医生、程序员——这些外界眼中"最值钱"的职业。

Karen Hao 在调查中发现,这背后根本不是什么技术奇点来临的自然演化,而是一个再简单不过的商业逻辑:谁付费能力强,谁就先被盯上。

换句话说,大多数人的职场危机,本质上不是因为你的工作太容易被机器取代,而是因为你的岗位太值钱,被资本提前锁定了。

你的岗位值钱,不是因为你不可替代,而是因为替代你的收益最大。

更值得玩味的是,OpenAI 向国会讲述 AGI 时,用的是"治愈癌症、解决气候变化";向消费者讲故事时,说的是"最强 AI 助理";向微软谈判时,又变成了"能创造数千亿美元的收入系统"。

三个版本,三套话术,同一个技术。AGI 从来都不只是一个技术目标,它更像一面镜子:谁需要被说服,它就被定义成什么形状。

▌真相二 被AI替代的人,正在用最后一口气喂养那个替代自己的 AI

这大概是五个真相里最让人窒息的一个。

Karen Hao 在访谈中记录了一个真实案例:一位美国女性,原本有一份体面的白领工作,被公司裁员之后,失去收入来源,只能靠做数据标注来维持生计。

数据标注,你可以理解为坐在电脑前,一句一句教 AI 认识什么叫"愤怒"、什么叫"悲伤"、什么叫一句话里暗含的反讽。这个工作听起来像是在训练 AI,实际上是在用她刚丢掉的那份技能,反过来去训练 AI,让它变得更强,然后去替换掉下一批人。

她最怕的是什么?不是活太多,而是在工作软件里看不到消息。因为没有消息就等于今天没有收入。

有一次项目终于来了,偏偏赶上了孩子放学回家想跟妈妈说话。她一边赶标注进度,一边冲着孩子大吼。等项目交付完,她坐在电脑前彻底崩溃了。

她说了一句话,我想了很久:

“我感觉自己就像一个怪物,连上厕所的时间都没有。”

讽刺的是,数据标注已经是全美增长最快的职业之一。无数被 AI 淘汰的白领,正在涌向这条他们亲手被推下去的传送带。这不是新的机会,这是一个深不见底的死循环。

▌真相三 AI不只在抢屏幕里的工作,它在现实世界跟你抢空气

这一条,真相的重量已经超出了职场和收入的范畴。

Karen Hao 把镜头对准了美国孟菲斯的一个底层黑人社区。那里的居民有一天突然在家里闻到了煤气泄漏的味道。调查之后才发现,原因竟然是马斯克的 AI 团队为了训练大模型,在附近秘密建造了超级计算机集群,直接部署了 35 台甲烷燃气轮机。

事前,没有提前告知社区。没有环境影响评估。没有社区听证。

这个社区本来就因为工业污染,肺癌发病率远高于全国平均水平。而现在这台钢铁巨兽,日夜不停地往空气中排放有毒物质,孩子们的哮喘问题持续加剧。

富人因为有了AI,有了更多的时间,活得更像人。而普通人却失去了控制,失去了尊严,甚至连呼吸一口干净空气的权利都在被剥夺。

这不是科幻电影里的末世图景。这是 2026 年的美国。AI 竞赛的代价,正在由那些最没有话语权的人来承担。

▌真相四 科技大佬高喊AI末日,他们真的在担心人类毁灭?

Sam Altman、Elon Musk、Demis Hassabis……这几年,顶级科技领袖们没少在公开场合表达对 AI 失控的担忧。"AI 可能在十年内超越人类智慧","存在性风险"这样的词频频出现在他们的演讲和博客里。

Karen Hao 在调查中挖出了更有意思的内幕。

她发现,早期 OpenAI 为了拉拢马斯克的投资,在官方博客里几乎逐字照搬了马斯克本人偏好的 AI 毁灭论叙事。而在投资落袋、资源到手之后,OpenAI 迅速转身,把马斯克踢出了核心圈。

这说明什么?

Karen Hao 在访谈中说了一句很犀利的话:你会发现,他们总是喜欢把 AI 包装成两种极端:要么拯救世界,要么毁灭世界。而目的只有一个:制造恐慌,顺势告诉你,这么危险的技术,不能开源、不能分散,必须把算力、资源、权力集中在少数人手里。

所谓AGI威胁论,在很多时刻更像是科技寡头们封锁竞争对手、建立技术霸权的借口,而非真正的技术警报。

换句话说:当你听到某个科技大佬严肃地谈论 AI 末日,不妨先问一句:他现在是在保护人类,还是在保护自己的商业版图?

▌真相五 当AI的问题无法被解决,他们选择解决提出问题的人

这是五个真相里最让人感到无力的一条,也是被公开报道最少的一条。

Karen Hao 在调查过程中发现,OpenAI 内部有一套严格的非贬低协议。离职员工被要求签署,承诺不在公开场合说公司的坏话,违者将面临法律后果。有多位内部人士向她证实:因为这道协议,很多人即使知道公司存在问题,也不敢在公开场合发声。

不只是 OpenAI。Karen Hao 记录了另一个案例:谷歌内部曾有一位顶级 AI 伦理专家,她在内部报告中明确指出了大模型存在的缺陷和潜在危害。报告提交后不到 24 小时,她被公司扫地出门。

第二天,她的工位已经被清空,就像这个人从来没有存在过一样。

他们不是在讨论问题,他们是在管理问题的声音。

Karen Hao 把这种现象总结为一句话:当你无法用逻辑反驳一个批评,你就用权力让它消失。在 AI 这个赛道上,这句话正在以超出公众认知的速度发生着。

深度思考:我们该如何看待这场 AI 浪潮?

写到这里,有几个问题值得认真停下来想一想。

AGI 的定义权在谁手里?

谁定义 AGI,谁就掌握了它的发展方向。当定义权集中在少数几家公司手里,AGI 最终服务的是技术本身,还是掌握技术的人?

AI 的代价由谁承担?

算力中心建在谁的社区?数据标注工人的权益谁来保障?AI 的光环背后,有多少人在承担那些不可见的成本?

谁有资格决定 AI 的边界?

当提出问题的人被迫沉默,当质疑的声音被法律协议封堵,AI 行业的纠错机制正在失灵,而我们每一个普通人都是这个系统的参与者。

━━━━━━━━━━━━━━━━━━━━

Karen Hao 在书的结尾写道:

在这场AI 的狂热里,最该警惕的不是 AI 会不会越来越强,而是——谁在决定它往哪个方向强。它到底替谁服务,就会让谁付出代价。

它影响的不是某个遥远的机器人会不会叛乱。它影响的是你的工作、你的收入、你喝的水,甚至是你呼吸的空气。

━━━━━━━━━━━━━━━━━━━━

写在最后

Karen Hao 用两年时间做了一件很少有人愿意做的事:把镜头对准那些没有聚光灯的人,而不是科技舞台上最耀眼的名字。

如果你看完这篇文章,也想了解更多,推荐去找一下她的原书和长访谈。每一个细节背后,都有比文章能容纳的更沉重的重量。

也欢迎在评论区聊聊你的看法——这五个真相里,哪个最让你意外?

参考资料

·Karen Hao, 《Empire of AI: The Lies, Power, and Greed Behind Artificial Intelligence》

·MIT Technology Review: Karen Hao 前主笔专访

·Karen Hao 个人网站 & Newsletter

·The Atlantic: "The People Who Are Training AI While Being Replaced by It"

夜雨聆风

夜雨聆风