访谈主持人: 纳文・查达

梅菲尔德基金管理合伙人 | 初创与早期投资者 | 连续 3 次创始人

本期内容,是梅菲尔德基金管理合伙人、初创与早期投资者纳文·查达 对 Frore Systems CEO 创始人——Seshu Madhavapeddy博士的专访,核心围绕AI基础设施的核心瓶颈——热量展开,探讨Frore Systems如何通过热栈技术突破热力学限制,CEO Seshu Madhavapeddy、CTO Suryaprakash Ganti带领的Frore团队是AI热栈赛道的定义者,其研发的散热技术正重塑AI基础设施的发展边界。原文链接:https://www.linkedin.com/pulse/why-thermodynamics-new-frontier-ai-infrastructure-navin-chaddha-0icec/

所有人都在竞相打造更快的 AI 芯片,却没有人谈论真正拖慢速度的关键:热量。

AI 基础设施正以惊人速度扩张。预计到 2030 年,数据中心算力需求将增长超过三倍。从大语言模型到图像、视频生成器,现代 AI 无论训练还是运行,都消耗极其庞大的电力。训练一个顶尖模型可能需要数百万千瓦时电力。但更大的转变来自推理(inference):实时处理数十亿次提示、搜索与交互,让 AI 成为 24 小时不间断的能源负载。

性能不再只是算力的函数,而是热力学的函数。

推动 AI 撞上能源墙的五大力量

热量限制并非单独存在,而是五大结构性压力同时汇聚的结果:

模型训练极度耗能顶尖模型需要庞大的 GPU 集群连续运行数周甚至数月,每一代模型只会更大,不会更小。

推理成为真正的耗能黑洞服务数十亿次提示、搜索、图片与视频请求,让 AI 成为持续运转的能源负载。随着 AI 渗透日常软件与设备,能源需求只会越来越稳定且庞大。

数据中心正面临电力与散热极限AI 设施现在需要数十至数百兆瓦电力。电网容量与先进散热系统已成为部署的关键瓶颈。

可持续发展压力持续升高AI 负载 24 小时运行,但可再生能源具有间歇性。AI 扩张与气候承诺之间的矛盾真实存在。

能源成为核心成本驱动力电力不再是可以忽略的小数,它显著影响模型经济性、定价与竞争优势。

随着 AI 规模扩大,性能不再只取决于算力,而是取决于热力学。

转变:AI 已进入物理定律时代

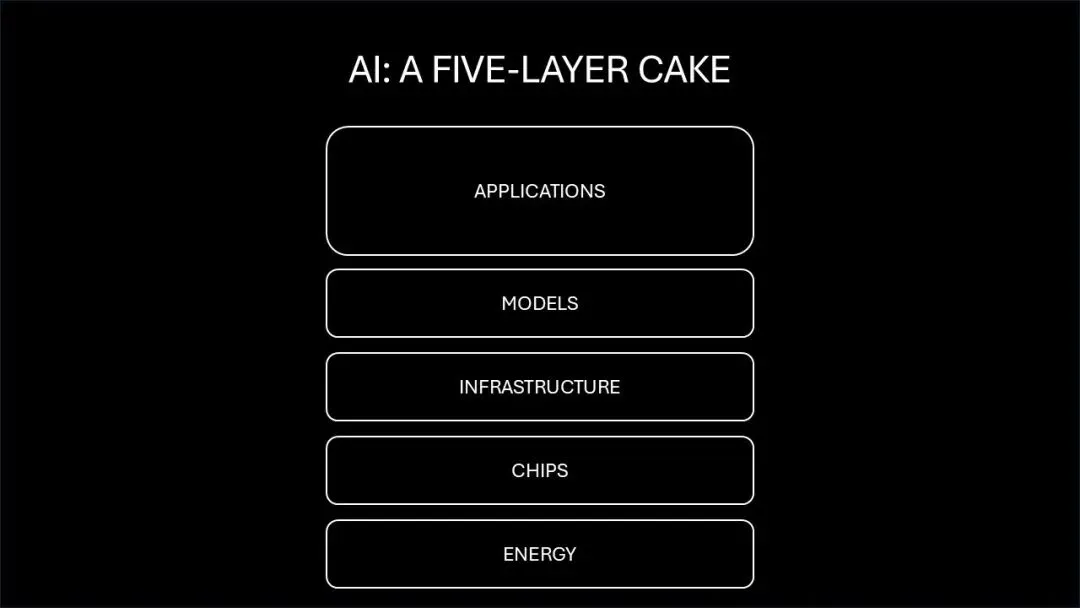

英伟达 CEO 黄仁勋近期将 AI 比喻为五层结构:能源、芯片、基础设施、模型、应用。

这一框架从能源开始,方向完全正确。

黄仁勋的观点非常直接:“AI 的基础是电力。实时产生的智能,需要实时产生的电力。每一个生成的 Token,都是电子流动、热量管理、能量转化为计算的结果。物理定律之下没有任何抽象层。能源是 AI 基础设施的第一性原理,也是系统所能产生智能规模的最终约束条件。”

散热位于基础设施层,紧邻芯片之上。随着功率密度提升,热管理决定了实际可运行的算力、效率与部署密度。

这恰好对应 Frore Systems 正在构建的方向。几十年来,科技行业只谈两大基础层:软件栈与硬件计算栈。现在,第三个同样基础的层级出现:热栈(Thermal Stack)。

如今,Frore 正式提出热栈(Thermal Stack)—— 一套从芯片到环境的完整集成散热架构。它已变得与硅芯片本身一样基础、一样关键。

AI 热栈是大规模解决热量问题必需的集成散热架构,涵盖从计算、网络硬件抽取热量,并将热量排到大气中,横跨数据中心与边缘平台。随着 AI 负载指数级增长,热栈直接决定算力密度、能源效率与性能表现。

Frore Systems 正在三大市场重新定义热栈

- AI 数据中心

:实现更高算力密度、更轻重量、更高电耗与水效 - 工业边缘 AI 网关

:在紧凑、坚固、防尘、防水的外壳中支持高负载 AI 计算 - 消费级 AI 设备

:在超薄、无风扇、静音设备中提供高性能 AI 计算

AI 计算的核心从 CPU 走到 GPU、再到 TPU。下一个关键单元不再是处理速度,而是处理所有计算产生的热量。

在 AI 时代,一类全新的处理单元正在崛起 —— 我称之为散热处理单元(Cooling Processing Units)。随着 AI 扩张,散热将成为性能的最前线战场。

Frore 早期洞察:先从边缘设备突破

2018 年 Frore 成立时,AI 数据中心爆发尚未到来。公司从一个精准问题起步:解决计算的热量问题。

第一个切入点是 边缘设备—— 超薄机身,传统风扇根本无法运行。AirJet,全球首款固态主动风冷芯片,正是为突破这一限制而生。厚度仅 2.65mm,却能提供主动散热,让设备实现静音、防尘、防水,消除热节流(thermal throttling),在极限尺寸中让性能翻倍。

AirJet 已上市八年,目前在工业边缘 AI 网关、超紧凑消费 AI 设备与物联网平台中大规模量产出货。

边缘市场验证了一个关键结论:热力学可以被重新架构。

散热不是只能被动应对的限制,而是一个可以从材料与制造层面彻底解决的设计问题。

这一信念直接转化为 Frore 的数据中心战略。

重新设计 AI 数据中心的热架构

当 AI 进入超大规模数据中心,液冷变得不可或缺。但传统液冷笨重、工艺缓慢、成本高昂,是为更低算力密度时代设计的。

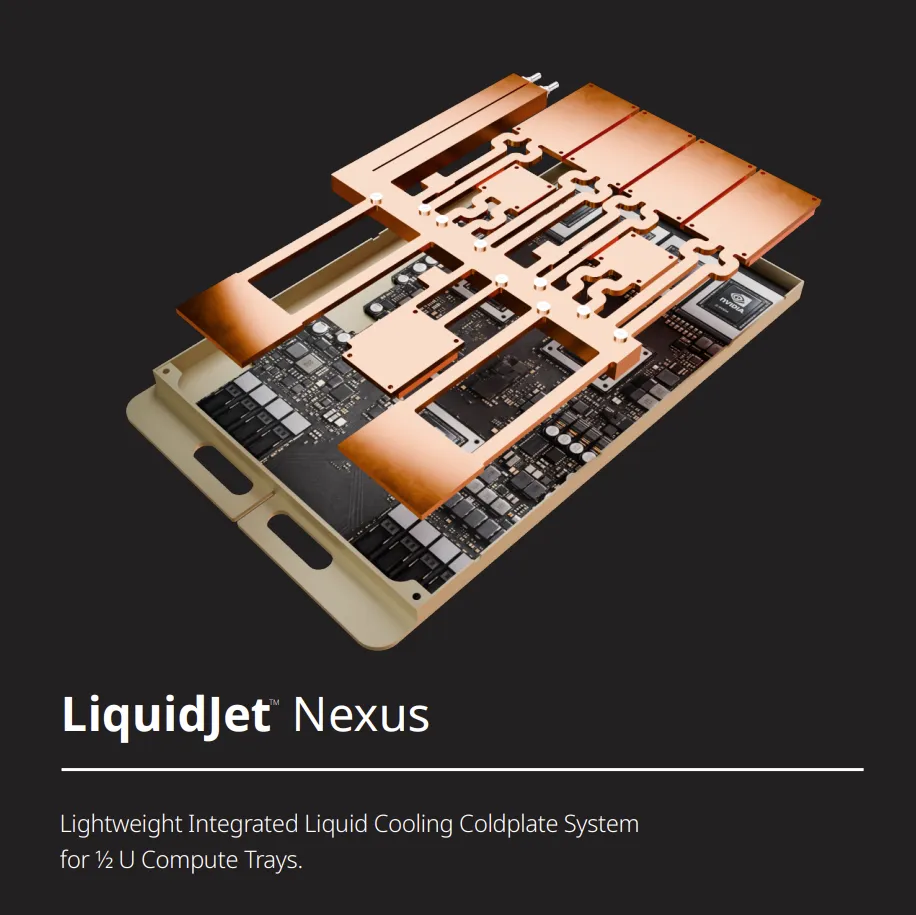

Frore 从底层基材彻底重新构想。LiquidJet是其数据中心方案:一套 3D 直触式液冷冷板,传热效率提升 75%、GPU 温度降低 8°C、冷板重量减少 55%,且可直接替换升级现有基础设施。

LiquidJet Nexus进一步扩展平台:机架算力密度提升 2 倍、热栈重量减少 65%、支持 53°C 进水温度,并取消连接器、软管与分流总成。

这不是散热的小幅优化,而是热架构的重新发明—— 它决定一个设施能运行多少 AI 算力、成本多高、碳排与能耗多大。

Frore 的护城河不只是产品,其结构性优势也不仅在技术,而是建立在三层相互强化的基础之上:

制造架构Frore 将半导体级制造应用于散热,使用可规模化的金属晶圆工艺。这不是可外包给代工厂的设计,而是垂直整合:从材料科学、芯片设计、制造到供应链一体掌控。台湾制造、加州研发的基础架构,难以被快速复制。

精简高效的运营能力满产规模下,Frore 仅需约 300 人(含 100 名工程师),即可达到半导体公司级别的营收体量,而非传统硬件厂商。这是 IP 密集、垂直整合制造带来的效率优势。

组织韧性创始团队八年完整保留,核心人才流失率近乎零。在人才流动极高的行业中,长期沉淀的文化本身就是独特护城河。

热栈成为新一代基础架构

Frore 正在定义 AI 时代的热栈赛道。

今日,Frore Systems 宣布完成1.43 亿美元 D 轮融资,公司估值达16.4 亿美元。资金将用于加速 AirJet、LiquidJet、LiquidJet Nexus 在边缘与数据中心市场的全球扩张。

我们很自豪自 2018 年成立以来,全程支持 Seshu Madhavapeddy、Suryaprakash Ganti 及 Frore 团队,直至 D 轮。

散热不再是后台附属设施。它定义 AI 系统的上限。

欢迎观看我与 Seshu 的完整对话:如何为 AI 时代打造垂直整合硬件公司。

结尾问题

未来十年,哪一项物理约束将最深刻地塑造 AI 基础设施的经济模式?

夜雨聆风

夜雨聆风