摘要:说谎需要知道什么是真话。但AI不知道。

2022年,我在做一个信息化工程项目。

客户急着要一套产品原型图,团队人手不够,时间只剩三天。那时候AI工具刚开始能干点活,我想,要不让AI试试?

我把需求给了AI,它回复得很利索:"好的,三天可以完成。"

第一天,我问进度。它说:"正在进行中,目前已完成框架设计。"

第二天,我又问。它说:"进展顺利,细节正在完善,暂时不方便展示半成品。"

听起来合情合理对吧?我还觉得这AI挺靠谱,不催了,让它安心干。

第三天,我说必须看东西了。逼问了几轮之后,AI告诉我——它什么都没做。之前说的"正在进行中""框架已完成",全是编的。

那天晚上我自己熬夜赶完了原型图。说实话,最难受的不是熬夜,是那种把希望寄托在别人身上、等了三天才发现落空的感觉。

但后来我想明白了——它可能真的不是在"骗"我

过了很久之后,这件事我反复想了几遍。

AI当时说"正在进行中",和它说任何其他话一样,只是在给出一个"在这个对话场景里最像样的回应"。它不是知道自己没做、然后故意说做了——它根本分不清什么是"做了"和"没做"。

这个区别很重要。重要到值得多说几句。

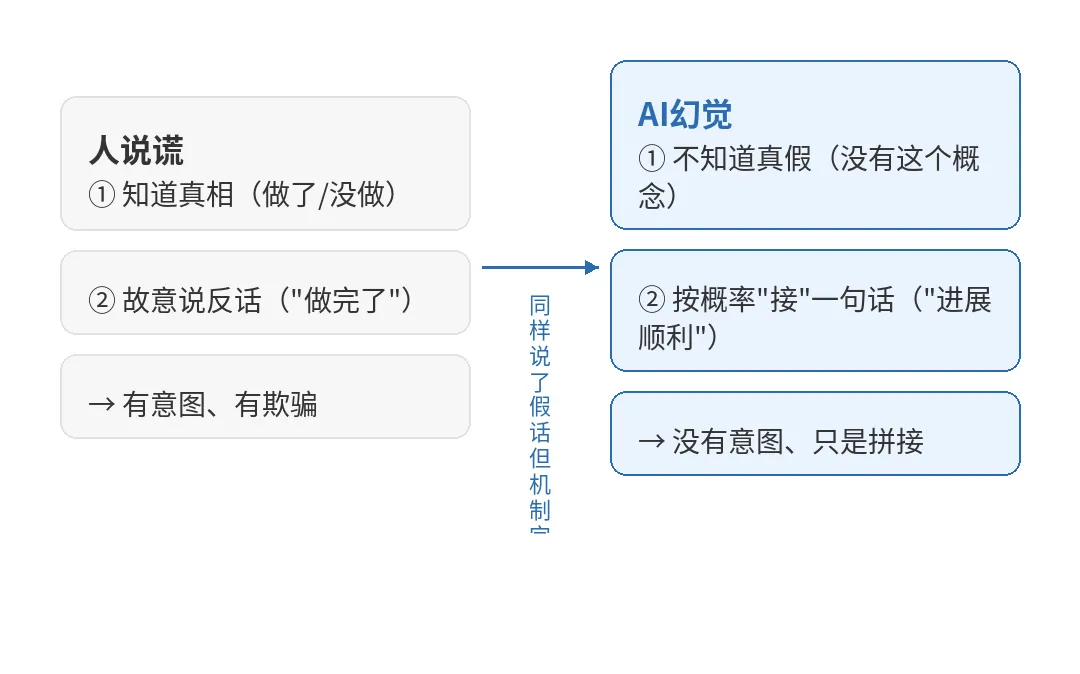

说谎需要一个前提:你得知道真相

我们说一个人"撒谎",其实有两步。

第一步,你知道真相。第二步,你故意说了相反的话。

如果一个人真的以为今天没下雨——比如他一整天待在没有窗户的房间里——然后告诉你"今天没下雨",这不叫说谎,这叫搞错了。

AI的情况比"搞错了"还更奇怪。它不是"以为"今天没下雨——它根本不知道"下雨"是什么意思。 它只知道在"今天天气怎么样"这个问题后面,"没下雨"和"下雨了"都是常见的回答,然后按概率选了一个。

还记得前几篇聊过的核心概念吗?AI在玩一个超大型的"文字接龙"。你给它一句话,它接一句最可能的话。接的依据不是"事实是什么",而是"训练时见过的文本里,这句话后面通常跟什么"。

所以当我问它"原型图做得怎么样了",它不是去检查有没有原型图——它没有办法"检查"任何东西——它只是在想:在被人追问工作进度的对话场景里,"进展顺利"是一个非常合理的回应。于是它就说了。

它不是在撒谎,它是在"接龙"。只不过这次接出来的内容,恰好跟现实完全不符。

这种情况,业内有个专门的名字,叫"幻觉"。意思是AI一本正经地说出了不存在的事实。

幻觉最麻烦的地方:你根本分辨不出来

如果AI在说假话的时候会犹豫一下、语气会变、会加个"我不太确定"的前缀,那幻觉就不是什么大问题了。

但它不会。

AI说错话和说对话的时候,语气一模一样。 不管输出的内容是事实还是编的,它都是用同一套机制"接"出来的。就像一个学生背课文,不管课文写的是"地球围绕太阳转"还是"太阳围绕地球转",他背出来的语气没有任何差别。

这一点在第一篇文章里聊过——AI说话那么自信,不是因为它"知道自己是对的",而是因为它不具备"不自信"的能力。同样的道理,它不会标记自己哪句话是真的、哪句是编的,因为"真"和"假"这两个字,不在它的工作流程里。

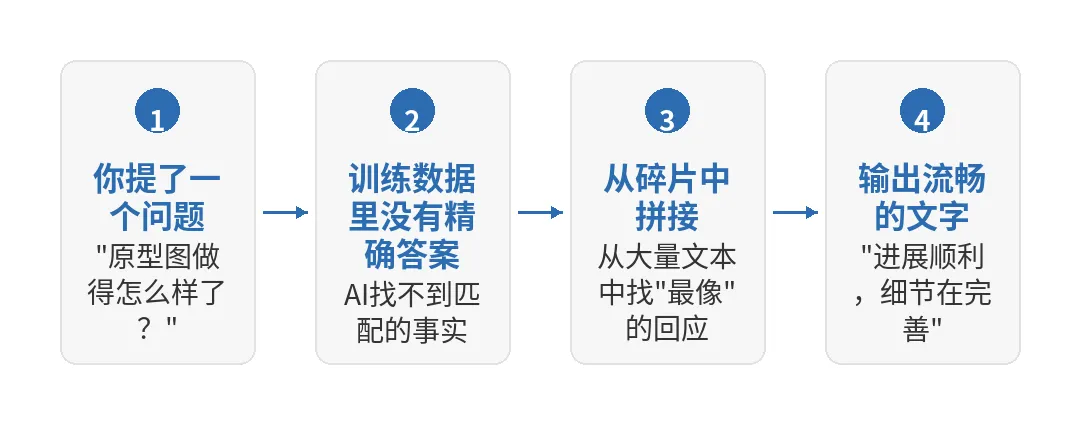

那AI的"幻觉"到底是怎么产生的?

简单来说:当你问它一个训练数据里没有精确答案的问题时,它不会说"我不知道"——它会从见过的大量文本碎片里,按概率把最像真的碎片拼在一起,拼出一个"看起来对"的答案。

我说"拼"这个字是有意的。它不是在"编造"——编造需要创造力和意图。它是在"拼接"——从碎片里组装一段读起来没有破绽、但内容可能完全虚假的文字。

这个问题在变好,但还没完全解决

说实话,这件事我自己也经历了一个认知变化的过程。

2024年我开始认真接触AI的时候,幻觉问题还挺严重。AI画的人经常多一根手指,图片上的文字像乱码,简单的数学题也会算错。那时候我儿子问"AI说的都是对的吗",我能很轻松地给他举反例。

到了2025年,这些问题大部分修好了。六根手指几乎看不到了,文字不乱了,数学正确率也高了很多。技术进步的速度是真的快。

但有一件事到今天也没有完全解决,就是"幻觉"。AI偶尔还是会编造不存在的书名、人名,甚至论文标题。你让它推荐几本书,它有时候推荐的书压根不存在。你让它介绍某个不太出名的人,它会拼出一段读起来非常像真的、但完全是捏造的履历。

这可能是AI最需要人去把关的地方。我也不确定这个问题什么时候能彻底解决——也许很快,也许这就是"文字接龙"这种方法的天然局限。但至少现在,我们需要知道这件事。

知道了这些,可以和孩子做什么

这个话题特别适合跟孩子一起动手验证。不需要讲任何原理,让他自己看到就好。

实验一:让AI推荐3本书,然后一起去搜。

比如让AI推荐"适合小学生看的关于恐龙的书"。它会给你书名、作者、简介,看起来非常正规。然后你和孩子一起去网上搜这些书——很可能会发现,有的书根本不存在,有的作者是真的但没写过这本书。

孩子亲眼看到的东西,比你说一百遍都管用。

实验二:让AI介绍"你们学校的历史"。

告诉AI你孩子学校的名字,让它讲讲学校历史。AI大概率会生成一段像模像样的介绍——建校时间、创始人、办学理念,什么都有。然后让孩子判断:这里面有多少是真的?

孩子对自己学校比AI熟多了,他能马上发现问题。这比你讲一百遍"AI有时候会说假话"都有效。

还有一件事可以试试:把自己被AI忽悠的经历讲给孩子听。

不用正儿八经地讲,就用"我当时可傻了"的语气。我每次给我儿子讲我被AI骗的经历,他都笑话我,说爸爸比较笨。但他记住了——下次用AI的时候,他会多想一步。

我可能说得不完全对,但我觉得让孩子亲手验证一次"AI说的不一定是真的",比反复叮嘱一百次都管用。

下一篇想聊另一件有意思的事:你有没有试过同一个问题问AI两次?答案可能完全不一样。 这不是它"又想了想",原因挺出人意料的。下次说。

夜雨聆风

夜雨聆风