这段时间一直在折腾本地 Agent、OpenClaw、多模型协同和长任务工作流。越折腾,越清楚一件事:

现在很多 AI 系统最大的瓶颈,已经不只是“够不够聪明”,而是“够不够节制”。

很多演示里,Agent 看起来无所不能:会读文件、会调用工具、会写代码、会拆步骤、会自己跑流程。

但真放进真实工作流里,很快就会遇到另一套完全不同的问题:

工具输出一多,上下文迅速膨胀;历史消息一长,压缩就开始不稳定;模型一换大,显存、内存、时延一起上升;一旦走云端,token 成本很快就不再是“体验问题”,而是“账单问题”。

表面上看,这像是模型能力还不够。但做久了会发现,很多时候不是能力问题,而是系统设计问题。

换句话说:

今天的 AI,正在越来越像一个高能耗、高冗余、高依赖堆料的系统。

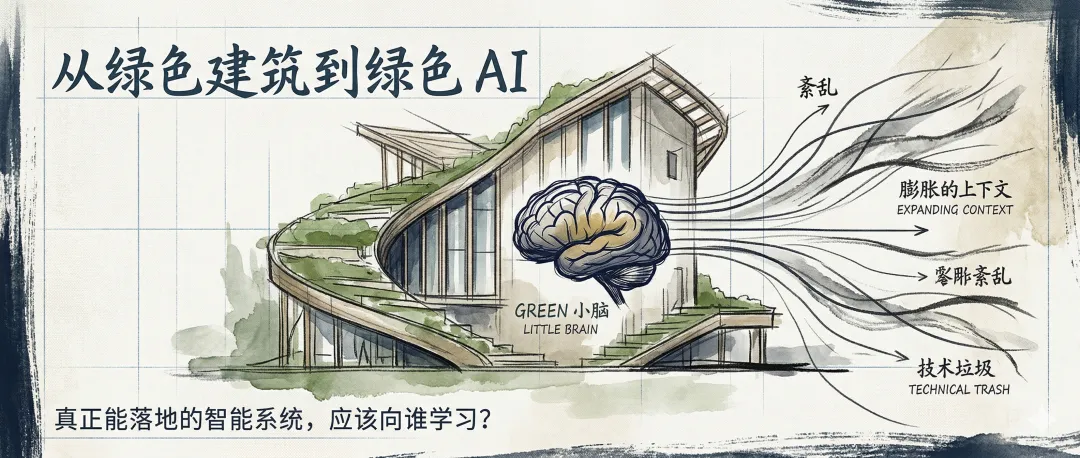

而这恰恰让我想到了另一个领域:绿色建筑。

一、今天的 Agent,困境不在安装,而在落地

如果只看表面,今天的大模型生态已经很热闹了。

本地有 Ollama,上层有 OpenClaw 这类 Agent 框架,云端还有更大、更强、更贵的模型随时待命。

看上去,问题仿佛只剩下“怎么把它们接起来”。但实际跑起来,真正的难点并不在安装,而在落地执行。

这段时间反复验证下来,最大的瓶颈并不是单点能力,而是context 膨胀。

一个长任务里,真正吃掉上下文的,并不只是用户那几句提问,而是整套系统一起往里塞的东西:

系统提示词、历史消息、工具调用记录、tool output、文件内容、中间状态、反复重试留下的残余信息。

这些内容叠在一起,很快就会让一个原本看似充裕的 contextWindow 变得不够用。

理论上,可以继续把窗口拉大。但在现实环境里,这种办法往往只是把问题往后推,而不是解决问题。

比如 contextWindow 拉到 256k,看起来更“宽裕”了,但显存占用、内存占用和推理时延也会明显上升。对 3060 这类本地场景来说,回到 65536 这种更克制的范围,反而更符合实际。再比如 compaction,本意是为了续命,但在不少场景里它不只是“优化器”,反而会变成新的故障触发点:摘要不准、状态漂移、任务中断,最后整段流程越来越脆。

很多人会本能地继续往上堆:不够稳,就再加 prompt;不够全,就再加工具;不够聪明,就再换大模型。

短期当然有用。但复杂任务一上来,就会出现一种非常典型的局面:

AI 似乎更强了,但系统反而更重、更慢、更贵,也更容易失控。

甚至在一些本地模型场景里,部分 GPU offload 也不一定更快。对 30B 量级模型来说,CPU + GPU 混合推理有时会因为频繁的数据搬运,反而不如纯 CPU 来得干脆。这说明问题已经不再只是“有没有硬件”,而是资源调度方式本身是否合理。

云端也一样。很多人以为把任务交给云模型,问题就解决了。其实并没有。

因为 context 不会因为到了云端就自动变小,tool output 也不会自动变短。如果还是沿用现在这种“大量工具输出回灌、长上下文维持状态、多轮历史反复叠加”的工作方式,那么结果通常只有一个:

本地承受的是显存和时延,云端承受的是 token 和账单。

根问题并没有变。

二、当“加法”不再有效,就要换一种思维找答案

做到这里,问题其实已经很清楚了。

今天不少 AI 工作流的默认逻辑,本质上是一种粗放式加法:

上下文不够,就继续拉长;模型不够强,就继续变大;结果不够全,就继续回灌;执行不够稳,就继续重试。

这条路在能力展示阶段非常好用,但一进入长期任务、真实业务和成本约束,就会越来越吃力。

我后来意识到,这种困境其实并不陌生。建筑行业早就经历过一轮类似的问题。

过去建筑设计也有一种很典型的粗放思路:室内热不舒服,就拼命加空调;能耗高,就继续堆设备;系统不好控制,就再加一套智能控制;一个系统不够,再补一个系统。

这样当然也能解决一部分问题。但代价很明显:系统越来越复杂,能耗越来越高,维护越来越难,稳定性也越来越依赖“不断加码”。

后来为什么会有绿色建筑?根本原因不是因为大家突然喜欢“绿色”这两个字,而是因为传统粗放型路径走到一定阶段之后,继续加设备已经不是最优解了。

真正更优的办法,是反过来想:

能不能先降低负荷?能不能先优化围护结构?能不能先做被动式设计?能不能先让系统本身更克制,再去谈主动设备和高精控制?

绿色建筑的价值,恰恰就在这里。它不是简单地“多装一点节能设备”,而是把思路从“不断加法”改成“先减负,再提效”。

而今天的 AI,正处在一个非常相似的节点。

三、绿色建筑给 AI 的启发,不是口号,而是方法

如果把今天的 AI 系统和绿色建筑放在一起看,会发现它们之间有一种非常强的对应关系。

传统粗放型 AI,像什么?像一栋围护结构很差、朝向混乱、负荷很高的建筑,却想靠不断加空调、加风机、加控制器来维持舒适。

上下文不够,就扩 context;响应不稳,就换更大模型;结果不准,就全量回灌;任务断了,就整段重跑。

看起来每一步都合理,但整体上越来越重,越来越贵,也越来越依赖资源堆叠。

绿色建筑的方法恰恰相反。

它强调的第一件事,不是先上设备,而是先做被动优化。先把建筑本身的负荷降下来。先通过朝向、遮阳、围护结构、通风组织,把不必要的消耗压下去。只有在这个基础上,主动系统的价值才会真正体现出来。

把这个逻辑放到 AI 里,其实非常顺:

不是先想“哪个模型更大”,而是先想“哪些 token 根本不该花”。

不是先想“如何把更多信息塞进上下文”,而是先想“哪些信息根本没必要进入上下文”。

不是先想“要不要上更强的工具链”,而是先想“当前流程里有没有大量无效搬运、重复推理和状态污染”。

这就是我越来越认同的一个方向:

AI 也需要绿色化。

这里说的“绿色”,不是一个泛泛的环保口号,而是一种系统设计原则:

尽量减少无效推理、无效上下文、无效搬运和无效扩容,让系统在更低浪费的前提下维持稳定执行。

它至少包含几个非常具体的技术要求。

第一,复杂任务不能只靠聊天上下文维持状态,必须落到本地文件。像 task_context.md、manifest.json、issues_log.md、run_summary.md、project_scan.csv 这类文件,不只是“记录”,而是任务可续跑、可审计、可恢复的基础设施。详细结果尽量写文件,对话里只留摘要、统计值、路径和当前阶段状态,这本质上就是在做“上下文节能”。

第二,工具输出不能默认全文回灌。tool output 应该分级:哪些必须全文保留,哪些只保留摘要,哪些写入文件后直接丢弃。这不是节省几行文字,而是在控制整个系统的上下文负荷。

第三,任务必须分阶段执行,而不是整库一次跑完。分阶段意味着每一段都有边界,有中间成果,有断点恢复能力。这和建筑里分区、分系统、分阶段调试的逻辑非常像,本质都是为了降低整体失控风险。

第四,精确路径、规则源、输入输出目录,不能主要依赖 memory。只靠会话记忆来维持工程状态,本身就是高风险设计。这些关键信息必须固化到本地规则文件里,才能避免路径漂移和状态走失。

写到这里,绿色 AI 的轮廓其实已经出来了。它不是少用模型,而是先把系统中的无效负荷降下来,再让模型在真正有价值的地方发力。

四、真正可持续的 Agent,需要一个“绿色小脑”

顺着这个逻辑继续推,就会得到一个很重要的结论:

未来真正能落地的 Agent,不应该永远拿大模型顶在最前面。它应该先有一个轻量化、本地常驻、低占用的小型 AI,作为调度层。

这个调度层,不妨把它理解成一个“绿色小脑”。

它不需要最强,但必须最稳。它不负责炫耀能力边界,而负责守住系统边界。

它主要做什么?

判断这次任务值不值得调用大模型。不是所有任务都值得直接上 30B、70B,更不是所有任务都值得走云端高成本路线。

判断哪些内容必须进入上下文。哪些信息要给模型看,哪些只写本地文件,哪些直接丢弃,应该由它先筛一遍。

判断工具输出的保留方式。全文、摘要、索引、路径,甚至直接删除,都应该有规则,而不是默认全部塞回会话。

维持任务状态和续跑秩序。会话断了,任务不能断;入口变了,状态不能丢;长任务跑到一半,必须知道自己停在哪一步。

控制 tokens、显存、时间和费用。它要像项目经理、调度员和会计的结合体,知道什么时候该省,什么时候才值得上高精度模型。

其实这跟绿色建筑里的系统分工非常像。不是把所有问题都甩给一个“超级设备”,而是让每个层级承担适合自己的工作,把高成本能力留给最值得的环节。

所以我越来越相信,下一代 AI 工作流,更合理的形态不是“一个模型包打一切”,而是分层结构。

第一层,是绿色 AI 小脑。轻量、本地、常驻、低功耗,负责分级、筛选、调度、记账、续跑和风险提醒。

第二层,是专业执行模型。用中等模型承担日常扫描、分类、整理、结构化输出等工作。

第三层,是高精度验证模型。只在关键节点调用,用于复核、冲突判断、最终审校和高风险结论确认。

这样一来,高成本能力不再被日常滥用,大模型从“全程苦力”变成“关键节点专家”,整个系统也更接近真正可维护、可扩展的工程体系。

五、绿色化,正在成为 AI 发展的真实痛点

为什么我觉得这个方向不是一个小众想法,而会越来越重要?

因为 AI 发展到今天,真正的瓶颈已经越来越不像“有没有能力”,而更像“有没有效率”。

继续堆大模型,当然还能往前走。继续拉长 context,当然也能暂时撑住。继续依赖云端高 token 工作流,也还能服务一部分高预算场景。

但这些路径的共同问题是:它们都在变得更贵、更重、更脆。

一旦 AI 真的要从演示走向大规模真实应用,问题就不会只是某个极客玩家本地跑不跑得动,而会变成更普遍的系统问题:

算力是不是被大量浪费;网络和存储压力是不是不断增大;工作流是不是越来越难维护;普通用户是不是根本承受不起持续的使用成本;企业是不是不得不把越来越多高复杂度能力委外给云端、平台和专业服务商。

从这个角度看,“委外趋势”其实也不是偶然的。当系统越来越重、成本越来越高、维护越来越难时,外包高复杂度能力几乎是自然结果。就像建筑行业里,不可能所有专项都由一个人、一家公司、一套系统独立完成一样,AI 也会越来越走向分工。

但问题在于:如果没有绿色化思路,委外只会把成本转移,不会把问题解决。

真正合理的趋势,应该是:

本地保留轻量调度和状态秩序,专业执行按层分工,高成本高精度能力只在关键节点委外。

这样委外才不是盲目依赖,而是系统层面的合理配置。绿色化也才不是一个形容词,而是能真正降低成本、降低失控、提升可持续性的设计原则。

六、从绿色建筑到绿色 AI,下一阶段拼的不是“更强”,而是“更稳”

今天很多人谈 AI,最容易谈到的是能力边界。模型更强了,工具更多了,上下文更长了,看起来什么都在往上长。

但真实世界不是只看峰值能力的。真实世界看的是另一件事:

这个系统能不能长期稳定地跑,能不能在成本可控的前提下持续工作。

这恰恰是绿色建筑给人的最大启发。真正成熟的系统,不是靠不断加码维持表面效果,而是先控制负荷,再提高效率;先减少浪费,再使用高成本能力。

AI 走到今天,也该开始进入这个阶段了。

未来真正有价值的,不只是更大的模型,而是更有秩序的智能系统。

它应该会判断,会取舍,会分流,会节制,会把昂贵能力留给最值得的地方。

说到底,下一代 Agent 要解决的,可能不只是“怎么更聪明”,而是“怎么像绿色建筑一样,更少浪费、更少冗余、更少失控”。

这也许才是 AI 真正走向现实世界、走向长期可持续应用的起点。

夜雨聆风

夜雨聆风