不是手机突然开窍了,是云端那三笔账——隐私、时延、成本——终于开始一笔一笔找上门了。

这两天好多人都在把Gemma 4 往手机里塞。

很多人第一反应大概都差不多:这不就是老黄历吗?

前几年就有人讲本地 AI,后来又讲端侧推理,再后来又讲手机跑模型。每次刚出来的时候都挺热闹,过两天就没声了。原因也简单,因为大多数时候它都像那种展台 demo。

你站远一点看,挺唬人。

你真上手一试,就发现味不对。

要么慢得像在拧老式水龙头,半天才滴一滴;要么装起来麻烦得像在给手机做开颅手术;要么虽然能跑,但跑出来的东西只适合拿去朋友圈发一句“见证历史”。

所以这些年,大家心里其实早就形成一个默认判断:本地 AI 不是不行,是没必要。

云端又快、又强、又省事,谁还折腾你这个。

但有意思的地方就在这儿。今年这波端侧 AI 回朝,味道跟以前不太一样了。

以前是在证明“我也能跑”。现在是在回答“什么东西其实根本不该先上云”。这两句话,差得挺远。

前一种是技术展示,后一种是路线重算。

这事为什么会突然变重要?因为云端 AI 这条路,前几年跑得太顺,顺到很多账都被暂时藏起来了。现在 AI 开始想从“偶尔用一下的高级功能”,变成“天天会碰到的基础能力”,这些账就藏不住了。

第一笔账,叫隐私。

以前大家对隐私这事,不是完全不在乎,是没得选。你要用 AI,就得上传。文字上传,照片上传,录音上传,文档上传,聊天记录上传。上传完等它处理,再给你吐回来。

那时候大家还能安慰自己:反正都这样。

但一旦手机本地开始真能干一部分活,问题就会立刻变成另一种问法:既然有些东西根本不用出设备,为什么还非得先发到云上绕一圈?

你会发现,很多需求原来不是“用户不在乎”,而是“用户以前没资格在乎”。现在有替代方案了,心思自然就变了。

尤其是越靠近个人生活的东西,这种感觉越明显。比如照片整理、录音整理、个人知识库、设备内搜索、聊天辅助、甚至手机当前界面的上下文理解。这些东西一旦全都先上云,再怎么说“我们很安全”,用户心里总归会咯噔一下。

不是不让你做,是能不出门最好别出门。

第二笔账,叫时延。

云端 AI 最大的优点,是脑子大。而云端 AI 最大的缺点,就是离你远。

你手机上点一下,数据先上传,再排队,再推理,再回来。只要网络抖一下、服务端堵一下、链路上多拐一个弯,体验立刻就从“聪明”变成“卡”。

而很多 AI 场景,最怕的根本不是答案没那么完美,最怕的是慢。

你想想:看一眼相册,让它帮你找某张图;录一段会议语音,让它顺手给你理个提纲;在设备里搜一条自己写过但忘了放哪儿的内容;或者当前页面上,给你一个低打扰的小提示。

这些动作,用户真正想要的是“顺手”。不是“全世界最强答案”,而是“你别让我等”。

很多时候,离你近,比更聪明值钱。就像你下楼买瓶冰可乐,没人会因为城北那家超市货更全,就愿意顶着太阳先打车过去。

第三笔账,叫成本。

这笔账最阴,但也最真。以前很多人会觉得,云端 AI 也没多贵,甚至很多时候看起来像白送。可那是因为成本暂时没有直接怼到用户脸上。

有的是平台在补,有的是厂商先贴钱抢市场,有的是功能还没大规模展开。可一旦 AI 从偶尔调用变成高频调用,账就完全不是以前那个算法了。

今天帮你改一段话,明天帮你看十张图,后天挂在后台一直理解上下文。再往后,系统里每个地方都想塞一点 AI。到了这个阶段,每一次调用都是算力钱、带宽钱、存储钱。

这些钱总不能一直靠爱发电。最后无非三种结果:要么用户付更多,要么平台开始限次数,要么产品为了控制成本,把功能做得越来越抠。

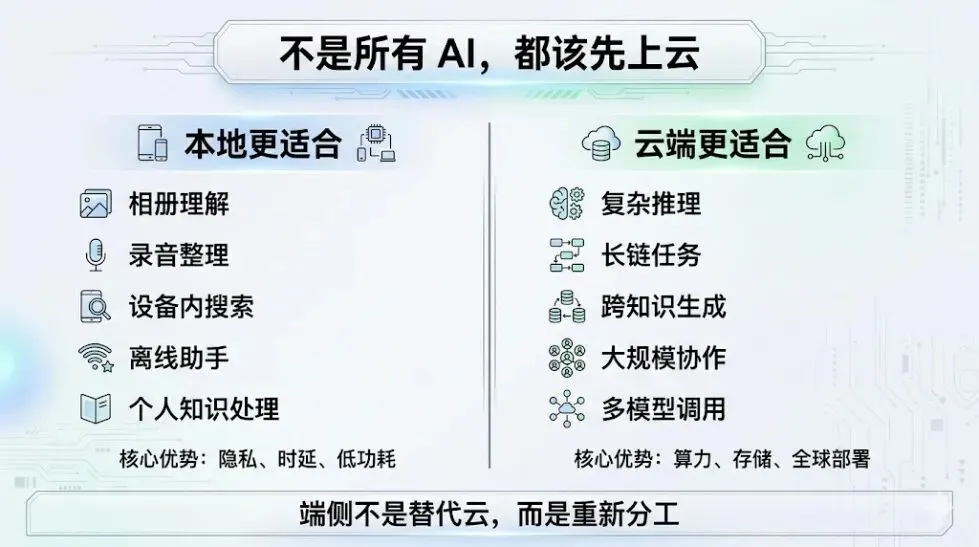

所以端侧 AI 这次重新变重要,不是因为大家突然对“在手机上跑模型”有了童年滤镜。而是因为行业慢慢意识到:不是所有任务,都值得上云。

有些任务太小、太频繁、太私密、太讲究响应速度,硬塞给云端处理,根本不划算。最合理的办法,不是二选一,而是重新分工。

重任务、复杂推理、跨知识整合,继续上云。高频、低延迟、强隐私、设备内闭环的小任务,留在本地。

这就对了。

以前的说法是:云端万能,端侧补充。现在更像是:云端干大活,端侧干碎活。

听起来没那么性感,但特别像成熟产品会干的事。因为成熟产品不迷信“全都最强”,成熟产品只在乎一件事:哪个方案放在这个位置最顺手。

所以你现在再看 Gemma 4 这类消息,重点就别放在“哇,手机也能跑模型了”。这句话已经不值钱了。

真正值钱的是,它让整个行业开始认真讨论一件以前总被糊弄过去的事:什么任务,应该留在设备里解决?

一旦这个问题被认真讨论,很多看似零散的动作就会突然串起来。为什么手机厂商开始猛讲 NPU?为什么系统层越来越想把 AI 做成底层能力?为什么小模型、量化、本地部署又开始升温?为什么“离线助手”“设备内推理”“本地 agent”这些词又变得顺耳了?

因为大家都在补同一堂课:AI 不只是要能用,还要天天能用。

而“天天能用”这四个字,要求的从来不只是模型更强。它要求快,要求稳,要求便宜,要求不烦人,要求别什么都往外传。

这些东西听起来没那么像发布会 keynote,但真到了产品生死线附近,拼的往往就是这些。

当然,话也不能说太满。端侧 AI 现在也没到“从此天下太平”的程度。

它至少还有三道坎。

第一,能力上限还是不如云端。模型一旦缩小、量化,很多复杂任务就是会掉效果。轻量理解、摘要、分类、简单多模态,还有机会;真碰到长链推理、深度生成、复杂规划,云端还是更稳。

第二,设备差异很大。不是每台手机都叫“手机”。芯片、内存、散热、电池、系统权限,都会直接影响体验。你在旗舰机上跑得跟风一样,换一台普通设备,可能立刻就变成拖拉机。

第三,产品设计这关最难。很多人一说端侧 AI,脑子里还是那套老思路:把云端那一大坨功能,原封不动搬到手机上。这路子通常都没啥好下场。

因为用户不会因为你技术很先进,就自动给你鼓掌。真正有机会的,是那些本来就属于设备侧、而且留在本地更合理的场景。

比如:相册理解、录音整理、本地文档总结、设备内搜索、基于当前界面的辅助建议、不想上云的个人知识处理。

这些场景有个共同点:它们都不需要一个世界级最强大脑,它们只需要一个别拖后腿的贴身助手。

这话听着不热血,但特别像真需求。

所以我觉得,端侧 AI 这次真正的变化,不是技术突然爆炸了,而是产品逻辑终于开始讲人话了。

以前是在炫:看,我也能跑模型。现在是在想:哪些任务留在本地,才更像一个正常产品。

这一步迈出去,端侧 AI 才算从 demo 往产品那边挪了一大截。

说到底,端侧 AI 又回来了,不是因为手机突然更强。而是云端那笔隐私账、时延账、成本账,终于拖不下去了。

以前这些问题还可以往后压一压。现在 AI 想变成系统级能力、日常级能力、长期级能力,就压不住了。

Gemma 4 被装进手机这件事,真正值得看的,不是“模型下沉到设备侧”,而是行业终于开始认真承认:不是所有 AI,都该先上云。

这句话一旦承认了,后面很多东西就都顺了。

今天就聊到这。

夜雨聆风

夜雨聆风