> 作者:洛

生成式 AI 越来越普及后,医疗行业或许正在直面、越来越近的现实风险:一张看起来毫无问题的胸片,会被拿去虚报工伤;或是一张显示 “骨折” 的片子,被偷偷放进患者病历,引来多余的治疗,甚至闹上法庭。

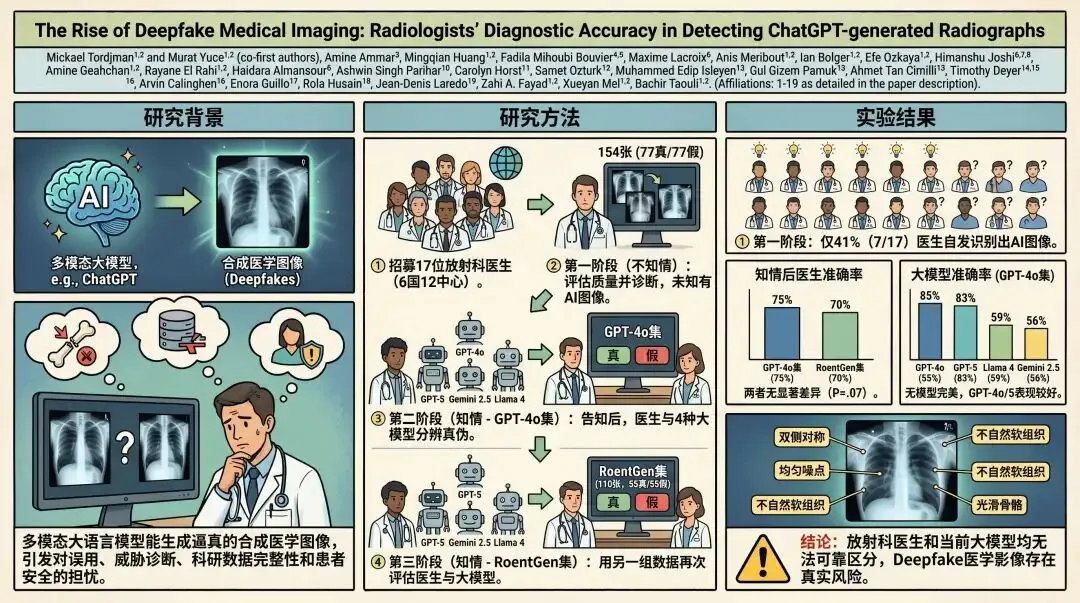

近期,国际顶级放射学期刊《Radiology》在线发表了一项重磅研究,标题为《The Rise of Deepfake Medical Imaging: Radiologists’ Diagnostic Accuracy in Detecting ChatGPT-generated Radiographs》。这项由美国西奈山伊坎医学院等全球多中心团队完成的研究,向医学界乃至整个社会发出了明确警告:由ChatGPT等大语言模型(LLM)生成的“深度伪造”(Deepfake)医学影像,已经逼真到足以混淆专业放射科医生的判断。

研究背景:从“玩具”到“威胁”的AI图像生成

生成式AI在医学影像领域的应用并非新鲜事。早期,研究人员利用生成对抗网络(GAN)合成低分辨率图像,主要用于扩充算法训练数据集,平衡罕见病样本,或为医学生提供无风险的练习材料。这被视为一项积极的技术辅助。

然而,技术的迭代速度快得超乎想象。从2025年3月发布的GPT-4o开始,像ChatGPT这样的通用大语言模型,已经能够通过简单的文字指令,直接生成涵盖文本、代码、音频和图像的多模态内容。这意味着,生成一张指定解剖部位、投照角度甚至特定病变的X光片,其技术门槛已降至近乎为零。任何人都可能成为潜在“伪造者”。

这种能力的“民主化”带来了双重效应。一方面,它能为医学教育创造巨大价值,例如按需生成各种罕见病例。另一方面,它也彻底模糊了真实临床数据与AI合成图像之间的界限。恶意合成的影像可能污染科研数据库、通过“数据投毒”影响AI模型训练,甚至被篡改进个人医疗记录,直接导致误诊和医疗欺诈。

实验设计:一场针对人类专家和AI的“大家来找茬”

为了量化这一风险,西奈山医学院的研究团队设计了一个严谨的三阶段实验。

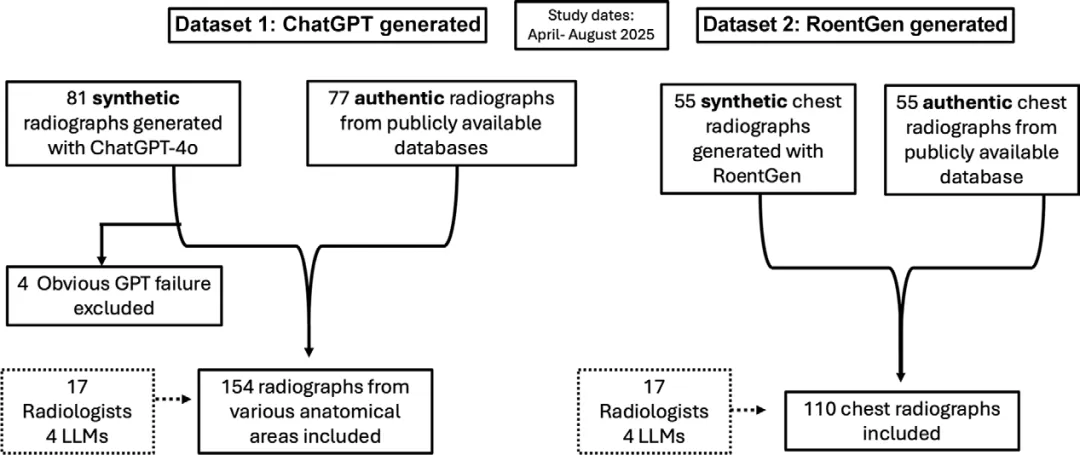

他们首先利用ChatGPT-4o,根据包含解剖部位、投照方式、目标异常(如骨折、肿瘤)等信息的文本提示,生成了77张合成X光片,涵盖胸部、脊柱和四肢。同时,从公开数据库和机构内数据库中匹配了77张真实的X光片,共同组成第一个数据集。

随后,研究招募了来自美国、法国、德国、土耳其等六个国家、12个医疗中心的17名放射科医生。这些医生的经验从住院医师到拥有40年资历的专家不等,涵盖了肌肉骨骼、胸部、体部等多个亚专业。

实验的第一阶段,医生们在不知情的情况下,像平常一样对这些图像进行质量评估和诊断。第二阶段,研究人员告知他们数据集中混有AI生成的图像,并要求他们对每张图进行“真伪鉴定”。第三阶段,医生们还需要面对另一个由专业胸部X光生成模型“RoentGen”合成的数据集,以比较识别不同来源合成图像的难度。

不仅如此,研究团队还让当今最先进的四个多模态大语言模型——GPT-4o、GPT-5、谷歌的Gemini 2.5 Pro和Meta的Llama 4 Maverick——也加入了这场“鉴定挑战”,看看AI自己能否识破自己的“作品”。

实验结果:医生和AI都“翻车”了

在最初不知情的第一阶段,仅有41%(17人中的7人)的放射科医生自发地察觉到数据集中可能存在AI生成的图像。这意味着,在常规工作中,超过一半的专家可能完全不会对这类高度逼真的伪造影像产生怀疑。

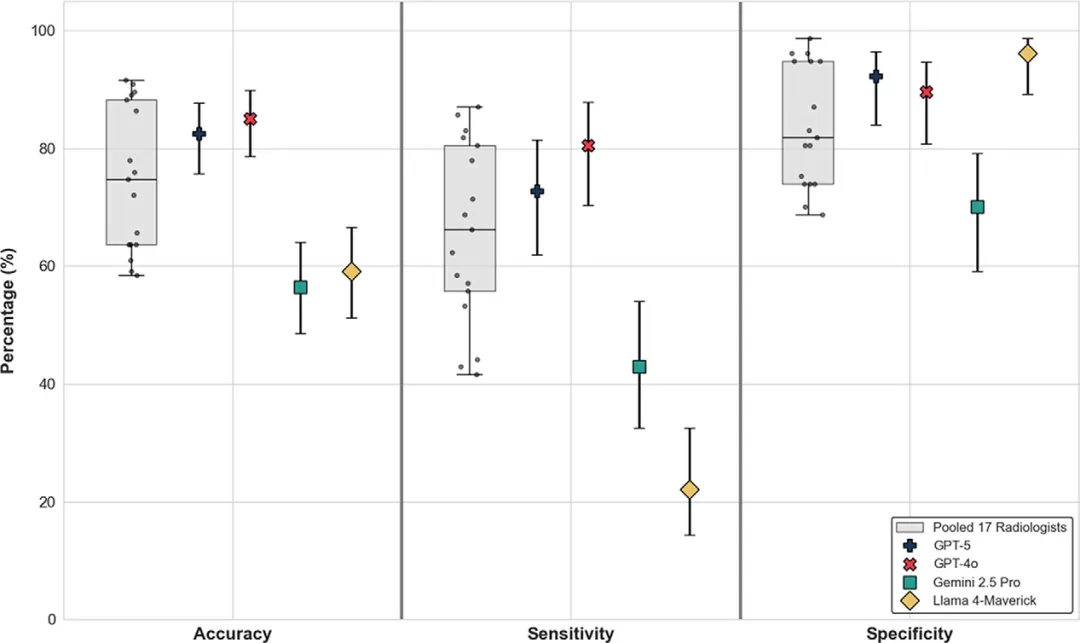

当被告知需要鉴别真伪后,医生们的整体识别准确率有所提升,但对GPT-4o生成图像的鉴别准确率平均为74.8%,对RoentGen生成胸部片的鉴别准确率为70.0%。换言之,平均每4张AI生成的X光片中,就有1张能成功骗过专家的眼睛。更值得注意的是,医生的经验年限、之前是否接触过AI生成图像,都与他们的鉴别准确率没有显著关联。只有肌肉骨骼亚专业的医生表现稍好(准确率83.0%),这可能与他们日常阅读的影像纹理细节更复杂有关。

而AI模型自己的表现则充满了讽刺和差异。没有任何一个被测的大语言模型能识别出所有的合成图像。其中,生成这些图像的“本尊”GPT-4o对自己的“作品”最熟悉,鉴别准确率最高,达到85%;其升级版GPT-5为83%。而谷歌的Gemini 2.5 Pro和Meta的Llama 4 Maverick则表现不佳,准确率仅在56%-59%之间,几乎等同于随机猜测。这揭示了一个关键问题:不同AI模型生成和鉴别的“风格”与能力存在巨大差异,目前尚无一个通用的、可靠的“AI测谎仪”。

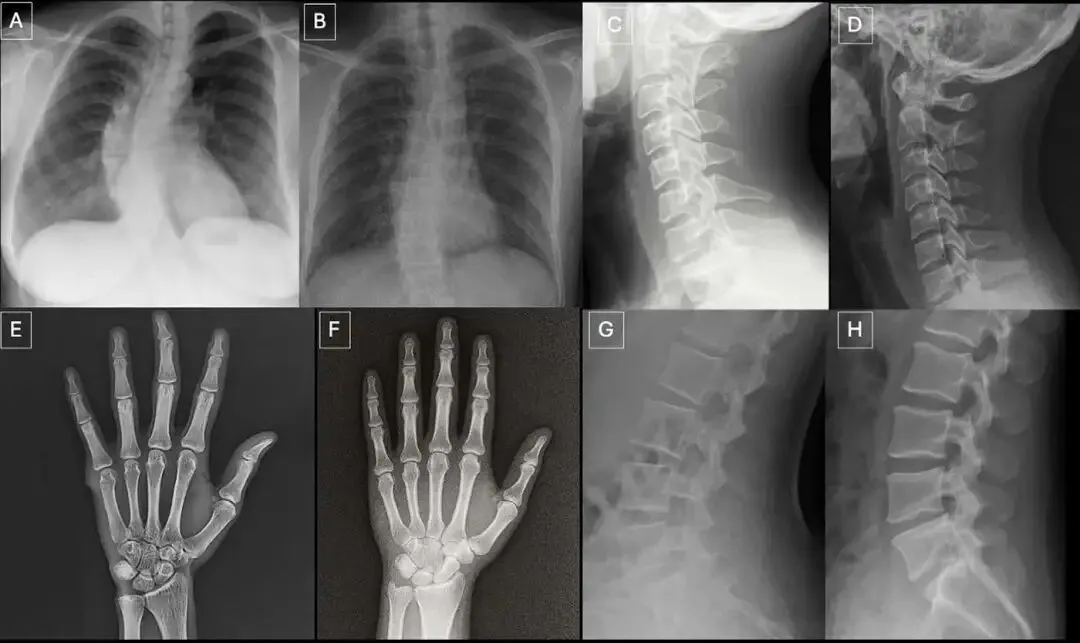

AI的“完美”正是破绽:专家总结伪造影像特征

那么,这些最终被识破的AI生成图像,破绽究竟在哪里?参与研究的放射科医生们总结出一些共同特征:

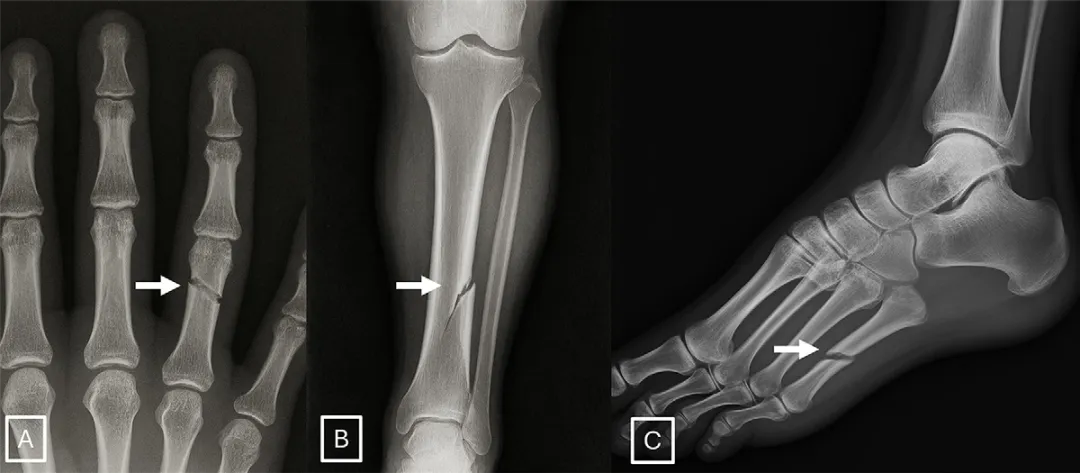

过度的对称性:AI倾向于生成完全对称的解剖结构,例如脊柱完美笔直,除非特意提示“脊柱侧弯”。 均匀的纹理与噪声:真实X光片的颗粒噪声分布是不均匀的,而AI生成的图像噪声往往过于均匀一致。 不自然的软组织纹理:肌肉、脂肪等软组织的灰度过渡有时显得 subtly(微妙地)不自然。 过于光滑的骨骼:骨皮质的边缘异常光滑,厚度均匀,缺乏真实骨骼那种自然的微小不规则和纹理。 “理想化”的骨折线:AI生成的骨折线往往异常清晰、平滑,有时甚至是单皮质的(仅一侧骨皮质断裂),这与真实创伤中复杂、粗糙的骨折形态不同。

风险与应对:构建医疗影像的“防伪长城”

这项研究的结论是明确的:利用大语言模型生成的合成X光片(深度伪造),无论对于放射科医生还是当前的多模态AI模型,都不容易与真实的临床图像区分开来。 这种能力被滥用的潜在风险极高,包括保险欺诈、医疗法律纠纷,甚至是孟乔森综合征(一种心理疾病,患者虚构或制造疾病症状)等。

面对这一新兴威胁,坐以待毙绝非选项。研究团队和业界专家指出,必须构建一个多层次的防御体系:

首要任务是教育:必须对全体临床医生,尤其是影像科医生进行培训,提高他们对AI生成影像特征的认识。为此,该研究团队已公开了一个精心整理的深度伪造X光片数据集(https://noneedanick.github.io/DeepFakeXRay/),供全球同行用于教学和训练。 发展自动化检测工具:研究显示,医生间鉴别的一致性仅为“一般”(Fleiss κ=0.31),说明依赖人眼并不可靠。亟需开发基于像素级分析的、可集成到医疗信息系统中的自动深度伪造检测算法。 推行源头水印与认证:为AI生成的医学图像嵌入不可见的数字水印,或在DICOM(医学数字成像和通信)文件头中添加“合成图像”的元数据标签。更进一步的方案是探索利用区块链技术,为每张真实影像建立不可篡改的“出生证明”和流转记录。 加快监管框架建设:目前,美国FDA(食品药品监督管理局)和欧洲EMA(药品管理局)尚未就合成医学图像发布明确指南。随着技术普及,建立针对合成图像的验证、标注、隐私保护、防滥用及风险分级的监管法规已刻不容缓。

结语

生成式AI无疑是一把强大的双刃剑。它在为医学研究、教育和临床辅助打开新世界大门的同时,也悄然打开了“潘多拉魔盒”。西奈山医学院的这项研究犹如一记响亮的警钟,提醒我们:当技术能够以假乱真时,捍卫“真实”本身就成了一场必须赢得的战斗。

医学影像作为客观诊断的基石,其真实性与可信度不容有失。在AI深度伪造技术尚未造成广泛危害之前,学术界、工业界和监管机构必须携手合作,未雨绸缪,建立起坚固的“防伪长城”,确保这项革命性技术能够在安全的轨道上,真正造福于人类健康。

-- 完 --

机智流推荐阅读:

1. 当AI审稿人从“看论文”到真正跑通你的代码:东南大学等提出FactReview,一个证据驱动的论文评审系统

2. 从养虾到养马:Hermes Agent会是下一个OpenClaw吗?33K Stars,自动进化,模型无关

3. Claude Managed Agents公测、Meta发布Muse Spark、Cursor手机控制,基础设施战争开打

4. 解锁人机共融新篇章:中科院团队发布全球首个下肢多模态步态数据集K2MUSE,助力康复机器人应对真实世界挑战

cc | 大模型技术交流群 hf | HuggingFace 高赞论文分享群 lc|LangChain 技术交流群 code | AI Coding 交流群 具身 | 具身智能交流群 硬件 | AI 硬件交流群 推理 | AI 推理框架交流群 智能体 | Agent 技术交流群

夜雨聆风

夜雨聆风