点击上方

AI 的风暴正在冲击学术圈,而且比大多数人意识到的更猛烈。

第一篇完全由 AI 生成的论文,通过了 ICLR 2025 同行评审。

2024年8月,日本 AI 研究机构 Sakana AI 联合牛津大学和英属哥伦比亚大学,发布了 The AI Scientist,全球首个旨在自主完成科研全流程的系统:从生成假设、编写代码、运行实验,到产出完整的学术论文。每篇论文的计算成本仅仅为15美元。

升级后的 AI Scientist-v2,向 ICLR 2025 Workshop 提交了三篇完全由 AI 生成的论文,其中一篇以6.33的平均评分通过了双盲同行评审。

2026年2月,另一记重锤砸下。

一家叫 Math, Inc. 的 AI 公司开发的推理智能体 Gauss,只花了 5 天,就自动完成了人类数学家团队 15 个月还没搞定的任务——验证 8 维空间中的球体堆积问题。这是2022年乌克兰数学家玛丽娜·维亚佐夫斯卡(Maryna Viazovska)获得菲尔茨奖的研究课题。

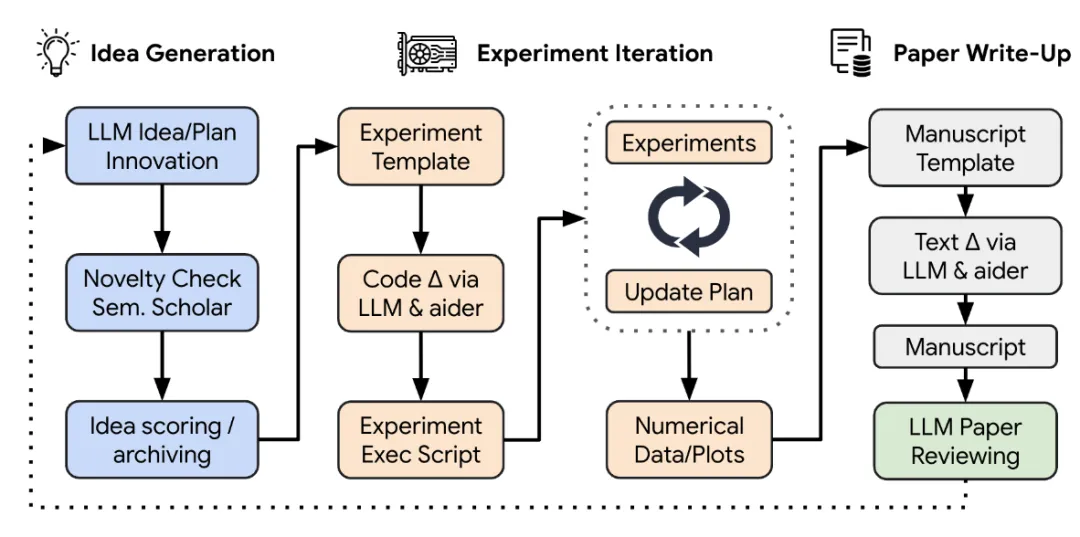

The AI Scientist 的概念插图。运行流程为:①“头脑风暴”一组想法、评估创新性;②编辑一个自动化代码库、进行实验并撰写科学报告;③最后生成自动同行评审。

可以看到,一方面,学术论文正在变成一种可批量生产的工业品。而另一方面,AI 已经展现出人类个体甚至团队都难以匹敌的知识验证能力。

两股力量同时作用于学术体系,开始动摇整个知识生产的基础逻辑。

从现在开始,需要回答的真问题是:当机器越来越有能力承担学术研究的工作,人在知识生产中的角色究竟是什么?大学存在的意义又是什么?

对 AI 论文的支持者,他们相信的是这样一套令人振奋的叙事:AI 正在让知识生产“民主化”。

这个论断有其真实的一面。在过去,一篇合格的英文学术论文,需要研究者具备扎实的文献积累、严谨的研究设计、娴熟的学术英语写作能力,以及长达数月乃至数年的反复修改。这些门槛,在客观上将大量来自资源匮乏地区、非英语母语背景、以及正处于学术生涯早期阶段的研究者拒之门外。AI 的介入,确实在一定程度上拉平了这条学术鸿沟。

但这里隐藏着一个我们必须警惕的认知陷阱:论文写作的民主化,并不等同于知识的民主化,更不等同于思想的民主化。

认知科学领域的经典理论早已告诉我们,知识的生产过程,本身就是认知建构的过程。而正如维果茨基(Vygotsky)的社会文化学习理论所强调的,思维发展离不开“符号中介”。也就是说:自主地使用语言,不仅是在表达思想,更是在生成思想。当研究者艰难地梳理文献、构建论点、遣词造句、反复修订时,这个“写”的过程本身,就是知识内化与思想深化的过程。

而当这个过程被 AI 接管,当人类把使用语言的权利主动让渡出去,当研究者退化为“提示词工程师”时,究竟还剩下多少认知建构过程真正作用在我们的大脑中?

更深层的问题在于:AI 生成论文,不能“无中生有”地创造。

AI 特别擅长在现存的知识空间内填补空白,通过对既有知识的重组来呈现一些新鲜的内容,比如找到尚未被组合的关联概念、尚未被验证的关联假设、尚未被引用的交叉文献。

然而,真正拓展人类知识边界的,从来不是对已有知识空间的精细填补,而是向已知空间之外的“那一跃”——那种诞生于直觉、异想、偶然性与人类经验的突破之举。

今年1月发表在《自然》(Nature)期刊上的一项研究揭示了 AI 在科研领域应用的一个悖论:随着科学家们越来越多利用 AI 作为科研辅助工具,研究进展不断加速,但科学研究的关注视野却在收窄。也就是说,论文越来越多,但真正改变领域走向的突破性研究却越来越少,学术同质化的情况日益严重。

戳破这种表面繁荣的假象,就迫使高等教育重新思考:当学术写作与自主思考脱钩,论文产出的还是真正的知识吗?构建在如此“知识”之上的学术体系基座,到底还有多牢靠?

学术期刊,尤其是以 SCI/SSCI 为代表的国际期刊体系,长期以来在科学知识生产中扮演着“质量守门人”的角色。同行评审制度是这个体系的核心信用机制:由领域内专家匿名评审投稿论文,从而保证所发表知识的质量与可靠性。

而 AI 的介入,正在从两个方向侵蚀这个体系赖以存续的可信度。

首先,当 AI 写作变得普遍,“谁是真正的作者”这一根本问题将引发深层的学术伦理危机。

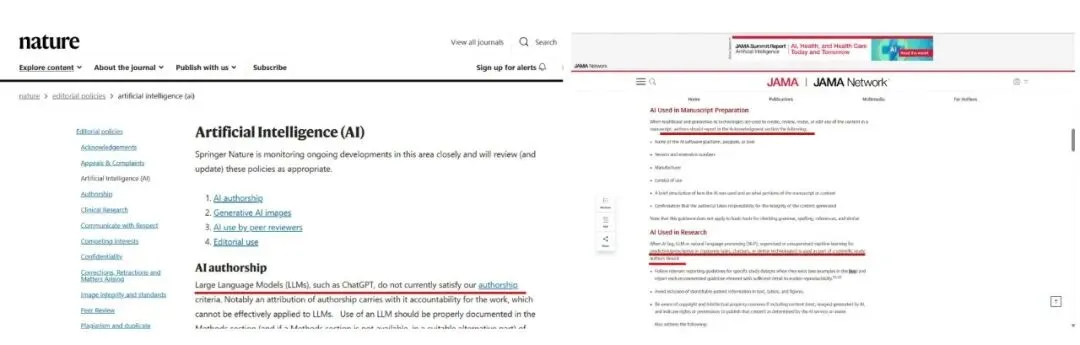

国际上已有多家顶级期刊明确要求作者声明 AI 使用情况。例如,《自然》期刊明确禁止将 AI 工具列为作者,并要求若在研究或写作中使用了 AI 辅助技术,必须在稿件的“方法”或“致谢”部分注明;《美国医学会杂志》(Journal of the American Medical Association)在投稿系统中设置了专门问题,强制作者声明是否使用了 AI 工具。

《自然》与《美国医学会杂志》期刊关于“使用 AI 撰写论文”的明确说明。

不过,这种声明在缺乏技术手段加以检验的情况下,更多依赖于投稿人的自我规范,难以形成系统性保障。

其次,当 AI 可以批量生成格式规范、逻辑连贯、符合学术惯例的论文时,期刊编辑和审稿人将面临前所未有的甄别压力。

AI 生成的论文往往具有很高的表面规范性——结构完整、引用充分、统计规范,但其内在的原创性贡献却可能极为空洞。这种外形完美的学术空壳,越来越难以被传统的同行评审识别。

2025年7月,《美国急诊医学杂志》(American Journal of Emergency Medicine)发表了一篇文章,旨在调查专业审稿人是否能识别出 AI 所生成的论文。研究者要求 ChatGPT-4o 撰写了一篇医学 SCI 论文,其中涉及1000例患者的合成数据集完全是虚假的。这篇论文被发送给14位有经验的审稿人,其中11位未发现稿件由 AI 生成,还有4位认为稿件只需小幅修改即可录用。

综合以上两点来看,传统学术期刊体系或许将在 AI 时代迎来前所未有的衰退。

这一体系本是前数字化时代的产物。当知识传播需要依靠纸质出版物时,期刊才能成为稀缺的传播渠道。互联网的出现已经动摇了这种稀缺性,而 AI 论文以假乱真的能力,进一步瓦解了期刊作为学术认可机制中重要一环的可信度。

取而代之的,可能是一套更为多元和动态的知识认证体系:基于开放同行评审的预印本平台(如 arXiv 生态的持续演化)、基于社群认可的知识贡献记录系统、基于引用影响的动态信誉机制,乃至基于区块链的学术贡献可溯源体系。

这不是想象中的未来,而是正在发生的现在。问题在于:在这段过渡期内,高等教育的评价体系能否及时跟上?还是将在路径依赖的惯性中,继续沿用一套日益失效的标准,评判一代亟待改变的学者?

AI 工具对学术环境的冲击,将高校教师进一步拖入进退维谷的制度困境。

一方面,由于中国高校现行的教师考核体系仍高度取决于论文发表数量,在“非升即走”的强压机制下,青年教师面临的生存压力,很容易驱使他们将 AI 这类提效工具视为不得已的理性之选——毕竟,批量生产论文确实有助于短期内迈过考核门槛。

另一方面,当 AI 能够在短时间内生成大量接近发表标准的论文时,教师们以学术成果来衡量自身价值的逻辑就变得岌岌可危。这是因为大多数教师的身份认同深度绑定于两件事:第一是研究,产出有影响力的学术成果;第二是教学,成为学生面前的知识权威。

教师的价值认知与科研学术、课堂教学强相关。而由 AI 产出学术论文,无疑会对教师的身份认同造成剧烈冲击。

更残酷的是,AI 的冲击在不同学科间的分布极不均匀。那些高度依赖知识重组与文本生产的领域,以及数据密集型的量化研究、标准化的系统综述类研究,都是 AI 最擅长的领域。而那些需要长期田野调查或创新性理论突破的研究,AI 则显得力有未逮。

这意味着,高校教师内部将出现一种新的学术阶层分化,不同学科的教师将面临截然不同的职业命运。

美国斯坦福大学教育研究院的拉里·库班(Larry Cuban)教授在其关于教育技术历史的研究中,反复论证了一个规律:每一次技术革命都宣称将颠覆教育,但教育系统最终吸收了技术,而技术并未颠覆教育。

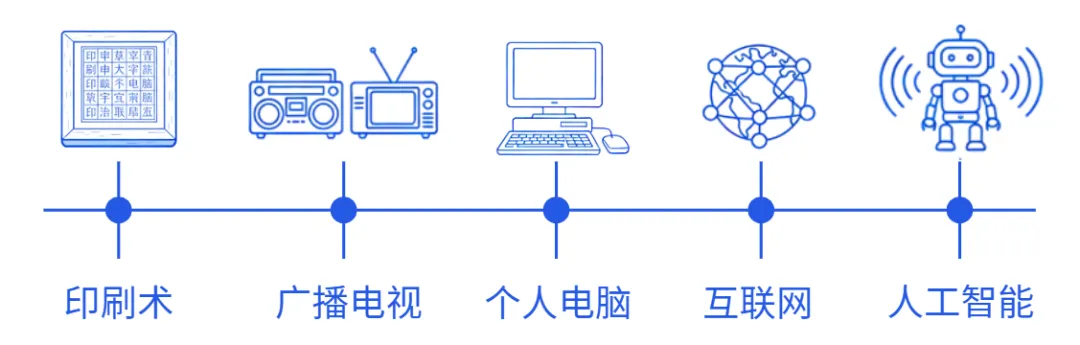

以往的技术发展,只改变知识传播方式;如今人工智能技术的发展,同时改变着知识生产的方式。

但这一次 AI 的冲击或许将与以往不同。以往的技术,例如从印刷术到广播电视,从个人电脑到互联网,改变的是知识传播方式。这一次,AI 改变的是知识生产方式。这是一个更为根本的层次,它触碰的是大学安身立命的最深处。

大学作为知识生产和传授中心的逻辑,如今受到剧烈动摇。AI 写作带来学术论文的批量生产,但原创性的知识产出不仅没有迎来井喷,反而愈加收窄。学术发表体系难以规范和识别 AI 论文,使其自身陷入可信度危机。而高度依赖于期刊发表成果进行教师评定的高校管理考核制度,也随之失去了合理性。

种种危机撕开了旧秩序的裂口,阵痛是必然的。

不过,AI 对知识生产方式、知识生产者的冲击,或许也是一次迟来的、痛苦的、却真正有可能催生高等教育深层变革的契机。

文章来源:教育数字化100人

我们期待原创稿件,来稿请发: moxiangxueshu@126.com

温馨提示:推广内容如有侵权请您告知我们会在第一时间处理或撤销; 互联网是一个资源共享的生态圈,我们崇尚分享。

温馨提示:推广内容如有侵权请您告知我们会在第一时间处理或撤销; 互联网是一个资源共享的生态圈,我们崇尚分享。

(来源:墨香学术 微信:moxiangxueshu)

(来源:墨香学术 微信:moxiangxueshu)

转载仅供思考 不代表【墨香学术】立场

公众号推荐

墨香学术

关注学术资讯,追踪学术前沿

密切关注学术资讯,持续追踪学术前沿问题,积极推广原创性成果

夜雨聆风

夜雨聆风