摘要:针对传统智能家居指令僵化、生态割裂的痛点,我全栈开发了一套基于“AI Agent + 自动化中控”的进化方案。该方案创造性地整合了 HomeAssistant 的硬件控制力与 OpenClaw 的逻辑推演能力,利用 Ollama 与 LiteLLM 技术链实现了 AI 能力的本地化封装。这不仅是一次硬件的堆砌,更是对家庭感知与决策链路的重构,打造出了一个真正理解用户意图、能够自主进行任务编排的私有化智能枢纽。

一、背景

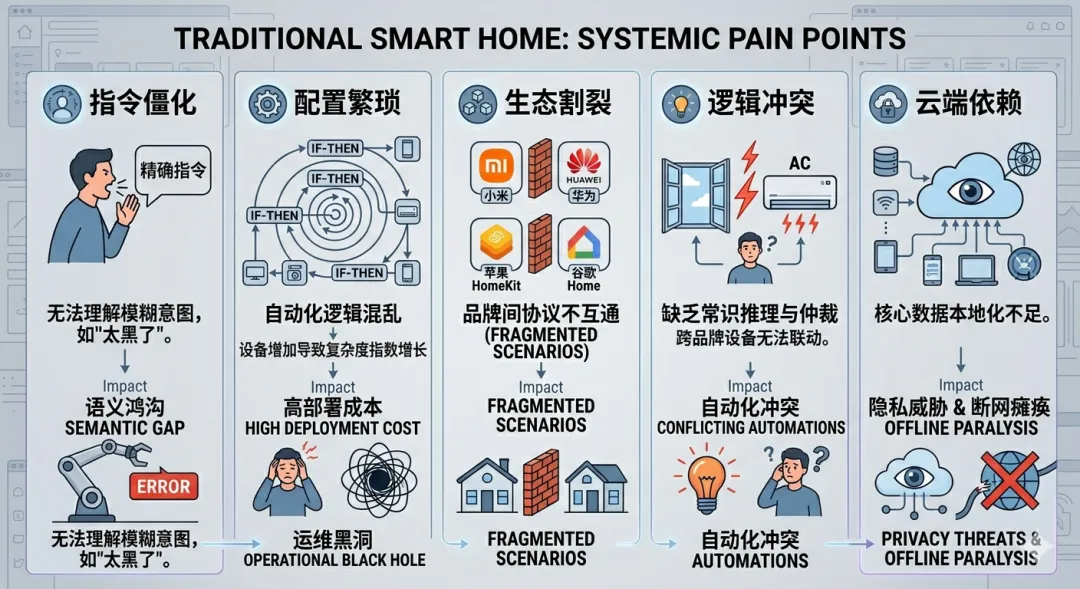

1.1 传统智能家居的几大痛点

1.2 技术演进方向

智能家居的进化路径应当是模仿人类神经系统的发育过程,实现从“条件反射”向“认知决策”的代际跨越

维度 | 传统自动化 (Reflection) | 认知型智能 (Cognition) |

逻辑核心 | 硬编码脚本 (Fixed Logic) | 大模型推理 (LLM Reasoning) |

交互逻辑 | 显式指令 (Explicit Commands) | 意图识别 (Intent Inference) |

感知边界 | 单一传感器触发 | 多模态环境感知 + 历史偏好记忆 |

执行模式 | 静态单步执行 | 动态任务规划 (Task Planning) |

1.3 演示

通过 OpenClaw 与 HomeAssistant 的深度解耦与协同,我实现了以下具备“高级感”的智能交互:

- 自然意图推断

:无需记住设备名称,AI 自动将“光线不好”映射为环境光传感器与灯具组的闭环控制。 - 动态偏好对齐

:系统具备长期记忆能力,能根据不同家庭成员的行为习惯,自动微调空调温度与灯光色温。 - 跨协议 Skill 移植

:通过标准化的 Skill 定义,将复杂的自动化逻辑实现一键跨平台迁移与快速复用。 - 零代码 UI 生态

:利用大模型直接生成符合业务逻辑的控制面板,将开发周期从数天缩短至分钟级。

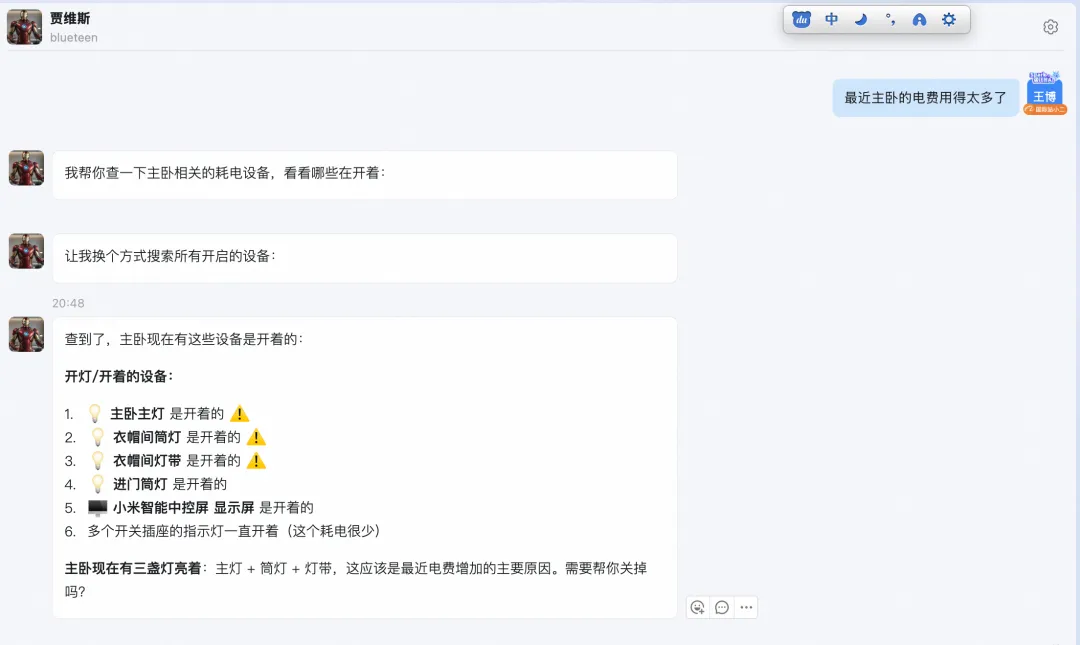

1.3.1 自然语音识别

1.3.2 人喜好记忆

1.3.3 任务智能规划

1.3.4 skill快速移植

skill可以快速移植到Qorderwork,悟空等平台上,配置非常简单

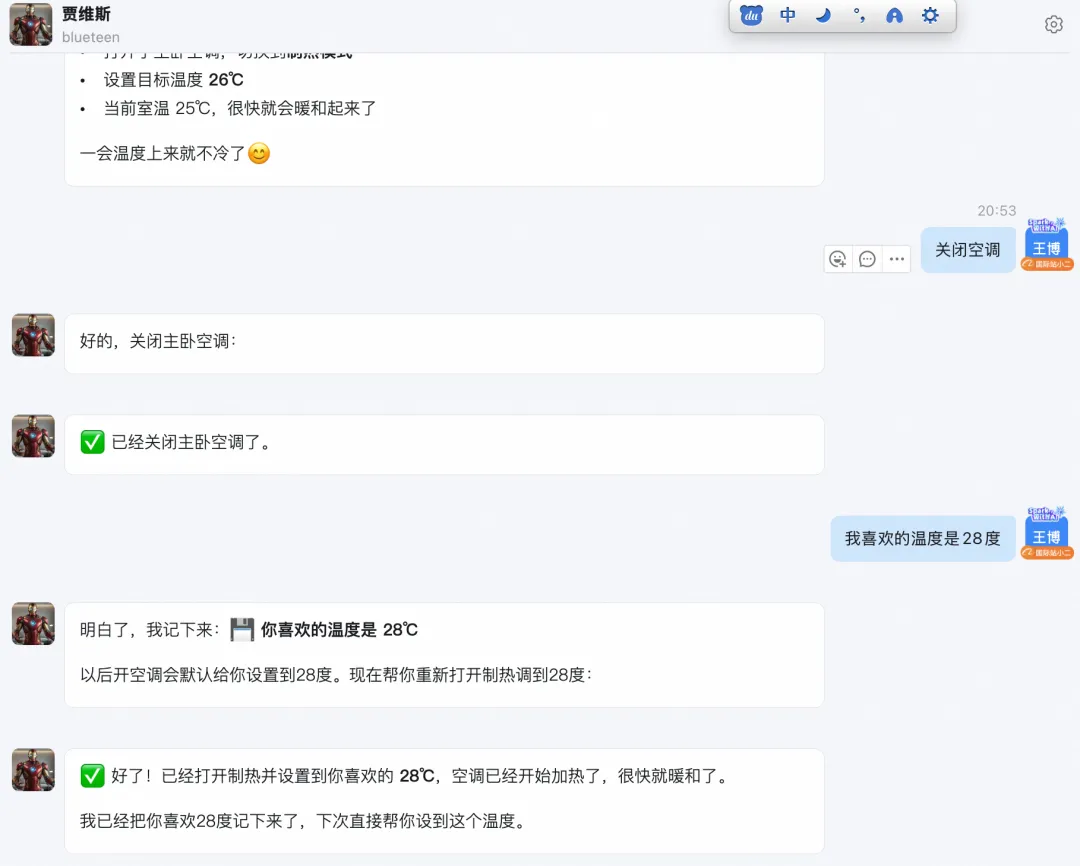

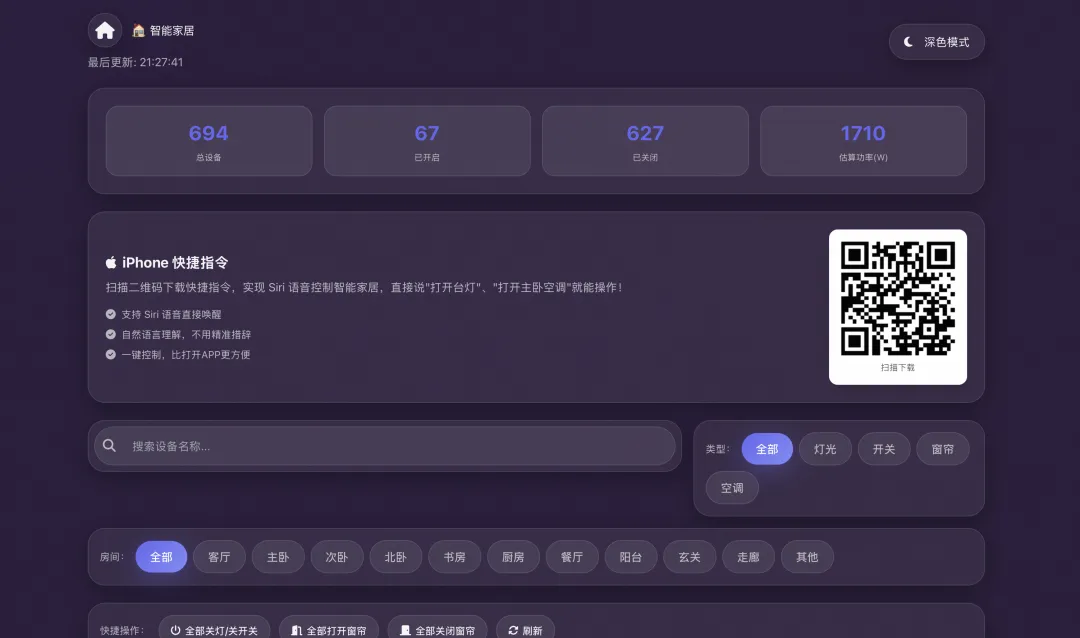

1.3.5 控制面板快速成功

通过大模型快速生成自己的控制面板,零代码开发,10分钟搞定

二、整体架构设计

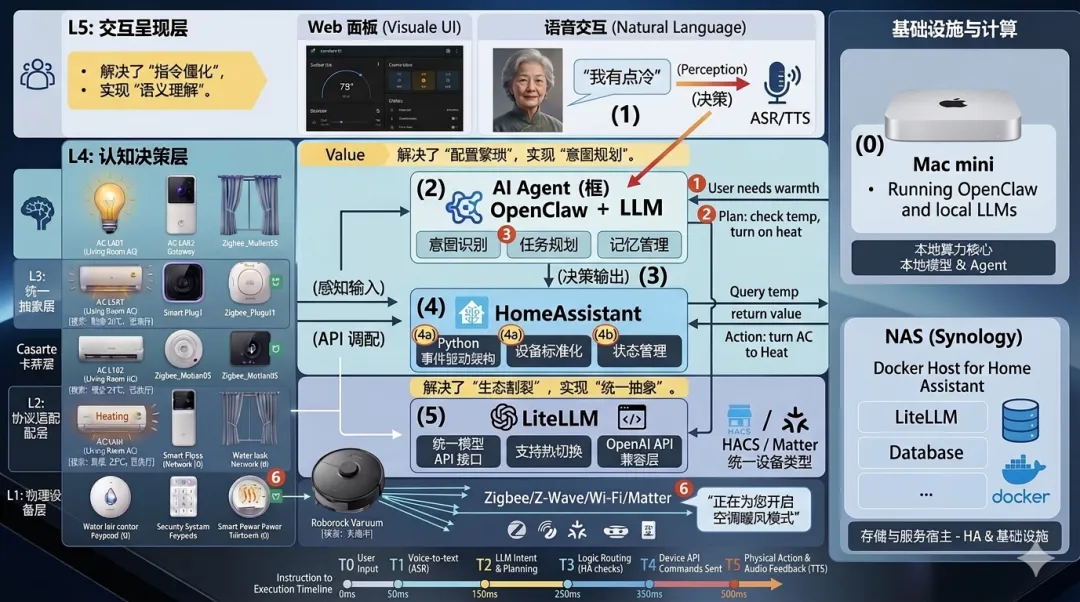

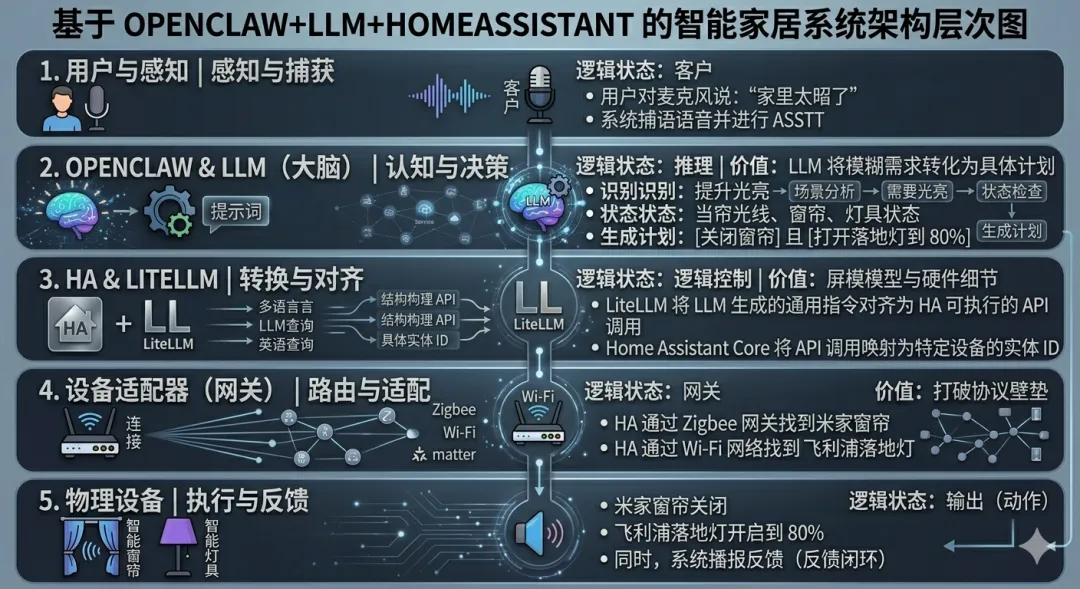

2.1 系统架构图

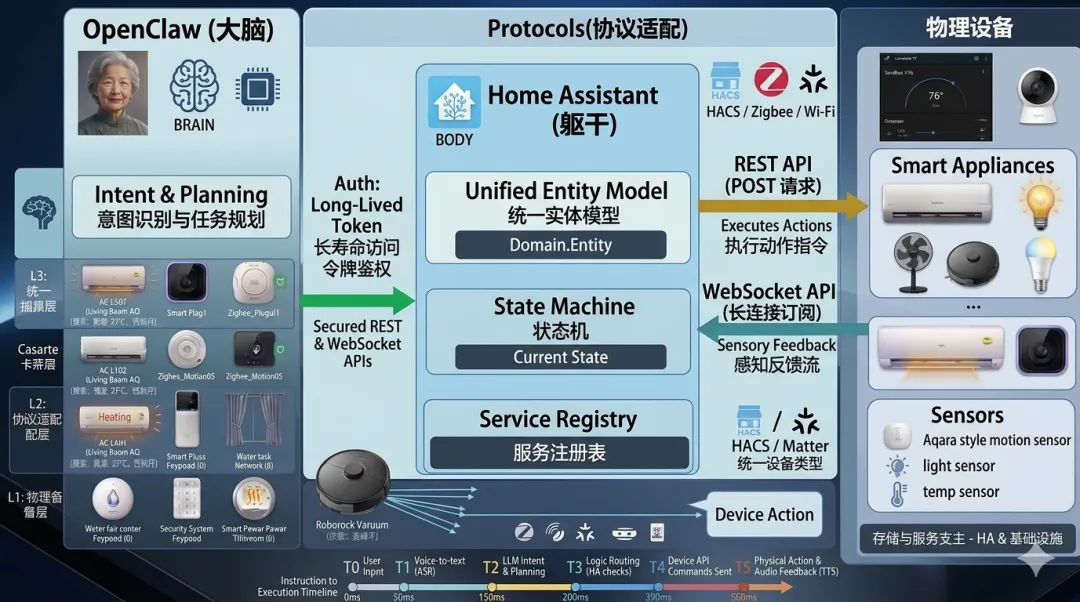

图 1:系统整体架构,展示从物理设备层到 AI 交互层的完整数据流

2.2 核心组件职责

层级 | 核心组件 | 核心功能与价值体现 |

交互感知层 (User Interface) | 语音助手 / 手机 App / 环境传感器 | 价值: 接收非结构化语言(如“我有点冷”)或环境变化信号。 |

认知决策层 (AI Agent) | OpenClaw + LLM (Ollama/GPT) | 核心价值: 意图识别、任务编排。将用户的模糊需求拆解为具体的设备指令序列。 |

逻辑中控层 (Controller) | Home Assistant (Core) | 价值: 统一状态机。管理所有设备的实时状态,执行由 AI 下发的自动化脚本。 |

模型适配层 (Model Gateway) | LiteLLM | 价值: 屏蔽不同 LLM 接口差异,支持本地模型(隐私安全)与云端模型无缝切换。 |

硬件协议层 (Abstraction) | HACS / Matter / Zigbee / Wi-Fi | 价值: 打破品牌壁垒。将米家、Aqara、松下等设备抽象成统一实体。 |

基础设施层 (Infrastructure) | Mac mini / Synology NAS / Docker | 价值: 提供算力支撑。本地化部署保障低延迟与数据隐私。 |

三、核心技术详解

3.1 HomeAssistant:统一生态的基石

3.1.1 为什么选择 HomeAssistant?

HomeAssistant 作为全球领先的开源智能家居平台,是 LLM 介入物理世界的标准化接口层,具备以下优势:

- 极致适配:强大的 HACS 生态将复杂的异构协议(Zigbee, KNX, Bluetooth)统一转化为标准的 Domain.Entity模型,为 LLM 提供了结构化的训练与操作对象。

- 本地优先:所有逻辑本地运行,断网可用,数据隐私可控

- 事件驱动:基于状态机与事件总线的架构,毫秒级的状态更新频率,为 AI Agent 实时感知环境变化(如:光照骤降、人体移动)提供了可靠的数据源。

3.1.2 架构原理:事件驱动的状态机

HomeAssistant 的核心是一个基于 Python 构建的事件驱动型状态机,包含四个关键组件:

- 集成层 (Integrations)

:将不同协议的设备抽象为标准 Entity 对象 - 状态机 (State Machine)

:充当系统的“瞬时意识”,保存全家所有设备的实时快照。 - 事件总线 (Event Bus)

: 采用发布/订阅模式。当传感器触发时,总线产生事件,AI Agent 像“监听器”一样实时捕捉这些信号,无需轮询 - 服务注册表 (Service Registry)

:定义可执行动作的接口

关键技术:OpenClaw 通过 WebSocket 订阅事件总线获取实时状态,通过 REST API 调用服务执行规划后的动作,实现双向通信。

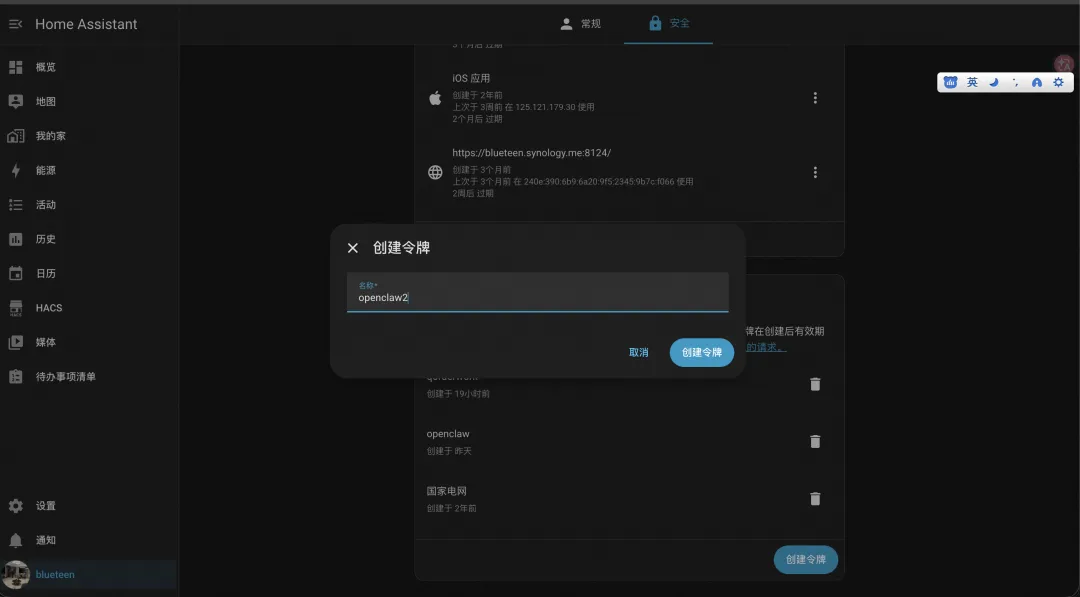

3.1.3 openclaw如何对接homeassistant

两者通过 “认证驱动 + 异步通信” 的方式实现深度融合:

- 身份认证安全:

通过 HA 后台生成的 长寿命访问令牌 (Long-Lived Access Tokens) 进行鉴权。这种令牌具备高强度加密属性,确保 OpenClaw 作为外部 Agent 获取完整的 API 操纵权限,同时通过 HA 的权限管理机制限定 AI 的操作边界。

- 双重通信机制:

- 控制路径 (Control Path):

OpenClaw 利用 REST API 发送 POST 请求。当 LLM 完成任务规划(Planning)后,将指令转化为标准 JSON 负载发送至 HA,实现对硬件的精准控制。 - 感知路径 (Perception Path):

通过 WebSocket API 建立持久化长连接。OpenClaw 订阅全量事件流,当家中任何传感器发生变化,HA 会主动“推送”给 AI,使 AI 具备主动触发(Proactive Service)的能力,而非被动等待指令。

- 语义映射对齐:

OpenClaw 会定期拉取 HA 的实体列表(Entity List),自动将设备的 friendly_name(如“阳台左侧射灯”)与实体 ID(light.balcony_left)进行映射。这意味着用户说“关掉阳台左边的灯”时,AI 能够通过语义搜索直接定位到对应的硬件句柄。

3.1.4 交互的例子

为了清晰展示 OpenClaw (AI Agent) 如何通过接口操纵 Home Assistant (HA) 里的硬件,我们以一个典型的语义场景为例:“我准备睡觉了”

这个过程涉及从“模糊意图”到“精确 API 调用”的转化。

一、意图解析 (LLM 内部处理)

当 OpenClaw 接收到用户的语音,它首先通过 LLM 将其转化为具体的设备指令列表。

- 输入:"我准备睡觉了"

- 规划结果:

关闭卧室大灯 ( light.bedroom_main)开启床头灯并调至 10% 暖色 ( light.bedside_lamp)关闭遮光窗帘 ( cover.bedroom_curtain)

二、具体的 REST API 调用例子

OpenClaw 通过 HTTP POST 请求向 HA 的服务注册表发送指令。以下是其中一个调用的技术细节:

请求 URL:http://<your_ha_ip>:8123/api/services/light/turn_on

请求头 (Header):

HTTP

Authorization: Bearer <你的长寿命访问令牌>Content-Type: application/json请求体 (JSON Payload):

JSON

{ "entity_id": "light.bedside_lamp", "brightness_pct": 10, "rgb_color": [255, 197, 143]}三、 通信全过程流图

- 认证阶段:

OpenClaw 在请求头中携带 Token。HA 验证成功后允许接入。 - 指令下发:

OpenClaw 发送上述 JSON 指令。 - HA 处理:

HA 的 Service Registry 接收到指令,查找 light.bedside_lamp对应的物理协议(如 Zigbee)。 - 硬件执行:

HA 通过网关发送物理信号给床头灯。 - 状态回传:

床头灯执行完毕,HA 的 State Machine 更新状态为“开启/10%”,并通过 WebSocket 实时告知 OpenClaw 指令已成功落地。

3.2 OpenClaw:注入认知能力的 AI 大脑

3.2.1 从自动化到智能化的跃迁

传统自动化系统的局限性:

用户指令:"我有点冷"❌ 传统系统:无法理解模糊意图,需精确指令"开启空调制热 26 度"✅ AI 系统:理解意图 → 查询温度传感器 → 判断低于阈值 → 开启空调 → 设定 26 度3.2.2 OpenClaw 的核心能力

能力 | 说明 | 示例 |

语义理解与泛化 | 将自然语言转化为可执行的逻辑链 | "太黑了" → 开灯 |

动态任务规划 | 根据环境状态调整策略 | 窗户开着 → 先关窗再开空调 |

记忆与演化 | 记住用户偏好并自我优化 | 上次 24 度嫌冷 → 这次自动设 26 度 |

核心价值:如果说 HomeAssistant 是"神经系统",负责传递信号和控制肌肉;那么 OpenClaw 就是"大脑",负责理解语言、推理因果、规划任务。

3.3 本地部署大模型:Ollama + Mac mini

openclaw 可以接入不同的模型,考虑到家居的响应效率与体验,本地部署的RT要优于云端API。

3.3.1 技术选型依据

考量维度 | 云端 API | 本地部署 |

响应延迟 | 200-500ms | 50-100ms(局域网) |

数据隐私 | 数据出户 | 完全本地 |

使用成本 | $0.002-0.01/次 | 一次性硬件投入 |

可用性 | 依赖网络 | 断网可用 |

3.3.2 部署步骤(Mac mini M1/M2/M3)

# 1. 安装 Ollamabrew install ollama# 2. 启动服务ollama serve# 3. 部署模型(推荐 Qwen3.5 系列)# M4 16GB 配置:主力模型 Qwen3.5-4B,备用模型 Qwen3.5-2Bollama pull qwen3.5:4b# 4. 验证接口curl http://localhost:11434/api/generate -d '{ "model": "qwen3.5:4b", "prompt": "Hello"}'性能参考:Qwen3.5-4B 在 M4 芯片上响应时间 1-2 秒,内存占用约 3.5GB,支持 256K 上下文。

3.3.3 局域网访问配置

Ollama 默认仅监听本地回环地址,如需局域网访问:

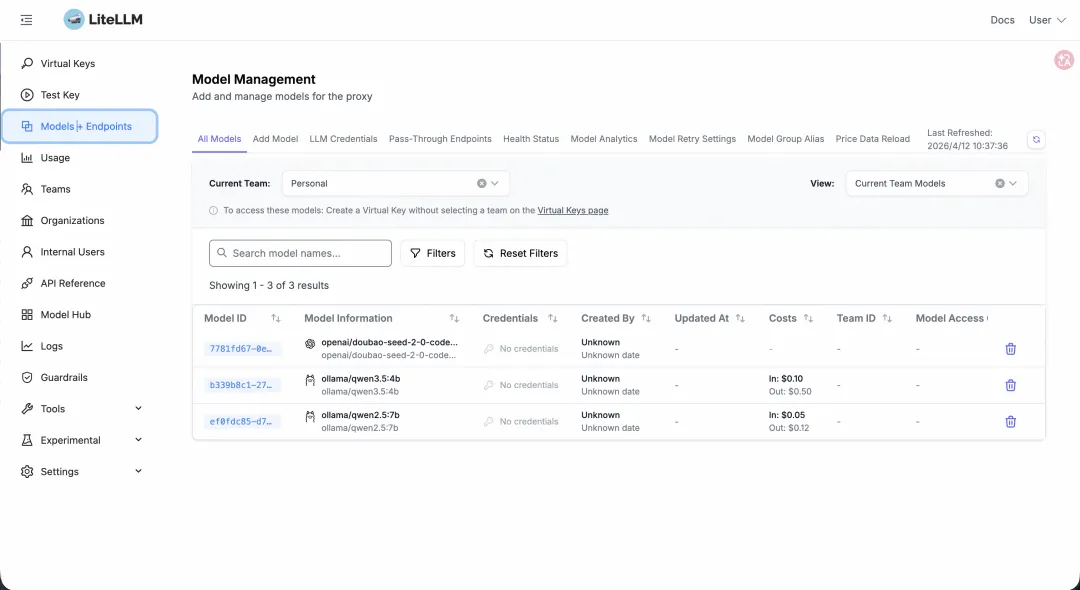

# 设置环境变量launchctl setenv OLLAMA_HOST "0.0.0.0:11434"# 重启服务brew services restart ollama3.4 LiteLLM:协议标准化的智能网关

3.4.1 解决的核心问题

核心维度 | 技术特性 | 业务价值 |

协议解耦 | 统一 API 标准化:将 Ollama、Azure、Anthropic 等异构接口封装为标准 OpenAI 格式 | 开发零成本:后端模型更替无需修改 OpenClaw 业务逻辑,实现插件式切换。 |

混合架构 | 自动故障转移 (Failover):本地模型异常或超时时,自动触发云端高参数模型补位 | 系统高可用:彻底解决本地算力波动带来的“智障”瞬间,保障 99.9% 的响应率。 |

动态路由 | 按需分配 (Smart Routing):简单指令走轻量本地模型,复杂逻辑自动上云 | 成本与性能平衡:极大地降低 Token 消耗成本,同时保证复杂任务的推理成功率。 |

全链路监控 | 多维可观测性 (Observability):实时监测 Token 消耗、延迟(Latency)与调用链路 | 性能调优依据:通过 4015 端口可视化面板,精准定位 AI 响应缓慢的“病灶”。 |

http://<YOUR_IP>:4015/ui/?login=success&page=logs

3.4.2 配置示例

# config.yamlmodel_list: - model_name: "home-brain" litellm_params: model: "ollama/qwen3.5:4b" api_base: "http://localhost:11434" - model_name: "home-brain-backup" litellm_params: model: "azure/gpt-4" api_key: os.environ/AZURE_KEY3.4.3 部署命令

docker run -p 4000:4000 ghcr.io/berriai/litellm:main \ --config /app/config.yaml收益:OpenClaw 只需对接 http://localhost:4000,底层模型可随意热切换,无需修改业务代码。

3.5 LLM 生码定制控制面板

3.5.1 操作流程

- 收集上下文在 HA 开发者工具中复制实体 ID 列表

- Prompt 工程:

- 部署应用:进入 HA 仪表盘 → 编辑 → 添加卡片 → 手动 → 粘贴 YAML 代码

3.5.2 进阶用法

将此流程写入 OpenClaw Skill,实现对话式面板生成:

用户:"帮我做一个卧室控制面板"AI → 生成 YAML → 自动部署 → 返回预览链接四、Skill 封装与一键部署

4.1 OpenClaw Skill 定义

Skill 是 OpenClaw 识别设备能力与交互逻辑的描述文件,内置记忆机制:

name: homeassistant-dashboard description: 一套从"设备连接"到"智能规划"的智能家居进化方案 —— 通过 HomeAssistant 统一异构硬件生态,利用大语言模型的推理与规划能力,打造具备语义理解、动态记忆与自主规划能力的家庭智能中枢。开箱即用,一键启动可视化控制面板。 author: openclaw version: 1.0.0 category: smart-home tags: ["homeassistant", "dashboard", "smart-home", "voice-control", "natural-language"] license: MITHomeAssistant 智能家居控制面板 Skill简介你是否已经用 HomeAssistant 接入了各种品牌的智能设备,但还在烦恼:❌ 缺乏一个美观现代化的控制面板,手机APP操作繁琐❌ 每次控制都需要点来点去,不能直接说"我想看电影"自动执行❌ 不同设备分散在不同页面,想要找某个设备还要翻半天❌ 想要查询室温功率,还要打开多个页面才能看到这个 skill 帮你一次性解决所有问题!✅ 现代玻璃拟态设计 —— 简约高级,深浅主题自动适配✅ 自然语言直接控制 —— 说"客厅光线太强"自动关客厅灯,说"我想看电影"自动关全屋灯✅ 三级精准筛选 —— 搜索 + 类型筛选 + 房间筛选,一秒找到设备✅ 环境信息一键查询 —— "客厅温度多少"同时得到温度/湿度/功率✅ 一键批量操作 —— 全开全关,省事省心✅ 原生 Node.js 反向代理 —— 解决跨域,零依赖,开箱即用让你的智能家居从"能连接"进化到"真智能"。功能特点🎨 现代设计:玻璃拟态风格,深浅双主题自动适配,手机电脑都好看💬 自然语言理解:支持语义推断,不用精准措辞,AI懂你想要什么🔍 三级筛选:搜索 + 设备类型 + 房间,快速定位设备🌡️ 环境查询:查询房间同时得到温度、湿度、功率统计📊 实时统计:顶栏显示总设备、开启数、估算总功率🪑 房间分组:按中文名称自动分组,可折叠,界面干净⚡ 一键操作:全开全关快捷按钮,省心省力🔄 自动刷新:每 30 秒自动更新状态,不用手动刷新📱 响应式布局:手机、平板、电脑完美适配🚀 零依赖:原生 Node.js,不需要 npm 装任何包支持的智能场景你说 AI 理解 自动执行打开客厅主灯 打开客厅主灯 ✅ 执行关闭所有窗帘 关闭全部窗帘 ✅ 批量执行客厅光线太强 太亮需要关灯 → 关闭客厅所有灯 ✅ 智能推断我想看电影 看电影需要关灯 → 关闭全屋所有灯 ✅ 智能推断客厅温度多少 查询客厅环境 → 返回温度/湿度/功率 ✅ 查询客厅功率多少 查询客厅统计 → 返回设备数/总功率/温度湿度 ✅ 查询安装使用一键安装# 下载skill后cd homeassistant-dashboard./scripts/start.sh http://<你的HA地址>:<端口> <你的长期访问令牌> [服务端口]示例:./scripts/start.sh http://<YOUR_IP>:8123 eyJhbGciOiJXXXIJSK5cCI6IkpXVCJ9... 8082就这么简单!自动完成:复制模板文件到当前目录自动替换你的 HA 地址和令牌杀掉旧进程启动后台服务输出访问地址访问控制面板启动完成后,直接打开输出的地址就能用了,例如: http://<YOUR_IP>:8082/smart-home-dashboard.html不需要登录,直接控制。技术原理颜色主题修复经验问题:浅色模式下标题看不清 → 因为硬编码了固定颜色,没有使用 CSS 变量深色模式下body背景不对 → 因为硬编码了 bg-gray-100修复方法:使用 :root 和 [data-theme="light"] 分别定义两套 CSS 变量所有标题颜色强制使用 color: var(--text-primary)body 背景改用 background: var(--bg-primary) 而不是固定 class跨域问题解决问题:直接从静态网页访问 HomeAssistant API 会遇到跨域问题 解决方法:启动一个 Node.js 静态文件 + API 反向代理服务所有 /api/* 请求代理转发到 HomeAssistant正确添加 CORS 头,允许跨域访问不依赖任何第三方 npm 模块,原生即可运行高级功能自然语言指令控制面板内置大语言模型级别的自然语言理解能力:直接控制:打开客厅主灯 → 自动找到并打开关闭所有窗帘 → 批量关闭客厅光线太强 → 智能推断:关闭客厅所有灯我想看电影 → 智能推断:关闭全屋所有灯查询信息:客厅功率多少 → 返回:设备数 + 总功率 + 温度 + 湿度客厅温度多少 → 返回客厅温度 + 湿度 + 功率当前室温 → 返回全屋温度统计智能推断规则:太亮/光线强/太强 → 推断为关灯看电影/观影 → 推断为关灯自动提取房间名称,只操作/查询指定房间自动识别温度/功率查询,返回完整环境信息筛选能力三级筛选组合,一秒找到设备:搜索 - 按设备名称模糊搜索类型筛选 - 只看灯光/开关/窗帘/空调/传感器房间筛选 - 只看指定房间可以组合使用,精准定位。其他便捷功能统计栏:显示总设备数/已开启/已关闭/估算总功率房间可折叠:不用的房间收起来,界面更干净一键快捷操作:全部关灯、全部开窗帘、全部关窗帘、刷新自动 30 秒刷新状态,保持最新项目结构homeassistant-dashboard/├── SKILL.md # 本文档├── assets/│ └── smart-home-dashboard.html # HTML 控制面板模板└── scripts/ ├── start.sh # 一键启动脚本 └── server-8082.js # Node.js 反向代理服务系统要求Node.js >= 14 (只要有 node 就能运行,不需要 npm)bash 环境可访问的 HomeAssistant 实例长期访问令牌(从 HomeAssistant 个人设置获取)说明开箱即用的 HomeAssistant 智能家居控制面板,让你的家庭智能中枢真正"聪明"起来。一句话: 原来控制智能家居可以这么简单。4.2 Docker Compose 一键部署

4.2.1 编排配置

version: '3'services: # OpenClaw 智能大脑 openclaw: image: xiaolong/openclaw:latest environment: - LLM_API_BASE=http://litellm:4000/v1 - HA_TOKEN=${HA_LONG_LIVED_TOKEN} - HA_URL=http://homeassistant:8123 volumes: - ./skills:/app/skills - ./memory:/app/memory depends_on: - litellm # LiteLLM 协议网关 litellm: image: ghcr.io/berriai/litellm:main command: --config /app/config.yaml volumes: - ./litellm_config.yaml:/app/config.yaml # Ollama 本地模型 ollama: image: ollama/ollama volumes: - ollama_data:/root/.ollama ports: - "11434:11434" # HomeAssistant homeassistant: image: homeassistant/home-assistant:stable network_mode: host volumes: - ./ha_config:/configvolumes: ollama_data:4.2.2 部署效果

# 一键启动docker compose up -d# 查看日志docker compose logs -f openclaw跨平台兼容:该配置可在群晖 NAS、树莓派、Mac mini 等任何支持 Docker 的平台复现。

五、AI 任务规划流程

图 2:从用户指令到设备执行的完整规划流程

5.1 典型场景解析

场景:用户说"我要睡觉了"

步骤 | AI 思考过程 | 执行动作 |

1. 意图识别 | 用户准备休息,需要执行睡前场景 | - |

2. 状态查询 | 查询窗户、灯光、空调、窗帘状态 |

|

3. 策略规划 | 检测到窗户开着 → 应先关窗 |

|

4. 安全校验 | 燃气阀状态检查(高危操作需确认) |

|

5. 顺序执行 | 按依赖关系依次执行 | 关灯→关窗帘→设空调→设闹钟 |

六、常见误区与避坑指南

误区 | 正确认知 | 解决方案 |

模型越大越好 | 本地部署需平衡速度与显存,7B 级模型足以处理家居指令 | 优先测试 Qwen3.5-4B,复杂推理失败时切换大模型 |

AI 直接控制硬件 | AI 存在幻觉,直接控制危险设备风险极大 | Skill 中设置"高危操作二次确认"机制 |

网络隔离导致不通 | Docker 容器间网络默认隔离 | 使用 Docker Compose 定义同一网络,或 |

忽略记忆持久化 | 容器重启后记忆丢失 | 务必将 |

七、性能优化建议

7.1 响应速度优化

优化点 | 措施 | 预期提升 |

模型选择 | 使用 Qwen3.5-4B 替代 7B+ 模型 | 延迟降低 50% |

关闭思考模式 | OpenClaw 配置中设置 | 延迟降低 30% |

模型预加载 | 定时任务保持模型驻留内存 | 冷启动延迟消除 |

八、总结与展望

8.1 技术价值总结

本方案实现了六个关键技术突破:

- HomeAssistant:提供坚实的硬件抽象层,打破生态壁垒

- OpenClaw:赋予系统语义理解与任务规划能力

- Ollama + Mac mini:低成本、高隐私的本地算力支撑

- LiteLLM:屏蔽模型差异,实现灵活扩展

- LLM 生码:界面定制像对话一样简单

- Skill 容器化:先进架构可一键复制

8.2 未来探索方向:迈向高度自治的具身智能

- 多模态交互:从“对话交互”到“全感知无感应答”

超越单一的语音链路,引入视觉大模型 (VLM) 赋予系统“察言观色”的能力。通过实时环境语义分析,系统可识别复杂的手势指令或捕捉用户的疲惫神态,从而自动调暗灯光并启静谧模式,实现从被动响应向主动服务的跨越。 - 具身智能与空间拓扑:从“操作设备”到“逻辑接管空间”

利用 SLAM(即时定位与地图构建) 技术将家庭物理平面图转化为 Agent 的先验空间知识。AI 将不再仅仅依赖设备名称,而是深度理解“人-物-场”的空间拓扑关系(例如:识别“打开我背后那盏灯”中的相对方位),通过空间语义对齐实现对物理环境的精准接管。 - 自主技能进化:实现系统功能的“自我生长”

利用 LLM 的原生生码能力(Code Generation),赋予系统自我修复与动态扩容的特性。当检测到新硬件接入或接收到复杂的长尾需求时,AI Agent 能够自主完成 Skill 容器的编写、测试与封装。这种“代码即技能”的闭环,使得系统能够在物理世界中不断演化,保持架构的长期生命力。

夜雨聆风

夜雨聆风