为什么要折腾 OpenClaw?

作为一名技术爱好者,你是不是早就想在自己的 Mac 上部署一个开源 AI 框架,既能本地跑模型,又能自由定制功能?

OpenClaw(江湖人称 “龙虾”)就是这样一个宝藏工具:开源、轻量、支持多模型接入,不管是接通义千问、豆包,还是本地 Ollama 模型,都能一键搞定。

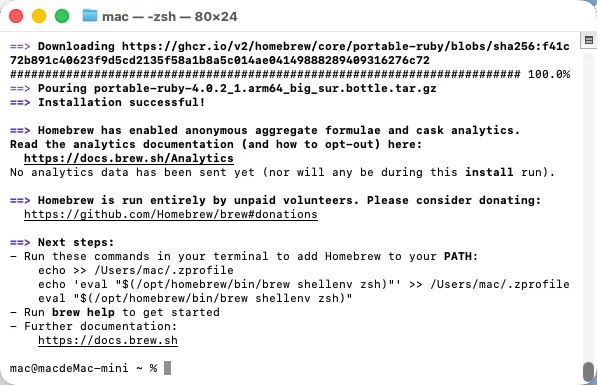

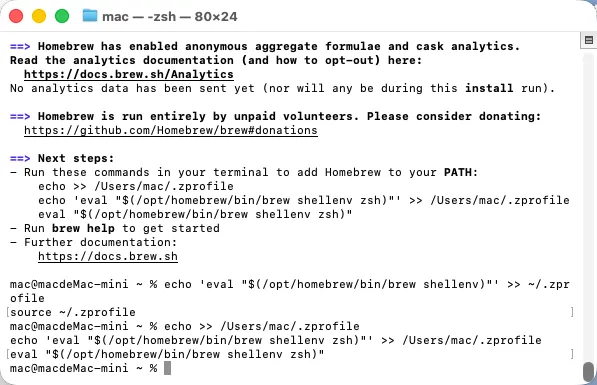

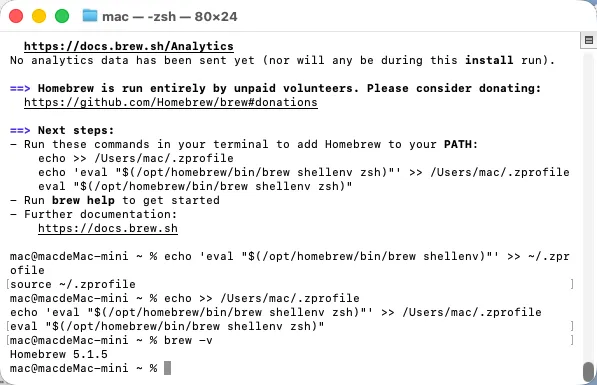

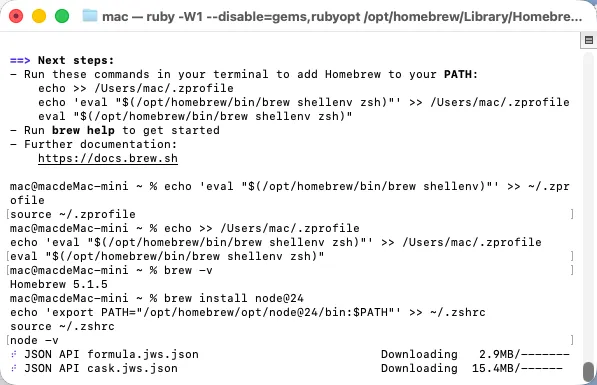

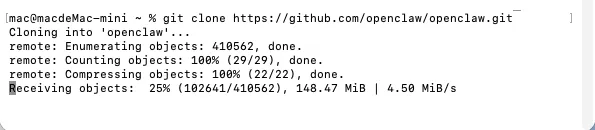

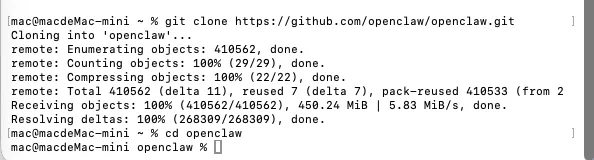

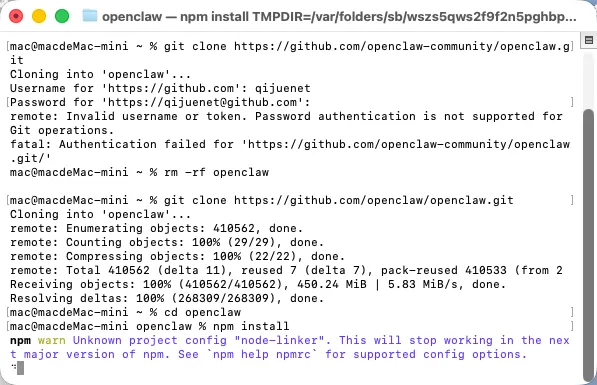

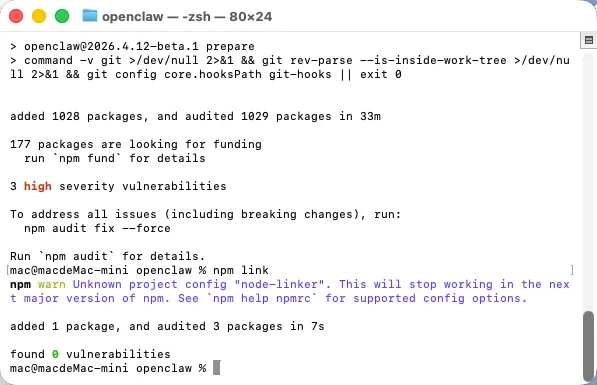

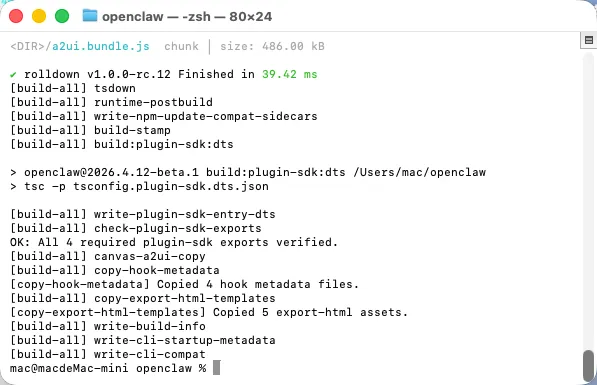

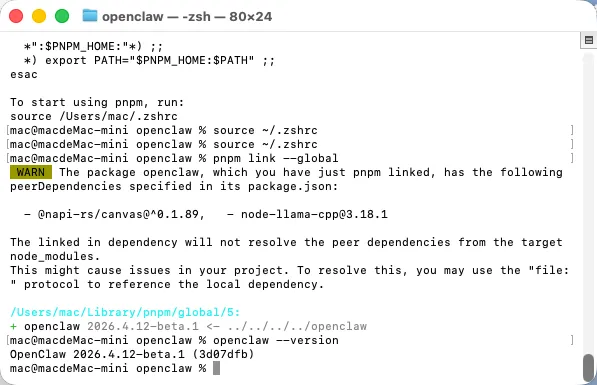

今天这篇,我把自己在 Mac mini(macOS 26.4.1) 上从 0 到 1 部署 OpenClaw 的全流程过一遍

一、📋 前置准备:先确认你的设备条件

- 设备

:Mac mini(Intel / Apple Silicon 通用,本文以 M 系列芯片为例) - 系统

:macOS 12+(本文实测 macOS 26.4.1 完美兼容) - 权限

:管理员账户(必须,否则 sudo 命令无法执行) - 网络

:可能需要那啥 - 存储

:≥ 2GB 可用空间(OpenClaw 本身非常轻量)

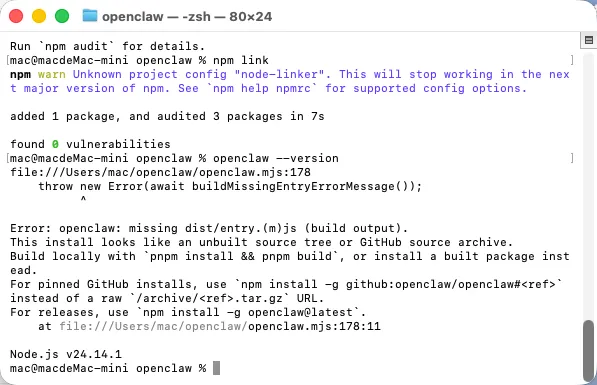

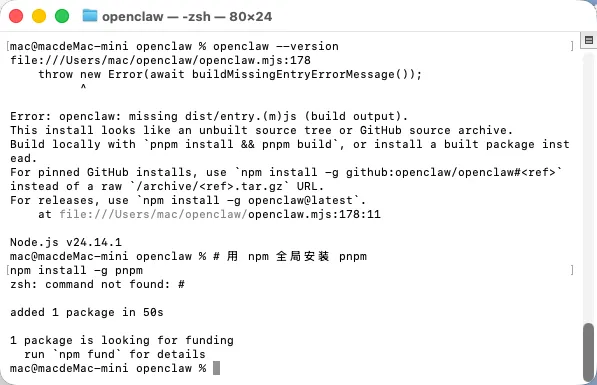

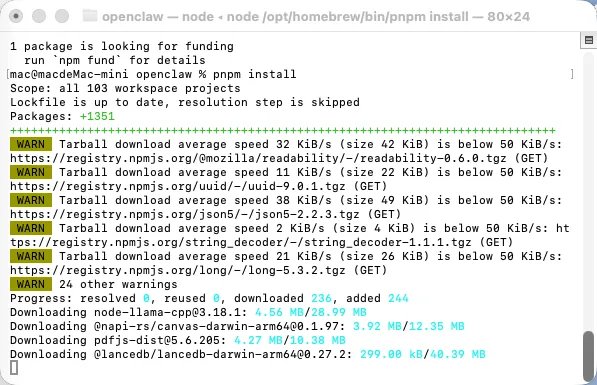

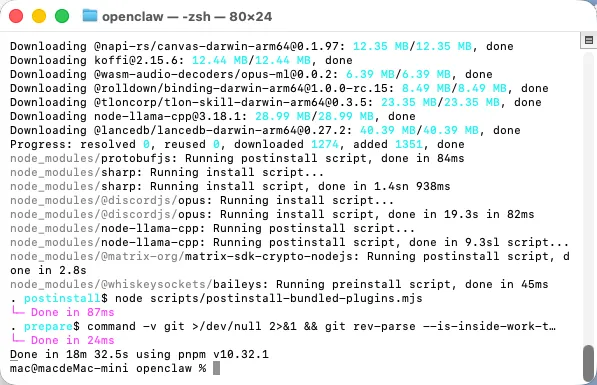

dist/entry.js 缺失那么 用 npm 全局安装 pnpmnpminstall-gpnpm

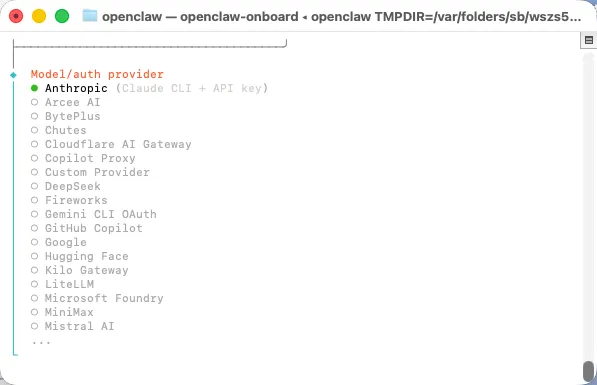

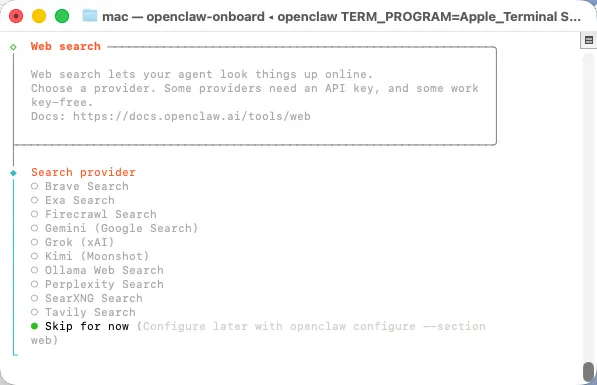

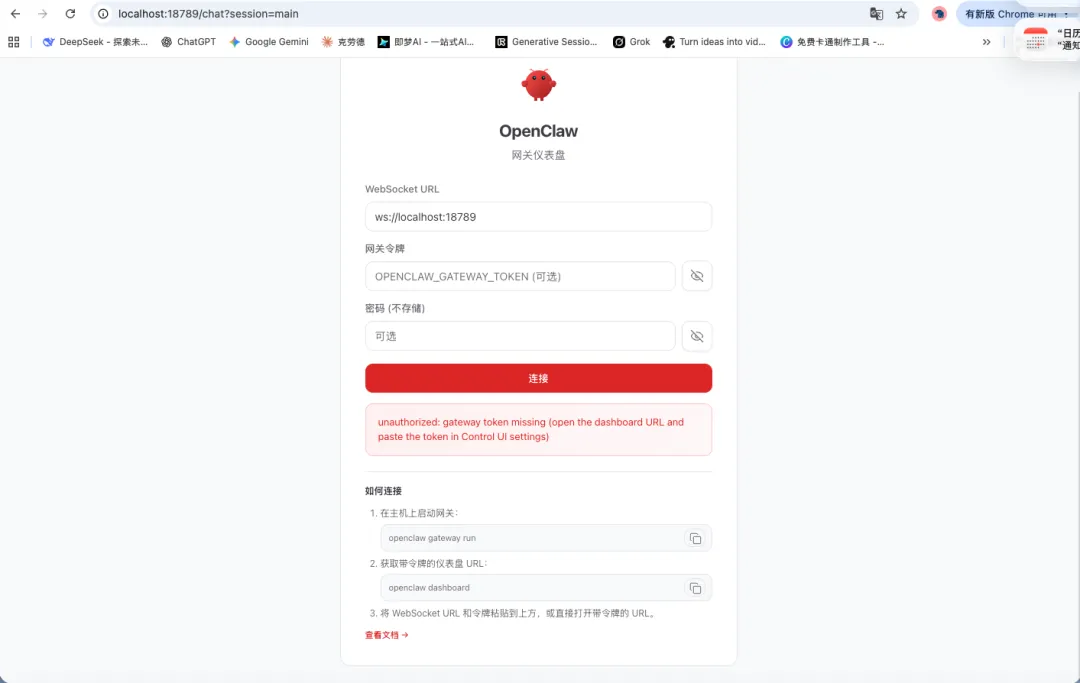

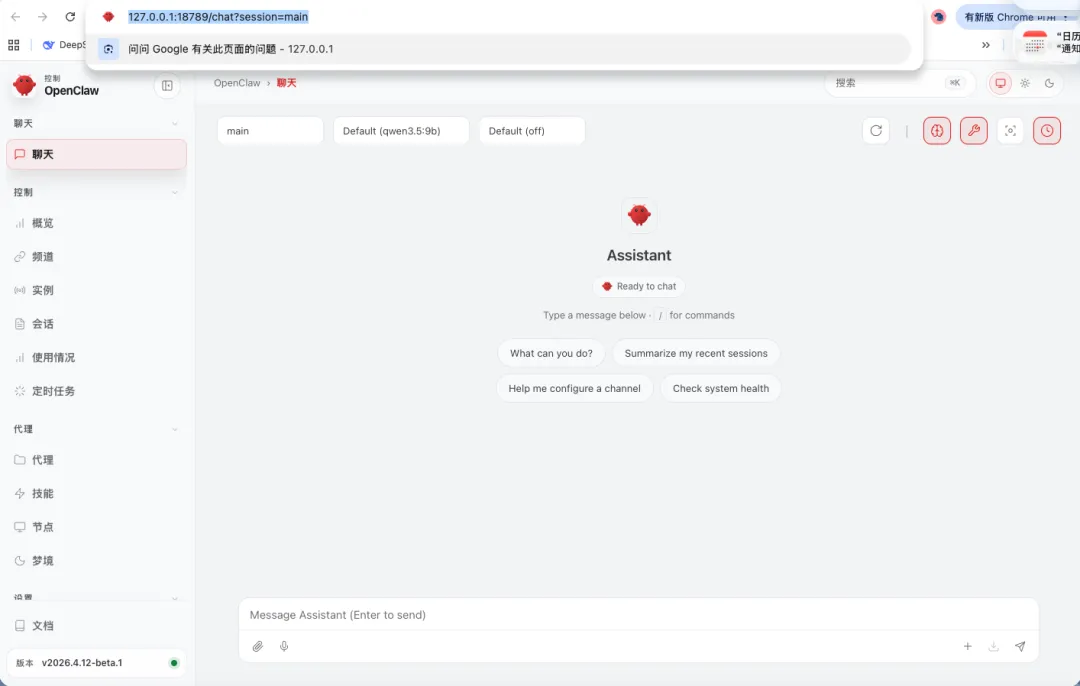

这是 OpenClaw 初始化的核心配置页,用来选择你要对接的 AI 大模型服务商,先给你拆解清楚,再给你直接可用的操作方案👇

✅ 界面说明

绿色选中的 Anthropic是默认选项(Claude 系列模型)列表里包含了国内外主流的 AI 服务商,比如 DeepSeek、BytePlus(字节豆包)、MiniMax等用方向键上下移动选择,回车确认,后续会引导你填入对应的 API Key

🚀 国内用户首选方案(直接能用)

1. 选 DeepSeek(深度求索)

优势:国内可直接注册,免费额度高,API 稳定,模型能力强 操作:方向键选中 DeepSeek,回车,按提示填入你的 DeepSeek API Key 即可

2. 选 BytePlus(字节豆包)

优势:国内用户熟悉,豆包模型免费,适合日常使用 操作:选中 BytePlus,回车,填入豆包的 API Key(火山引擎控制台获取)

3. 选 Custom Provider(自定义)

优势:可以对接本地 Ollama 模型,完全离线,不用 API Key 操作:选中 Custom Provider,配置 Ollama 的本地地址(默认http://localhost:11434),就能用本地大模型

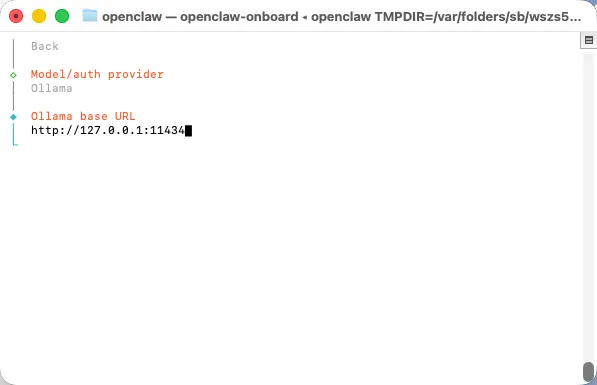

💡 操作步骤(以我这里是要接本地ollama所以以ollama为例)

用方向键向下移动,选中 ollama回车

浏览器访问 http://localhost:3000,就能正常使用 OpenClaw 了

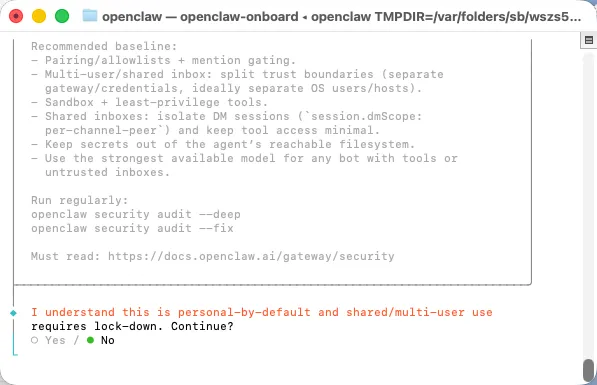

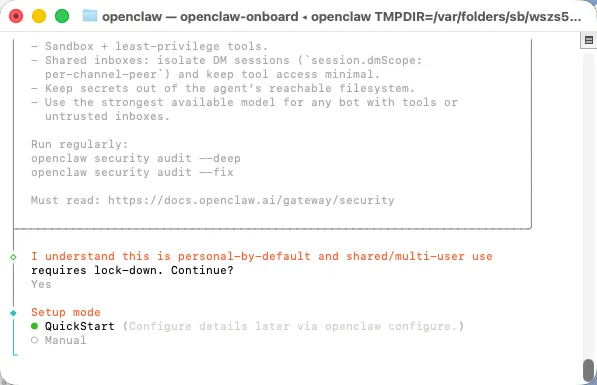

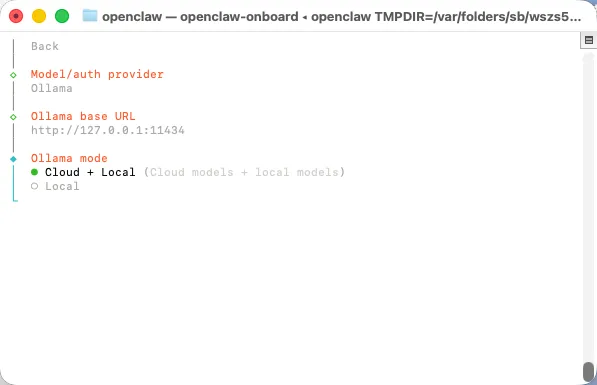

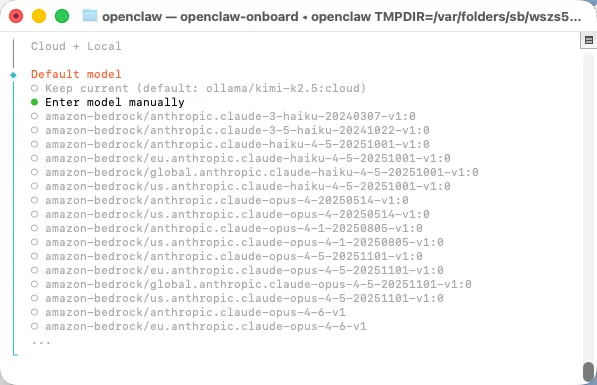

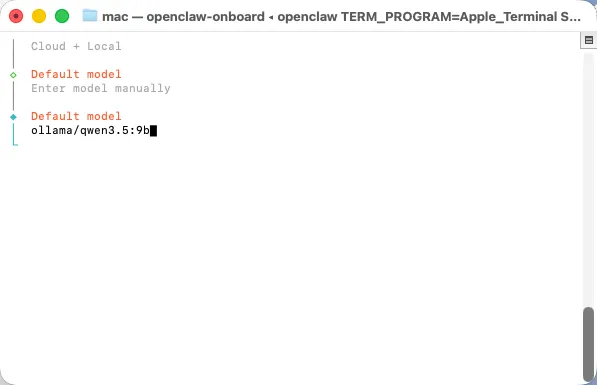

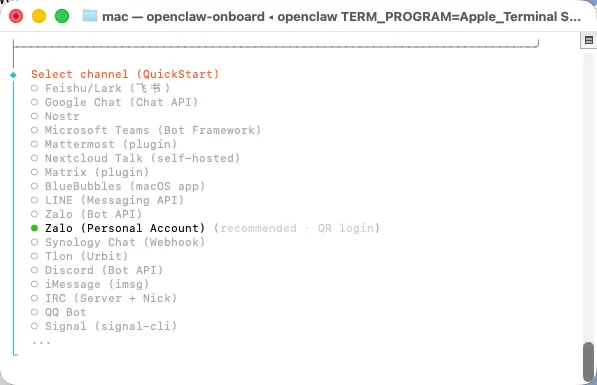

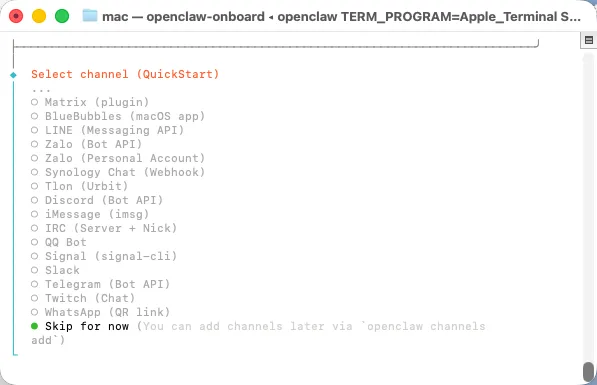

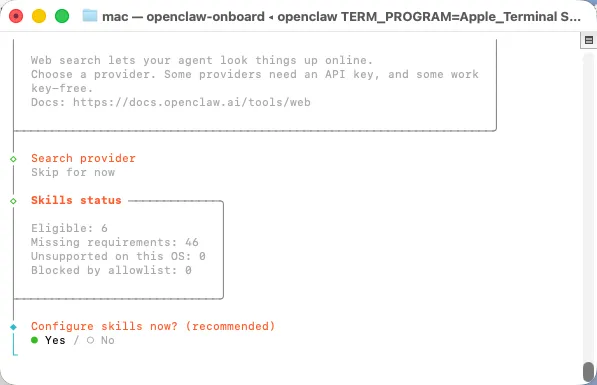

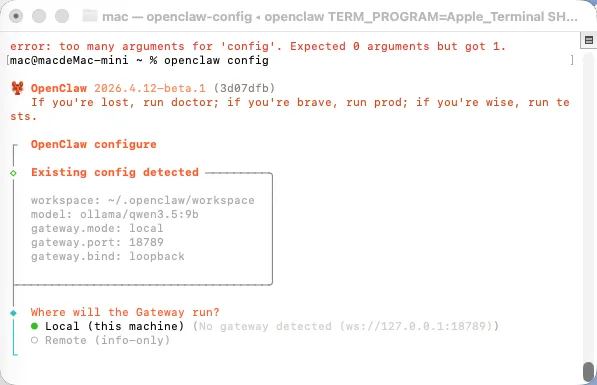

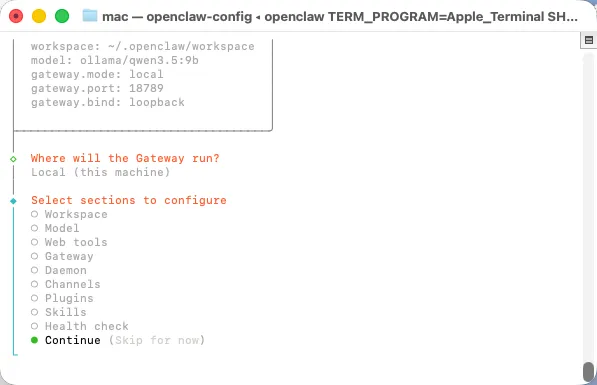

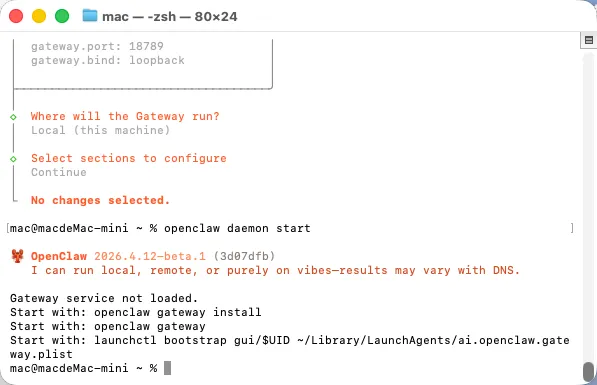

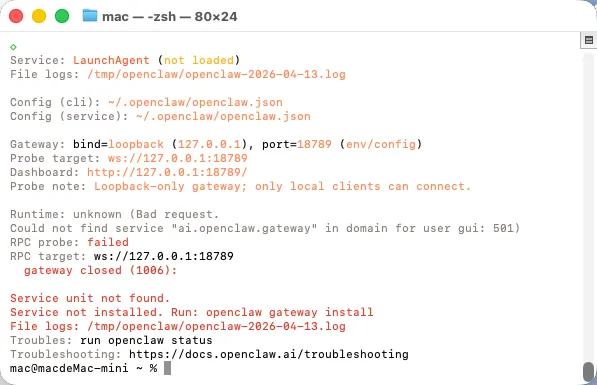

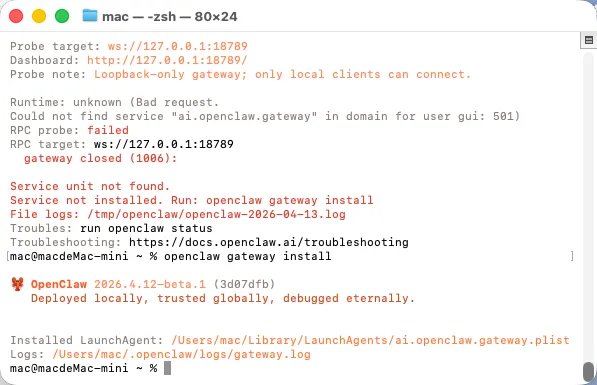

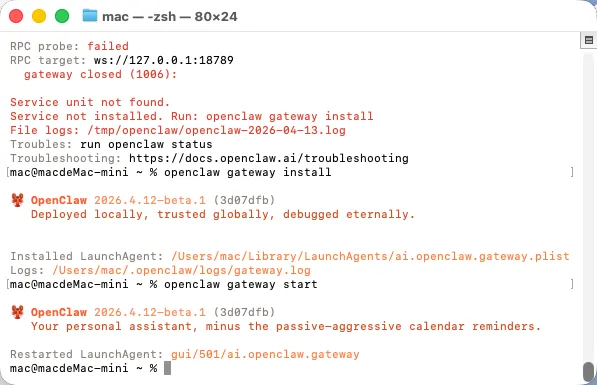

安全确认选 Yes安装模式选 QuickStart模型提供商选 Ollama地址保持默认 http://127.0.0.1:11434,回车模式选 Cloud + Local,回车登录确认选 No(纯本地用不上)默认模型选 Enter model manually,输入你的本地模型(比如llama3.2)

Continue按回车键确认

夜雨聆风

夜雨聆风