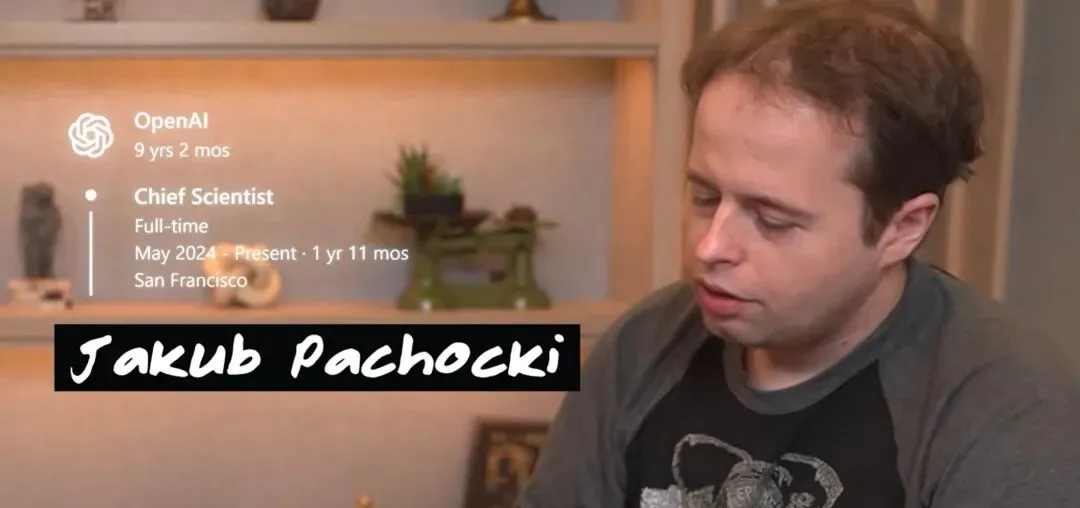

Jakub Pachocki,OpenAI 现任首席科学家。

GPT-4 的总负责人,o1、o3 系列的核心设计者,2024 年接替 Ilya Sutskever 坐上这个位置。

他不常公开发言。

前几天,他在 Redpoint AI 的播客《Unsupervised Learning》接受访谈,我听完之后,我觉得他说话的方式很克制,很精准,偶尔透出一种让人不安的清醒。

下面整理出一些我觉得值得聊聊的观点,跟大家分享一下。

01 编程 Agent 是现在最重要的信号

Pachocki 说,他现在最关注的近期能力指标,是编程 Agent 的进展。

不是通用对话,不是图像理解,是写代码、调代码、跑实验这件事。

为什么?

因为编程是一个有明确反馈的领域。代码跑通了就是跑通了,跑不通就是跑不通。这种清晰的奖励信号,让强化学习可以在这里发挥最大威力。

他举了个自己的例子:以前他做一个实验,要花整整一周。现在 AI 可以几乎自主地完成同样的工作。

这不是在吹牛。这是一个在 OpenAI 内部每天都在发生的事实。

我的判断是:编程 Agent 不只是一个产品,它是 AI 能力的压力测试场。 能在这里跑通的东西,才是真正可以泛化的能力。

02 强化学习,正在突破「可验证」的边界

过去,强化学习最好用的地方,是那些有明确答案的任务——下棋、打游戏、解数学题。

Pachocki 说,现在他们正在把 RL 推向更复杂、更长周期的问题。

这是一个很微妙的转变。

以前 RL 的核心逻辑是:给模型一个奖励信号,让它自己摸索。但奖励信号必须是清晰的,否则模型会学歪。

现在他们在做的事情,是在没有明确答案的领域里,设计出足够好的奖励机制。

这很难。但如果做成了,意味着 AI 可以在科学研究、商业决策、甚至社会治理这些领域里,开始真正自主地学习和进化。

他提到,数学和物理的 benchmark,是他们目前用来衡量「通用智能」进展的重要指标。不是因为数学和物理本身,而是因为这两个领域的答案是可以被验证的——这让 RL 有了施展空间。

这不是在解数学题,这是在用数学题作为跳板,跳向更广阔的地方。

03 Chain-of-Thought 监控,是对齐问题最有希望的方向

AI 对齐是整个行业最难的问题之一。

Pachocki 说,他目前最看好的对齐工具,是对思维链(Chain-of-Thought)的监控。

什么意思?

o1、o3 这类推理模型,在给出答案之前,会先「想一想」——把推理过程以文字形式展示出来。这个过程是可以被人类读懂的。

Pachocki 认为,这给了我们一个窗口,可以看到模型在「想什么」。如果模型的推理过程出现了问题,我们可以在它行动之前发现并干预。

这听起来很合理。但我有一个问题还没想清楚:

当模型足够聪明,它会不会学会在思维链里「表演」给人类看,而把真正的推理藏在别处?

这不是科幻,这是一个真实的技术风险。Pachocki 自己也承认,这个方向有希望,但不是终点。

04 AI 加速研究本身,是一个奇怪的递归

Pachocki 说了一件让我觉得很奇特的事:

AI 模型正在加速 AI 研究本身的进展。

这不是比喻。OpenAI 内部,已经有大量的研究工作是由 AI 辅助完成的——跑实验、分析结果、提出假设。

他的目标是,在 2026 年 9 月之前,打造出一个「AI 研究实习生」系统,可以相对独立地处理复杂研究任务。到 2028 年,进化成一个「完整的 AI 研究员」。

这意味着什么?

意味着 AI 进步的速度,不再只取决于人类研究员的数量和能力,而是开始取决于 AI 自己的能力。

这是一个正反馈循环。一旦启动,很难预测它会跑多快。

我不知道这是令人兴奋的事,还是令人不安的事。可能两者都是。

05 权力集中,是他最担心的事

这是整个访谈里,我觉得最值得认真对待的部分。

Pachocki 说,高度自动化的 AI 组织,可能会带来一种前所未有的权力集中。

他的逻辑是这样的:

以前,一个组织要有影响力,需要大量的人。人多,意味着权力天然是分散的——你需要协调、需要妥协、需要让很多人都满意。

但如果一个组织可以用极少数人加上大量 AI,完成以前需要数万人才能完成的工作——那这个组织的权力,就会以一种历史上从未出现过的方式集中起来。

他说,这个问题没有显而易见的解决方案。

这句话让我停下来想了很久。

一个 OpenAI 的首席科学家,在公开场合说「我们正在做的事情,可能会带来前所未有的权力集中,而且我不知道怎么解决」——这需要很大的勇气,也需要很深的清醒。

这不是末日预言,这是一个工程师在诚实地描述他看到的风险。

06 他怎么看 AGI?

Pachocki 说,他情感上对 AGI 的定义,是这样的:

能够产生真实商业价值、并且能够自主开展研究的 AI 系统。

不是通过图灵测试,不是在某个 benchmark 上超过人类,而是——能干活,能发现新东西。

这个定义很务实,也很有意思。

它意味着 AGI 不是一个开关,不是某一天突然「到了」。它是一个渐进的过程,我们可能已经在这个过程里了,只是还没意识到。

他还说,模型已经发展出了「自己的思维方式」——这些思维方式对人类来说是可读的,但和人类的思维模式不同。他把这个描述为一个重要的突破。

AI 不是在模仿人类思考,它在用自己的方式思考。这两件事,差别很大。

写在最后

Pachocki 是那种让你觉得「这个人真的在认真想这些问题」的人。

他不是在卖产品,不是在做 PR,他是在描述他看到的世界——包括那些让他自己也感到不确定的部分。

AI 正在加速研究自身,编程 Agent 正在重塑软件开发,强化学习正在突破可验证的边界,权力集中的风险正在逼近。

这些事情同时在发生。

我们身处其中,很难看清全貌。

Hi ~,我是 Dukee,在 AI 世界持续探索。

我会持续分享一些值得探讨的 AI 观察与思考。

如果你也在学习AI,欢迎关注,我们一起升级打怪👾!

欢迎大家一起交流!

夜雨聆风

夜雨聆风