最近你可能注意到了,Anthropic、OpenAI还有很多国内AI框架都开始支持MCP,也就是模型上下文协议。

GitHub上相关的项目星涨得特别快,很多人都说这是AI Agent下一步的关键标准。

但是MCP到底是什么?它真的能解决AI Agent的痛点吗?今天我们从技术角度彻底拆解一下。

AI Agent为什么需要一个"协议"?

要理解MCP为什么重要,我们得先看看现在AI Agent开发遇到了什么问题。

你想开发一个AI Agent,让它能调用工具、访问数据库、连接第三方服务,你会发现一个很头疼的问题:

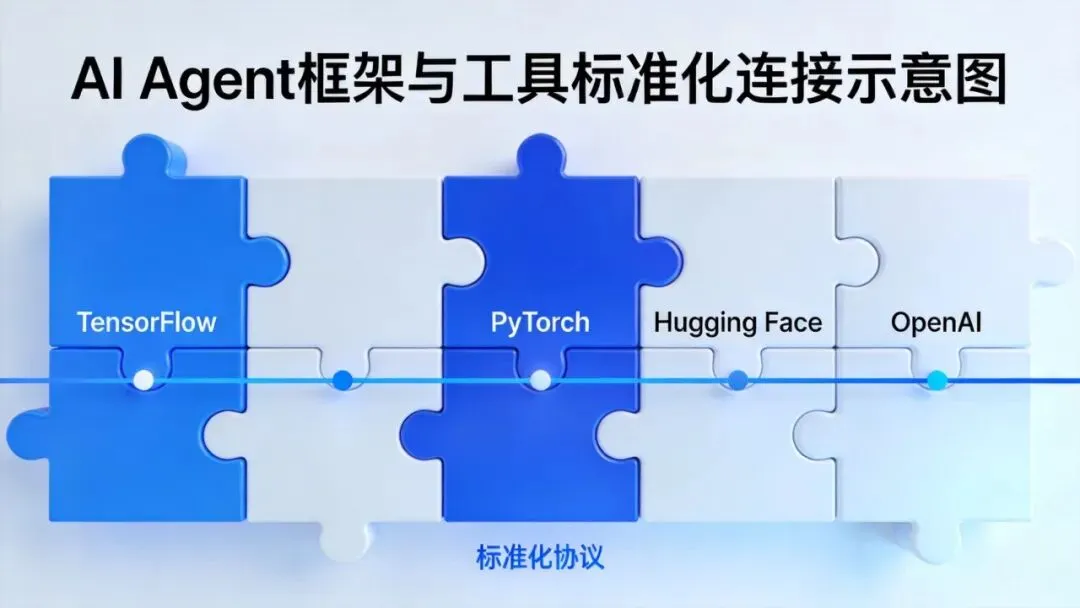

每个框架都有自己的接口定义,每个工具都要重新适配一遍。

你用LangChain开发的Agent,要想搬到LlamaIndex上用,所有工具都得重写一遍适配代码。你开发了一个新工具,要想让不同框架的Agent都能用,你得给每个框架都写一遍接入层。

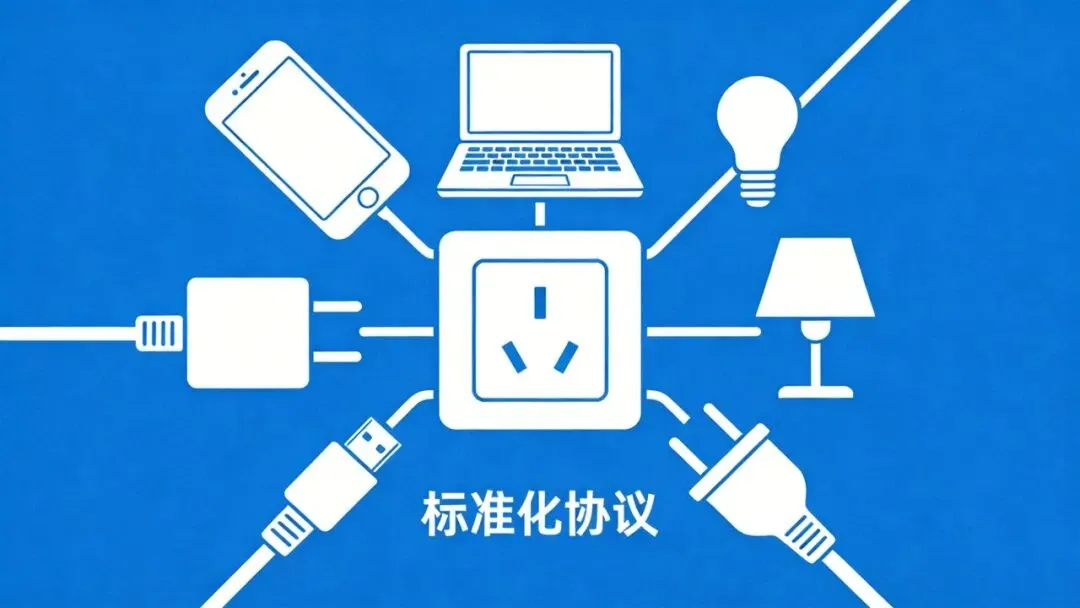

这就好比你家里的电器,每个牌子都用不同形状的插座,你买个新冰箱还得重新改电路,这谁受得了?

MCP想要解决的,就是这个问题:定义一个统一的上下文和工具调用协议,让模型、框架、工具之间能互相"对话",不用每个都重新适配。

MCP核心是什么?三个核心设计理念

很多人看了官方文档还是云里雾里,我把它拆解成三个最核心的设计理念,你一下子就能明白。

1. 上下文是第一类公民

在传统的大模型API里,上下文就是给模型输入的一坨文本。MCP不这么看——MCP认为上下文是结构化的对象集合。

你可以有不同类型的上下文:文本、图片、音频、文件引用、工具返回结果、甚至其他模型的输出。每个上下文对象都有统一的元数据描述。

这样好处是什么?不同框架可以互解析上下文,不用重新做格式转换。

2. 工具调用有标准格式

以前每个框架定义工具调用的格式都不一样,参数描述也不一样。MCP定义了一套标准的JSON Schema格式描述工具:

工具叫什么名字 工具能做什么 需要什么参数,每个参数是什么类型 返回值是什么格式

只要工具按照MCP标准写一次描述,任何支持MCP的Agent框架都能直接调用它,不用再写适配代码。

3. 流式交互原生支持

现在大模型都是流式输出,MCP从设计一开始就原生支持流式上下文增量更新,不用事后hack。

Agent一边想一边输出,一边调用工具,整个过程都是流式的,用户体验更好。

MCP真的能解决问题吗?利弊分析

MCP现在这么火,它是不是银子弹?我们客观说说它的优缺点。

好处:确实解决了碎片化问题

- 减少重复劳动

:工具开发者写一次,所有框架都能用,节省大量适配时间 - 生态更容易做大

:工具越多,框架就越愿意支持;框架越支持,工具开发者就越愿意按照标准来,正向循环 - 降低入门门槛

:新手开发Agent不用再纠结各个框架的接口差异,直接用标准工具就行

潜在问题:标准化也有代价

- 不是万能药

:MCP解决的是接口标准化问题,解决不了Agent推理能力、规划能力这些核心问题 - 会增加一点 overhead

:统一协议意味着抽象层次更高,性能会有一点点损失,对绝大多数应用来说可以忽略 - 现在还在早期

:虽然很多大框架已经支持,但生态还没完全起来,还有很多工具没做适配

哪些人需要关心MCP?

说了这么多,你可能会问:我就是普通用户,需要关心MCP吗?

- 普通AI用户

:不用关心,对你来说没感知,背后框架帮你处理好了 - AI应用开发者

:值得关注,以后开发Agent真的会方便很多 - 工具开发者

:建议尽快按照MCP标准适配,一次开发多框架复用

我的判断是:MCP不是什么"Agent终极答案",但它确实是AI生态走向成熟的必然一步。就像Web需要HTTP,数据库需要SQL,AI Agent生态也需要一个统一的对话协议。

总结:标准化是生态成熟的标志

AI发展到现在,从单模型到多Agent协作,从单一场景到复杂工具调用,碎片化问题越来越严重。

MCP的出现,就是行业在自发解决这个问题。虽然现在还在早期,但方向是对的。

接下来一两年,应该会有越来越多框架和工具支持MCP,到时候开发AI Agent真的会像搭积木一样简单。

你怎么看MCP?觉得它会成为下一代AI Agent的标准吗?评论区聊聊你的看法。

夜雨聆风

夜雨聆风