你有没有注意到一件奇怪的事?

当你打开一个传统 App——比如 Excel、Photoshop、甚至微信——你心里是踏实的。你知道点这个按钮会发生什么,输入这个公式会算出什么。哪怕软件再复杂,你和它之间的关系本质上是清晰的:你操作,它执行。

但当你打开 ChatGPT 或者 Claude 的对话框时,你会不自觉地做一件从未对软件做过的事——你开始斟酌措辞。

你会想:我该怎么问,它才能更好地理解我?你甚至会在心里组织语言,像在跟一个聪明但不完全了解背景的同事沟通。

这个微妙的变化,藏着一场我们尚未完全意识到的范式革命。

一、完全不同的“造物”

过去半个多世纪,人类建造了一座极其精密的数字大厦。

从底层的编译原理、操作系统调度、并发控制,到上层丰富的 PC、Web、移动端、小程序、跨平台架构——这套体系是计算机科学几乎所有分支的集大成者。它壮观、精密、可靠,支撑着全球数十亿人的数字生活。

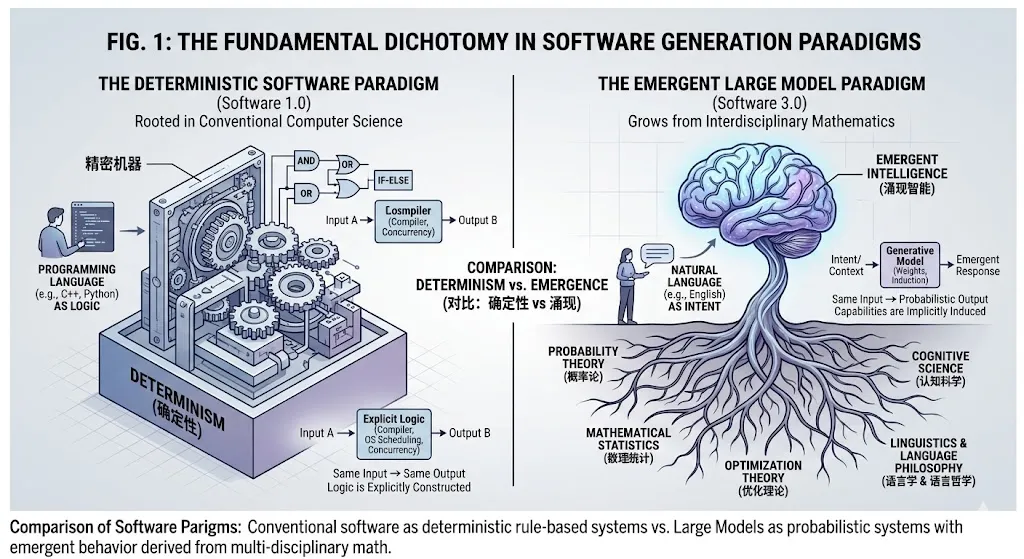

但如果追问这座大厦的地基是什么,答案只有两个字:确定性。

传统软件的全部哲学,就是消除意外。你写了一个排序算法,它就永远按那个逻辑排序。你定义了一套 if-else 规则,系统就严格按照规则走。从编译器到调试器,从单元测试到持续集成,整条工具链的存在意义就是确保:同样的输入,永远得到同样的输出。

Fred Brooks 在经典论文《没有银弹》中说过一句意味深长的话:物理学家相信自然界必有简洁的规律,但软件工程师没有这种信仰可以慰藉——他们面对的复杂性是人造的、本质的、不可压缩的。然而即便如此,整个软件工业的努力方向始终是一致的:把这些复杂性装进确定性的笼子里。

大模型是从完全不同的土壤里长出来的东西。

它的根系不在计算机科学的传统花园里,而是扎进了概率论、数理统计、优化理论、信号处理、认知科学、甚至语言哲学的交叉地带。斯坦福大学在那份两百多页、跨十个院系的基础模型报告里,用了一个精准的词来形容这种差异:大模型的能力是“隐式诱导的,而非显式构建的”——没有人逐行编写了它的“思考逻辑”,它的智能从数据和训练中涌现出来。

Andrej Karpathy 把这个变化讲得更直白。他说传统软件是 Software 1.0——人写代码,代码是逻辑;大模型是 Software 3.0——人写提示词,提示词是意图。他甚至开了个玩笑:“现在最火的编程语言是英语。”

笑言背后揭示的是——我们正在从“精确指令驱动”的软件,过渡到“模糊意图驱动”的软件。你不再需要自行控制机器每一步该怎么做,你只需要正确地告诉它你想要什么——剩下的,自有“大儒”为你辨经。

二、它“不确定”,它强大

很多人第一次发现大模型“不靠谱”时,会本能地感到不安:为什么同一个问题,问两遍得到的答案不一样?为什么它有时候会“一本正经地胡说八道”?

这种不安是可以理解的——我们被半个世纪的确定性软件训练出了一种根深蒂固的期待:工具应该是确定的。

但换一个角度想:你有没有觉得奇怪,为什么你从来不会对一个同事“问两遍同一个问题得到不同回答”感到惊讶?因为你知道人是活的。人会根据语境、心情、刚刚获取的新信息来调整表达。你不会因此觉得这个同事“有 Bug”,反而会觉得这种灵活性正是他有价值的地方。

大模型的“不确定性”也是如此。

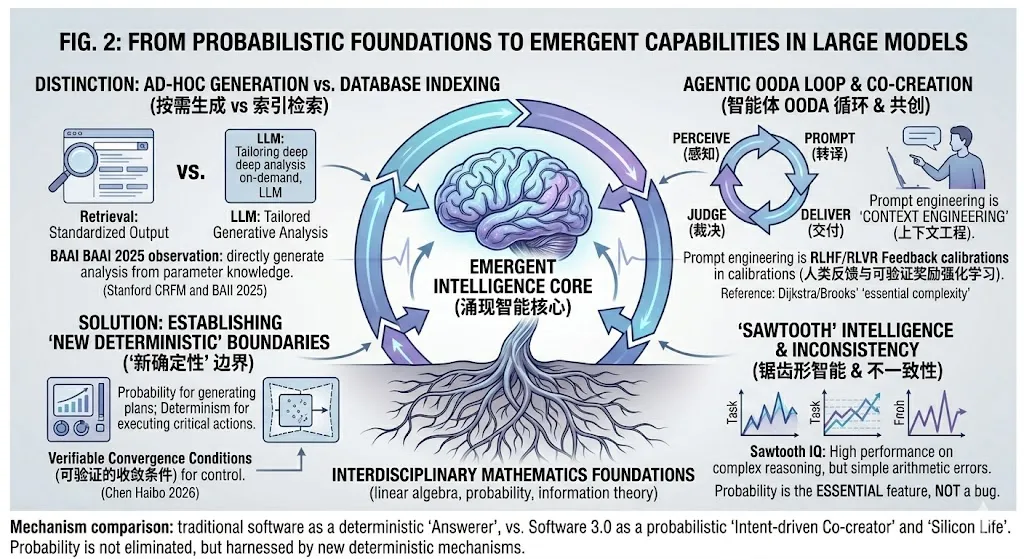

上海交通大学的陈海波教授说过一句很有洞察力的话:面对大模型的概率性,很多人的直觉反应是“想办法把它变确定”——加更多约束,收紧输出格式,甚至试图让它每次都返回一模一样的结果。但这其实是用对待传统软件的思路去驯服一种全新的事物。你当然可以这样做,但你会在这个过程中丢掉它最有价值的东西。

想象一下:如果每个人问同一个问题,大模型永远只返回同一个标准答案,那它跟搜索引擎有什么区别?

正是因为它能根据你的具体上下文、你的提问方式、你对话的历史轨迹,生成“千人千面”的回应,它才超越了检索,成为了真正意义上的生成式智能。它不是从数据库里“查”一个答案给你,而是为你“想”一个答案出来。

更值得玩味的是,大模型还展现出了传统软件完全不具备的另一个特性:自我演变/优化。不是版本更新意义上的“变”,而是在与你交互的过程中,通过上下文理解、通过人类反馈的强化学习(RLHF),它变得越来越“懂你”、让你感觉“越用越好用”。

Andrew Ng 曾经分享过一个让业界震动的数据:当你给一个能力一般的模型配上精心设计的多轮交互工作流,它在编程测试中的得分可以从 67% 飙升到 95%——超过了能力更强但“裸奔”的模型。

换句话说,大模型不再是冷冰冰的工具,它是“活”(Live)的。它更像是一个会与你共同成长的协作伙伴。你对它投入得越多,它回馈给你的就越多。这是 Excel 和 Photoshop 永远不会给你的体验。

三、新的“人机”协同

理解了大模型的本质,再回过头来看我们自己的工作方式,你会发现一个有趣的变化正在悄然发生。

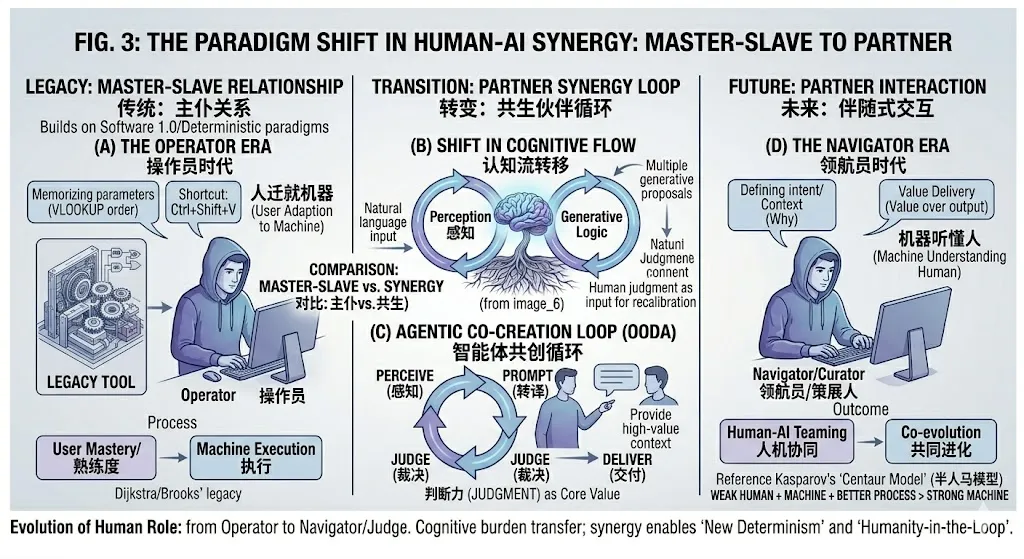

在确定性软件时代,人类和软件的关系是“主仆关系”。你是操作员,软件是工具。你学习它的界面规则、快捷键、菜单层级,本质上是在让自己适应机器的语言。你得知道 Ctrl+Shift+V 是“无格式粘贴”,得记住 Excel 里 Countifs、XLOOKUP、Filter 的参数顺序。机器不迁就你,你迁就机器。

但大模型时代,这个关系反转了。

你不需要学习任何“操作手册”。你用自然语言表达你的意图,机器来理解你——虽然它理解得并不总是完美,但至少,认知负担从人转移到了机器这一侧。

这意味着什么?意味着人类在人机协作中的核心价值发生了根本性的迁移。

过去,你的价值在于熟练度——你对工具操作得越熟练,效率越高。现在,你的价值在于判断力——你能不能提出好的问题,能不能辨别好的回答,能不能在 AI 给你的十个方案里选出那个真正对的。

哈佛大学的 Karim Lakhani 教授有一句被广泛传播的话:AI 不会取代人类,但使用 AI 的人会取代不使用 AI 的人。我想补充一句:在使用 AI 的人当中,判断力强的人会取代判断力弱的人。

国家发改委在 2025 年 8 月发布的一篇文章中,用了一个我觉得非常准确的词来描述这种新关系:“人机共生”。机器从工具变成了伙伴,从一次性使用变成了持续性交互。大模型的记忆能力让它能记住你之前说过什么,它的上下文理解能力让它能猜到你接下来想要什么。这不再是人在“操作”一个软件,而更像是人在“陪伴”一个不断成长的数字搭档。

四、新的工作节奏:感知、裁决、交付

如果仔细观察你现在每天使用大模型的工作流程,你会发现它几乎都可以拆解为三个阶段。这不是什么高深的理论框架,而是已经在发生的日常:

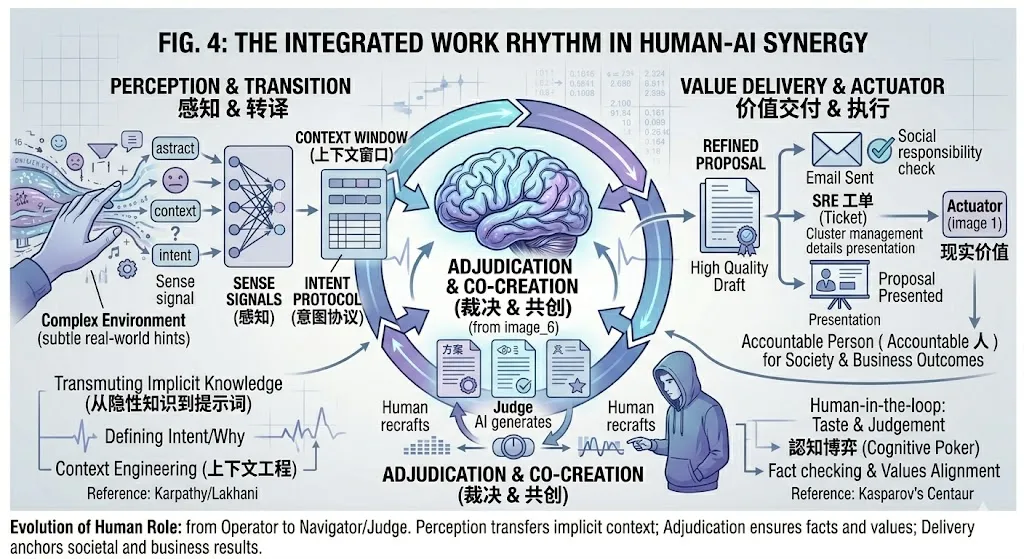

第一步,你在做“感知转译”。

AI 什么都知道,但它什么都不了解。

它有全人类的公开知识,但它不知道你今天开会时客户的一个微妙的表情变化意味着什么,不知道你所在行业此刻的暗流,不知道你老板上周说的那句“我们需要更大胆一点”具体指什么。

这些信息存在于你的感知、直觉、和与真实世界的互动之中。你的第一项工作,就是把这些模糊的、隐性的现实上下文,转化为 AI 能听懂的语言——一段提示词、一组背景描述、一份需求说明。

Karpathy 在最近的分享中说了一件值得注意的事:比起“提示词工程”(Prompt Engineering),他更倾向于用“上下文工程”(Context Engineering)这个词。因为真正决定 AI 输出质量的,不是你那句话写得多巧妙,而是你给它提供的整个背景信息是否充分、准确、有层次。

第二步,你在做“裁决”。

大模型给你的输出,从来都不是“最终答案”。它是一个“高质量的初稿”、一组“可能性的集合”、一份“待审批的提案”。

你需要带着自己的经验、品味和价值判断去审视它:这个方案的逻辑通不通?这段文案的语气对不对?这个代码有没有遗漏的边界条件?这个建议在我所处的具体情境下可行吗?

这不是简单的“通过或驳回”,而是一场认知博弈与共创——你修改它的输出,它根据你的修改重新理解你的意图,给出更贴合的新版本。几个来回之后,产出的东西往往比你独立完成的更好,也比 AI 独立完成的更好。

卡斯帕罗夫在输给深蓝之后发现了一个有趣的规律:在人机组队赛中,水平一般的棋手加上机器,如果配合得当,能赢过顶尖棋手加上机器但配合糟糕的组合。“配合得当”的核心,就是人知道什么时候该相信机器的计算,什么时候该坚持自己的直觉。

裁决能力——知道什么时候接受、什么时候推翻、什么时候追问——这是 AI 时代人类最核心的专业能力。

第三步,你在做“价值交付”。

AI 可以帮你写出一封完美的邮件,但它无法替你按下“发送”并承担随之而来的社交后果。它可以生成一份精美的提案,但它无法走进会议室面对客户的质疑和犹豫。它可以规划一个项目的里程碑,但它无法在团队士气低落时鼓舞人心。

从数字世界到物理世界的那段距离,从“方案”到“结果”的那个跨越——回复客户、上台演示、提交工单、推动项目进入下一阶段——仍然只有人类能走完。

这三个阶段构成了一个持续的循环:你感知现实、转译给 AI、审判它的产出、带着成果回到现实世界完成交付,然后在新的反馈中开始下一轮感知。这个循环转得越快、越流畅,你的产出就越高。

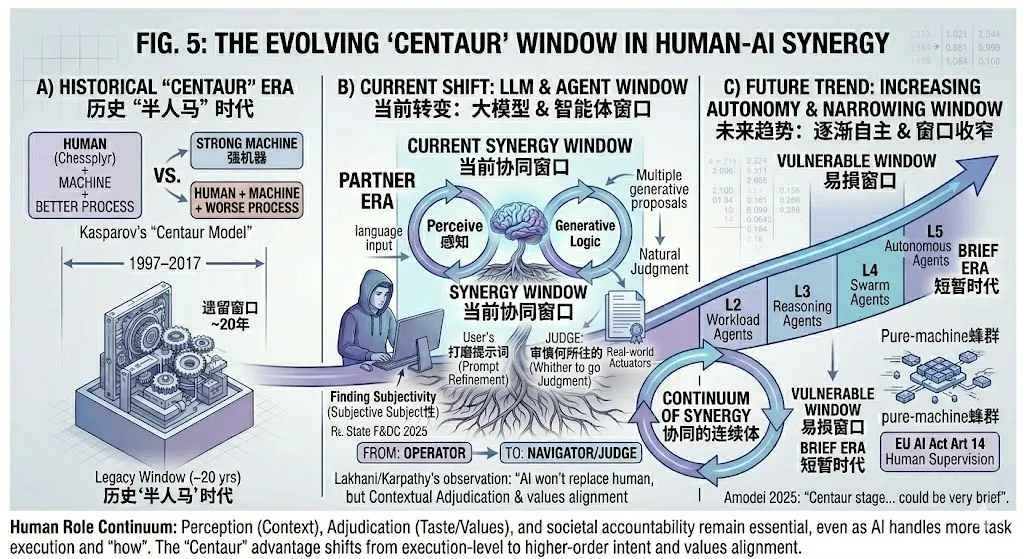

五、半人马的窗口期

Anthropic 的 CEO Dario Amodei 在 2025 年说了一句让很多人停下来想了一会儿的话:“我们已经处在半人马阶段了。但这个阶段可能非常短暂。”

他的意思是,在国际象棋历史上,人机协作(半人马模式)战胜纯机器的时代持续了大约十五到二十年。但在 AI 发展的指数曲线上,留给“人机协作”的窗口期可能短得多。

这不是在贩卖焦虑。这是在描述一个事实:今天你和 AI 协作所创造的价值优势,明天可能会因为 AI 进一步自主化而被压缩。

但反过来想,这恰恰说明了此刻学会与 AI 共事的紧迫性。

当机器逐渐掌握了所有“怎么做”的能力,真正稀缺的将是人类的“想要什么”和“为什么”——是你的目的感、价值判断、对现实世界复杂性的感知、以及在模糊地带做出决策的勇气。

这些东西,暂时还没有任何模型学会。

所以,与其问“AI 会不会取代我”,不如问:在这个人和 AI 短暂共生的窗口里,该怎样找到属于自己的“主体性”、如何拥抱并与“不确定性”共舞?

答案,可能就在接下来的每一个日常里:

在你每一次认真打磨的提示词中;

在你每一次审慎判断“何所往”的裁决中;

以及,在你跨越人机边界、回归现实的每一次价值交付里。

夜雨聆风

夜雨聆风