2025 年,生成式 AI、智能算法已经深度融入我们的生活:用 AI 规划低碳出行、用算法优化家庭能耗、用数字平台参与碳普惠…… 数字化绿色行为,正在成为普通人参与环保的新方式。

2025 年,生成式 AI、智能算法已经深度融入我们的生活:用 AI 规划低碳出行、用算法优化家庭能耗、用数字平台参与碳普惠…… 数字化绿色行为,正在成为普通人参与环保的新方式。下面发表在 Taylor & Francis 旗下 SSCI 期刊《Behaviour & Information Technology》的最新综述论文《Bridging the gap: inequalities that divide those who can and cannot create sustainable outcomes with AI》,就直击了这个核心矛盾:在 AI 赋能的数字化绿色时代,不公平正在制造一道新的 “鸿沟”——AI 鸿沟(AI divide),把能通过 AI 创造可持续成果的群体,和被挡在门外的群体,彻底割裂开来。

一、什么是 “AI 鸿沟”?不公平如何渗透数字化绿色生活?

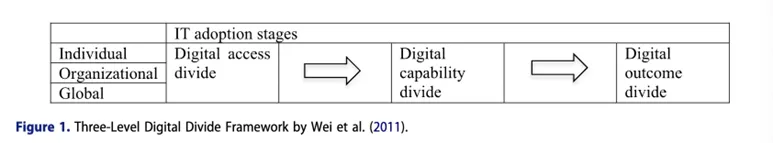

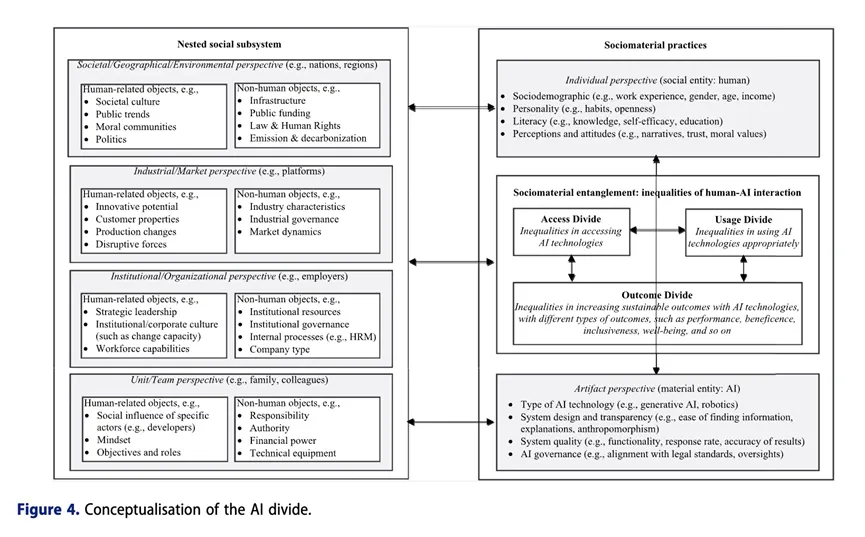

我们常说的 “数字鸿沟”,是不同群体在网络接入、数字技能上的差距;而 “AI 鸿沟”,是数字鸿沟在 AI 时代的全新升级:它指的是不同个体、组织、社会,在利用 AI 获取成功、可持续成果时的巨大差距。

简单来说,就是:有的人能用 AI 轻松实现低碳生活、绿色发展,拿到数字化绿色转型的红利;有的人却因为各种不公平,连参与的门槛都摸不到,只能被动承担环保成本,却享受不到 AI 带来的绿色便利。

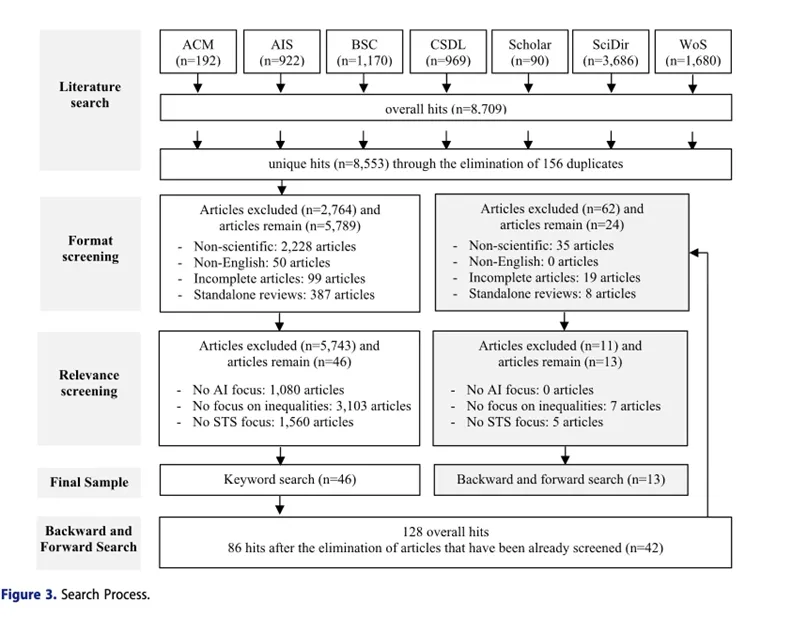

这篇论文通过系统文献综述,把 AI 鸿沟背后的不公平,拆解成了三大核心维度,每一个都和我们的数字化绿色行为息息相关:

1. 社会层面的不公平:资源与机会的先天差距

这是最直观的不公平:经济条件、数字素养、社会身份,直接决定了你能不能用好 AI 搞环保。高收入、高学历群体,能轻松用上智能节能家电、AI 碳足迹追踪 APP、绿色消费推荐算法,用 AI 优化自己的低碳生活;低收入、低数字素养群体,可能连稳定的网络、智能设备都难以负担,更别说掌握 AI 工具的使用方法,自然被排除在数字化绿色行为之外。更隐蔽的是,AI 算法本身就带有 “偏见”:面向高收入群体的绿色服务越来越完善,而面向弱势群体的绿色 AI 工具却严重缺位,进一步放大了不公平。

2. 技术层面的不公平:AI 设计的 “隐形门槛”

很多时候,不是我们不想用 AI 搞环保,而是AI 工具从设计之初,就没考虑过弱势群体的需求。复杂的操作界面、专业的术语、对高性能设备的要求,把老年群体、农村群体、低技能群体直接挡在门外;算法推荐的 “信息茧房”,让高收入群体不断接收到绿色消费、低碳生活的信息,而弱势群体却很难获取有效的环保 AI 工具和知识;数据隐私的不平等,也让弱势群体不敢使用 AI 绿色工具:担心个人信息泄露,只能放弃参与数字化绿色行为。

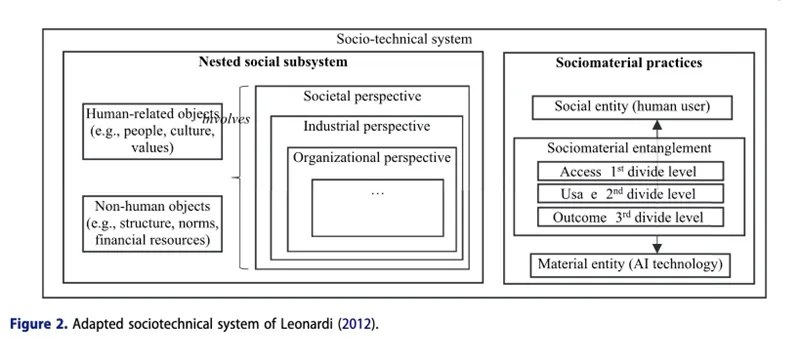

3. 社会技术层面的不公平:系统层面的结构性割裂

这是最深刻的不公平:AI、社会、制度的联动,让不公平形成了闭环。企业、政府在推广 AI 绿色技术时,往往优先布局城市、发达地区,农村、欠发达地区的数字化绿色基础设施严重滞后;环保政策、碳普惠机制,大多围绕 “会用 AI 的群体” 设计,不会用 AI 的群体,连参与环保、获取绿色收益的资格都没有。

以上种种,最终形成了一个恶性循环:不公平→AI 鸿沟→数字化绿色行为差距→环境不公平,让贫富差距、城乡差距,在环保领域进一步放大。

二、AI 鸿沟,正在加剧数字化绿色时代的 “环境不公平”。

这篇论文的核心结论,戳中了很多人没意识到的真相:AI 不是天然的 “公平神器”,如果不解决不公平,AI 只会让环境不公平愈演愈烈。

我们总以为,用 AI 搞环保是 “人人平等” 的,但现实是:

高收入群体用 AI 优化出行、家居,降低自己的碳足迹,还能通过碳普惠拿到收益;低收入群体却因为买不起智能设备、不会用 AI 工具,只能继续高碳生活,还要承担高碳带来的环境成本;城市群体用 AI 享受绿色服务,农村群体却连基础的数字环保服务都覆盖不到。

最终,数字化绿色转型,变成了 “富人的环保游戏”,而弱势群体被彻底边缘化,环境不公平被 AI 进一步固化。

论文特别强调,AI 鸿沟不是单一维度的问题,而是多层次、循环性的结构问题:社会不公平催生技术不公平,技术不公平又反过来加剧社会不公平,最终让数字化绿色行为的差距越来越大,环境福利的分配越来越失衡。

三、如何弥合 AI 鸿沟?让数字化绿色行为真正 “人人可及”。

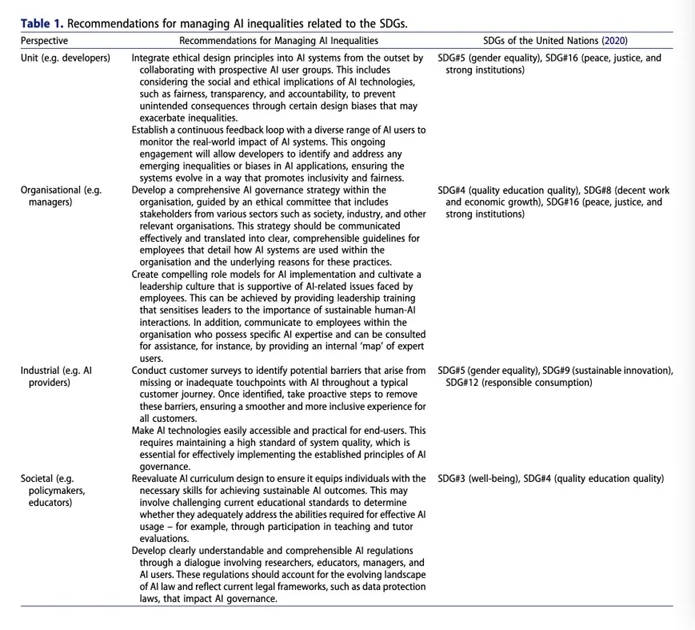

针对 AI 鸿沟带来的不公平,论文也给出了明确的方向:打造以人为中心的 AI(human-centered AI),才是破解之道。

具体到我们的生活和政策层面,有三个核心发力点:

1. 消除 AI 使用的 “数字门槛”。

让弱势群体也能用上绿色 AI简化 AI 绿色工具的操作界面,推出适老化、适农化版本,降低使用门槛;加强数字素养教育,尤其是针对老年、农村、低收入群体的 AI 绿色技能培训,让每个人都有能力参与数字化绿色行为;完善基层数字基础设施,让欠发达地区也能享受到稳定的网络和 AI 绿色服务。

2. 打破算法偏见,让 AI 绿色红利公平分配。

要求 AI 算法进行公平性审计,避免算法向高收入、城市群体倾斜;推出面向弱势群体的专属 AI 绿色服务,比如针对农村的智慧农业 AI 工具、针对低收入家庭的节能 AI 补贴;建立公平的碳普惠机制,让不会用 AI 的群体,也能通过传统环保行为获得收益,避免 “数字排斥”。

3. 构建公平的制度框架,从根源破解 AI 鸿沟。

政府出台 AI 公平性相关法规,强制要求 AI 绿色技术兼顾弱势群体需求;企业承担社会责任,在 AI 绿色产品研发中融入公平性设计;建立多方参与的监督机制,让弱势群体的声音被听到,避免 AI 绿色转型成为 “少数人的盛宴”。

四、写在最后:数字化绿色转型,不该有 “被落下的人”。

这篇论文给我们的最大启示是:数字化绿色转型,从来不是 “技术越先进就越公平”,公平才是技术的前提。

AI 可以成为环保的强大工具,但如果任由不公平制造 AI 鸿沟,那么数字化绿色行为,只会变成新的阶层分化工具:富人用 AI 享受绿色生活,穷人被挡在门外,承担环境代价。

真正的可持续发展,从来不是少数人的环保,而是所有人的共同参与。弥合 AI 鸿沟,让每一个人,无论贫富、城乡、年龄,都能平等地参与到数字化绿色行为中,才是 AI 时代环保的真正意义。

毕竟,环保的本质,是守护所有人的共同家园,而不是制造新的不公平。

参考资料

Hammerschmidt T, Stolz K, Posegga O. Bridging the gap: inequalities that divide those who can and cannot create sustainable outcomes with AI[J]. Behaviour & Information Technology, 2025.

夜雨聆风

夜雨聆风