做一个思想实验:你正坐在电脑前阅读这篇文章。你的眼睛接收光线,大脑处理信号,意识浮现出"这是一篇关于康德和 AI 的文章"这个念头。

但如果,你的大脑其实泡在一个营养缸里,所有的感觉都是超级计算机喂给你的电信号呢?

这不是科幻小说的开场白。这是哲学家希拉里·普特南在 1981 年提出的经典思想实验。而更让人意外的是,240 多年前,一个从未离开过家乡柯尼斯堡的德国老头,已经给出了回应这个问题的思想工具。

他就是伊曼努尔·康德。

今天,当 AI 能写诗、能推理、能通过律师考试的时候,康德的那套"先验哲学"不仅没有过时,反而成了我们理解 AI、智能和意识最锋利的手术刀之一。

康德的核心洞见:你看到的世界,不是世界本身

大多数人对现实有一种朴素的信念:我看到红色,是因为那个苹果"本身就是红色的";我感到硬,是因为桌子"本来就是硬的"。

康德说,不对。

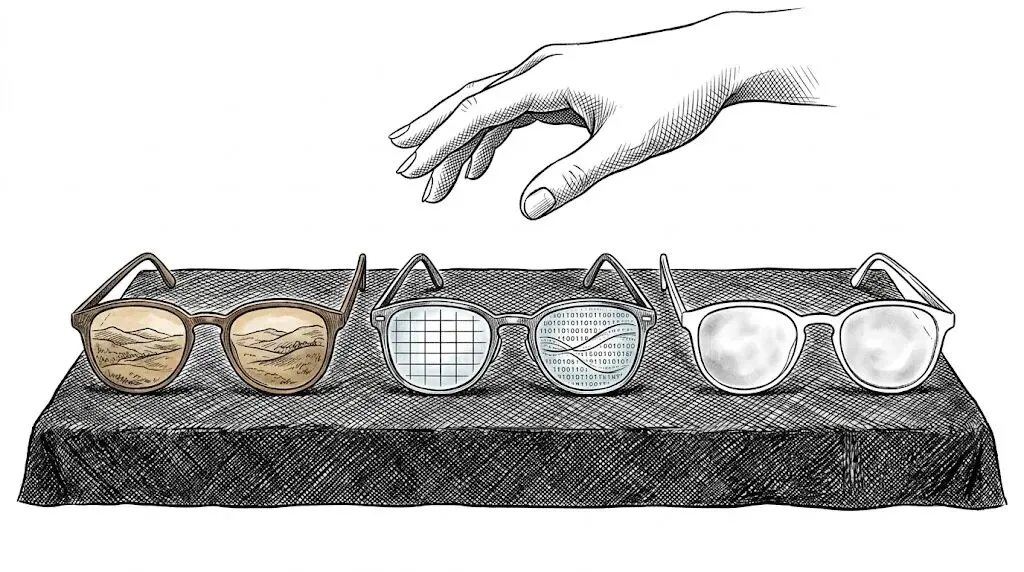

先验唯心论(Transcendental Idealism)我们永远无法直接接触"事物本身"(物自体),我们感知到的一切,都经过了心智的加工和建构。可以想象成你永远戴着一副无法摘下的"心智眼镜",你看到的一切都是经过镜片过滤后的样子。

这副"眼镜"有两层滤镜。

第一层:时间和空间。康德认为,时间和空间不是客观世界的属性,而是我们感知世界的"先天格式"。就像你的手机拍照时,不管拍什么,照片都是矩形的。这不是因为世界是矩形的,而是因为你的相机传感器是矩形的。

第二层:知性范畴。感官给你的只是一堆零散的感觉材料(红的、圆的、甜的)。要把它们组织成"眼前有一个红苹果"这样有意义的经验,需要一套概念框架来"拼装"。康德列出了 12 个基本范畴,比如因果关系、实体与偶性、统一性与多样性。

这里最关键的一点是:这些范畴不是从经验中学来的,而是经验之所以可能的前提条件。

你没法靠观察来"发现"因果律。恰恰相反,因果律是你能够观察和理解任何事情的前提。没有它,你面前就只有一团无法解释的、混沌的感觉碎片。

机器能思考吗?图灵和康德的隔空对话

1950 年,图灵提出了一个绕过"思考"定义的精妙方案:如果一台机器的对话表现让人分辨不出它是不是人类,那我们就说它能"思考"。这就是著名的图灵测试。

图灵测试(Turing Test)判断机器是否具有智能的一种方法。如果你和一台机器文字聊天,分不清对面是人还是机器,就说明它通过了测试。可以想象成一场"蒙面歌王",你只听声音判断歌手是谁。

今天的大语言模型在很多场景下已经能骗过人了。那是不是说 AI 真的在"思考"?

康德的框架给出了一个更深层的分析工具。

在康德看来,真正的"认知"需要两样东西同时工作。直觉(Intuition)提供原始材料,知性(Understanding)用范畴去组织它。正如他那句名言所说:

"没有内容的思想是空洞的,没有概念的直觉是盲目的。"

那么 AI 在做什么?它处理文本序列,预测下一个 token,在统计意义上"理解"了语言的结构。但它有"直觉"吗?它有原始的感觉经验吗?显然没有。它从未见过一个苹果,闻过一朵花,感受过疼痛。

但问题没这么简单。

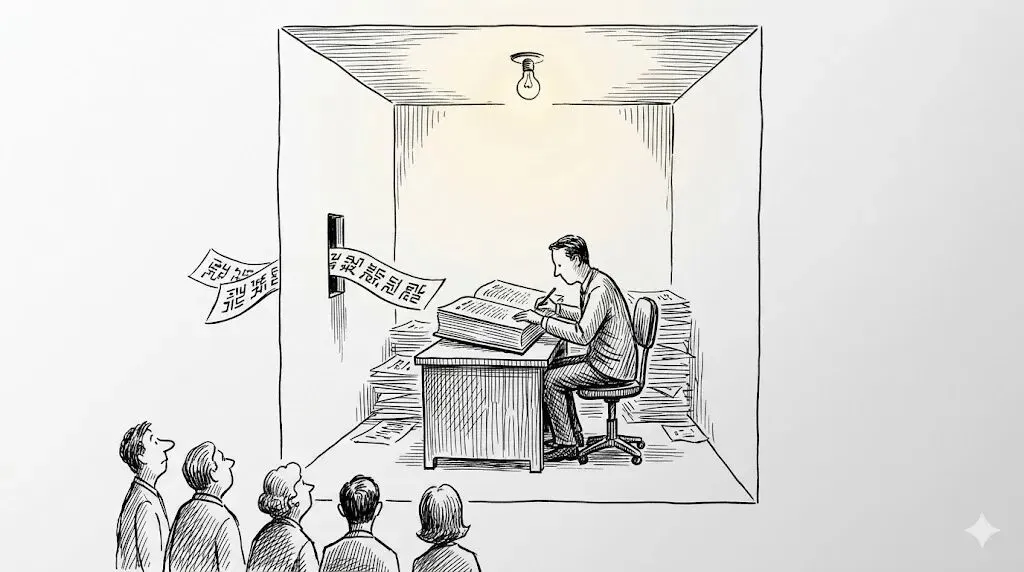

中文房间:语法够不够?

哲学家约翰·塞尔在 1980 年扔出了一个炸弹。

中文房间(Chinese Room)一个不懂中文的英语母语者被关在房间里,手里有一本规则手册。中国人从门缝塞进中文问题,他按规则查表、输出中文回答。外面的人以为房间里有人懂中文,但实际上他一个字也不理解。可以想象成一本翻译手册足够厚、足够详细,就能骗过所有人,但手册本身"不懂"任何语言。

塞尔想说的是:语法(按规则操作符号)不等于语义(真正理解含义)。电脑再强大,也只是在做语法操作。

如果我们用康德的框架来看这个实验,会发现一个有趣的对应。

那个房间里的人(或者说,GPT 的算法)确实在执行一种"知性"操作:按规则组合、转换符号。但他缺少的是"直觉"维度的参与:他从未真正接触过中文语义的"原始材料"。他的操作是空转的知性,是没有直觉的概念。

按康德的说法,这样的操作是"空洞的"。

不过,这里有一个微妙的反驳值得讨论。塞尔的论证预设了"理解"必须发生在执行操作的个体层面。但如果把整个系统(规则手册 + 房间 + 操作者)作为一个整体来看呢?这就是所谓的"系统回应"(Systems Reply)。

康德本人不会反对"系统"这个视角。他的"统觉的综合统一"就是一种系统性的自我意识,是所有经验碎片被整合到同一个"我"当中的过程。问题在于:一套算法系统,即使再复杂,有没有这样一个统一的"我"来整合所有信息?

这把我们带到了这场讨论中最深的那口井。中文房间实验追问的是:没有真正接触语义的系统能不能算"理解"?接下来的问题更狠:就算一个系统真的在处理信息、做出反应,它"里面"有人在体验吗?

意识的"难问题":从康德到查尔默斯

为什么蝙蝠"觉得"自己在用超声波定位?为什么你看红色的时候会有一种"红的感觉",而不是仅仅处理了一个 700 纳米的波长数据?

意识的难问题(Hard Problem of Consciousness)由哲学家大卫·查尔默斯提出。为什么物理过程(神经元放电、突触传递)会产生主观感受?解释大脑如何处理信息是"容易问题",解释为什么处理信息的同时还伴随着"体验",是"难问题"。可以想象成你完全拆解了一台收音机的所有零件和电路,但你仍然无法解释"音乐为什么好听"。

查尔默斯在 1995 年把这个问题磨得极其锋利。他指出,即使我们把大脑的所有神经科学细节都搞清楚了,"为什么会有主观体验"这件事,仍然是一个独立的解释空白。

这和康德的一个核心区分遥相呼应。

康德把世界分成了现象(phenomenon,我们能经验到的)和物自体(noumenon,事物本身的样子)。现象界可以被科学研究,物自体则永远在认知的边界之外。

意识就处在这条边界上。

作为大脑的功能(处理信息、做出反应),意识属于现象界,可以被神经科学研究。但作为"主观体验"本身(那种红色的"红感"、疼痛的"痛感"),它似乎指向了某种无法被第三人称科学方法完全捕获的东西。

这对 AI 意味着什么?

如果意识的主观维度真的属于"物自体"的领域,那我们可能永远无法从外部确定一个系统到底有没有意识。你可能造出一个行为上和人类完全一样的 AI,但你无法确定它"里面"有没有人在家。

反过来也一样吓人:你也不能确定它没有。

缸中之脑:最狠的怀疑论

现在让我们回到开头那个营养缸。

1981 年,希拉里·普特南提出了"缸中之脑"思想实验。假设一个疯狂的科学家把你的大脑挖出来,放在一个充满营养液的缸里,用电线连接到一台超级计算机上。这台计算机完美地模拟了你所有的感觉输入。你"看到"的蓝天、"闻到"的咖啡、"感受到"的键盘触感,全都是电信号模拟的。

你怎么知道你现在不是缸中之脑?

缸中之脑(Brain in a Vat)一个怀疑论思想实验。如果所有感觉经验都可以被完美模拟,那你怎么确定自己感知到的现实是"真实的"?可以想象成一个终极版的 VR 游戏,逼真到你完全分不出游戏和现实的区别,而且你从出生就在里面。

有趣的是,普特南自己用了一个精巧的语言哲学论证来"反驳"这个假设。他的论证是:如果你真的是缸中之脑,当你说"我是缸中之脑"的时候,"缸"和"脑"这两个词指的不是真正的缸和脑(因为你从未接触过它们),而只是计算机程序中的某种模式。所以"我是缸中之脑"这句话在缸中之脑的语境里是自我否定的。

这个论证很聪明,但也有一个漏洞:它依赖于一个特定的语义理论(因果指称论),而不是所有人都接受这个理论。

康德的思路更有启发性。

回忆一下,康德说时空和范畴是经验的"先验条件"。这意味着,不管你的感觉输入来自哪里(真实世界还是超级计算机),只要你的认知系统用同样的时空框架和知性范畴来组织经验,你就能获得在结构上一致的知识。

换句话说,康德的认识论并不要求"感觉输入来自真实外部世界"这个前提。他关心的不是信息的来源,而是信息被组织的方式。

这听起来像是在和稀泥?其实不是。关键是:

"真实性"不在于你接收到了什么信号,而在于你用什么结构来组织这些信号。

如果缸中之脑的经验具有完整的因果结构、时空连贯性和范畴一致性,那么在康德的框架里,这些经验就是"经验上真实的"。它们在现象界层面上为真。

但康德同时也会承认:关于终极实在(物自体),我们无论如何都说不了什么。不管你是不是缸中之脑,物自体都在认知的边界之外。

AI 时代的康德:我们该怎么想?

把这些线索拉在一起,会发现康德的框架在 AI 时代至少校准了三件事。

1"聪明"不等于"有意识"。

GPT-4 写论文、AlphaFold 预测蛋白质结构,这些是极强的模式识别和符号操作能力,是康德所说的"知性"在超常发挥。但知性不等于体验。一台计算器比你算得快,不代表它"感受到了"数学之美。

2所有认知系统都戴着不同的"眼镜"。

康德最大的贡献不是给了一套宇宙终极答案,而是划出了理性的边界。人类用进化赋予的感知系统和概念能力来组织世界,AI 用训练数据、模型架构和损失函数来组织数据。都是"先验框架",只不过一个是碳基的,一个是硅基的。没有谁在看"裸真实"。

3面对回答不了的问题,最难也最正确的姿态是诚实。

"AI 有没有意识?",这可能是康德所说的"二律背反":理性必然要追问,但理性自身回答不了。在缺乏判断标准的时候,比起草率下结论("当然没有!"或"肯定快了!"),承认我们目前的概念工具可能还不够用,才是真正的理性态度。

不是结论的结论

康德从来没有假装解决了所有问题。他做的事情更重要:他把问题的结构看清楚了。

关于 AI 与意识的争论,常常陷入两个极端。一端是狂热的乐观主义:"等 AI 足够复杂,意识自然就涌现了!"另一端是武断的否定:"机器就是机器,永远不可能有意识!"

康德的贡献在于告诉我们:在回答"AI 能不能有意识"之前,先问一个更根本的问题,"我们用什么标准来判断意识?"

如果连我们自己的意识都无法完全用第三人称的科学语言来描述,那凭什么要求 AI 证明它有意识?如果你连自己是不是缸中之脑都没法排除,又有什么底气说你比 AI 更"真实地"理解了这个世界?

这些问题没有轻松的答案。但一个负责任的思考者不会因为没有答案就停止追问。

240 年前,柯尼斯堡的那个教授在《纯粹理性批判》里写过一句话,放到今天依然振聋发聩:

"我不得不取消知识,以便为信念腾出地方。"

在 AI 时代,这句话可以被温和地改写为:

我们不得不承认认知的边界,以便为真正的理解腾出空间。

夜雨聆风

夜雨聆风