Meta AI与KAUST联合提出的Neural Computer概念

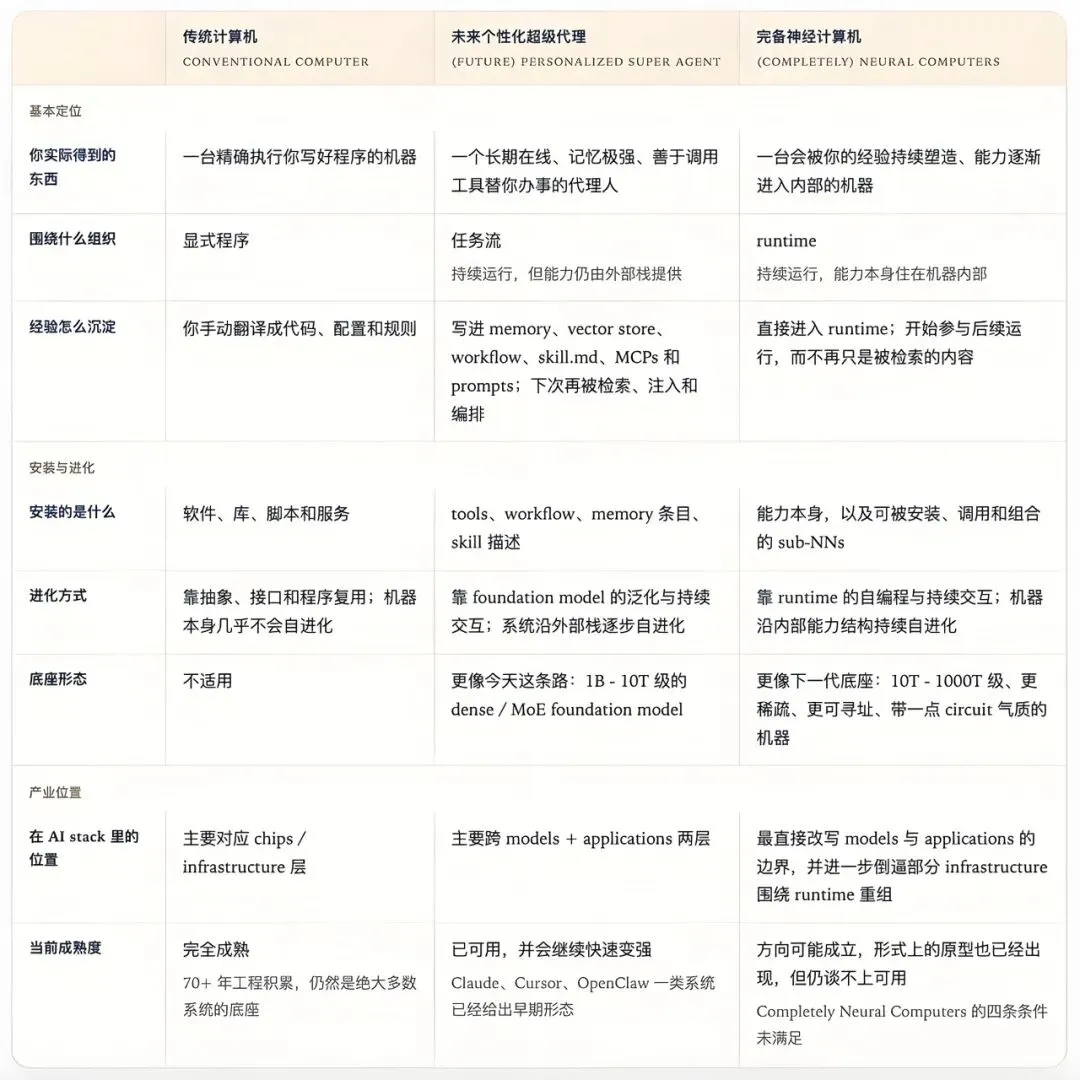

当AI不再只是工具,而是成为计算机本身

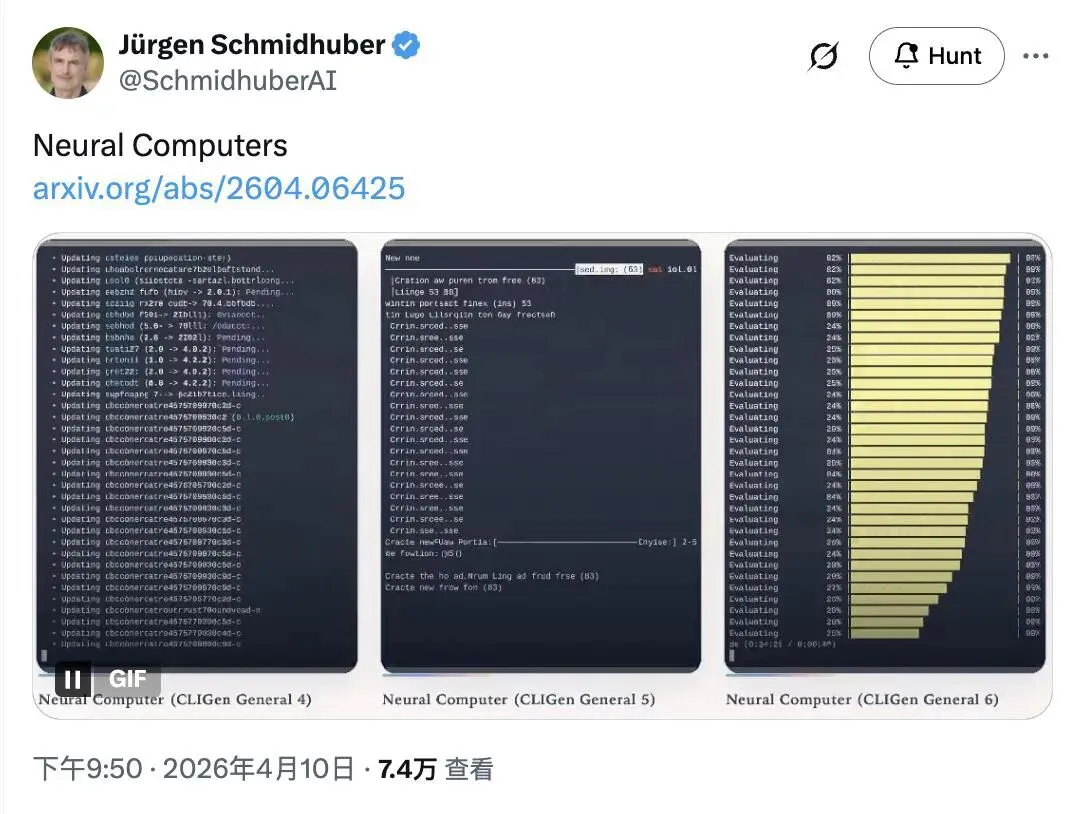

上周,Meta AI和沙特的KAUST实验室偷偷放了一篇75页的论文,标题叫《Neural Computers》。作者名单里有个名字挺有意思——诸葛明晨,外加LSTM的发明者Schmidhuber。

这篇论文的核心观点就一句话:让AI直接成为一台正在运行的计算机。

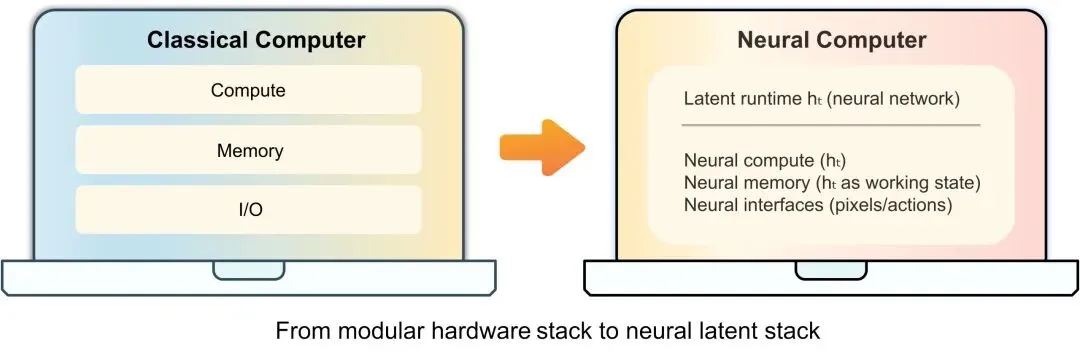

不是比喻,不是修辞。是真的要把CPU、内存、输入输出全部塞进一个神经网络里,让模型自己完成计算、存储、渲染三件事。

冯·诺依曼架构用了80年,终于有人想换掉了

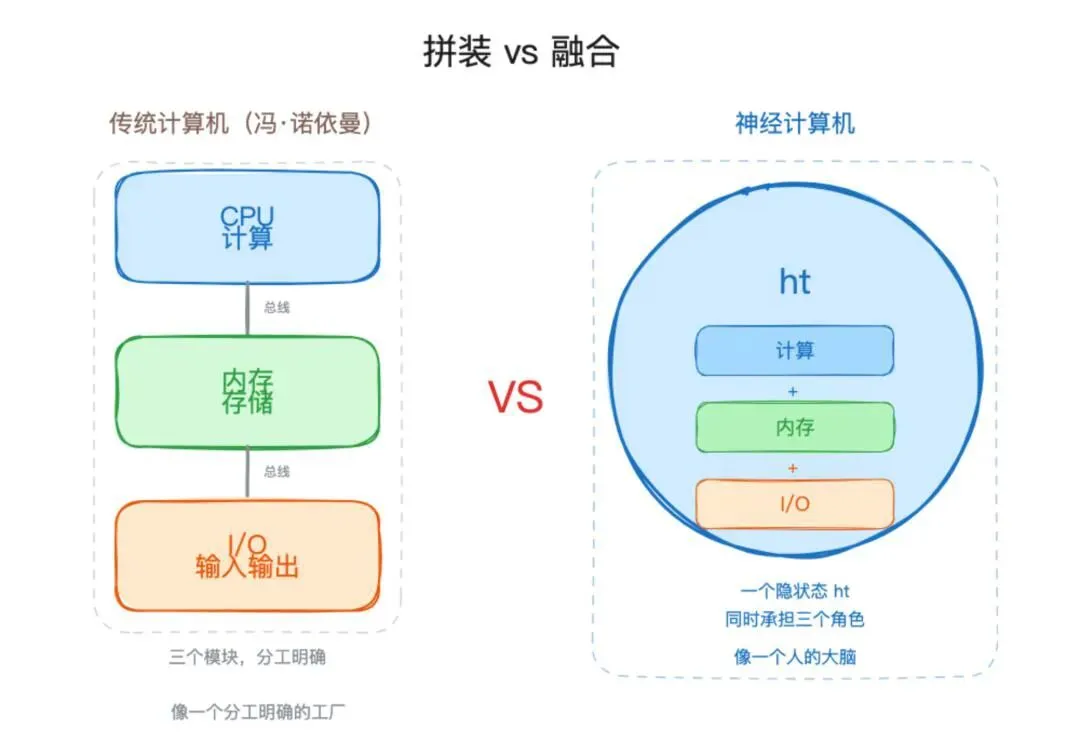

咱们现在用的所有电脑——笔记本、手机、服务器——都是冯·诺依曼架构。CPU负责算,内存负责存,键盘鼠标屏幕负责输入输出。三件事分给三个模块,用总线连起来,操作系统再在上面调调度。

这套体系从1945年用到现在,稳定、可靠、可编程。但它有个问题:太笨重了。

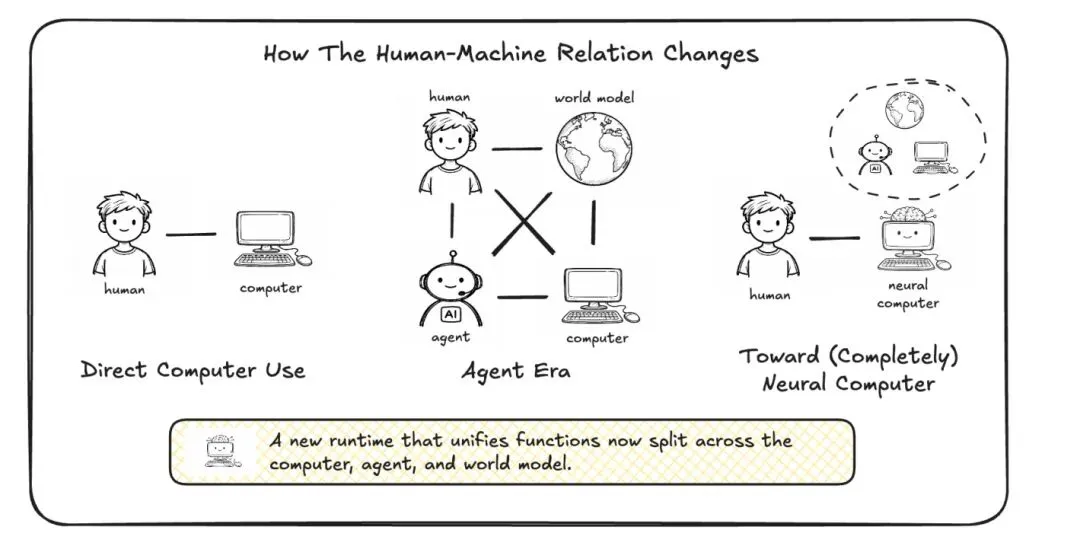

你让AI Agent帮你操作电脑,它得先读屏幕像素、理解界面、生成鼠标点击、等响应、再读屏幕……中间隔着操作系统、API、驱动程序、硬件抽象层,层层翻译,效率低得离谱。

Meta的想法很简单:干脆别翻译了,让AI直接接管计算机的所有功能。

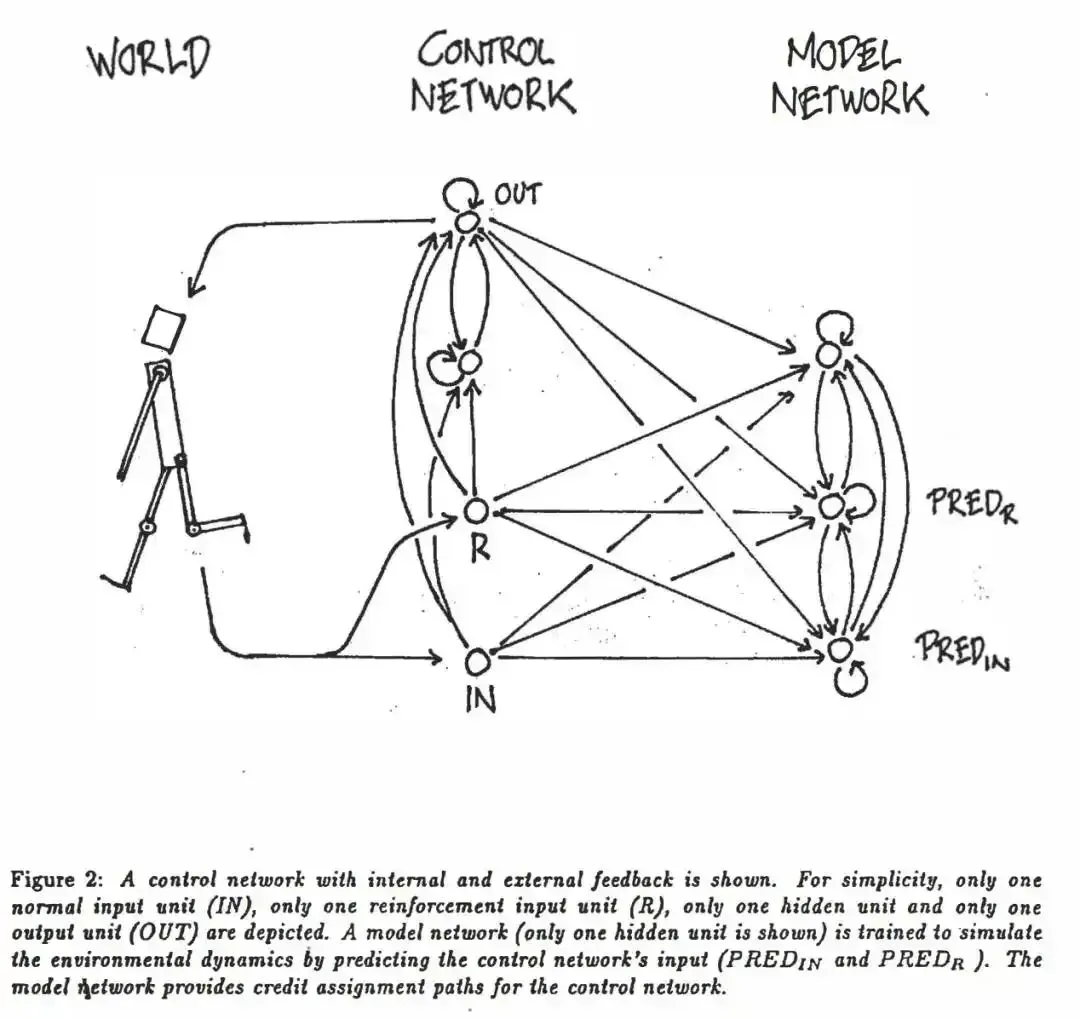

论文里提出了一个核心公式,把计算、内存、I/O全部折叠进神经网络的隐状态里。同一个隐状态,既当CPU用,又当内存用,还当显示器用。

说白了,传统计算机像一家分工明确的工厂,有车间、仓库、前台。而神经计算机……更像一个人,用同一个大脑完成思考、记忆和感知。

神经网络作为统一的计算、存储、渲染单元

他们真的做了个原型,虽然还很糙

概念是有了,能跑起来吗?

Meta团队做了两个原型来验证。他们用视频生成模型训练了一个能渲染终端界面的系统——就是那种黑底绿字的命令行窗口。

结果挺有意思:渲染质量很高,但算术几乎不会。

模型生成的终端画面跟真实画面几乎看不出区别,颜色、光标、滚动都还原得不错。但让它做数学题,比如10+15或者736×644,准确率只有4%。

这就暴露了一个根本问题:视频模型本质上是在学"画面长什么样",不是在学"怎么算"。

它看了大量终端画面之后,知道Python REPL的界面该是什么样子,但让它真正做符号计算……还差得远。

不过论文也提出了一个很有启发性的实验:如果把光标当成一个"视觉对象"来处理,在每一帧渲染一个小箭头让模型学习,算术准确率能从4%飙到98.7%。

这说明什么?对于视频模型来说,视觉信号远比数值信号更"友好"。

这事儿靠谱吗?我的判断是:方向对,但路还长

先说我支持这个观点的理由。

第一,Agent的瓶颈确实在"翻译层"。现在的AI Agent就像个外国人,想操作你的电脑,但不懂中文,必须通过翻译(API、操作系统、硬件驱动)一层层转达。如果能去掉这些中间层,让AI直接控制硬件,效率和灵活性都会大幅提升。

第二,计算范式确实在变化。从大型机到个人电脑,从PC到手机,每次计算平台的变迁都伴随着交互方式的革命。神经计算机如果真的能实现,将是继冯·诺依曼架构以来最大的计算机范式变革。

第三,Meta的技术储备够厚。这篇论文的作者阵容很强——诸葛明晨是Meta AI的核心研究员,Schmidhuber是LSTM的发明者、可微分世界模型的提出者。他们不是空谈,而是有技术路线图的。

但问题也很明显。

符号推理能力几乎为零。4%的算术准确率说明,现在的神经网络在抽象符号计算上依然是弱项。你可以让模型画出一张算式的图片,但让它真正算出结果,完全是另一回事。

传统CPU与神经网络计算范式的差异

传统CPU与神经网络计算范式的差异

长程一致性没验证。目前的实验都是短视频(约5秒),长时间运行下状态是否会漂移、行为是否会退化,还不得而知。

图灵完备性存疑。论文提出了一个"完全神经计算机"(CNC)的目标,要求满足图灵完备、通用可编程、行为一致、机器原生语义四个条件。坦白说,现在的原型一条都没达到。

如果真成了,对我们意味着什么?

先泼一盆冷水:短期内别指望换掉你的笔记本。

论文作者自己也估计,真正可用的神经计算机大概还要三年。而且说实话,三年可能都乐观了。

但如果真的实现了,影响会是颠覆性的。

软件行业会重构。现在的程序员写的是"明确的指令",未来的程序员可能只需要"描述意图"。自然语言会成为编程语言,用户的操作轨迹本身就是"程序"。

硬件行业洗牌。如果神经计算机真的能用,传统的CPU、GPU、内存芯片厂商都会面临巨大冲击。英伟达现在靠GPU赚得盆满钵满,但神经计算机可能根本不需要传统意义上的GPU。

AI Agent会质变。现在的Agent像个高级脚本,只能完成预设的任务。神经计算机如果真的能实现,Agent将拥有真正的"自主性"——不是调用工具,而是自己就是工具。

写在最后:这不是科幻,但也别急着换电脑

Meta这篇论文的意义,不在于他们做出了什么能用的东西,而在于提出了一个可能性。

过去几十年,计算机的演进一直在"功能叠加"——更快的CPU、更大的内存、更好的操作系统。而神经计算机的思路是"范式替换"——不是让计算机更强大,而是让AI成为计算机本身。

这个方向对不对?我觉得对。但能不能成?说实话,我不知道。

诸葛明晨在博客里写过一句话:"未来的神经计算机可能不应该模仿大脑,而应该模仿传统计算机的设计哲学,用离散的、稀疏的、可验证的计算原语来构建。"

这句话挺有意思。也许最终形态的神经计算机,既不是今天的神经网络,也不是今天的冯·诺依曼架构,而是某种融合了两者优势的新物种。

三年后再看吧。反正现在,我的MacBook Pro还是得继续用。

——— 🦞 养龙虾技巧 ———

读学术论文写科普文章时,不要堆砌术语,试着用自己的话翻译一遍。比如"隐状态"就是"神经网络的记忆","图灵完备"就是"什么都能算"。把术语翻译成大白话,读者才看得懂。

编辑:小哎

来源:arXiv 2604.06425、Meta AI、智源社区

📢 AI世界,哎咆为你精选。资讯快如咆,观点不随大流。

夜雨聆风

夜雨聆风