我刚接触AI时,总希望找到”那个最好用的 AI“,以为只要用上”最强AI“,再学习写出高阶提示词,就能”一招通“一个AI搞定所有事,所以我的关注点都放在改进提示词上,有时对着一个 AI 改十几遍提示词,但出来的回答都还是泛泛之谈,正确的废话,甚至有时瞎编数据;想找新点子,却越问越是老套路,感觉 AI 还没自己脑子灵。

随着对 AI 的了解多了,在实际应用中实践多了,踩了坑之后才发现:要多 AI 工具协作,才能把 AI 用出超预期效果。

一、为什么不能只依赖一个 AI?

1、模型的 "幻觉分布" 不同,交叉验证避大坑

每个 AI 都会编瞎话,行话叫 "幻觉",瞎编数据、瞎编法条、瞎编案例、瞎编步骤,写得比真的还像真的,不检验就会被误导。这是最要慎防的坑。

而每个 AI 的 "幻觉盲区" 都是不一样的,A 在历史问题上胡扯,B 在医学问题上胡扯,把同一个问题,同时发给 3 个不同的 AI,只要两个以上的模型给出了一致的答案,那这个答案的可信度就会大幅提升;如果三个答案各说各的,那这个问题大概率有坑,需要手动核对。

2、后训练导致固化:长期使用同一个 AI 会产生 "路径依赖",失去新鲜视角

很多人用 AI 越用越 "没灵感",核心原因是用单一 AI 产生 "路径依赖",这也是我自己一开始就陷入的坑。

当长期用同一个 AI,用固定的提问指令、逻辑、习惯,反复给它喂同类偏好风格的方案、内容,这个 AI 会越来越懂你,你一提问,它就知道你要什么风格、什么结构、什么侧重点,用起来确实越来越顺手,但结果也会是:你舒服了,可思路也变窄了,总在按老套路走。

跳出认知的新鲜视角,这恰恰是我们用 AI 最核心的价值之一。单靠一个用熟了的 AI,你永远只能在自己的固有认知里打转,而多 AI 协同,能不断给你新的思路和视角。

3、原生数据不同:知识覆盖和侧重点不同

AI 在成为得力助手前,必须先 "饱读诗书",这个阶段叫 "预训练"。

读什么书,决定它是什么样的人:各家公司给自家 AI 准备的 "书单" 是不同的。网页、书籍、论文、代码…… 每种 "书" 都塑造了 AI 不同的能力和气质。

这些差异,决定了 AI 的知识结构和思维方式的底色。单靠一个 AI,会受限于它书单里的知识边界,而多 AI 协同,才能把不同领域的知识组合在一起,拼成完整的认知版图。

4、架构设计不同:推理方式和效率不同

"原生数据" 是 AI 读的书,"架构设计" 是 AI 的 "思考习惯"。

就像同样解一道数学题,有人习惯先列公式再演算,有人习惯先举例子再推导,有人习惯先找易错点再反向验证。每家 AI 厂商的大模型,底层的神经网络架构、注意力机制、推理优化逻辑都完全不同,这直接决定了它想问题的 "思维路径" 大有差别。

如果让一个擅长快速写短文案的 AI,去做几十万字的行业报告拆解,提炼出来的肯定会丢三落四;反过来,让一个擅长长文本推理的 AI,去写幽默段子,肯定写得生硬,不接地气。只用一个 AI,相当于只能用一项 "特长" 干活,却要被迫接受其他的 "短板";多 AI 协同,就是把不同模型的长板拼在一起,拼成 "全面助手"。

5、每个 AI 模型的 "知识截止日期" 不同,导致时效性差异

所有的 AI 数据,都有一个数据训练截止日期,比如 ChatGPT 的知识可能停在 2024 年,DeepSeek 可能更新到 2025 年。不同厂商的数据模型,更新频率都不同:有的模型每个月都会迭代一次,把最新的行业规则、热点事件、技术更新都学进去;有的小众模型可能半年、甚至一年才更新一次,还停留在很早之前的老知识里。

多 AI 协同,用更新频率高的模型抓时效性内容,用知识沉淀深的模型做底层逻辑拆解,既不会错过新机会,也不会犯常识性错误。

6、模型的 "安全对齐" 边界不同,导致回答自由度不同

所有的 AI 在上线前,都会给 AI 定规矩,什么能说,什么不能说,什么内容要拒绝回答,这就叫 "安全对齐"。不同厂商的模型,对齐的尺度、边界、严格程度,完全不一样。

有的 AI 特别谨慎,动不动就说 "这个问题我无法回答",有的 AI 对齐尺度更宽松,只要不违规违法,就能给出非常落地、直白的实操方案;

多 AI 协同,就能在合规的前提下,拿到更全面、落地的内容,不会因为单个模型的对齐边界错过有用的信息。

7、同一模型在不同语言 / 文化上的表现差异

同一个模型,它的中文能力和英文能力,也可能有天壤之别。比如有的模型原生训练数据以中文为主,写中文文案接地气、有网感,但写英文内容全是中式英语;有的模型原生以英文为主,做海外内容地道流畅,但写中文内容生硬拗口。

多模型协同,就等于实现了语言和文化优势互补。

8、成本与效率的灵活调度

简单任务用免费模型,复杂任务(比如分析合同漏洞)再用付费模型。现在的 AI 工具收费有不同的差距,顶尖大模型的调用成本,可能是轻量化免费模型的几十倍,不是所有活都需要用最贵的模型干。

多模型策略,等于在质量和成本之间动态平衡。

二、唯一需要警惕的陷阱

但要注意:不要简单 "投票" 或 "取平均"。如果三个 AI 给出了三个完全不同的答案,我们作为最终的决策者,需要自己去判断、分辨哪个答案更准确、更符合需求、更贴合实际场景、逻辑更严谨。

否则,哪怕用了 10 个 AI,眼花缭乱,乱凑答案反而更糟,只会得到一个平庸的、甚至错误的结果。多 AI 协同,是让 AI 给我们提供更多的视角、素材、可能性,最终拍板的人,永远是我们自己。

很多人会说,我就是不会判断才用 AI,该怎么办?

做这关键的 3 步,90% 的情况都不会错:

第一步,先查 "事实类内容":凡是涉及数据、法条、规则、时间节点的内容,哪个 AI 给的内容能附上来源、能查到原始出处,就信哪个,没来源的直接丢掉;

第二步,再选 "适配类内容":凡是涉及文案、方案、创意的内容,哪个最贴合目标受众、最符合最终用途,就留哪个,不是选写得最好的,是选最能用的;

第三步,最后补 "亮点内容":把不同 AI 回答内容里的金句、新思路、避坑点,摘出来,补到主内容里,最终形成终稿。

三、正确的做法是:

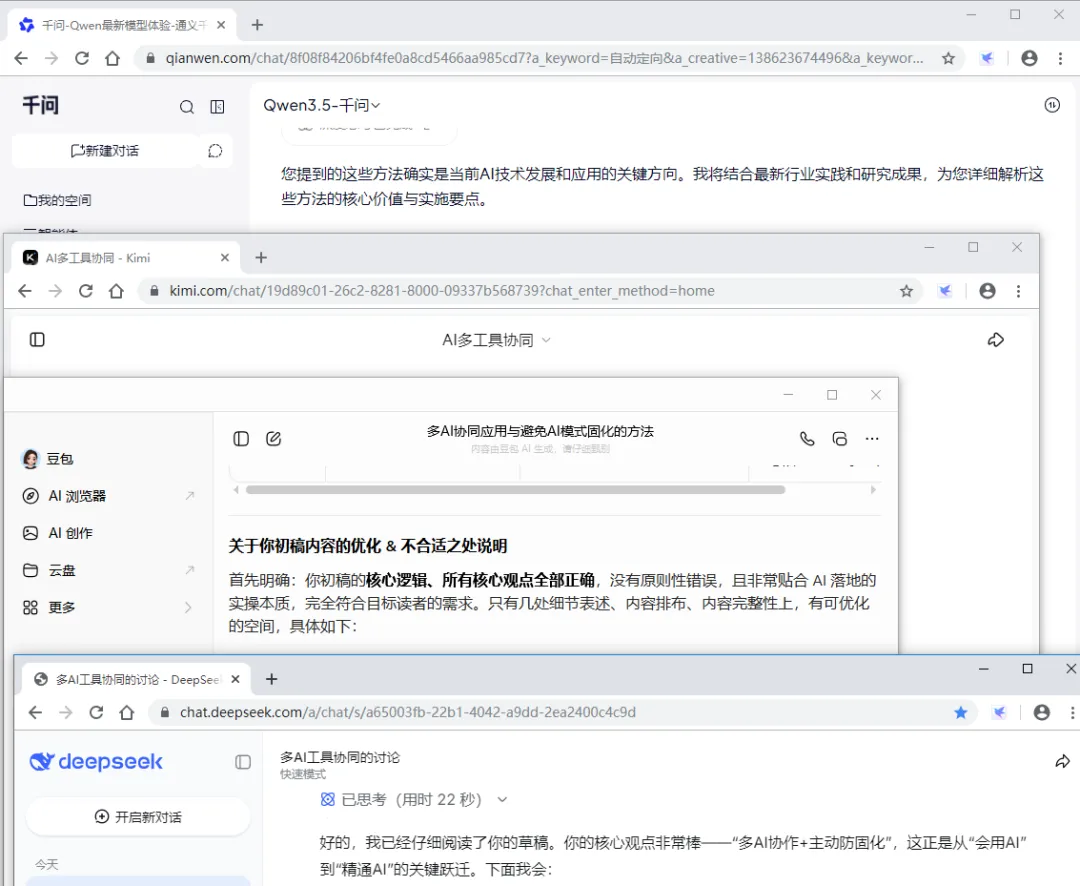

有两个方法是我日常用的:

第一个方法,让不同 AI 扮演不同角色,比如:一个负责创意发散,一个负责事实核查,一个负责逻辑整理,相当于搭了一个专属的全能团队。(不同角色提示词可以参考上一篇公众号文章)

第二个方法,先让多个 AI 各自产出,然后我们作为 "总编" 进行合成和取舍。

先把需求、指令,同步发给 3-5 个不同的 AI,让它们各自独立产出完整的内容,不要互相参考。等所有 AI 都产出结果后,我们再扮演 "总编" 的角色,把每个 AI 内容里的亮点、金句、好思路、好结构都挑出来,剔除掉错误的、平庸的、不符合需求的内容,然后重新融合、打磨、优化,形成最终的终稿。

这个方法的好处是,一次性拿到多个不同视角和思路的答案,不会被单个 AI 的固化思维限制,同时又能通过自己的审核,避开 AI 幻觉、内容平庸的坑。

同时也要和大家说的一个底层逻辑是:没有任何一个模型能在所有任务上都做到最优。每个 AI都有自己的 "偏科项",有的擅长写文案,有的擅长算数据,所以,多模型并行不是 "锦上添花",而是 "理性选择"。

四、除了多 AI 工具协作,避免模式固化的 6 个实用方法

1、换 "角色提示"

让 AI 换 "人设",强制 AI 跳出原有的 "习惯模式",进入陌生语境,它会立刻切换知识库和表达方式,产出完全不同类型的答案。

强性要求它 "必须跳出老思路",比如 "给我想 3 个我从来没试过的推广方法"、"给我写一个和我之前所有文案风格完全不一样的内容"、"给我挑出我之前方案里最死板的 3 个地方,全部改掉",甚至可以让它 "故意和我之前的要求反着来,看看会不会有更好的效果"。经常 "逼" 它换新的人设、角色,它就永远不会困在固定的套路里,能持续给出全新的思路。

2、强制 "反向提问"

持续问同类问题,AI 就会只给同类答案。让 AI 进行反思、反驳,打破思维定势。强制 AI 进入 "批判模式",比如让它充当最挑剔的评委,告诉它:"现在你是全世界最挑剔的评委,把这个方案里所有死板、没新意、按老路子来的地方,全挑出来,骂的越狠越好",然后再让它 "根据你挑的错,把这个方案全部推翻重写,不能用之前的任何一个老思路"。这样它就会跳出自己的固化模式,打破老套路,可以得到新的视角,而不是固化附和。

3、定期 "重置对话" 或 "换账号"

用了一段时间后,AI 已经被训练得完全按惯有的模式来了,可以定期给它 "清零":换个新的对话窗口、新建一个空白的知识库、甚至换个新账号,摒弃之前所有的训练内容、历史对话,重新给它喂新的东西、新的要求,它就不会困在之前的固化模式里, 重新产生新思路。

4、经常给它 "喂" 新内容

喂给 AI 什么内容,AI 就在什么内容的 "圈子" 里打转,慢慢变得固化。

想要打破这个僵局,就要不时给 AI 提供不同内容的资料、文案,拓宽它的信息边界。可以尝试每周给AI喂两类内容:一类是所在行业的最新爆款案例、行业报告,一类是跨行业的优质玩法、内容,绝对不要只喂自己的旧内容;

这样喂:

上传新文件内容的同时,加一句指令:"帮我把这份内容里,最有新意的 3 个玩法、3 个金句、3 个逻辑结构提炼出来,告诉我怎么用到我的 XX 具体工作里"。

就像人要多读书、多看世界,才不会思维固化一样,给 AI 喂的内容越新、越广,它的思路就会越开阔,出来的答案才不会老调重弹。

5、让 AI 拆步骤

一句话让 AI 一步出结果的方式恰恰是 AI 套用固定模板的重灾区。想要避免这个问题,就要把一个大任务,拆成 3 个以上的小步骤,每一步都让 AI 换角度、换思路,逐段推进,每一步都先给多个方案,再往下执行,它就不会从头到尾套用一个固定模板。

6、引入 "随机性参数"

大部分 AI 对话界面都有一个隐藏的 "温度" 参数,英文叫 Temperature。"温度" 越高,AI 的回答越随机、越有创意;温度越低,越固定、越保守。默认通常是中等。

一直用默认的 "随机性参数",AI 就一直按它认为 "最稳妥、最正确" 的模式来给答案。如果觉得 AI 翻来覆去都是老套路,可以试试把温度参数调高到 1.2-1.5 之间,同一个 AI,立刻就能生出多种 "性格",给出完全不一样的答案。

但要谨记:如果是做严谨的事实核查、数据计算,就把温度调低到 0.2-0.5 之间,保证内容的准确性。

最后,我还想和大家分享,最开始,我总想找到那个万能的、最好用的工具,但实际上,当越了解AI的底层逻辑、自己交流的思路越清晰,就越能发挥去AI的效果。这些AI工具好不好用,也是在要使用中练出来的。

所以最重要的是实操应用起来,把今天要写的文案、正在做的方案,同时复制发给 3 个不同的 AI,看看它们给的答案,有什么你之前没想到的亮点。

-------------------------------------

想第一时间了解AI新资讯,想系统学AI,欢迎加入AI实战社群。

群里每天都有AI玩法和教程,从零基础到上手,职场提升效率、生活增添乐趣、搞钱更有效益。

夜雨聆风

夜雨聆风