导读:英伟达开源全球首个量子AI模型家族,它野心很大,要成为量子计算机领域的操作系统

今天,4月14日,是"世界量子日"。

英伟达选在今天,开源了:

一个叫 Ising 的开源 AI 模型家族

这是全球首个开源量子 AI 模型系列,目标是帮助研究人员和企业能够运行实用性的软件,而不是实验室跑的那种测验小Demo

黄仁勋说了这么一句话:

"AI is essential to making quantum computing practical. With Ising, AI becomes the control plane — the operating system of quantum machines."

翻过来就是:

AI 要当量子计算机的操作系统

这话很大!到底干了什么,一起来看。

量子计算机为什么牛?

先说清楚一件事,为什么全世界都在押注量子计算机?

传统计算机用的是经典比特:一个比特要么是 0,要么是 1。

量子计算机用的是量子比特,它能同时是 0 和 1——这叫"叠加态"。

再加上"纠缠"——两个量子比特一旦纠缠在一起,它们的状态是关联的,无论相隔多远。

这两个特性叠加起来,产生的计算能力不是线性增长,是指数级增长。

上面的话可能很多人不清楚,我引用一个经典比喻:

走迷宫,传统计算机是一条路一条路试。

量子计算机是一口气同时试所有路径。

理论上,量子计算机能解决一些对经典计算机来说"不可能完成"的问题

比如模拟药物分子如何与人体蛋白结合、破解现代加密算法、做全球级别的物流优化……

这些问题,经典计算机算到宇宙灭亡也算不完,但量子计算机可以!

可量子计算机有个前提:它必须稳定、必须可靠。

传统量子计算机现在“烂”在哪?

第一个:量子比特太容易出错。

传统比特只有 0 和 1,很稳定。

量子比特能同时是 0 和 1——这是量子计算威力的来源,但也是它的软肋。

温度、振动、电磁干扰,任何一点扰动都能让量子比特出错。

每做 1000 次操作,大约出 1 次错误。

要做到"实用量子计算",这个错误率要降到万亿分之一级别。

差了多少?

差了大概 10 亿倍!

这就是为什么量子纠错是这个领域最核心的挑战。

第二个:校准要花几天时间。

量子处理器运行之前,需要校准——确保每个量子比特的行为符合预期。

问题是,量子比特会漂移。温度变一点、外部干扰变一点,昨天校准好的今天就失效了。

传统方法:人工调参,跑测试,循环往复。

一次完整校准,需要几天时间。

量子芯片越来越复杂,靠人手调参根本撑不住规模。

这就是为什么它现在的问题这么致命,量子计算机只能是实验室研究,距离落地遥遥无期的原因

英伟达这次发布的量子AI模型Ising 是什么?

英伟达发布的 Ising 包含两个模型,分别解决上面两个问题。

解码速度比传统方案快2.5倍,精度高3倍,芯片校准也从过去的几天缩短为几小时。

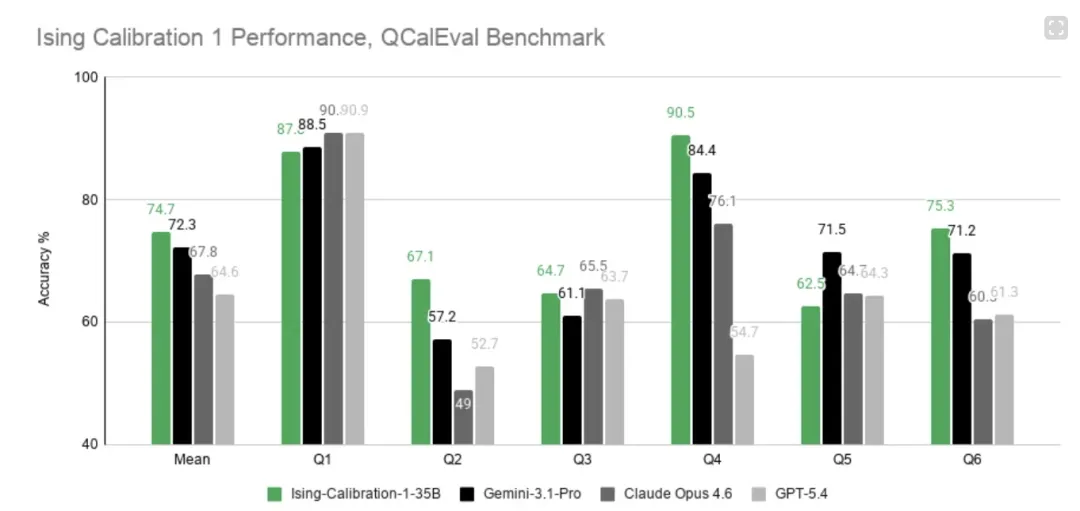

第一个:Ising Calibration

这是一个视觉语言模型(VLM),350 亿参数。

它能读取量子实验输出的数据(通常是图表和测量结果)

比对实际结果和预期趋势,自动判断哪里出了偏差、该往哪调 在 AI Agent 工作流里自动完成校准,不需要人盯着

效果:校准时间从几天压缩到几小时。

基准测试(QCalEval)里,Ising Calibration 的表现超过了 Gemini 3.1 Pro(+3.27%)、Claude Opus(+9.68%)、GPT(+14.5%)。

这个比较有点语境:这是在量子校准这个专项任务上的得分,不是通用能力对比。

专项场景里,专用模型打赢通用大模型不奇怪。

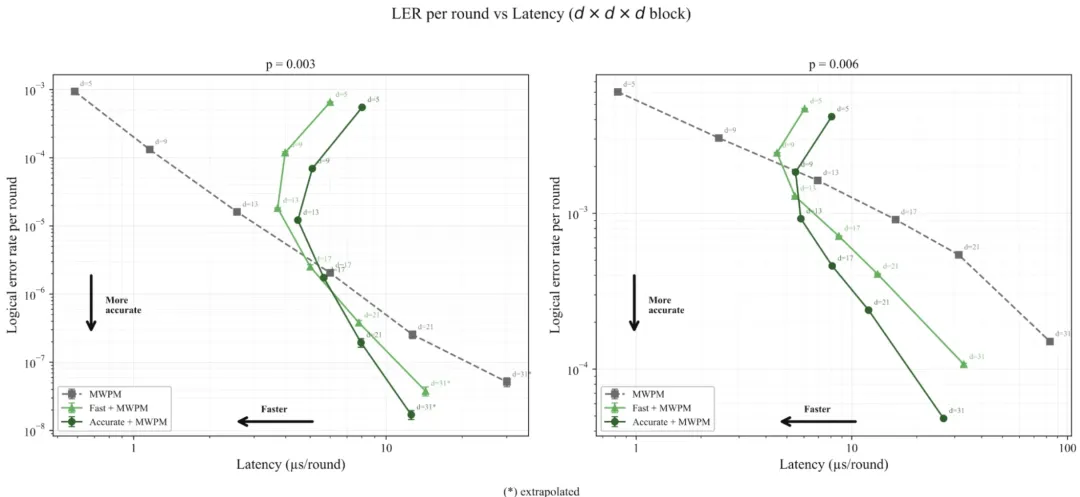

第二个:Ising Decoding

这是两个 3D CNN 模型,做实时量子纠错解码。

量子计算运行时会持续产生"错误综合征"——简单来说,就是错误发生的信号。

纠错解码器需要实时读取这些信号,推断哪里出了错,并在出错影响结果之前修正。

这个过程对延迟要求极高,几微秒级。

Ising Decoding 有两个版本:

对比基准是 pyMatching,目前开源社区里最主流的量子纠错解码方案。

在 d=13、p=0.003 的条件下(专业参数,量子码距和错误率),延迟约 2.33 微秒/轮,最快可到 0.11 微秒/轮。

名字是怎么来的?

Ising,取自物理学中的"伊辛模型"(Ising Model)。

这是 1920 年代物理学家恩斯特·伊辛(Ernst Ising)提出的一个数学模型

用来描述磁性材料里大量粒子之间的相互作用。

为什么叫这个名字?

因为伊辛模型干的事,就是把一个极其复杂的多体系统,简化成可以计算的形式。

这正是 Ising AI 模型在量子计算里想做的,把复杂混乱的量子错误,变成可以处理的信号。

这套模型全部开源,Apache 2.0 协议。

模型权重放在 Hugging Face 和 NVIDIA NIM 上,代码和训练框架都在 GitHub 上。

还附带了"工作流手册",告诉你怎么针对自己的硬件架构微调模型。

开源 + 可微调,意味着不同硬件路线的团队可以直接拿去用。

目前客观来看怎么样?不吹不黑,中立客观说下

校准从几天到几小时,是可以验证的实际效果,不是概念。纠错解码 2.5x 速度提升 + 3x 准确度提升,有具体测试数据支撑。

纠错解码的测试是在"面码(Surface Code)"体系下做的,属于特定场景。量子纠错有很多不同编码方案,其他方案是否有这么好的效果?还是个未知数

更大的问题没解决, Ising 解决的是"怎么更快更准地纠错",但当前量子计算的根本瓶颈,物理量子比特的错误率、规模化制造、逻辑量子比特所需的开销这些还在路上。

一个参考数字, 据 Resonance 数据,量子计算市场 2030 年预计超过 110 亿美元。

这是一个还在成长的早期市场,不是已经爆发的市场。

老黄,这个在十多年前押注AI的男人,又开始压住下一次技术革命

项目地址:

https://github.com/NVIDIA/ising

参考资料:

GitHub:https://github.com/NVIDIA/ising 官方技术博客:https://developer.nvidia.com/blog/nvidia-ising-introduces-ai-powered-workflows-to-build-fault-tolerant-quantum-systems 模型权重(Hugging Face):https://huggingface.co/collections/nvidia/nvidia-ising 英伟达新闻稿:https://nvidianews.nvidia.com/news/nvidia-launches-ising-the-worlds-first-open-ai-models-to-accelerate-the-path-to-useful-quantum-computers

夜雨聆风

夜雨聆风