如果你对人工智能(AI)的发展史稍有了解,可能会发现一个有趣的现象:AI似乎在2012年左右“突然”变得厉害起来。手机可以精准识别人脸,聊天机器人能对答如流,这一切的背后,有一个关键的转折点。今天,我们就来聊聊这个故事,看看AI究竟是如何迈过那个关键门槛的。

一场改变一切的“AI高考”

在2012年之前,AI识别图像的主流方法,有点像我们小时候学认字:

老师(研究人员)会先总结好规则——比如“猫有尖耳朵、胡须和圆眼睛”,然后告诉计算机(AI)按照这些规则去判断。这种方法被称为“人工设计特征+统计模型分类”。它的瓶颈很明显:人类能想到和定义的“特征”是有限的,而且不一定是最优的。

为了推动技术进步,学术界在2010年发起了一场大型竞赛——ImageNet挑战赛。简单说,这就是给AI出的“高考”:比赛提供超过120万张标注好的图片(涵盖1000个类别,如猫、狗、汽车等),让不同的AI模型去识别,看谁犯错最少。评测采用 top-5错误率,即AI有5次猜测机会,如果5次都没猜中才算错。这很像我们认人:如果看到一张陌生人的照片,你猜了“演员A、演员B、运动员C、歌手D、哦!原来是科学家E”,只要在五次内猜对,就算你认出来了。

前两年的比赛结果很“正常”:

- 2010年

冠军错误率为28.2%(相当于100张图认错28张)。 - 2011年

冠军错误率为25.8%,仅仅进步了2.4个百分点。 大家觉得,AI的进步大概就像挤牙膏,每年进步一点点。

然而,2012年10月,比赛结果公布时,所有人都惊呆了。 一个名叫 AlexNet 的模型,由多伦多大学的Geoffrey Hinton教授和他的两位学生Alex Krizhevsky、Ilya Sutskever创造,将错误率一举降至 15.3%。 而第二名,错误率是26.2%。

AlexNet领先了第二名超过10个百分点!

整个AI研究社区的第一反应是:“他们是不是作弊了?” 因为这完全不像是在原有赛道上的改进,而像是直接开辟了一条新路。ImageNet的创建者李飞飞教授后来回忆,当时神经网络被很多人视为“陈列在玻璃柜里的老古董”,而AlexNet的成绩让她立刻改变了行程,飞赴会议现场。

AlexNet成功的三大支柱:数据、算力、算法

为什么AlexNet能如此颠覆?不是因为它用了什么神秘魔法,而是它将三把早已存在的“钥匙”——海量数据、强大算力、巧妙算法——在2012年这个时间点,完美地插入了同一把锁中。

1. 燃料:ImageNet——前所未有的大规模数据

在AI学习中,数据就是“粮食”。以前给AI“喂”的“粮食”(数据集)只有几千到几万张图片,它很容易“挑食”和“死记硬背”(过拟合),学不会通用规律。

李飞飞教授的团队从2007年开始,做了一个当时看来很“疯狂”的决定:建立一个媲美人眼识别能力(约3万种类别)的巨型图片数据库。他们通过亚马逊众包平台,雇佣了来自167个国家的近5万名标注员,从超过1.6亿张图片中筛选、标注,最终建成了包含超过1400万张标注图片的ImageNet数据集。

这相当于给AI准备了一个包罗万象的“视觉百科全书”,让它真正能够“见多识广”,从中学习到事物最本质的特征,而不是记住几张特定图片的细节。

2. 引擎:GPU——被“挪用”的游戏显卡

有了“粮食”,还得有强大的“消化系统”(算力)来处理。AlexNet有6000万个参数需要调整,训练它意味着对120万张图片每张进行数千万次运算,并且要反复学习很多遍。如果用当时的电脑CPU来计算,可能需要好几个月甚至几年。

AlexNet团队的天才之处在于,他们使用了游戏显卡(GPU) 来进行计算。CPU像一位技艺精湛但一次只能炒一盘菜的大厨;而GPU则像成千上万个只会切菜、搅拌的帮厨,可以同时处理大量简单的任务(如图形渲染中的像素计算)。神经网络的训练恰好就是海量的简单乘加运算。

早在2009年,吴恩达教授团队就证明GPU能将AI训练速度提升约70倍。AlexNet团队使用了两块当时售价约500美元的NVIDIA GTX 580游戏显卡,将原本可能旷日持久的训练,压缩到了5-6天。这为深度神经网络的训练打开了算力的大门。

3. 蓝图:算法创新——让深度网络“学得动”

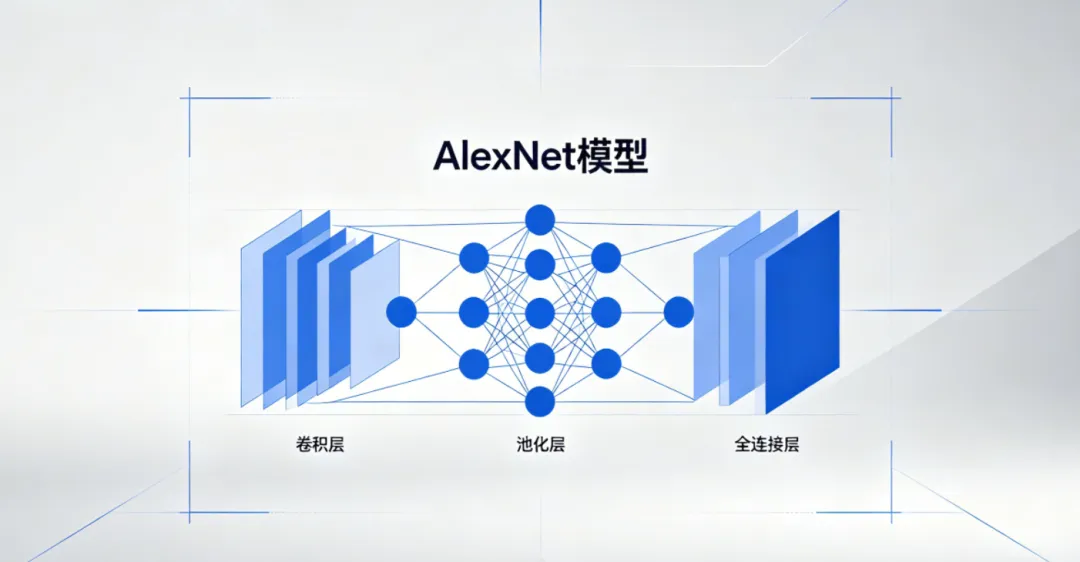

有了燃料和引擎,还需要一份高效的“汽车设计图”(算法)。AlexNet的核心是一种叫做“深度卷积神经网络”的结构,它模拟了人脑视觉皮层分层处理信息的过程:底层看边缘,中层看形状,高层看物体部件。

但在当时,训练深层网络有两个主要难题:

- 梯度消失

信号在多层网络中反向传播时,会越来越弱,导致前面的层几乎学不到东西。这就像一群人传话,传到最后完全走样。 - 过拟合

模型只记住了训练数据的细节,而无法泛化到新数据,好比学生死记硬背了三道题答案就去考试。

AlexNet用了两个精巧的“设计”解决了它们:

- ReLU激活函数

它像个“单向阀”,只让正数信号通过,将负数归零。这个简单的改变,让训练速度大幅提升,并有效缓解了梯度消失。 - Dropout(随机丢弃)

在训练过程中,随机“关闭”一部分神经元。这迫使网络不能依赖任何特定的神经元组合去记忆,必须学习更鲁棒、通用的特征。就像老师考前随机划掉一部分允许使用的公式,逼着学生真正理解原理。

化学反应:当三要素历史性地交汇

在2012年之前,神经网络的理论(算法)早已存在,但总是缺这少那:

- 90年代

算法有了,但数据太少,算力太弱(CPU算不动),只能玩玩手写数字识别。 - 21世纪初

数据在增长,算力在进步,但算法遇到瓶颈(梯度消失),神经网络被打入“冷宫”。

而到了2009-2012年:

- 数据

ImageNet成熟,提供了百万级标注数据。 - 算力

GPU的强大并行计算能力被验证适用于AI训练。 - 算法

ReLU、Dropout等技术出现,让训练深层网络成为可能。

三把钥匙终于同时到位,拧开了深度学习爆发的大门。

如果没有李飞飞构建ImageNet,如果没有GPU的普及,如果没有Hinton团队对神经网络的坚持,AI的爆发会推迟吗?或许会。但技术发展的洪流往往如此,当数据积累、硬件迭代和理论创新这三条线走到历史的交汇点时,突破便成为必然。

2012年的AlexNet,就是这样一个“完美风暴”的时刻。它告诉我们,真正的突破性进步,往往不是沿着旧地图更努力地挖掘,而是找到一张全新的地图。

夜雨聆风

夜雨聆风