4天用AI重写Claude Code,他们到底做到了什么?

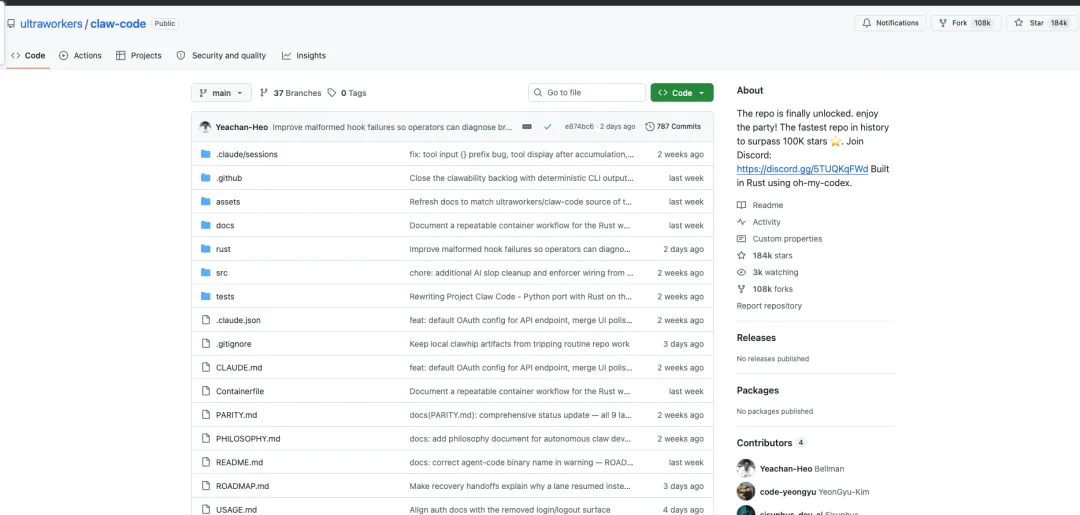

4月初,Claude Code源码泄露事件还没降温,一个叫Sigrid Jin的开发者放了个大招:用AI辅助,4天把Claude Code的核心架构用Rust重写了一遍,产出4.8万行代码,GitHub狂揽18.4万星。

新闻铺天盖地,但真正值得琢磨的不是“4天4.8万行”这个数字——它被严重夸大了。真实情况是:4人团队,4天,完成了约70%核心功能的Rust原型,距离生产级还差得远。

今天咱们不吹不黑,把这个项目扒开,看看到底怎么用AI辅助重写一个大型系统,以及我们能从中抄到什么作业。

一、claw-code到底做到了什么?

先说结论:一个非常优秀的技术Demo,但不是生产级替代品。

根据项目公开的技术报告和社区行为测试,claw-code复刻了Claude Code约**70-75%**的核心功能。模块完成度如下:

整个项目采用6模块分层架构,Agent loop核心代码只有88行。精简,但远不够健壮。

安全是最大的坑:Claude Code作为一款会执行Shell命令的工具,安全验证机制不完善意味着在生产环境使用它,存在相当风险。

二、AI辅助重写的核心工作流:OmX三层架构

Sigrid Jin团队真正的杀手锏不是代码,而是用AI驱动整个重写过程的工程方法。这套工作流的核心是一个叫OmX(Oh My CodeX)的编排层。

OmX是什么?

它不是AI模型,而是为OpenAI Codex CLI专门设计的工作流编排层和增强工具。简单说,模型像一台强大的发动机,OmX就是给这台发动机配上了方向盘、变速箱和导航系统。

OmX的三层架构:

第一层:工作流编排(OmX核心)

OmX通过一系列“元技能”指令,将模糊的需求转化为严谨的工程流程:

$deep-interview | ||

$ralplan | ||

$ralph | ||

$team |

一个典型的OmX配置示例:

tasks:

-name:"分析原始API契约"

agent:"gpt-5.4"

input:"从Claude Code行为反推API接口定义"

output:"api_spec.json"

-name:"生成Rust类型定义"

agent:"gpt-5.4"

input:"api_spec.json"

output:"src/api/types.rs"

depends_on:["分析原始API契约"]

-name:"实现MCP协议注册表"

agent:"claude-4.6"

input:"MCP规范文档"

output:"src/mcp/registry.rs"

review:true# 需要人工审查

第二层:代码生成引擎(GPT-5.4 / Claude 4.6)

执行层用的是当前最顶级的模型(如GPT-5.4或Claude 4.6),根据OmX生成的计划逐块生成Rust代码。关键技巧是把任务粒度拆得非常细——每次只生成一个函数或一个模块,而不是整个文件。

# 一个有效的生成prompt模板

任务:实现Rust版本的`execute_command`函数

要求:

1. 接收cmd: &str和cwd: Option<&Path>

2. 返回Result<String,CommandError>

3. 必须记录执行日志

4. 必须设置超时(30秒)

输出格式:只输出代码,不要解释。

第三层:AI自审闭环

每生成一段代码,立即触发自动化检查:

编译检查( cargo check)单元测试( cargo test)安全规则扫描(自定义脚本)

失败时,错误信息直接喂回AI,让它自己修复。这个循环可以持续多轮,直到通过。

一个典型的工作会话记录(来自项目公开的Telegram截图):

[09:12] OmX: 分配任务 #342 - 实现MCP协议注册表

[09:12] GPT-5.4: 开始生成... 预计1200行Rust

[09:18] GPT-5.4: 生成完成,触发编译检查

[09:19] ❌ 编译失败:3个错误(未解析的符号)

[09:19] GPT-5.4: 读取错误日志,修复中...

[09:22] ✅ 编译通过,触发单元测试

[09:25] ❌ 2个测试失败(边界条件处理错误)

[09:25] GPT-5.4: 分析失败原因,修复中...

[09:28] ✅ 所有测试通过。耗时16分钟。

三、为什么生产环境不能用?

claw-code项目作者自己在README里写了:“Not ready for production use.” 主要原因:

1. 安全验证机制不完善

作为一款会执行Shell命令的工具,Claude Code类应用需要完善的安全验证。claw-code目前在这方面还有明显短板,比如对高危命令的拦截能力有限。

这暴露了AI工程化的核心问题:用AI写代码不难,难的是如何安全地驾驭AI(Harness Engineering)。 一个生产级的AI系统,必须在代码执行路径上嵌入多道安全闸门:输入过滤、工具权限控制、输出审计、运行时沙箱。缺少任何一道,都是在裸奔。

2. 会话管理不完整

官方Claude Code有4层上下文压缩机制,claw-code只实现了最基础的一层。长会话会导致内存溢出或Token爆炸。

3. 未经过大规模测试

官方Claude Code经过了数万开发者、数百万次会话的实战考验。claw-code只在少量测试用例上验证过。

四、可复用的“AI迁移老项目”工作流模板

虽然claw-code不能直接用,但它的工作流完全可以照搬到你自己的项目里:

步骤1:建立任务清单(人工)

把老项目的功能模块拆解成独立任务,粒度要细:

[ ] 模块A:解析配置文件

- [ ] 读取YAML文件

- [ ] 验证必填字段

- [ ] 合并默认值

[ ] 模块B:建立日志系统

- [ ] 初始化logger

- [ ] 支持多级别输出

- [ ] 日志轮转

步骤2:编写AI生成Prompt模板

你是一个资深Rust工程师。任务:实现[模块名称]。

输入规范:[粘贴接口定义]

输出要求:

- 只输出代码,不要解释

- 必须包含错误处理(Result<T,E>)

- 必须包含单元测试

- 禁止使用unsafe代码

参考示例:[粘贴1-2个类似模块的实现]

步骤3:建立自动化验证流水线

#!/bin/bash

# 每次AI生成代码后自动运行

# 1. 编译检查

cargo check --message-format=json > check_result.json

# 2. 运行测试

cargo test -- --format=json > test_result.json

# 3. 安全扫描

./scripts/security_scan.sh src/

# 4. 失败时把错误信息喂回AI修复

if [ $? -ne 0 ]; then

cat check_result.json test_result.json | ai-fix

fi

步骤4:人工审查关键点

AI生成的代码必须人工审查:

[ ] 错误处理是否完整(没有 unwrap())[ ] 资源是否正确释放(文件句柄、网络连接) [ ] 并发安全(没有数据竞争) [ ] 无命令注入风险

五、最后说两句

4天4.8万行Rust,18万星——这些数字很燃,但别被带偏。claw-code的真正价值不是“替代Claude Code”,而是第一次完整公开了一套用AI辅助重写大型系统的工程方法。

把工作流拆成“编排-执行-自审”三层,把任务粒度打碎到函数级别,让AI在闭环中自我修复——这些才是你真正能抄的作业。

至于生产环境?还是老老实实用官方工具,或者等claw-code把安全短板补上再说。毕竟,AI替你写的代码如果删了库,可不会替你背锅。

从“手写砖头”到“驾驭AI”,这不仅是技术栈的升级,更是开发者角色的跃迁。 未来的核心竞争力,属于那些能通过架构设计、工作流编排和安全兜底来统帅AI的人——这才是“AI超级协作者”的真正含义。

如果你也在用AI重构老项目,或者被AI写代码的安全问题困扰过,点个在看,让更多人看到这份实战复盘。

夜雨聆风

夜雨聆风