Claude Code 是目前公认最强的 AI 编程 Agent,但它默认只能用 Anthropic 自家的 Claude 模型。对国内开发者来说,官方服务不仅贵,还有封号风险。

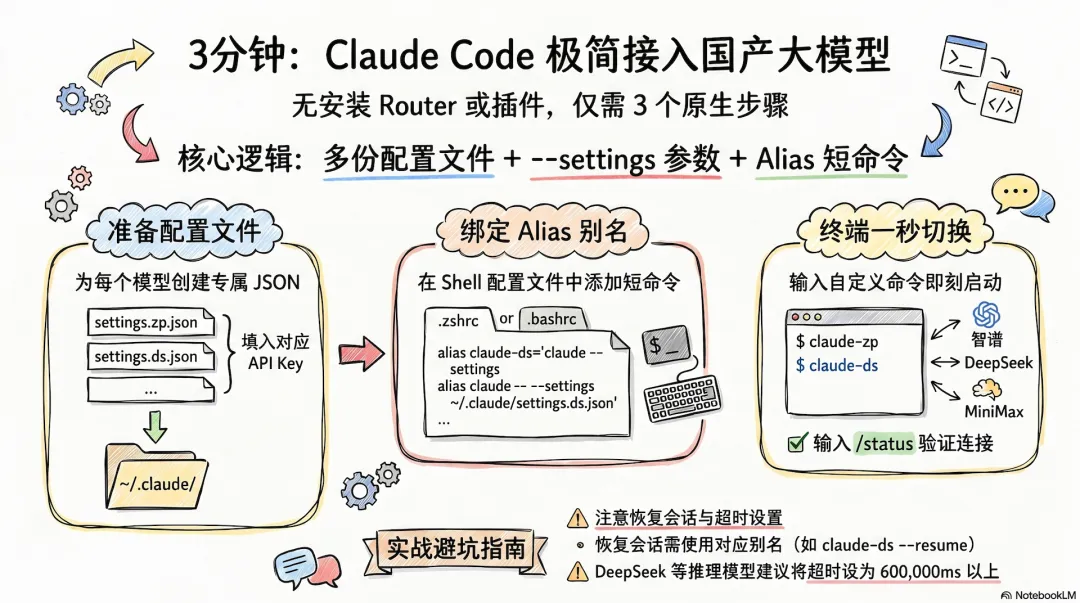

好消息是,国内的智谱、DeepSeek、MiniMax 都已经提供了兼容 Anthropic API 的接口。我们完全可以用一个极其轻量的方案,让 Claude Code 无缝切换到这些国产模型——不装 Router,不装 CC-Switch,只靠配置文件 + alias。

方案思路

Claude Code 有一个 --settings 参数,可以指定不同的配置文件启动。

我们的做法很简单:

第一步,在 ~/.claude/ 目录下,给每家大模型各建一个 settings.xxx.json。

第二步,在 ~/.zshrc 里用 alias 绑定短命令。

第三步,终端里输入不同命令,一秒切换模型。

~/.claude/ ├── settings.json ← 默认模型 ├── settings.zp.json ← 智谱 GLM ├── settings.ds.json ← DeepSeek └── settings.mm.json ← MiniMax

这个方案的好处是:各项目的模型调用互不影响,出问题秒回滚,而且完全不依赖任何第三方工具。

实操:创建配置文件

每个配置文件的核心就是四个环境变量。以下是三家平台的模板,替换 API Key 即可使用。

智谱 GLM

文件路径:~/.claude/settings.zp.json

{ "env": { "ANTHROPIC_AUTH_TOKEN": "替换为你的智谱Key", "ANTHROPIC_BASE_URL": "https://open.bigmodel.cn/api/anthropic", "API_TIMEOUT_MS": "3000000", "CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": "1" } }

智谱目前可用模型包括 glm-5、GLM-4.7、glm-4.6 等,如需指定可以加一行 "ANTHROPIC_MODEL": "GLM-4.7"。智谱还提供 GLM Coding Plan 订阅套餐,Lite 档月费 49 元起。

DeepSeek

文件路径:~/.claude/settings.ds.json

{ "env": { "ANTHROPIC_AUTH_TOKEN": "替换为你的DeepSeek Key", "ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic", "ANTHROPIC_MODEL": "deepseek-chat", "ANTHROPIC_SMALL_FAST_MODEL": "deepseek-chat", "API_TIMEOUT_MS": "600000", "CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": "1" } }

如果需要推理能力更强的模型,把 deepseek-chat 换成 deepseek-reasoner。

MiniMax

文件路径:~/.claude/settings.mm.json

{ "env": { "ANTHROPIC_AUTH_TOKEN": "替换为你的MiniMax Key", "ANTHROPIC_BASE_URL": "https://api.minimaxi.com/anthropic", "ANTHROPIC_MODEL": "MiniMax-M2.7", "API_TIMEOUT_MS": "600000", "CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": "1" } }

⚠ 特别注意:MiniMax 的域名是 api.minimaxi.com(带 i),不是 api.minimax.io。写错会报 401 错误,我自己就踩过这个坑。

配置 Alias

在 ~/.zshrc(bash 用户编辑 ~/.bashrc)末尾添加:

# Claude Code 模型切换alias claude-zp="claude --settings ~/.claude/settings.zp.json"alias claude-ds="claude --settings ~/.claude/settings.ds.json"alias claude-mm="claude --settings ~/.claude/settings.mm.json"

然后执行 source ~/.zshrc,或者直接新开一个终端。

使用方式

配置完成后,使用就非常简单了:

输入 claude:使用默认 settings.json 里的模型 输入 claude-zp:走智谱 GLM 输入 claude-ds:走 DeepSeek 输入 claude-mm:走 MiniMax

启动后输入 /status 可以确认当前连接的模型。

在 VSCode 等 IDE 里,Claude Code 插件默认读取 settings.json,所以把你最常用的模型配置放在默认文件里就好。

踩坑记录

恢复会话要用对命令

Claude Code 恢复会话时会提示 claude --resume xxx。如果当初是用 claude-mm 启动的会话,恢复时一定要换成 claude-mm --resume xxx,否则会用错模型。

超时问题

推理类模型思考时间长,API_TIMEOUT_MS 建议设大一些。DeepSeek 推荐 600000(10 分钟),智谱推荐 3000000。

关于本地反代

智谱、DeepSeek、MiniMax 三家都已经原生兼容 Anthropic API,直连就行,不需要搭反代。只有想接不兼容的模型(比如 GPT、豆包、本地 Ollama)时,才需要用 LiteLLM 等工具做协议转换。

与其他方案的对比

如果你只是需要在几个模型之间切换,本方案完全够用。如果需要按任务类型自动路由到不同模型(比如日常编码走便宜模型、复杂推理走 DeepSeek-Reasoner),那可以考虑 Claude Code Router。

总结

核心就三步:

给每个模型写一个 settings.xxx.json 用 alias 绑定短命令 终端输入对应命令即可

不装软件,不配代理,不搞路由。简单、稳定、可回滚。

如果你也在用 Claude Code 接入国产模型,欢迎评论区交流你的配置方案。

如果觉得有用,欢迎转发分享 🙏— 点赞 · 在看 · 关注 —

夜雨聆风

夜雨聆风