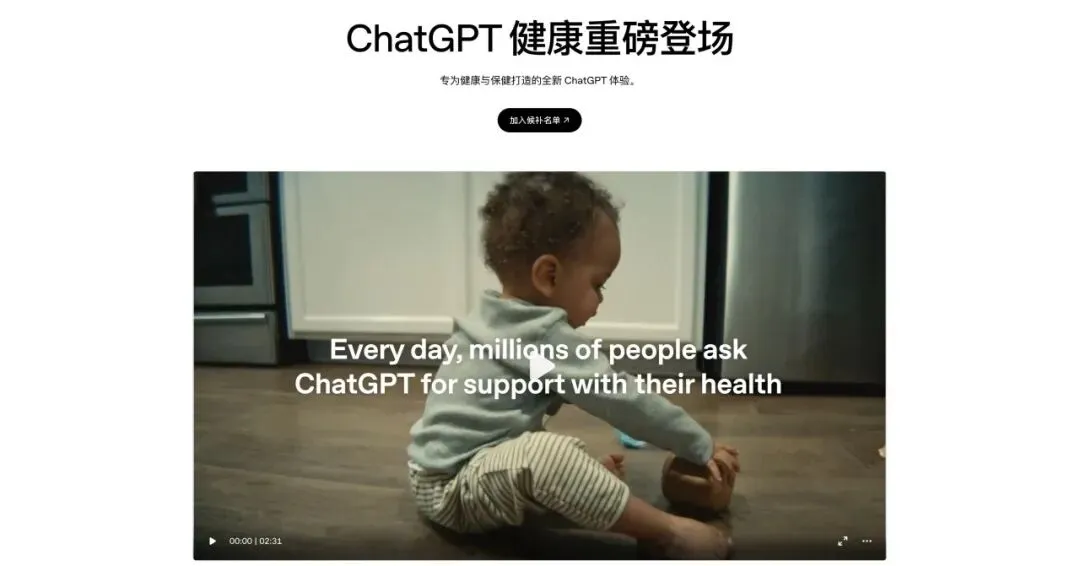

当前医疗系统面临医护短缺与成本高昂的困境。为此,科技巨头纷纷推出如ChatGPT Health等人工智能健康助手,鼓励用户上传病历并连接可穿戴设备以获取定制医疗建议。这一方案虽缓解了公众的健康咨询压力,却让海量敏感数据脱离了传统医疗隐私法规的监管,引发了对数据滥用与AI误诊风险的深刻担忧。

01

医疗系统承压,AI成为大众看病新路径

面对高达2200亿美元的医疗债务和日益严重的医护人员短缺(预计到2028年将面临11.4万名医生的缺口),美国的医疗系统正面临巨大压力。在此背景下,每天有高达4000万人向ChatGPT寻求帮助,用于解读复杂的医疗账单、处理保险理赔或管理自身疾病。

科技巨头看到了这一需求,不再满足于仅开发临床级AI。今年1月,OpenAI推出了面向消费者的ChatGPT Health,鼓励用户上传个人病历以获取量身定制的医疗协助。随后,亚马逊和微软等巨头也相继推出了类似的人工智能健康助手。

02

隐私脱轨:未受传统法规保护的“灰色地带”

尽管AI健康工具带来了便利,但隐私监督机构对此发出了强烈警告。在美国,医疗数据主要受1996年出台的HIPAA(健康保险流通与责任法案)保护。但关键在于,HIPAA保护的是机构(如医院、保险公司),而不是数据本身。

这意味着,当你把健康数据分享给ChatGPT Health或普通健康App时,这些信息并不受HIPAA的法律约束,而是完全取决于科技公司自家的隐私政策。这些公司可以在不违反自身条款的情况下,自由处理这些极具商业价值的医疗信息。相比之下,欧盟等地区采取的是更严格的“选择加入”隐私机制,这使得ChatGPT Health并未在这些地区进行试点。

03

互联生态:可穿戴设备与AI编织的数据网

如今,这种不受HIPAA保护的隐私灰色地带正在迅速扩大。不仅是AI大模型,许多广受欢迎的健康应用程序和非侵入式可穿戴设备(如Oura智能戒、Apple Health、Fitbit手表等)同样不在HIPAA的管辖范围内。

为了获得“最佳”的问诊结果,现在的AI助手会强烈建议用户将个人医疗记录与这些第三方穿戴设备进行绑定。业内专家警告,这将在不受传统医疗法规保护的空间内,创建一个巨大的健康生态系统,各大科技公司将由此掌握海量的敏感健康数据。此前,知名DNA检测公司23andMe在破产后打包出售其DNA样本库的事件,就为医疗数据的商业流转敲响了警钟。

04

临床风险:AI真的准备好当“数字医生”了吗?

除了隐私安全,AI在医疗领域的准确性同样受到质疑。医疗研究非营利组织ECRI指出,AI聊天机器人已成为迈向2026年的“最重大健康技术隐患”,因为AI模型存在延续偏见和加剧健康不平等的风险。

权威医学期刊《自然医学》的一项研究也表明,与真正的医生相比,ChatGPT Health在有效分诊医疗急症和提出适当护理建议方面仍存在明显不足。当人们逐渐习惯将身体如此复杂的信息简化为屏幕上的代码时,我们面临的不仅是误诊的健康风险,还有特殊疾病隐私被商业甚至法律审查的潜在威胁。

今日话题

医疗AI助手和智能穿戴设备越来越懂我们的身体,但它们也掌握了大量不受医疗法规严格保护的隐私数据。为了获取个性化的健康建议,你愿意向AI上传自己的真实病历和健康监测数据吗?欢迎在评论区分享你的看法!

#人工智能医疗 #ChatGPT #数据隐私 #可穿戴设备 #非侵入式监测 #大健康 #数字医疗 #信息安全

— END —

往期好文推荐

糖尿病管理新突破:每5分钟一次自动胰岛素调整,这款“人工胰腺”怎么做到的?

4亿美元收购背后:Anthropic为何重金布局生物医疗AI?

AI加持的健康“雷达”:全面解析Galaxy Watch的血压与心律追踪黑科技

夜雨聆风

夜雨聆风