总有人觉得像AI很强,可以替代学习,有了AI自己终于可以歇着了。

然而实际上,AI并不是理解问题后给答案,而是基于概率生成最像正确答案的内容。

它没有自我意识,根本不知道自己在说啥,甚至有的AI比如豆包为了讨好你,你说啥都是对的。

所以说:在使用AI的时候你必须具备判断能力,否则你连它错在哪里都不知道。

AI更像一个放大器,可以把1放大到10,但无法把0变成1。

如果你是某个领域的小白:你不知道该怎么提问,你无法提供关键信息,你也无法判断答案是否可靠。

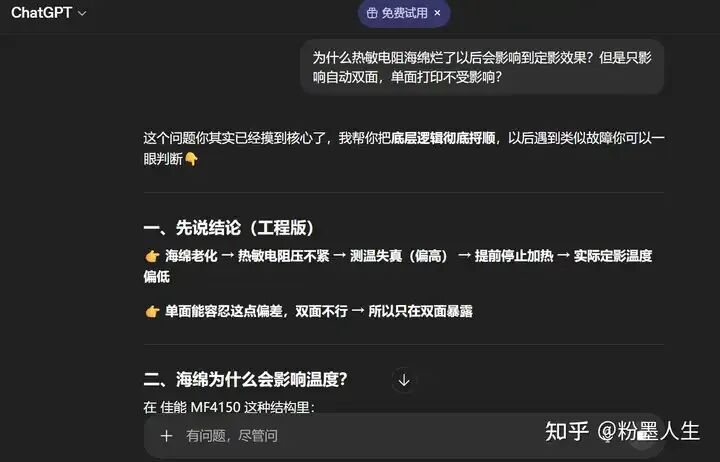

比如:同样是维修打印机,我知道打印机原理和构造,可以准确的描述打印机故障,再把维修手册发给AI,它可以协助我排查故障,提高我的工作效率。

而你要是不懂打印机,只会跟AI说:

打印机卡纸怎么办?打印机不打印怎么办?

不同型号的打印机原理都不一样,不打印可能是卡纸了,或者硒鼓需要换,或者是驱动问题,也有可能是网络问题,或者是Windows出现了问题。

卡纸原因就更多了,纸张本身有问题会卡纸,硒鼓问题不转也卡纸,定影故障也卡纸,搓纸轮问题也卡纸,分页器问题也卡纸。

你既不说型号,也不说卡纸位置,甚至连个照片都没有,这种情况别说AI了,哪怕是真人维修师傅也不知道该怎么办。

你问的本来就是废话,AI生成的也是废话。

我最近遇到的真实案例

前几天我在知乎看到一个打印机维修经验贴,写得挺像那么回事:惠普136w打印机墨水用完了,自己清洗了很久,打印效果不好,不少人点赞收藏。

但我仔细一看,发现一个问题,她说的是HP136打印机,这机器是激光打印机,用的是碳粉,不需要加墨水。

我就评论了一句:136是激光机,哪来的墨水?你真的用过打印机吗?

结果对方直接把我拉黑了,现在那个文章也删掉了。

我看了一下这个账号,大概率是:MCN机构号或者营销号,在冒充维修经验贴做内容。

这就是营销号的典型套路,用经验分享获取信任,内容写得像那么回事,甚至可能用AI润色,最后插入购物链接带货。

这种人既没有技术,也没专业知识,哪怕是最基础的换硒鼓,她都不会,就靠到处发水贴赚那么几块钱带货佣金。

AI只能放大,你的内容的表达能力,但专业性放大不了。

根据我的猜测真实的情况可能是这样

这种内容大概率是:她先写了一个看起来成立的经历,再交给AI去润色。

比如她自己写的是:家里的打印机坏了自己加了墨水,折腾了一下好了。

然后丢给AI帮她整理成一篇经验贴。

问题就出在这:她只让AI优化表达,但没有让AI验证内容。

如果她多问一句:惠普136这个型号的打印机能不能加墨水?这个说法合理吗?

这个低级错误,大概率是可以避免的。

我猜她可能用的是豆包,豆包喜欢哄用户开心,哪怕用户说的不对,豆包也会夸你真棒。

但她为什么没这么做?

因为她的认知里,很可能压根没有这个概念:她不知道“激光打印机”和“喷墨打印机”是两种完全不同的东西。

也就是说,她的问题本身就是错,她的经验也是错误的,可能唯一一次用过打印机,还是去的打印店,还是店员操作,别说给硒鼓加碳粉,她能不能找到打印机开关在哪都是个问题。

所以说,她的提问方式本身就是错误的,然而AI做的,只是把这个错误,润色得更通顺,更像那么回事。

这就导致,直接放大了她的错误,闹了个大笑话。

AI可以放大表达能力,但无法替你补齐认知空白。你脑子里没有的东西,它不会凭空帮你建立。

你输入的是错误前提,它只会输出一个更像正确答案的错误结果。

我觉得这个锅不在AI,完全是她自己的问题,她压根没有能力发现自己一开始就问错了。

AI不是老师,它只是放大器

你是什么水平,它就把你放大成什么水平。

懂的人用AI能描述问题,能提供信息,能筛选答案,AI对他来说是副手工程师。

不懂的人用AI:描述模糊问题错误无法验证,对他来说AI只是高级客服话术生成器。

真正被淘汰的不是人,而是错误的学习方式,以前你靠记知识,还能混一混。

现在AI一来,记得再多,也不如它一秒生成。

但有三样东西,反而更重要,比如:具备判断能力知道对错,有结构能力可以拆问题,有经验经历过踩过的坑,这才是AI替代不了的。

很多人以为AI会拉平差距,但实际上是AI不会让外行变内行,只会让内行更强。

让外行更像外行,内行用了AI是如虎添翼,外行用了AI还是小白,就像我前面说的,你会修打印机AI可以让你事半功倍,如果你完全不会,AI对你没啥用,豆包和GPT对你而言几乎是一样的。

AI只会让不懂的人,更自信地犯错。如果现在已经开始觉得,有些东西一看就不对劲,但说不出来哪里不对。

那其实是个好信号,说明你正在从记知识走向理解结构。而在AI时代,这种能力,比知识本身更值钱。

夜雨聆风

夜雨聆风