2026年,如果你在硅谷的工程团队里没听过"Harness Engineering"这个词,那你可能错过了现在最流行的技术趋势。

一匹野马的启示

想象一下:你得到了一匹世界上跑得最快的马。它的速度无可挑剔,耐力惊人。但问题是——它不听指挥。你让它向左,它向右;你让它停下来,它直接冲进灌木丛。

这匹"野马",就是今天的顶级大模型。

2026年,GPT-5、Claude 4、Gemini Ultra 这些模型的差距已经小到普通用户几乎感知不到。真正的瓶颈不再是"它能不能做到",而是"它能不能稳定地、可靠地、在我们需要的时候做到"。

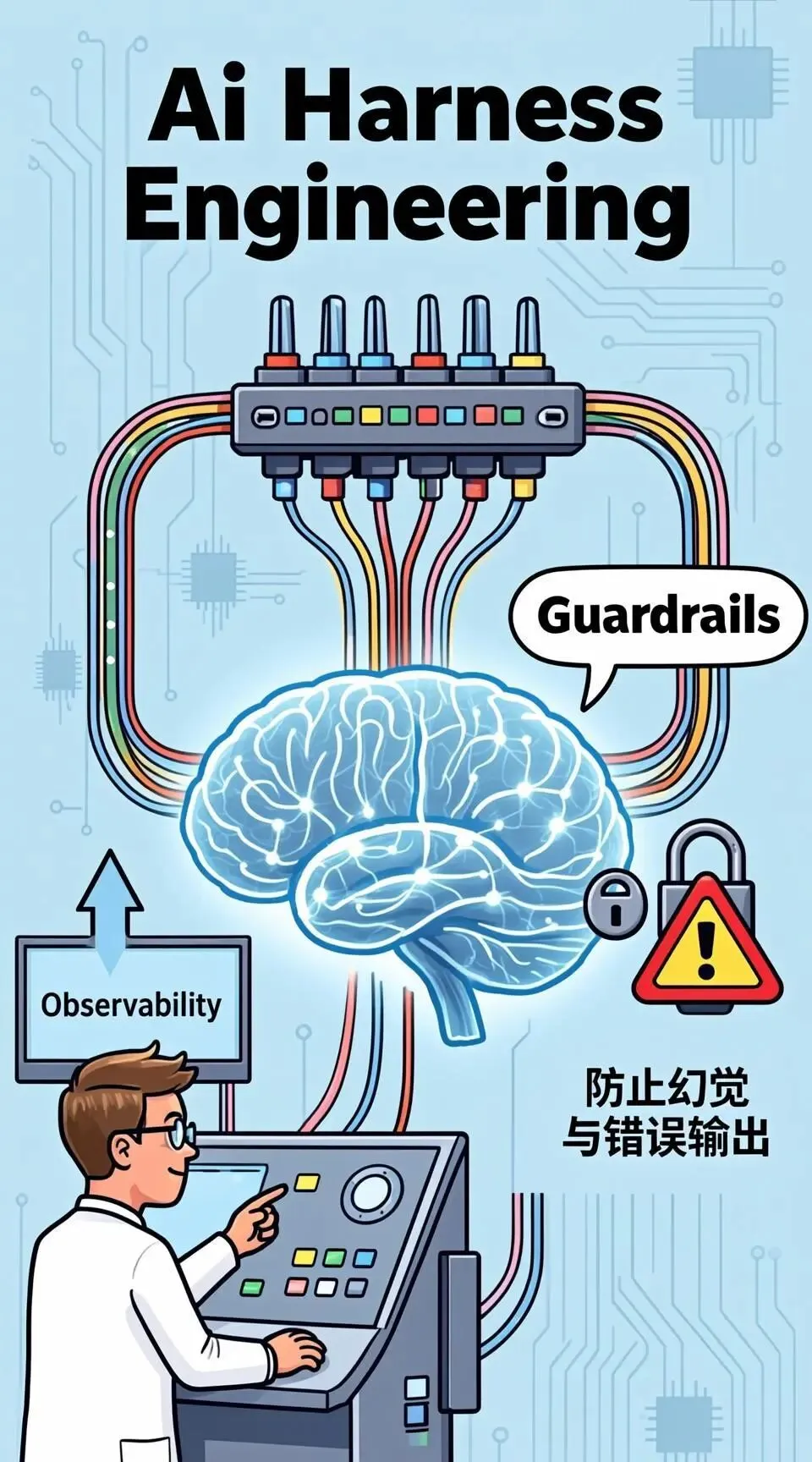

于是,一个新的工程领域诞生了——Harness Engineering,中文叫"驾驭工程"。它的核心理念很简单:与其花时间训练一匹更听话的马,不如给它套上一套精密的缰绳和马具。

从"咒语师"到"驯马师"

过去几年,我们熟悉的技能叫"Prompt Engineering"——提示词工程。它的本质是:怎么把话说清楚,让AI听懂。我们像巫师念咒语一样,精心雕琢每一个提示词,期待模型吐出完美的答案。

但到了2026年,这招越来越不够用了。

原因很简单:当我们让AI去完成复杂任务时,它会遇到三个几乎无解的"原罪":

第一,健忘症。 AI记不住长期的项目历史,你塞给它太多文档,它反而因为注意力稀释而变得更笨。

第二,架构失明。 AI生成的代码往往是"屎山"的前兆——它不懂分层,不懂解耦,只管眼前的功能实现,不管未来的维护成本。

第三,过度自信。 它经常在没完成工作时宣布任务结束,或者跳过关键测试就标记功能"已完成"。

驾驭工程的回答是:不要试图教AI"什么是好代码",而是构建一个"它只能写出好代码"的环境。

一个3人团队,5个月,100万行代码

最能说明问题的是一个真实的案例。

2026年初,OpenAI的一个内部团队做了一个激进的实验:他们派出一个AI Agent,在5个月内生成了超过100万行代码。整个过程中,没有一行代码是人工手写的。

你可能会问:这样的代码能用吗?答案是——不仅能用,而且达到了生产级标准。

他们做对了几件事:

第一,强制分层。 他们设计了严格的层级依赖模型:Types → Config → Repo → Service → Runtime → UI。任何跨层调用都会被CI管道直接拦截——无论代码是人写的还是AI写的。

第二,自动化"纠错机器人"。 一开始他们每周五手动清理"AI生成的垃圾代码",后来他们干脆写了一个后台Agent,定期扫描并自动提交修复PR。

第三,文档即代码。 所有设计决策都存在于仓库的文档中。如果不在文档里,对Agent来说就不存在——它会主动去补全缺失的文档。

这个实验的结论很清晰:模型只是"CPU",Harness才是真正的"操作系统"。

驾驭系统的四大护栏

经过硅谷多个团队的实践验证,Harness系统通常由四个核心组件构成:

护栏一:上下文工程——新员工手册

不是简单地把所有文档塞给AI,而是维护一个"地图式"的信息系统。类似于新人入职时拿到的员工手册,告诉Agent:项目结构是什么、核心模块在哪里、遇到问题该看哪份文档。

护栏二:架构约束——物理防呆设计

这是最硬核的部分。传统做法是把规则写在文档里,靠人自觉遵守。驾驭工程的做法是:把规则写成代码检查工具(Linter),如果AI试图违反架构分层,代码连提交都提交不上去。

有个精妙的细节:Linter的错误信息本身也是"上下文"。它不只说"你违反了规则X",而是解释"为什么这个规则存在、正确做法是什么"——这样AI读到错误后能自我理解,不需要人类介入。

护栏三:反馈循环——Agent审Agent

传统开发中,人类工程师负责代码审查。在驾驭工程中,这个工作变成了Agent对Agent的方式:一个Agent负责写代码,另一个Agent专门负责"挑刺"和"找茬"。

这借鉴了GAN(生成对抗网络)的核心思想:把"干活"和"挑刺"彻底分开,避免模型在自我评价时"自欺欺人"。

护栏四:熵管理——代码库的"垃圾分类"

随着时间推移,软件系统会逐渐混乱——技术债务会积累,文档会过时,代码会腐烂。这在工程学上叫"熵增"。

驾驭工程的解决方案是:部署一个专门的"清洁Agent",像操作系统的垃圾回收机制一样,定期扫描代码库,清理不一致的地方,自动提交修复PR。

这对你意味着什么?

也许你会觉得:这些听起来都是大公司、大团队的事情,跟我有什么关系?

但如果我们仔细看这个趋势,会发现一个正在发生的转变:

工程师的价值,正在从"写代码"转向"设计环境"。

以前,我们评价一个工程师好不好,主要看他编码的速度和质量。未来,这个标准会慢慢变成:他能设计出多可靠的Agent运行环境?他的约束系统能不能让AI稳定工作而不失控?

这其实是一种思维升级:从"控制AI说什么",到"控制AI怎么工作"。从"对话"到"驾驭"。

就像汽车取代马车时,司机这个新职业诞生了。当AI Agent开始普及,一个新的工程角色也在悄悄出现——不是"使用AI的人",而是"驾驭AI的人"。

结语

2026年,AI已经是千里马了。但千里马没有缰绳,跑得再快也可能到不了目的地——甚至可能把你摔下来。

Harness Engineering,就是这个时代最重要的缰绳。

它告诉我们一个反直觉的道理:规矩越明确,AI能独立做的事越多;约束越严格,它获得的信任和自主权越大。

听起来矛盾?但这和人类社会的运转逻辑完全一致——法律越完善的社会,个人自由度往往越高。

下一次,当你发现AI又在"发野"的时候,不妨换一个思路:别急着骂它不听话,试着问问自己——是不是该给它配一套更好的"缰绳"了?

夜雨聆风

夜雨聆风