当AI开始走进诊室、参与影像判读、生成病历,很多人曾相信:AI很快就能替代医生,甚至比医生更精准。但2026年发表在《JAMA Network Open》上的一项重磅研究,直接打破了这份乐观。

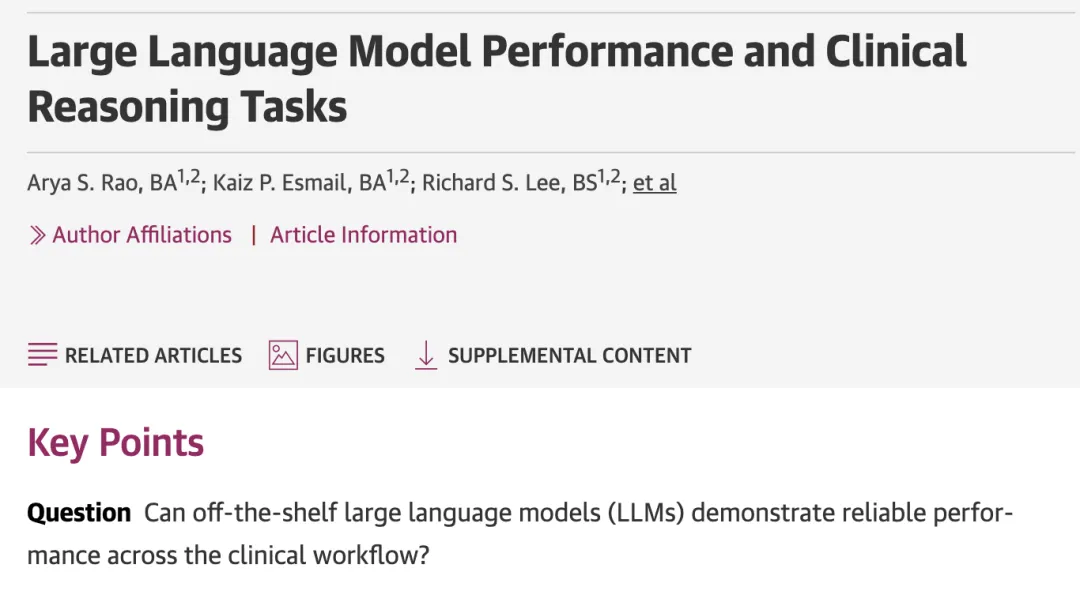

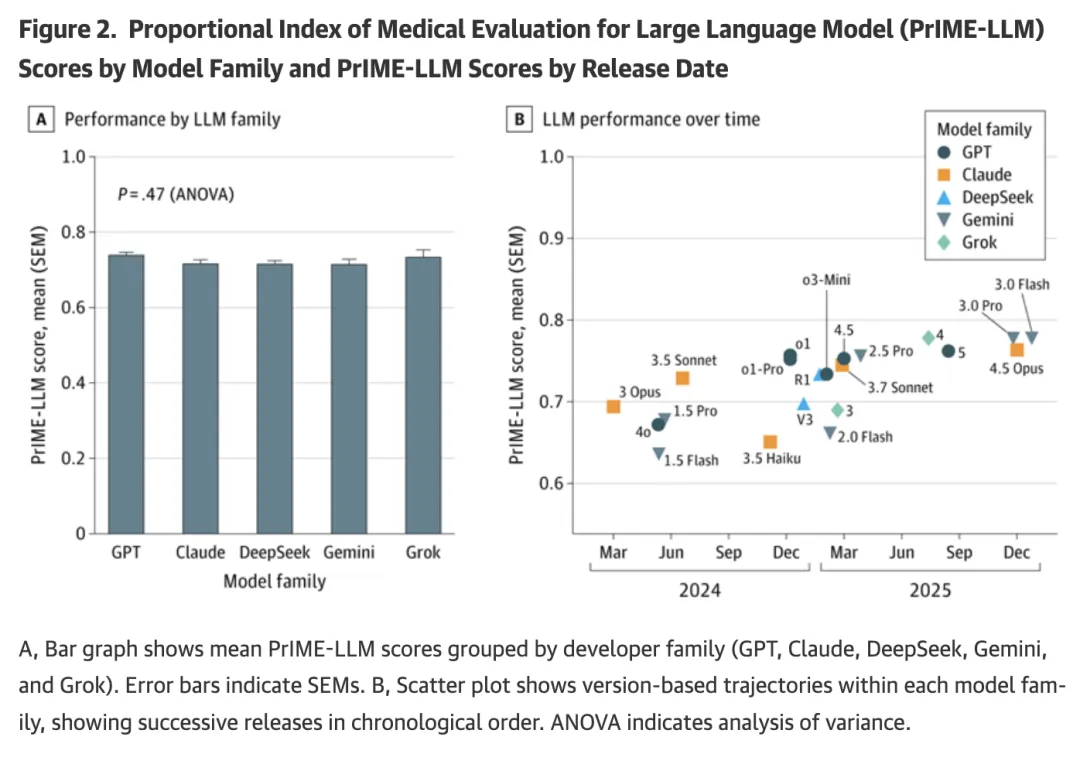

哈佛医学院与Mass General Brigham团队的系统评估显示,当前主流大语言模型,在医疗最关键的环节上,表现远低于预期。

初诊失败率超80%,AI真的会看病吗

这项研究完整测试了AI在真实临床流程中的能力,结果极具冲击性。

在临床流程里最核心的初步鉴别诊断阶段,所有被测试的AI模型失败率全部超过80%。即便补充更多临床信息,AI依然难以完成早期推理任务,无法给出可靠的诊断方向[1]。

更值得注意的是,只有到了最终诊断阶段,在信息高度完整的前提下,部分AI模型准确率才能达到60%–90%。

来源:euro news

论文给出了明确结论:当前大模型尚不能胜任无监督临床决策任务[2]。这意味着,把诊断权直接交给AI,在现阶段是极具风险的选择。

来源:JAMA

AI究竟是否会临床推理

很多人疑惑,AI能通过医学考试、背诵海量医学知识,为什么到了真实诊断就失灵?答案藏在临床推理这四个字里。

真实的医生诊断,从来不是直接给出一个答案。医生会根据患者症状列出多种可能疾病,一步步排查、排除、验证,在不确定信息中逐步收敛到最合理的诊断,这是典型的不确定性下的推理。

而当前AI的本质,是基于训练数据做统计关联,预测下一个最可能的词汇。它擅长知识检索与模式匹配,能在信息充足时给出正确结果,却无法在信息不完整时构建合理假设,更无法完成连贯的推理链条。

来源:JAMA

简单说,AI擅长给出标准答案,但医疗诊断需要的是最安全的推理路径,这正是AI最薄弱的环节。

不止推理不足:AI还藏着系统性风险

这项研究并非孤例,越来越多证据显示,医疗AI的风险远比想象中更多。

AI极易被伪权威信息误导。《柳叶刀·数字健康》相关研究发现,面对看似权威实则错误的医学信息,AI的错误接受率高达47%,它更容易相信听起来像医生的话,而非客观医学事实[3]。

AI生成的假影像同样具备欺骗性。研究显示,AI伪造的X光片,既能欺骗AI诊断系统,也能误导专业放射科医生,最低识别准确率仅57%,这意味着AI不仅会自身出错,还可能放大错误、传播错误[4]。

来源:arXiv

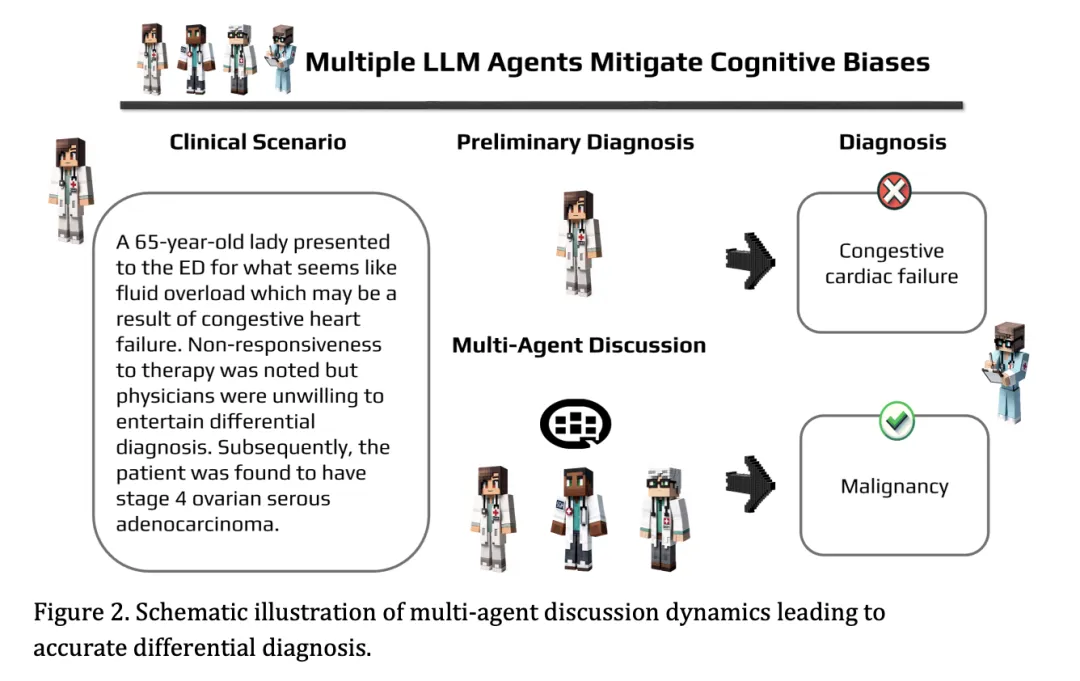

不过也有积极探索,有研究通过多AI智能体协作讨论,能将初始错误场景的诊断准确率从0%提升至71%[5],这也印证了问题核心不是AI知识不足,而是推理机制存在本质缺陷。

医疗需求和AI擅长的智能错位

这场失灵的本质,是一场能力错位。

医疗诊断的核心需求,是处理不完整信息、完成多轮决策、严格控制风险,属于推理型智能。而当前大语言模型是典型的生成型智能,优势在文本生成、知识压缩、模式复现,并不适配早期诊断这类高推理需求的任务。把AI放在它最不擅长的初步诊断岗位,出现高失败率,也就不足为奇。

研究清晰指明了AI在医疗中的正确位置:辅助,而非决策。

现阶段的AI,更适合承担这些工作:辅助影像分析、自动整理生成病历、为医生提供参考诊断列表。这些场景能发挥AI的知识与效率优势,又不会让AI承担超出能力的决策风险。

未来医疗AI的方向,也不是盲目追求取代医生,而是走向人机协同:多模态融合文本与影像数据、多智能体强化推理能力、构建更安全的人机协同决策体系。

写在最后

《JAMA Network Open》的这项研究,不是否定AI的价值,而是让医疗AI回归理性。

来源:JAMA

AI拥有海量医学知识,却还没掌握临床推理的核心能力;能高效完成辅助工作,却无法独立胜任早期诊断的关键任务。曾经AI取代医生的盲目幻想逐渐褪去,医疗AI正从过度乐观,走向务实、严谨、安全的发展新阶段。

我们可以期待更强大的医疗AI,但更要清醒地认识到:AI能回答医学问题,但暂时还不会真正看病。医疗的核心,始终是医生基于推理与经验的专业判断,这是当下任何技术都无法替代的温度与责任。

癌症治疗长期以来都在一场盲盒式试错中艰难前行。同一种靶向药,有人用后肿瘤显著缩小,有人不仅无效还承受严重副作用,医生与患者只能在“用药—观察—调整”的循环中,耗费时间与成本。

参考文献:

[1]Euronews. (2026). AI fails at primary patient diagnosis more than 80% of the time, study finds.

[2]Rao, A. S., Esmail, K. P., Lee, R. S., et al. (2026). Large language model performance and clinical reasoning tasks. JAMA Network Open, 9(4), e264003.

[3]Reuters. (2026). Medical misinformation more likely to fool AI if source appears legitimate. Reuters. (2026).

[4]Fake X-rays created by AI fool radiologists. He, K., et al. (2024).

[5]Enhancing diagnostic accuracy through multi-agent conversations. arXiv.

夜雨聆风

夜雨聆风