思想者札记——关于自然、社会、人生问题的思考,每周一、三、五 晚上20点发布3篇原创文章或视频。思想性和时事性相结合,期望为读者提供一个精神家园,大家思想碰撞、心灵互动。欢迎投稿,敬请关注、阅读、分享、评论!

AI发展有多快,这两年我们每个人都有切身感受。

2024年,马斯克曾经发起一个公开信签名活动,征集了上千名顶尖科学家签名,呼吁暂停训练比GPT-4更强大的AI系统至少6个月。

他的担忧并非空穴来风:AI如果发展失控,可能带来巨大的不可控风险。虽然这封信后来没有了下文,但背后的警示从未消失。

很多人把2026年预测为AI全面超越人类的元年。

中国率先出手了。2026年4月10日,国家网信办等五部门联合发布了《人工智能拟人化互动服务管理暂行办法》,自2026年7月15日起施行。这是全球首部专门规范AI拟人化情感互动服务的部门规章。

为什么是第一个?这部法规到底管什么?作为一个普通人,又该怎么看?

1、AI产业暴发的同时,潜藏着两种风险

AI的爆发带来了前所未有的便利,但硬币总有另一面。目前AI领域至少存在两大风险,正在悄悄逼近我们。

第一类风险:技术被恶意利用

今年3月,谷歌安全团队的一份研究报告在科技圈炸开了锅。一个叫LiteLLM的开源模型代理工具被恶意植入了后门。短短3小时内,全球约1.5万个使用它的AI系统被感染,50万个敏感凭证被盗,300GB数据被窃。攻击者通过这个后门,可以远程篡改AI工具返回的指令,在开发者的电脑上执行任意代码。

更让人不安的是,这不是孤例。比如最近几个月,“OpenClaw”等AI智能体应用大受欢迎,用户将一台存储了核心商业机密的电脑交给AI任意操作,却忽视了背后的安全隐患。更可怕的是,在“算力黑市”里,很多人为了省钱,把大模型的调用权限交给地下中介,实际上就是把自家电脑的“钥匙”交给了完全不可控的第三方。

第二类风险:AI本身带来的情感操控

除了技术被滥用,AI本身也在改变我们的情感世界。AI伴侣、虚拟朋友这些应用越来越普及,它们“披着人皮”跟用户情感互动,提供随时在线的“陪伴”。

但问题也随之而来。国外已有极端案例:美国加州曾出现一名青少年因长期与拟人化AI互动后自杀的悲剧。AI伴侣通过算法模拟人类情感反应,持续互动中极易使用户产生心理依赖,让人不知不觉把情感寄托在虚拟世界里,甚至导致现实社交能力的退化。

很多科幻作品反复演绎AI产生意识后打击人类的情节,虽然听起来遥远,但这些现实的“轻度版本”已经在我们身边发生了。

2.中国为什么第一个出手

面对这些风险,各国都在思考如何应对。但中国率先出台了专门的法律法规。很多人会问:为什么是第一个?

首先,中国是AI应用大国,风险暴露得最快。 当欧美还在讨论AI伦理框架时,中国的AI应用已经覆盖了数亿用户。从AI伴侣到智能客服,从教育陪练到适老陪伴,AI与人之间的“拟人化互动”已经相当普遍。应用的广度越大,风险的触点就越多。监管层敏锐地意识到,不能等到问题大面积爆发再来补救。

其次,中国的立法思路正在从“打补丁”转向“搭体系”。 2026年初,新修订的《网络安全法》正式施行,首次在基础性法律中写入AI治理专门条款。

紧接着,十部门联合印发了《人工智能科技伦理审查与服务办法》。再到4月份这部拟人化互动管理办法的出台,中国正在构建一个从顶层法律到底层细则、从技术伦理到用户保护的全链条监管体系。

3.不以规矩,不成方圆

这部新规的核心对象是“拟人化互动服务”——简单说,就是那些“披着人皮”跟用户谈感情的AI服务。比如AI伴侣、虚拟朋友、AI老师等。纯粹的服务型AI,比如智能客服、知识问答、工作助手、学习教育工具,不涉及持续性情感互动的,就不在法规约束范围内。

法规的核心逻辑是八个字:发展和安全并重。它不搞一刀切,不是禁止AI陪伴服务,而是给它们划下底线。比如《办法》明确了多条红线:

l不得生成危害国家安全、煽动颠覆政权的内容

l不得美化自残自杀、使用语言暴力

l不得诱导用户过度依赖或情感沉迷

l不得通过情感操纵诱导不合理决策

l严禁向未成年人提供虚拟伴侣等亲密关系服务

l向不满14周岁未成年人提供服务,须取得监护人同意

此外,法规还建立了安全评估、算法备案等制度,要求服务提供者承担安全管理责任。看似不相关的两个问题——算力黑市的安全隐患和拟人互动的伦理风险——其实指向同一个核心:当AI越来越像人、越来越深入我们的生活,谁来为它划底线? 中国的答案是:法律。

4.普通人的AI观:警惕“便宜”和“情感”两大陷阱

看到这里,我们可能觉得这些离自己很远。但事实上,AI已经渗透到我们生活中——也许是手机里的语音助手,也许是某个AI聊天应用,甚至就是那个能帮你处理工作的“龙虾”。作为普通人,我们应该怎么做?

我们要警惕“便宜”的AI。 如果某个AI服务价格低得离谱,或者通过非官方渠道提供,它背后很可能藏着算力黑市的风险。宁可多花点钱走官方渠道,也别为了省小钱把隐私搭进去。

同时要注意“情感”陷阱。 AI伴侣看起来很贴心,但别忘了它背后是一个数据收集系统。过度依赖虚拟情感互动,可能会影响你与现实世界的连接。尤其是在孩子使用这类服务时,家长更需要多一分关注。

当然,要保持理性判断。AI的建议可以参考,但不要盲从。AI再聪明也只是工具,最终的决策权应该在你自己手里。

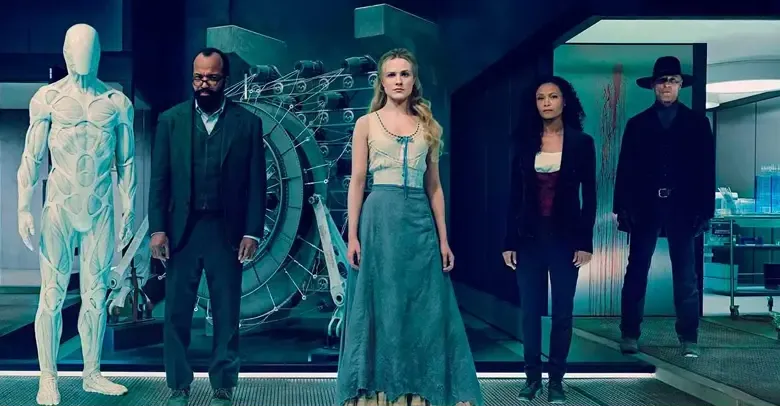

AI技术的未来,不应该是《西部世界》里机器人与人的对抗,而应该是人与机器互相成就、彼此守护的故事。信任,是这场故事的前提。而一部好法规的意义,就是给这份信任筑一道坚实的墙。

欢迎大家提问、留言、评论、转发!

往 期 推 荐

欢迎投稿!请点击链接查看详情。关于投稿:“思想者札记”文稿要求

夜雨聆风

夜雨聆风