你有没有被 AI 配音坑过?

我是说那种——你满心期待让它读一段小说,结果出来的是"您好,请问您需要办理什么业务"的客服腔调。又或者,你想让它带点情绪,结果它把"他气得浑身发抖"读出了播报天气预报的从容感。

配音这事儿, AI 折腾了好几年,一直卡在"字正腔圆但毫无灵魂"这个坎儿上。

直到我看到阶跃星辰昨天( 4 月 16 日)上线的 StepAudio 2.5 TTS 。

你以为它是个语音合成工具,其实它是半个编剧

先说清楚一件事: StepAudio 2.5 TTS 不只是个"把文字转成声音"的东西。

它的官方定位是 Contextual TTS——语境感知语音合成模型。这名字听着有点虚,但上手跑一遍就懂了:它不是在念文本,它在"演"文本。

怎么做到的?三项核心能力。

第一项:全局语境控制

你可能用过其他 TTS API ,比如 ElevenLabs 或者国内的火山引擎。你会发现它们能调语速、调音调、调情绪标签——但那个情绪标签吧,通常是"happy""sad""angry"这种,选完之后你发现 AI 读出来的感觉和你想象中的完全不是一回事。

StepAudio 2.5 的做法不一样。

它用自然语言下指令。不是选标签,是说人话。

比如官方示例里,它让你输入这样的 instruction :

语气冰冷,压迫感强,语速偏慢 或者

声音极度紧绷,像在拼命压住快要失控的狂喜;语速快而断续,带明显的压抑感 你看,这是导演在给演员说戏,不是程序员在调参数。

这条指令会定调整段音频的基调。从第一个字到最后一个字, AI 会尽量维持这个整体感觉。

这在有声书和角色配音里特别有用。你要讲一个悬疑故事,开头需要低沉的悬念感;你要配一个喜剧角色,全程需要那种微妙的轻佻。以往的 TTS 模型很难做到"从头到尾一致",因为它倾向于每句话独立处理,越长文本越容易前后割裂。

全局语境控制解决的就是这个问题。

第二项:文中语境控制

但光有全局语境还不够。

你想过没有——一段配音里,同一句话用不同语气读,味道完全不同?

比如这句台词:

"哦,是吗?" 你可以读成嘲讽,读成惊讶,读成敷衍,读成"我就知道你会这么说"的得意。标点符号帮不了你,语速也帮不了你太多——关键在于句子里某个瞬间的转折。

StepAudio 2.5 引入了文中语境控制,用括号语法实现:

(压低声音)喂……你看我手机。(短促吸气)是不是我眼花了?(强装镇定)……算了,肯定是诈骗短信。 括号里的内容不会被读出来,它是给 AI 的表演指导。

"压低声音"——这是音色控制。"短促吸气"——这是气息感。"强装镇定"——这是情绪。"……"——这是停顿。

你看,这就是"人人都能是配音导演"的真正含义:你不是在调参数,你是在写表演备注。

这套语法支持精细到每一个气口、每一处重音、每一次停顿。用得好,真的能做出那种"不像 AI 读的"的感觉。

第三项:零样本复刻

最后这项对创作者来说可能比前两项都实用。

Zero-shot 音色复刻——你只需要提供 3 秒参考音频,就能复刻出那个人的音色,然后在后续合成中自由使用。

不是传统意义上的"克隆",是"理解并迁移"。

它会保留目标音色的特征,但同时支持对情感、风格、表达方式进行调节。简单说:同一个人的声音,可以演绎悲伤,也可以演绎欢快;可以用来说悄悄话,也可以用来读说明书。

而且复刻出来的音色,同样支持全局语境和文中语境控制。

这意味着什么?你可以让一个声音"演"各种角色,而不需要去找一堆不同音色的配音演员。

当然,官方也提供了一批预设音色,覆盖不同年龄、性别、风格的音色资产。对于不想折腾复刻的用户,直接用预设音色 + 语境控制,上手门槛极低。

技术细节:能跑多快,限制有多少

说几个实际的参数。

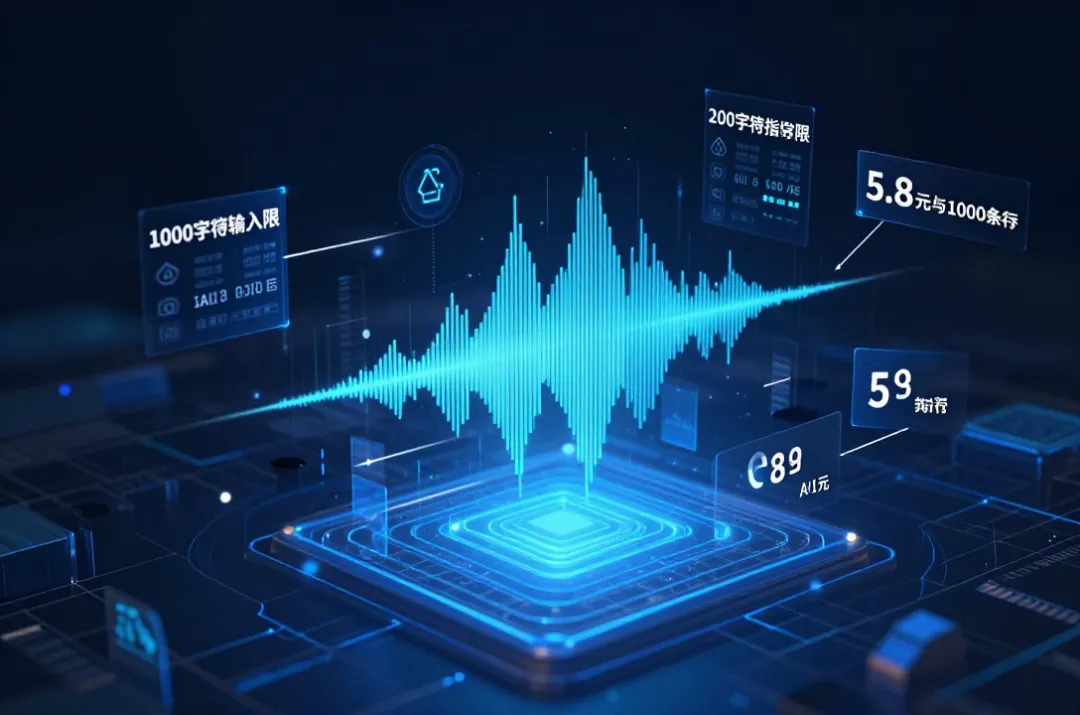

输入上限:单次合成最多 1000 个字符。如果你需要处理更长的文本(比如一整章有声书),需要分段落调用,然后拼接。

Instruction 上限: 200 字符。够用了,别絮叨。

API 端点分两种:

POST /v1/audio/speech | ||

WebSocket /v1/realtime/audio |

流式接口用起来稍微复杂一点,需要先建连发 tts.create,然后通过 tts.text.delta 发送带括号指令的文本。但如果你只需要批量生成音频,非流式接口够用了。

定价方面:

| 5.8 元 / 万字符 | |

| 9.9 元 / 音色 |

复刻接口需要注意一点:试听不收费,但正式复刻成功会立即扣费。所以别拿这个接口做无意义的测试。

实操:我用它配了一段悬疑小说开头

光看参数没意思,我们来点实际的。

我随手找了一段悬疑小说的开头,让 StepAudio 2.5 来读:

我随手找了一段悬疑小说的开头,让 StepAudio 2.5 来读:

输入文本:

(压低,缓慢)午夜时分,雨已经下了三天。 (停顿两秒)老宅的门吱呀一声开了。 (短促吸气)没有人。 (极轻)但门确实动过。 全局指令:阴冷,悬疑氛围,每句话之间有细微的紧张感递进

生成出来的音频,我反复听了好几遍。

有几个细节让我意外:

一是"吱呀一声"这四个字,它真的读出了那种拟声词该有的质感——不是机械念字,是带着画面感的。

二是"没有人"那句,和后面"但门确实动过"之间有一个自然的呼吸感,紧张感不是靠语速堆出来的,是靠留白撑起来的。

三是最轻的那句"但门确实动过"——真的读得很轻,像是怕惊动什么。这个"怕"不是情绪标签能调出来的,是括号里的 (极轻) 和整体氛围配合出来的。

当然,我不能睁眼说瞎话说它完美。有些长句的转折处理还是能听出"这是 AI",但已经比我之前用过的任何 TTS 都好太多了。

这个"不像 AI"的程度,大概相当于"配音水平中上的新人播音员"——比专业配音演员还是差一点,但已经不会让人出戏。

避坑指南:这几个坑我先替你踩了

坑一:括号语法别滥用

刚开始用的时候,我恨不得每个字都加上括号指令。结果出来的东西情绪太满,听着反而假。

正确的用法是:关键节点加指令,比如重音、停顿、气息;其他地方让 AI 靠全局语境自己发挥。

坑二: Instruction 不是越长越好

200 字符的上限其实挺宽裕的,但我的经验是:越具体越容易翻车。

比如你写"声音极度紧绷,像在拼命压住快要失控的狂喜"——AI 可能真的会把"压住"这两个字咬得很重,读出"憋着"的感觉。效果好不好,要看你的文本适不适合这个方向。

反而是"语气平稳但透着不安"这种模糊指令,出来的效果往往更自然。

多试几次,找到感觉。

坑三:流式接口慎用

流式接口延迟低,适合实时对话场景,但如果你只是做内容创作(非流式接口一次性出音频),就别折腾 WebSocket 了。

代码量多,调试麻烦,而且音质和非流式接口没有本质差别。除非你做的是语音交互产品,否则不建议在这块浪费时间。

谁适合用这个东西

说了这么多,你可能在想了:这个东西到底适合谁?

适合的场景:

不太适合的场景:

对比市面其他产品:如果你之前用过 ElevenLabs 、字节 Seed-McGee 或者 MiniMax 的 TTS ,你会发现 StepAudio 2.5 的优势主要在"语境控制"这个环节。

当然,音色本身的自然度也很重要。这方面 ElevenLabs 仍然是第一梯队, StepAudio 2.5 和它的差距在缩小,但还没完全追平。

说回开头那个问题:配音这件事, AI 能做好吗?

我的判断是:能做好,但需要好的工具和正确的用法。

过去几年,大家对 AI 配音的期待是"又快又便宜还行"——这个三角从来解不开。但 StepAudio 2.5 至少在一个点上做到了:足够便宜,上手足够简单,效果足够像人。

对于大多数内容创作者来说,这个"足够"已经够了。

剩下的那点差距,要么靠时间解决,要么靠你多调几轮 prompt 补上。

你可以自己去 阶跃星辰开放平台[1] 体验一下。 API 文档写得很清楚,代码示例也有。

看完觉得有用的话,记得回来告诉我你的感受。

或者——你有什么 AI 配音工具推荐?

参考链接

[1] 阶跃星辰开放平台: https://platform.stepfun.com

不装/不藏/不玄学 ★ 点赞=签收 ★ 转发=好评

就在👉「AI✦不装指南」

夜雨聆风

夜雨聆风