AI时代个人发展系列文章(进阶篇)

上篇文章,我们聊到了用AI的五层能力——从「会提问」到「能委托」,一个人借助AI完成过去需要一个团队才能做的事。

有朋友看完问我:那多智能体到底怎么用?现在有哪些工具真正能上手?

这篇文章,不讲技术原理,只聊一件事:什么场景用什么工具,以及选之前要想清楚什么。

一、从单打独斗到团队作战

你有没有这种感觉?

跟AI对话的时候,它好像什么都懂,但每次出来的结果差点意思。写文案还行,但数据不会查;分析可以,但排版太丑。

这不怪AI。当你让一个人同时做策划、调研、执行和审核,每一项都只能做到六七十分。

多智能体解决的,就是这个问题。

它不是魔法,而是让AI像真正的团队一样分工协作:有人搜集信息,有人分析数据,有人负责写作,有人专门审核。

专业分工,才是把事情做好的前提——不只是对人,对AI也一样。

二、什么场景用什么东西

多智能体工具越来越多,面面俱到地介绍只会让你更困惑。

我按真实场景来聊——每个场景只推荐最容易上手的1-2个工具,配上真实案例。

场景一:日常办公自动化

典型需求: 整理文件、处理邮件、写周报、做PPT、查资料

推荐工具:WorkBuddy(https://www.codebuddy.cn/work/)

腾讯今年2月推出的职场AI桌面助手。免部署,下载即用。

它的工作方式很简单——你说一句话,它帮你规划执行。

举个例子:

你:「帮我整理桌面上的合同文件,把还没签字的挑出来,列个清单发给我。」

WorkBuddy自动规划步骤 → 读取桌面文件 → 识别合同类型 → 筛选未签字 → 生成清单 → 发送到你的企业微信。

整个过程你只说了一句话,剩下的它自己跑。

我还听说有人用它每天早上自动汇总前一天的邮件,生成简报发到群里。以前要花20分钟,现在全自动。

场景二:搭建自动化工作流

典型需求: 每天定时搜集新闻、生成日报、批量处理数据、搭建业务流程

推荐工具:Coze(https://www.coze.cn/overview)

Coze走的是可视化编排的路——你不需要写代码,在网页上拖拖拽拽,就能把一个自动化流程搭起来。

一个真实案例:

一个做运营的朋友,每天早上要搜集行业新闻发到群里。以前她每天花30分钟手动操作:打开网站 → 复制标题链接 → 整理格式 → 发群。

后来她用Coze搭了一个「早报机器人」:每天早上8点自动运行 → 调用必应搜索 + 内容提取插件 → 按设定格式整理 → 自动发到企业微信群。

搭好之后,群里每天早上8点准时收到早报。她再也没手动操作过。

Coze的优势是门槛极低——完全不需要技术背景,模板丰富,直接复制改改就能用。

场景三:写代码、做开发

典型需求: 读代码、改Bug、写新功能、跑测试

推荐工具:Claude Code / Cursor (需要网络适配)

两个方向,适合不同的人。

如果你用终端开发——选Claude Code。

它是Anthropic推出的终端智能编码助手,能真正理解你的整个项目,不只是补全代码,而是能读代码、改Bug、跑测试、管理Git。

今年2月上线了Agent Teams功能——多个AI实例组成团队,有人写代码,有人测试,有人做审查。像真正的开发团队一样协作。

有个独立开发者用它做一个小型Web应用,描述需求后,Claude Code的多个Agent自动分工:第一个分析需求拆解任务,第二个写前端,第三个写后端API,第四个写测试用例,最后跑出了一个可以运行的基础版本。

商业成绩也能说明问题:Anthropic 2025年1月ARR突破10亿美元,2026年4月ARR逼近300亿美元。

如果你更习惯图形界面——选Cursor 3.0。

它是基于VS Code定制的AI原生编辑器,今年3月发布的3.0版本以多Agent并行调度为核心。你可以在同一个界面里同时启动多个AI「员工」分工协作——一个写用户认证模块,一个写测试用例,效率翻倍。

还支持从手机、网页端、Slack触发任务,不用一直守在电脑前。

场景四:数据敏感、需要本地部署

典型需求: 处理公司内部数据、客户隐私信息,不想数据上云

这里需要分清楚一件事:工具本地 ≠ 数据本地。

很多人以为装了本地工具数据就安全了,其实不然——OpenClaw 本身是个调度平台,如果你接的模型是 GPT 或 Claude,数据还是会经过第三方服务器。

真正实现数据不出本地的方案,是让 OpenClaw 调用本地部署的大模型。

方案:OpenClaw + Ollama + 本地大模型

OpenClaw 是奥地利开发者 Peter Steinberger 做的一个 AI Agent 执行网关——GitHub 史上最快20万星项目,开源免费,支持飞书、微信、钉钉等15+平台接入。

它的定位是连接大模型和你的系统工具(文件、浏览器、终端等),本身不提供大模型。

接上 Ollama和本地大模型之后,OpenClaw 调用的就是你自己电脑上跑的模型——合同、邮件、文档全在本地处理,不经过任何云端。

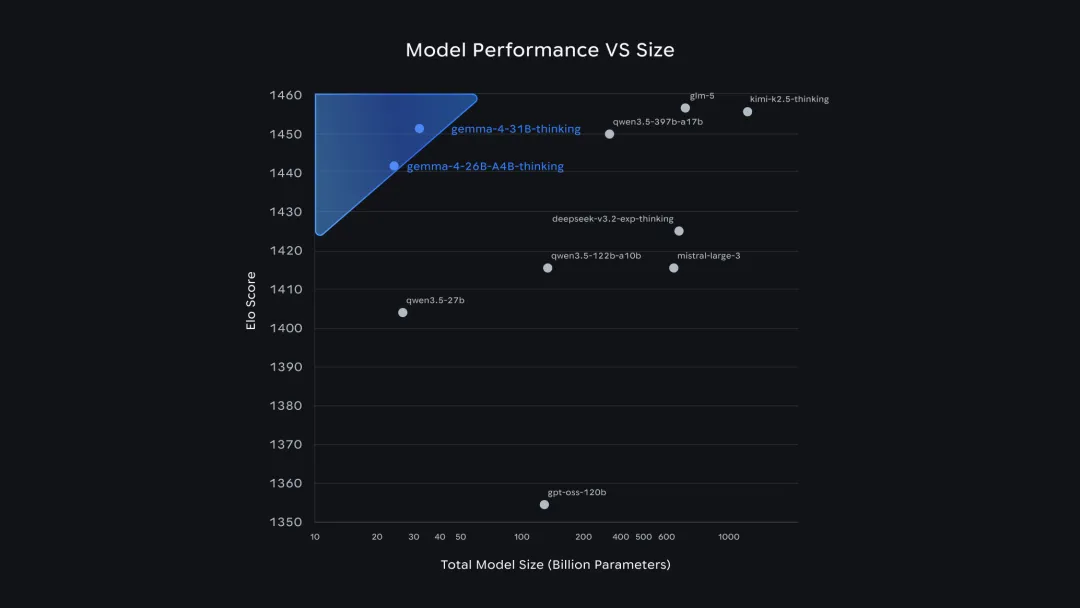

Google 今年4月发布的 Gemma 4 31B 是目前最强的开源小模型——EIO得分超过1440,256K上下文,多模态支持,在多项基准测试中与云端大模型性能基本持平。

用 Ollama 一行命令就能本地部署,Q4量化版本约需20GB显存/内存,可以使用带32G统一内存的Macbook或者是配一张中高端显卡就能跑起来。

数据永远不出你的电脑,模型调用一分钱不花。

注意:OpenClaw 默认配置存在一定风险,建议配合防火墙使用,关闭公网访问,且只安装官方或可信来源的技能包

按场景选工具

三、这些工具背后的大模型和费用

多智能体工具本身不「智能」——它们只是调度员,真正干活的是背后的大模型。

这意味着:你选什么模型,决定了能力强不强;模型怎么收费,决定了你花多少钱。

• 每天处理邮件、整理文档:DeepSeek约¥1/天,GPT-5约¥50/天 • 搭好Coze工作流后:豆包模型有免费额度,超出后每月几十元够用 • 用Ollama跑Gemma 4:一次性设备投入(Macbook或者显卡),模型调用不用花

关键点:多智能体工具本身大多免费或便宜,大头费用在模型调用上。

四、2026年值得关注的几个变化

几个正在发生的变化,值得你提前知道。

工具之间开始「说话」了

今年有个协议叫MCP(Model Context Protocol),正在让不同厂商的AI工具互相「对话」。

你在Coze搭的搜集Agent,可以调用Claude Code帮你写代码,再调用OpenClaw跑在本地——它们不再是孤岛。

本地化从「极客爱好」变成「企业标配」

以前觉得本地部署是极客才干的事,现在发现是刚需。尤其是医疗、法律、金融这些对数据隐私要求高的行业。

AI团队可以「跨平台」干活了

现在你可以用手机远程控制AI——地铁上发条消息,家里电脑就开始干活。

OpenClaw支持15个以上平台接入,包括微信、飞书、钉钉。AI团队不再被困在某一个软件里,而是随时随地可以被你调用。

写在最后

系列文章写到这里,核心想说的就一件事:AI不是你的替代者,而是你的放大器。

学会用它,而不是被它用。

下篇文章预告:

系列第四篇,我打算聊聊一个具体的落地场景——用多智能体搭建投研平台。

行情数据自动搜集 → AI分析研报 → 生成投资简报 → 定时推送到手机——整个流程不需要写一行代码,全部用现成工具搭起来。

夜雨聆风

夜雨聆风