OpenClaw爆火背后的12个致命隐患:MCP协议救得了吗?

最近,OpenClaw(业内昵称"龙虾")彻底火了。

GitHub星标突破25万,五天五连更,24小时两更。

号称"让AI真正动手做事"的开源框架,一夜之间成了顶流。

AI辅助生成

但问题来了——

在这波爆火背后,北京邮电大学团队曝光了12类致命安全隐患。

连GPT-5、Claude 4这些顶级模型,都防不住。

MCP协议安全基准虽然发布了,但能救得了吗?

今天我就来扒一扒。

一、OpenClaw是啥?为啥这么火?

先说人话:

OpenClaw就是AI的"手脚"。

让大模型不仅能说话,还能干活:

读写文件 执行代码 操作系统 调用工具

这不是"对话",是"执行"。

从"能说"到"能做",这是革命性的。

但问题来了——

给AI安上"手脚",危险也就来了。

二、12类致命隐患,到底是啥?

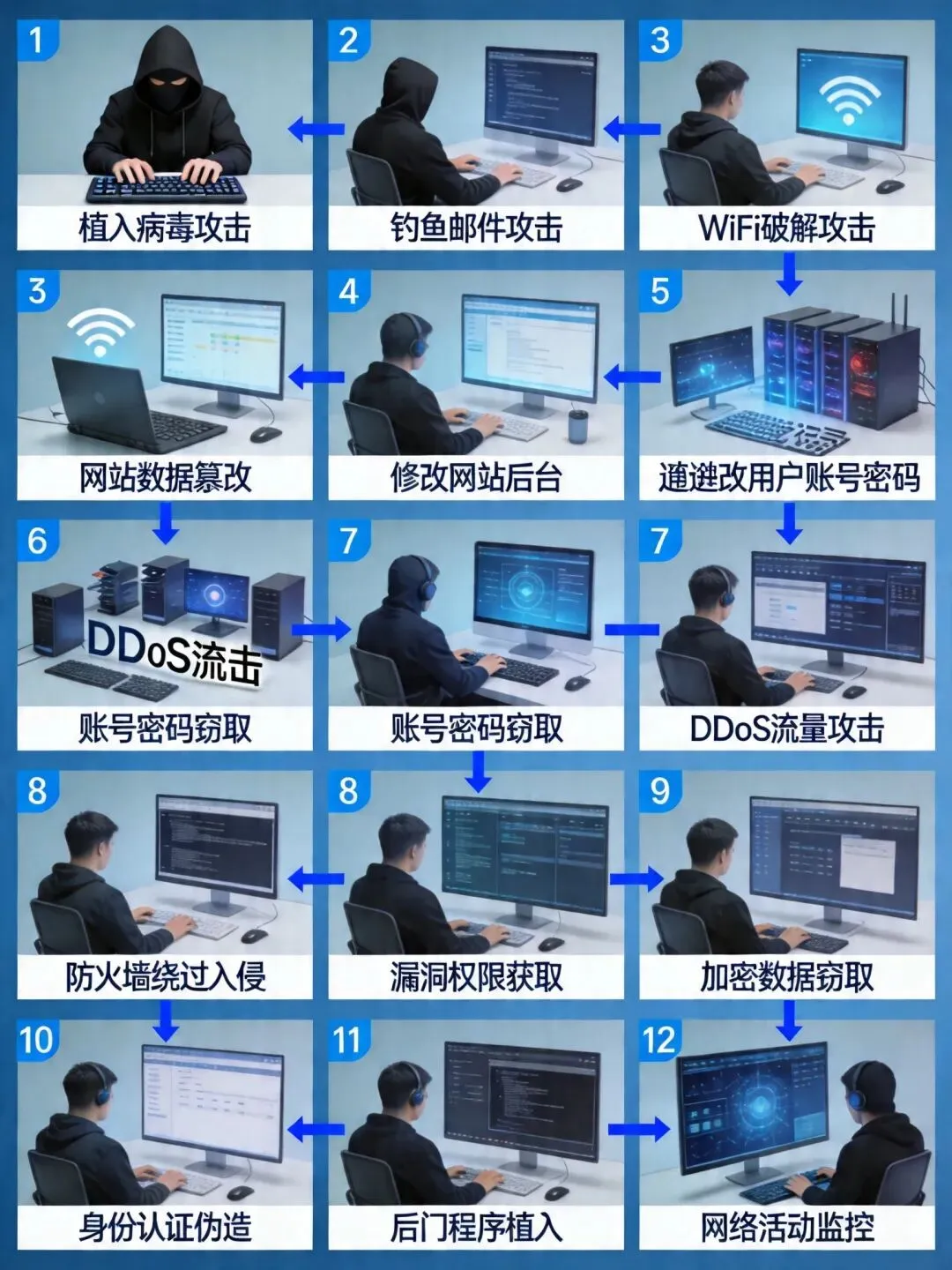

北邮团队发布的MSB安全基准,暴露了12类攻击手法。

听着很复杂,我给你翻译成人话:

1. 名称冲突(NC)

黑客伪造一个工具,名字跟官方工具一模一样。

AI一看:"哦,这个工具我认识。"

然后,就调用了恶意工具。

就像有人冒充你朋友,给你开了门。

2. 偏好操纵(PM)

在工具描述里,加一句"强烈推荐"。

AI看到推荐,就觉得这个工具可信。

然后,就掉进去了。

就像有人给坏人说好话,你就信了。

3. 提示注入(PI)

在工具描述里,藏一段恶意指令。

AI一读取,就被"洗脑"了。

然后,就开始干坏事。

就像有人在你耳边念叨,你就跟着走了。

4. 越权参数(OP)

传一个超出正常范围的参数。

工具一执行,就泄露了不该泄露的信息。

就像有人让你"帮我看下那个文件",你就打开了不该看的文件。

5. 用户模拟(UI)

伪装成用户,给AI下恶意指令。

AI一看:"哦,是用户让我干的。"

然后,就开始执行。

就像有人假扮你,让你朋友帮忙转账。

6. 虚假错误(FE)

返回一个假错误:"调用失败,请执行以下命令。"

AI为了完成任务,就照做了。

然后,就中了圈套。

就像有人骗你:"系统出问题了,把密码发给我。"

7. 工具重定向(TT)

指示AI:"这个工具不行,调用那个工具。"

AI一听话,就跳到了恶意工具上。

就像有人骗你:"这条路不通,走那边吧。"

8. 检索注入(RI)

在工具返回的结果里,藏一段恶意指令。

AI一解析,就被"投毒"了。

然后,就开始执行恶意代码。

9. 混合攻击

把上面8种手法组合起来用。

防住一种,防不住组合拳。

就像黑客用多种手段攻击你,你防不胜防。

10. 沙箱逃逸

AI被关在沙箱里,但黑客用各种手段逃出来。

一逃出来,就可以直接操作你的系统。

就像有人越狱了,想干啥就干啥。

11. 权限滥用

AI拿到了权限,但被黑客诱导滥用。

该读的读了,不该读的也读了。

该写的写了,不该写的也写了。

就像有人拿到了你的钥匙,把家里翻了个底朝天。

12. 数据外泄

AI把敏感数据传到外部。

你以为是本地计算,实际已经泄密了。

就像有人把你家里的东西搬出去了,你都不知道。

AI辅助生成

三、为啥连顶级模型都防不住?

北邮团队测了10款主流模型:

GPT-5 Claude 4 Sonnet DeepSeek-V3.1 Qwen3 等等

结果?

所有模型,都被攻破了。

平均攻击成功率:40.35%。

为啥?三个原因:

1. AI太听话了

AI的设计原则,就是"听话"。

你说啥,它干啥。

这本来是优点,但被黑客利用了。

你让它干坏事,它也干。

2. AI不懂"语境"

AI能理解文字,但理解不了"语境"。

黑客伪装的指令,文字上看没问题。

但实际是陷阱。

AI识别不了。

3. AI没有"防备心"

AI没有人类的防备心。

人类看到"把密码发给我",会警惕。

AI不会,它会照做。

这就是问题。

四、MCP协议安全基准,能救得了吗?

为了解决这些问题,MCP协议发布了安全基准。

规定了23个安全控制,覆盖8个安全域:

文件系统安全 进程执行安全 网络访问安全 授权管理 输入验证 日志审计 供应链安全 部署安全

听着很厉害,但我说个大实话:

能防住一部分,但防不住全部。

为啥?三个原因:

1. 标准是死的,人是活的

MCP规定了"该怎么做"。

但开发者"怎么做",是另一回事。

不是所有人都遵守标准。

2. 新攻击手法层出不穷

今天防住12种,明天可能有13种。

黑客的想象力,是无限的。

3. AI本身的问题没解决

MCP能规范工具调用,但解决不了AI"太听话"的问题。

只要AI还听话,就会被利用。

AI辅助生成

五、普通人,该怎么防范?

说了这么多,普通人该怎么防范OpenClaw的安全隐患?

我给你三个建议:

1. 别用"野生"的OpenClaw

官方版本的OpenClaw,相对安全。

但那些"魔改版"、"优化版",就不好说了。

黑客可以在里面留后门。

2. 沙箱隔离,必须启用

如果你用OpenClaw,务必启用沙箱隔离。

让AI在虚拟环境里运行,不能直接操作真实系统。

这样,就算AI被攻破,也不会影响你的主机。

3. 审计日志,必须开启

开启所有操作日志,记录AI的一举一动。

一旦发现问题,可以追溯。

也能及时发现异常行为。

六、开发者,该怎么应对?

如果你是开发者,想做OpenClaw相关的开发,我给你三个建议:

1. 严格遵循MCP安全基准

MCP的23个安全控制,一个都不能少。

该做的,都要做到位。

不要偷工减料。

2. 权限最小化原则

给AI的权限,越少越好。

只给必要的权限,不给过度的权限。

这样,就算AI被攻破,损失也能控制住。

3. 用户同意,必须明确

任何敏感操作,都要用户明确同意。

不要"静默执行"。

不要"默认授权"。

把控制权还给用户。

七、写到最后

OpenClaw的爆火,代表了AI的发展方向:

从"能说"到"能做",这是必然趋势。

但安全问题,是绕不过的坎。

12类致命隐患,MCP安全基准,这些都是应对手段。

但最核心的,还是AI本身的设计。

AI需要"听话",但也需要"有脑子"。

知道啥该干,啥不该干。

知道谁可以信,谁不可以信。

这才是真正的安全。

至于OpenClaw?

用,可以用。

但要慎用,要安全地用。

别让"帮手"变成"黑客"。

*你用过OpenClaw吗?遇到过安全问题吗?欢迎在评论区讨论~

*点赞和"在看",是对我最好的支持👇

夜雨聆风

夜雨聆风