前言:当全世界都在为ChatGPT走进教室而欢呼时,我们是否意识到,自己正亲手将下一代送入一个由算法构筑的“智力囚笼”?

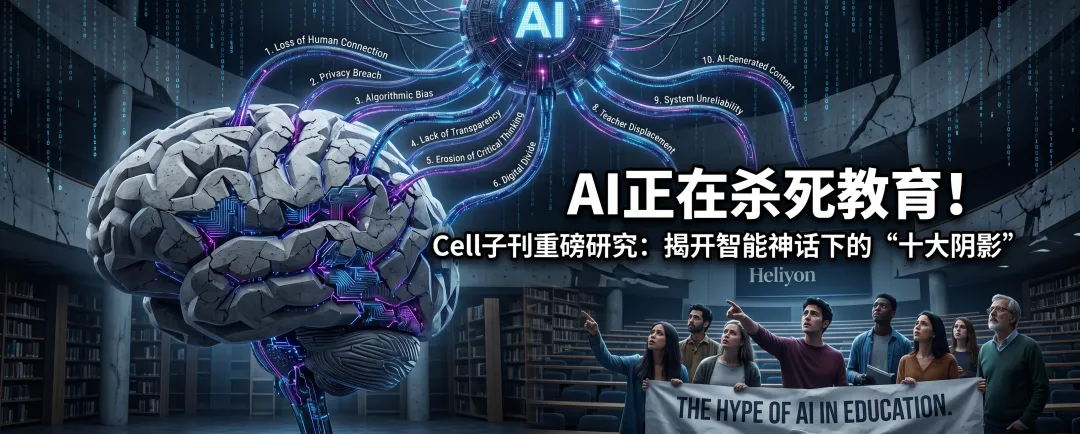

CellPress 旗下顶级跨学科期刊 《Heliyon》 上的研究论文——《揭开阴影:超越教育中人工智能的热潮》(Unveiling the Shadows: Beyond the Hype of AI in Education)震撼发声 。这份来自沙特阿拉伯贾达大学的研究,不仅撕开了AI教育的遮羞布,更用冰冷的统计数据告诉我们:技术狂欢的背面,是教育本质的崩塌 。

🛑 十宗罪:AI正在如何侵蚀学习的根基?

通过对56篇核心文献的内容分析,提炼出了AI整合教育过程中最致命的“十大阴影” :

1. 人文连接的“慢性死亡”:AI的介入导致师生间情感互动的缺失,学生会感到支持匮乏,社会化发展受阻 。

2. 数据隐私的“全面裸奔”:海量数据的采集让学生的隐私暴露在泄露、黑客攻击和非法滥用的风险之下 。

3. 算法偏见的“无形枷锁”:算法往往带有社会刻板印象,可能对少数群体或弱势学生产生系统性的歧视 。

4. “黑箱”操作的问责缺失:AI决策过程缺乏透明度,学生和老师根本不知道系统为何给出某个评分或建议 。

5. 批判性思维的“智力阉割”:过度依赖AI给出的“预设答案”,学生独立解决问题和发散性思考的能力正在萎缩 。

6. 数字鸿沟的“贫富世袭”:技术获取的不平等将进一步拉大精英与底层学生之间的差距,加剧教育不公平 。

7. 伦理防线的“全面失守”:在未经充分知情同意的情况下,学生正沦为AI实验的“小白鼠” 。

8. 教师角色的“职业危机”:缺乏培训的教师在技术浪潮中手足无措,传统的教学引导作用被算法取代 。

9. 系统故障的“连锁瘫痪”:当教育高度依赖不可靠的AI系统,一旦发生技术故障,学习进程将彻底停摆 。

10. 内容真实性的“学术灾难”:AI生成的作业和评估引发了关于真实性、知识产权及人类智慧价值贬低的巨大争议 。

📊 铁证如山:来自一线师生的焦虑图谱

为了验证上述模型,研究人员对260名大学师生进行了严密的实证调查 :

全员差评的“重灾区”: 在批判性思维方面,参与者极其担心AI限制探索性思考,其担忧均值高达 4.11 。 在系统可靠性方面,师生对“必须意识到AI局限性”的认同感同样高达 4.11 。 在人文连接方面,认为AI会削弱师生关系的均值达到了 3.99 。

令人绝望的“普适性”: 调查通过多因素方差分析(MANOVA)发现:性别、职业(学生/教师)、教育程度以及你对AI的了解程度,都无法减轻这种焦虑 。无论你是小白还是专家,只要你身处教育系统,就能感受到这种威胁 。

🔗 恶性循环:没有一个问题是孤立的

研究揭示了一个更可怕的事实:AI教育的各种负面影响是紧密勾连的“噩梦网络” 。

最强相关性 (r=0.967):对AI系统可靠性的担忧,与对AI生成内容真实性的忧虑几乎完全同步 。+1

黑箱效应 (r=0.956):算法越是不透明,教师就越难以进行专业发展,最终导致教学质量的全线溃败 。+1

多米诺骨牌:这意味着只要一个环节失控,整个教育生态就会面临崩溃的风险 。

⚠️ 终极警示:教育不是算法的试验场

研究者 Abdulrahman M. Al-Zahrani 在结论中发出了振聋发聩的疾呼:AI绝不应是人类教育者的替代品,而应是其延伸 。

如果我们:

不能保护学生的数据所有权 ;

不能打破算法的黑箱 ;

不能抹平技术获取的不对等 ;

不能挽救正在消亡的批判性能力 ……

那么,所谓的“AI赋能教育”,不过是一场加速通往智力荒原的集体自嗨 。

总结: 未来的教育需要的是具备情感温度的AI、透明公正的算法以及不可替代的人类教师 。在拥抱AI之前,请先学会审视它背后的阴影。

夜雨聆风

夜雨聆风