作者:小马哥

过去 18 个月,AI Agent 从概念验证(POC)走向生产环境的速度远超预期。但一个残酷的现实是:超过 60% 的企业 Agent 项目在 POC 阶段表现亮眼,却在规模化部署时折戟沉沙。

问题出在哪?不是技术不够先进,而是决策不够清醒。

本文基于 OpenClaw 平台数十个企业级 Agent 项目的实战复盘,提炼出7个关键决策点。每一个决策点,都是一道分水岭——选对了,Agent 成为业务增长的引擎;选错了,沦为又一个"技术债"负担。

●

01

1. 架构决策:单体 Agent vs 多 Agent 协作

POC 阶段的陷阱:用一个功能强大的单体 Agent 搞定所有任务,demo 时流畅丝滑,给人一种"这就成了"的错觉。

生产环境的真相:单体 Agent 在复杂业务场景下会遭遇三大瓶颈:

- 上下文爆炸:长链路任务导致 token 消耗失控,响应延迟陡增

- 逻辑耦合:业务规则变更时,牵一发而动全身

- 容错脆弱:单点故障导致整个流程崩溃

决策框架:

| 维度 | 单体 Agent | 多 Agent 协作 |

|---|---|---|

| 任务复杂度 | 简单、线性 | 复杂、分叉 |

| 业务稳定性 | 规则固定 | 频繁迭代 |

| 容错要求 | 低 | 高 |

| 团队规模 | 1-2 人 | 3 人以上 |

实战建议:

即使初期选择单体架构,也要在设计时预留"分家"接口。用 OpenClaw 的模块化技能(Skill)封装业务逻辑,当复杂度达到临界点时,可以低成本拆分为多 Agent 架构。

●

02

2. 模型选型:能力边界与成本的动态平衡

POC 阶段的陷阱:追求 SOTA(最先进水平),非 GPT-4 不用,非 Claude 3.5 不选,成本意识淡薄。

生产环境的真相:模型能力每提升 10%,成本可能翻倍。而很多业务场景并不需要最强模型,而是需要"足够好且可预测"的模型。

决策框架——分层路由策略:

用户请求 → 意图识别(轻量模型)

↓

├─ 简单查询 → 本地小模型(LLaMA-3-8B 级)

├─ 标准业务 → 中端模型(Claude 3 Haiku / GPT-3.5)

└─ 复杂推理 → 旗舰模型(GPT-4 / Claude 3.5 Sonnet)

OpenClaw 实战配置:

在技能配置中定义模型路由规则,根据任务类型自动选择最优模型:

- 结构化提取任务:优先选用支持 JSON mode 的中端模型

- 创意生成任务:调用多模型投票机制,取最优输出

- 高风险决策任务:强制使用旗舰模型 + 人工复核节点

●

03

3. 记忆设计:短期上下文 vs 长期知识库

POC 阶段的陷阱:过度依赖模型的"即兴记忆",把关键业务信息塞进 prompt,幻想模型能记住一切。

生产环境的真相:

- 上下文窗口是有限的(即使 200K token,也有成本边界)

- 模型不会真正"学习",每次对话都是全新的

- 业务知识需要结构化、可检索、可更新

关键决策:三层记忆架构

L1 - 工作记忆(Working Memory):

当前对话的短期上下文,由模型的上下文窗口承载。只保留当前任务必需的信息。

L2 - episodic 记忆( episodic Memory):

用户偏好、历史交互模式、任务执行记录。通过向量数据库存储,按需检索注入 prompt。

L3 - 语义记忆(Semantic Memory):

业务知识库、SOP、产品文档。通过 RAG(检索增强生成)架构,动态召回最相关的知识片段。

OpenClaw 落地建议:

- 使用 MEMORY.md 沉淀长期记忆配置

- 用 AGENTS.md 定义 Agent 的记忆访问权限

- 敏感业务数据走本地向量库(如 ChromaDB),不上云

●

04

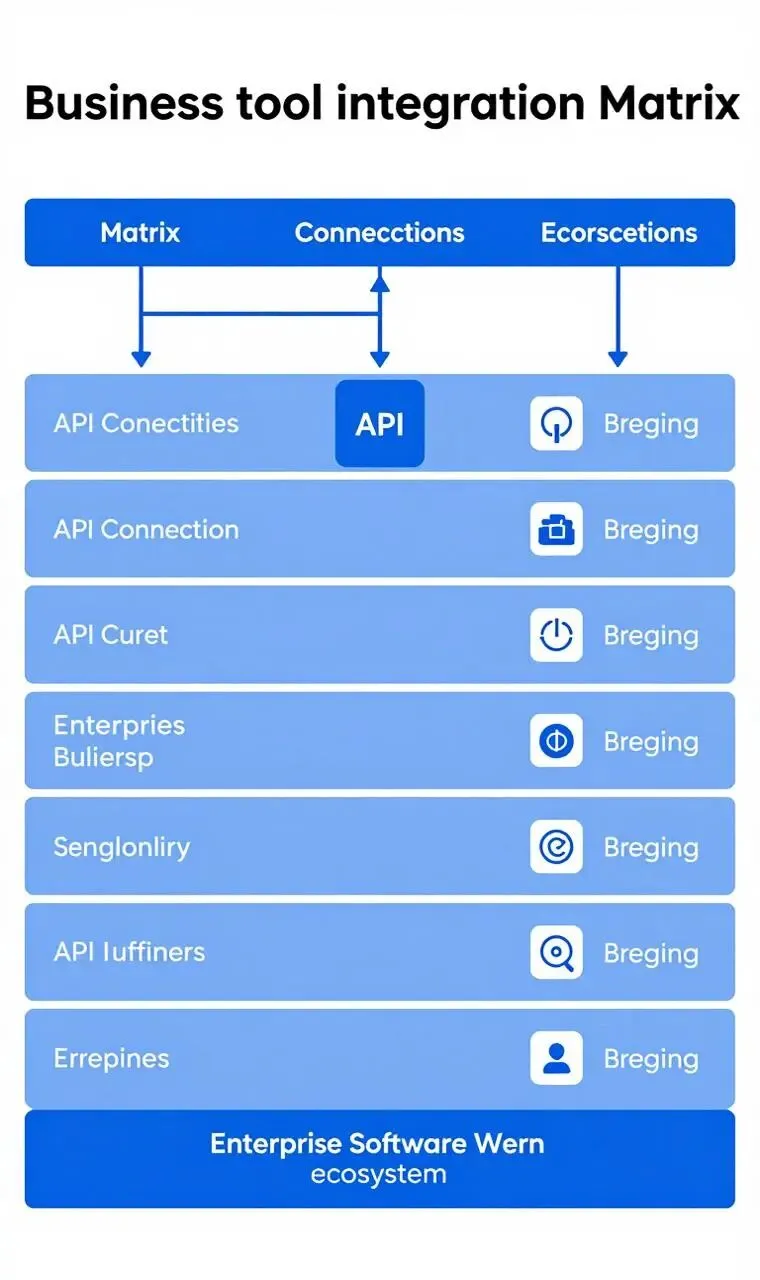

4. 工具生态:自建 vs 集成 vs 调用

POC 阶段的陷阱:追求"全栈自研",把宝贵的研发资源浪费在造轮子上。

生产环境的真相:Agent 的核心价值在于"编排",而非"重复发明工具"。

决策矩阵:

| 工具类型 | 推荐策略 | OpenClaw 实践 |

|---|---|---|

| 通用能力(搜索、计算、生图) | 直接集成第三方 API | Tavily 搜索、阿里/ModelScope 生图 |

| 企业系统(ERP、CRM、OA) | 调用现有系统 API | 通过 Skill 封装企业 API |

| 垂直领域(法律、医疗、金融) | 采购专业工具或服务 | 对接领域 SaaS,不自建 |

| 核心差异化能力 | 自研 + 持续迭代 | 封装为 Skill,版本化管理 |

关键原则:

工具层要薄,编排层要厚。OpenClaw 的 Skill 机制就是为了让工具集成变得标准化、可复用。

●

05

5. 人机协作:全自动化 vs 人工介入点

POC 阶段的陷阱:追求"全自动",试图消除所有人工环节,结果在边界 case 上翻车。

生产环境的真相:企业级 Agent 不是替代人,而是增强人。明智的做法是:让 Agent 做它擅长的(规模、速度、一致性),让人做人类擅长的(判断、创造、共情)。

HITL(Human-in-the-Loop)设计原则:

1. 事前审批:高风险操作前强制人工确认(如转账、数据删除、对外发送)

2. 事中观察:关键节点输出推理过程,供人类监督

3. 事后复盘:异常案例自动归档,用于模型迭代

OpenClaw 实现:

通过 APPROVE 命令机制,在关键节点暂停执行,等待人类确认后再继续。这既保证了安全,又保留了自动化的效率。

●

06

6. 可观测性:黑盒运行 vs 全链路追踪

POC 阶段的陷阱:只关注"输出对不对",不关心"为什么对/错"。

生产环境的真相:Agent 是概率系统,不可能 100% 正确。当出错时,必须能快速定位问题根因——是提示词问题?模型幻觉?工具返回异常?还是业务规则变更?

必备可观测性维度:

结构化日志:

- 每个 Agent 的输入输出

- 工具调用的参数与返回

- 模型调用的 token 消耗与延迟

- 异常堆栈与错误分类

性能指标:

- 任务成功率(按任务类型细分)

- 平均响应时间(P50/P95/P99)

- 成本 per task

- 用户满意度评分

OpenClaw 实践:

- 每次会话自动生成 session_id,全链路可追踪

- 关键决策点记录到 memory/ 目录,长期归档

- 使用 openclaw status 实时监控 Agent 健康状态

●

07

7. 演进路径:一步到位 vs 持续迭代

POC 阶段的陷阱:把 Agent 当成"项目"来做,追求上线即完美,一次性投入大量资源。

生产环境的真相:Agent 是"产品",需要持续运营。业务场景在变,用户需求在变,模型能力也在变。

推荐演进路线:

Phase 1 - 辅助模式(Copilot):

Agent 作为人类的助手,提供建议但不直接执行。重点验证价值假设,收集用户反馈。

Phase 2 - 代理模式(Agent):

在限定场景下,Agent 可以自主执行,但保留人工审批节点。重点打磨边界 case 处理能力。

Phase 3 - 自主模式(Autonomous):

Agent 在明确授权范围内完全自主运行,人类转向监督与优化角色。重点构建可观测性与安全护栏。

OpenClaw 建议:

- 从 SOUL.md 和 USER.md 开始,明确定义 Agent 的行为边界

- 使用 IDENTITY.md 固化 Agent 身份,保持长期一致性

- 通过 AGENTS.md 定义多 Agent 协作规则,为规模化做准备

●

08

结语:落地不是终点,而是起点

AI Agent 的落地,不是把模型接进业务系统那么简单。它是一个系统工程,涉及架构设计、模型选型、记忆管理、工具集成、人机协作、可观测性、持续迭代七大维度。

每一个决策点,都需要在"技术先进性"与"业务可行性"之间找到平衡。记住:最好的 Agent 不是能力最强的,而是最可持续的。

OpenClaw 作为面向企业级的 Agent 开发与运营平台,正是为了解决这些真实落地难题而生。从单 Agent 到多 Agent,从 POC 到生产,从人工协作到全自动化——每一步,都有清晰的实践路径与工具支撑。

如果你正在规划企业的 Agent 落地,希望这 7 个关键决策点能帮你少走一些弯路。毕竟,在 AI 落地的道路上,避坑比赶路更重要。

夜雨聆风

夜雨聆风