大模型真的能应用于数十种病种吗?

低倍镜扫全片、高倍镜看细节——病理医生每天都在做的事,终于有AI学会了。

病理大模型远未成熟!它们脆弱、昂贵、不理解组织结构、跨机构泛化能力差。任何声称“病理基础模型已具备临床能力”的说法,都是不负责任的误导。

这是不久前,数字病理图像检索奠基人、梅奥诊所资深学者Hamid R. Tizhoosh 独自署名发表的一篇重磅论文中的结论。

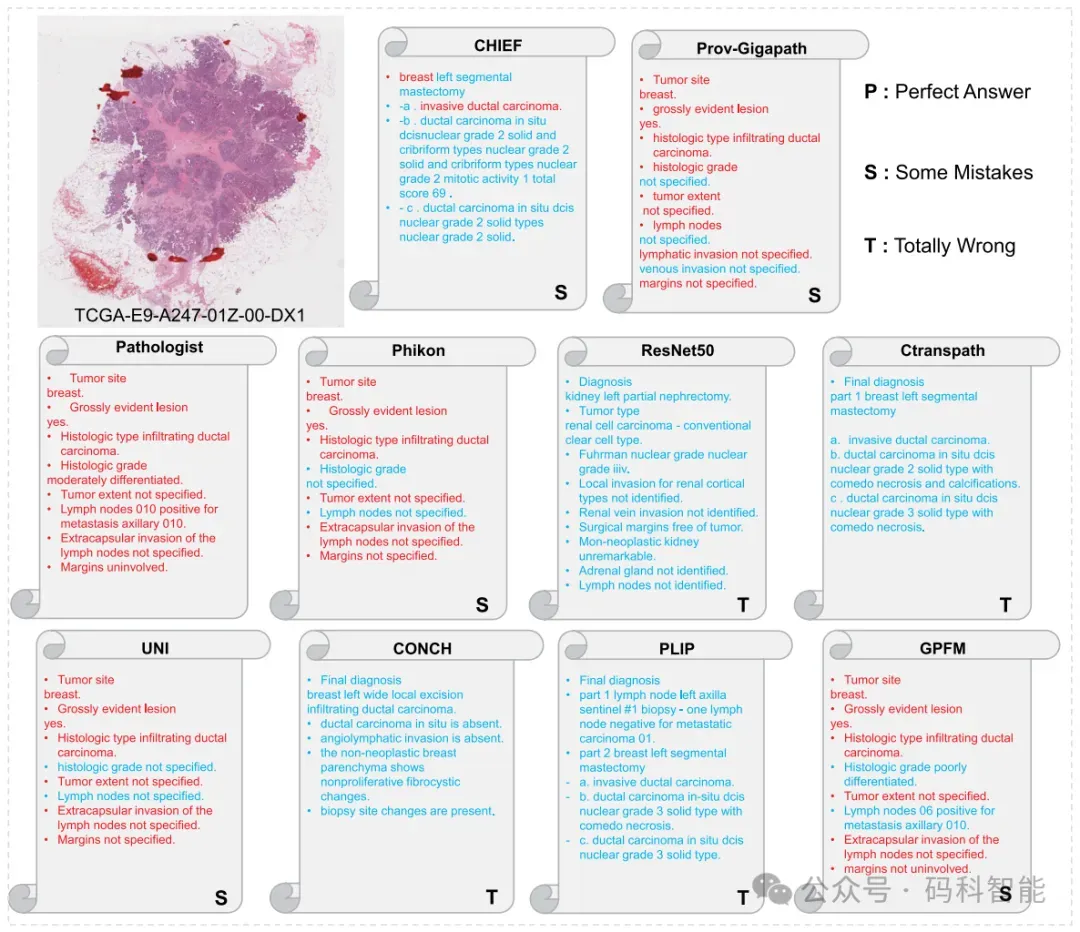

一盆冷水浇在了“病理学即将被大模型全面重塑”的狂热之上,文中对UNI、GigaPath、Virchow、H-Optimus 等一众病理大模型做了全面实验。

没有一个模型能够对扫描仪引起的变异性具备可靠的鲁棒性,没有一个模型在微调后的下游任务中表现明显超越基线模型。

一众病理大模型没有一个是完全正确的!

问题的根源在哪里?抛开论文中的结论,我个人认为核心症结有二:

第一,需要新的范式来破局。在智能驾驶领域,世界模型、VLA模型的出现彻底改变了传统“感知-规划-控制”的范式,从而让AI开得像老司机一样丝滑。但只依靠视觉模态的病理AI,凭什么诊断能像医生一样稳?

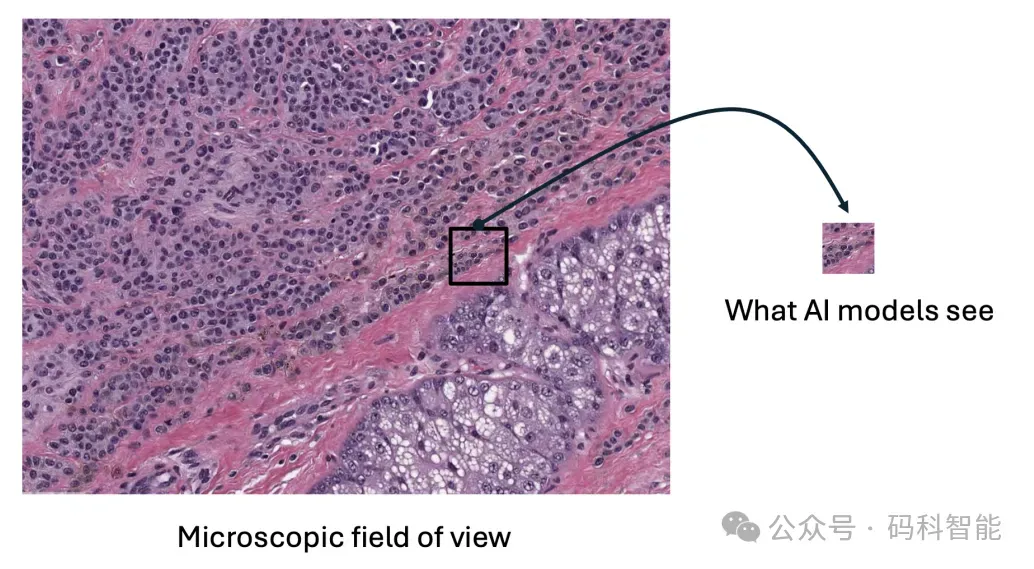

第二,需要深层次挖掘数据。不同分辨率视野对诊断的影响、不同染色/不同扫描仪对细胞形态的干扰、同一类型组织的多维度文本描述的差异性,这些问题,当前的基础模型几乎没有回答。

而目前不少号称“临床级”的病理大模型,本质上只是用私有数据复现了开源模型。那么,我们究竟该如何突破实际落地中遇到的瓶颈?

最近,来自iDeepwise的研究团队给出了一个不同的答案,他们提出了一个全新的范式,DongNI-MED 多模态病理大模型。

没有去追逐万能模型的神话,而是从临床真实需求出发,构建了一套受诺贝尔奖得主卡尼曼“快慢双系统”理论启发的全新病理AI架构。

快慢双系统,让AI像医生一样思考

人类大脑面临问题时候是有两套思考系统,快思考依赖直觉和经验,慢思考需要集中注意力进行逻辑分析。

DongNI-MED 将这一机制引入病理AI,用快系统保证效率,用慢系统兜底安全,让AI先学会不遗漏,再学会不误判:

快系统:负责秒级全片筛查,标记可疑区域,保证不遗漏

慢系统:负责深度推理分析,逐层推理,提供可解释的依据,保证不错判

系统在快慢双思考模式加持下,恰好回应了Tizhoosh指出的可解释性缺失与视野倍率局限两大核心难题。

DongNI-MED 的慢系统推理模式,借鉴了强化学习与思维链推理技术,依托于大量的病理图文对标注以及海量的病理学知识与临床指南。面对一张病理切片,它不是直接输出结论,而是逐步展示推理过程。

DongNI-MED 快系统的无监督模式,放弃单一尺度的特征提取,转向多尺度融合感知。采用多分辨率训练策略,从四个不同的放大倍数提取切片特征。

四个尺度的特征通过注意力机制动态融合,这种多尺度方法使模型能够学习层次化的表征,既能捕捉细致的细胞细节,又能理解更广泛的组织结构。

这正如同病理医生真实的诊断方式:他们会在低倍镜下扫视全片,在高倍镜下确认细节,在不同倍率间来回切换。DongNI-MED的快系统,正是在模拟这个过程。

落地破局:从实验室到临床落地

DongNI-MED 在工程化落地层面同样下了功夫,VLM模型最大的痛点是资源消耗,那算力焦虑怎么解?团队给出的解决方案:

Dongni-AMDC技术:对模型权重和输入同步压缩,大幅降低内存占用,提升编解码速度;

顺序加载与异构并行计算:先视觉编码器后语言模型,将模型运算分配至不同芯片并行处理,大幅提升推理效率。

经过整个端侧优化与蒸馏技术,最终轻量化模型参数仅有1.5B,可直接运行在本地服务器甚至显微镜端侧。

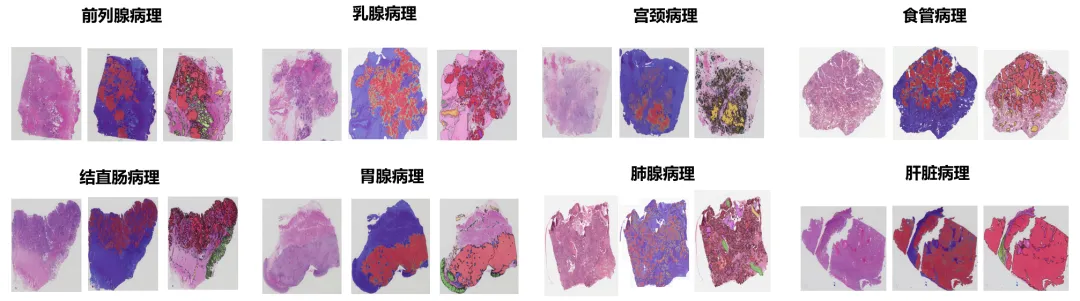

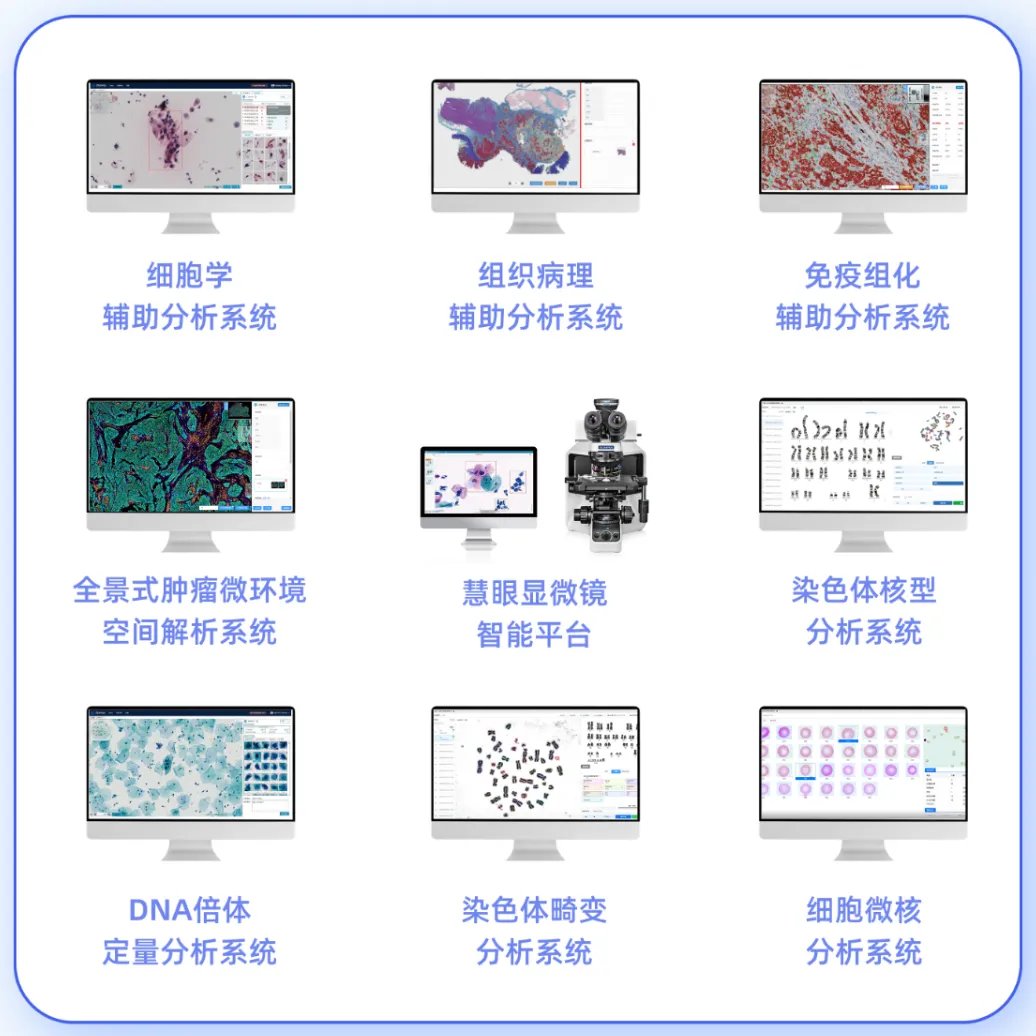

在组织病理辅助诊断方面,支持常见高发的癌种,实现对关键病变区域的精准定位与可视化表达,同时支持对应病种的免疫组化分析。

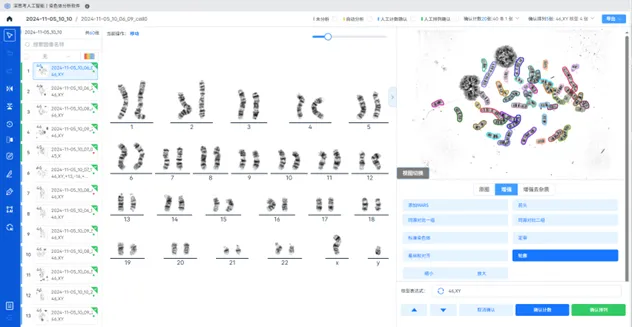

在遗传学方面支持染色体畸变检测与核型分析,支持分割、计数、排列、异常提示和中期搜索等所需功能,同时具备微核检测分析的能力。

另外受益于海量的知识库,可自动整合病理图像特征与临床文本信息,生成标准化医疗诊断报告,同时也面向科研分析方向,智能助手小思可以实现指南、文章、病例检索,健康咨询与关怀、医学报告解读等。

快慢双系统,赋能生命科学

如文章开头提的,Tizhoosh教授的批判是尖锐的,但它的价值不在于否定,而在于警醒。通用大模型的神话正在褪色,真正能留下来的,是最能解决临床问题的方案。

DongNI-MED 支持图像、视频、声音、文本、序列等多模态数据的联合分析与跨模态语义对齐,聚焦医疗健康领域场景,覆盖病理分析、基因与组学研究、临床诊疗、生物工程及健康管理等方向。

最后,深思考研究团队长期招聘多模态大模型及视觉基础模型算法研究员及实习生,感兴趣的可以私信我哦~

想涨知识,点击下方卡片,关注 Mark·AI!

点个“小爱心”吧

夜雨聆风

夜雨聆风