说三个我遇到的真实场景,你看看有没有戳中的:

场景一:公司的业务数据不能上云,但甲方爸爸又要求做个 AI 问答功能。去调第三方 API?法务直接打回来,说不行。

场景二:调 OpenAI 的 API,网络时不时抽风。给客户做 demo 演示,AI 回答转了三圈才出来,场面一度非常尴尬。

场景三:每天跑几十次调 API 的任务,月底账单出来心在滴血。量大的时候,一个月大几千真不是开玩笑的。

如果你也遇到类似问题,本地部署大模型就是一个值得认真考虑的解法。反正我自己用了大半年了,确实香。

先搞清楚两个方案

| 模型在哪跑 | ||

| 费用 | ||

| 数据隐私 | ||

| 网络延迟 | ||

| 模型规模 |

两个方案解决的问题不太一样,不矛盾。很多人(包括我)的用法是:小任务本地跑,省钱省心;大任务调云端 API,高效稳定。

方案一:Ollama——在自己电脑上跑(免费)

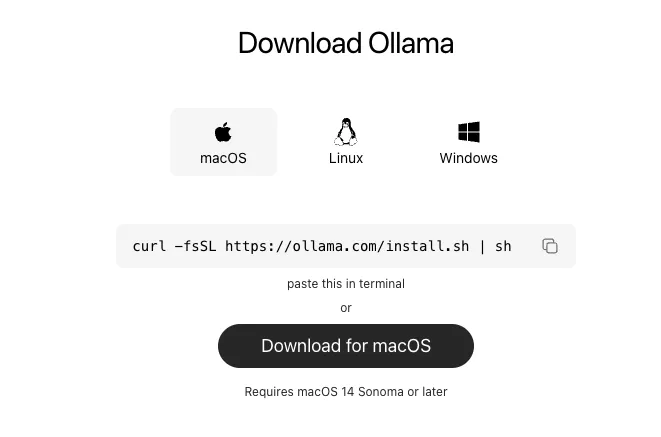

1. 安装,三分钟搞定

https://ollama.com/download/

可直接安装按需下载自己需要的版本。

装完之后打开终端验证一下:

ollama --version2. 下载模型

# 模型 ollama pull qwen2.5:7b-instruct3. 直接对话试试

ollama run qwen2.5:7b这里建议用7b 因为大的带不动 小的又太难用

4. 接口调用(开发者重点看这里)

开启服务(默认端口 11434):

ollama serve然后用 node 调用:

const http=require('http');function callOllama(prompt) {const data=JSON.stringify({model:"qwen2.5:7b", // 你本地的模型名prompt:prompt, // 你要问的问题stream:false// 非流式,一次性返回结果(最简单)});const options= {hostname:'localhost',port:11434,path:'/api/generate',method:'POST',headers: {'Content-Type':'application/json','Content-Length':data.length}};return newPromise((resolve, reject) => {const req=http.request(options, (res) => {let result='';res.on('data', (chunk) =>result+=chunk);res.on('end', () =>resolve(JSON.parse(result)));});req.on('error', reject);req.write(data);req.end();});}callOllama('内容')

这就是 Ollama 的调用方式,不过这个是js版本的调用方式!!!

5. Ollama 的坑,我替你踩了

坑一:Mac 上跑起来很烫跑 `qwen2.5:7b` 的时候风扇狂转,CPU 长期顶着 90%+,笔记本直接变成暖手宝。这个我建议直接加装风扇,如果不可以的话可以使用1.5b

坑二:响应很慢本地推理速度取决于硬件配置。7B 模型在我这台 Windows 台式机(RTX 3060)上大概 10-15 tokens/s,能接受;MacBook Air 大概只有 3-5 tokens/s,当作玩具可以,生产环境很难办。

坑三:Ollama 默认模板不支持 tools 参数如果你的 Agent 需要调用工具(Function Calling),注意不是所有 Ollama 模型都支持。我之前用 OpenClaw 接入的时候就踩过这个坑,换了带 tool 能力的模型版本才解决。

方案二:硅基流动——云端 API,按需付费

1. 为什么我选硅基流动

我自己在做一个微信小程序的 AI 功能,用的就是硅基流动。选它的原因:

• 国内服务器:不用科学上网,延迟低,稳定性好

• 价格便宜:按量计费,新用户有免费额度,薅羊毛首选

• 模型丰富:Qwen、DeepSeek、GLM 各种国产模型都有

• OpenAI 兼容:接口格式一样,迁移成本为零

2. 注册并获取 API Key

1. 打开 siliconflow.cn,注册一个账号

2. 进入控制台 → API 密钥 → 创建一个新密钥

3. 把 Key 保存好(只显示一次,记住了再关页面!)

免费额度大概够跑几万次对话,测试阶段完全够用。

3. 代码调用

async function chatWithSiliconFlow() {const apiKey = "你的硅基流动API_KEY";const res = await fetch("https://api.siliconflow.cn/v1/chat/completions", {method: "POST",headers: {"Content-Type": "application/json","Authorization": `Bearer ${apiKey}`},body: JSON.stringify({model: "deepseek-ai/DeepSeek-V3",messages: [{ role: "user", content: "用简单几句话介绍什么是AI大模型" }],stream: false, // 关闭流式,一次性返回temperature: 0.7})});const data = await res.json();if (data?.choices?.length) {console.log("🤖 AI回答:");console.log(data.choices[0].message.content);} else {console.log("❌ 调用失败:", data);}}

两种方案怎么选?

有没有隐私数据/合规要求?

├── 有 → Ollama 本地,稳

└── 没有

├── 有 GPU / 预算有限 / 小任务 → Ollama

└── 追求效果 / 要跑大参数模型 → 硅基流动

我自己现在的用法:

• 本地 Ollama:写代码、翻译、小工具脚本,省 API 额度

• 硅基流动:微信小程序正式功能、对接生产环境、需要调用大参数模型

常见问题

Q:Ollama 能跑多大的模型?A:理论上无限,但实际受内存/显存限制。经验参考——16G 内存跑 7B 模型勉强可以;想流畅跑 13B 以上,建议 24G+ 显存(RTX 3090/4090 级别)。

Q:硅基流动免费额度用完了怎么办?A:按量付费,价格透明。可以设一个额度预警,用超了会邮件通知,不至于无感超支。

Q:Ollama 和硅基流动能同时用吗?A:完全可以。我的实际项目里,根据任务复杂度自动路由——简单的走 Ollama,复杂的走硅基流动,一套代码搞定,体验很好。

Q:模型效果和 GPT-4 比怎么样?A:7B 级别的开源模型在多数任务上接近 GPT-3.5 的水平,和 GPT-4 比还是有差距。但日常开发够用,关键是不花钱和数据不出境这两个优势,有时候比模型能力更重要。

最后

本地跑大模型这件事,2024 年还有点折腾,2026 年真的已经非常成熟了。

Ollama 直接下载就能跑,硅基流动注册完十分钟接进项目。

我个人的感受是:不要在"用不用 AI"这个问题上犹豫了,先用起来,在用的过程中你会发现哪些场景真正需要 AI,哪些场景其实人工更快。

工具是拿来用的,不是拿来研究的。

你在本地部署大模型的过程中遇到过什么问题?评论区聊聊,互相避坑。

夜雨聆风

夜雨聆风