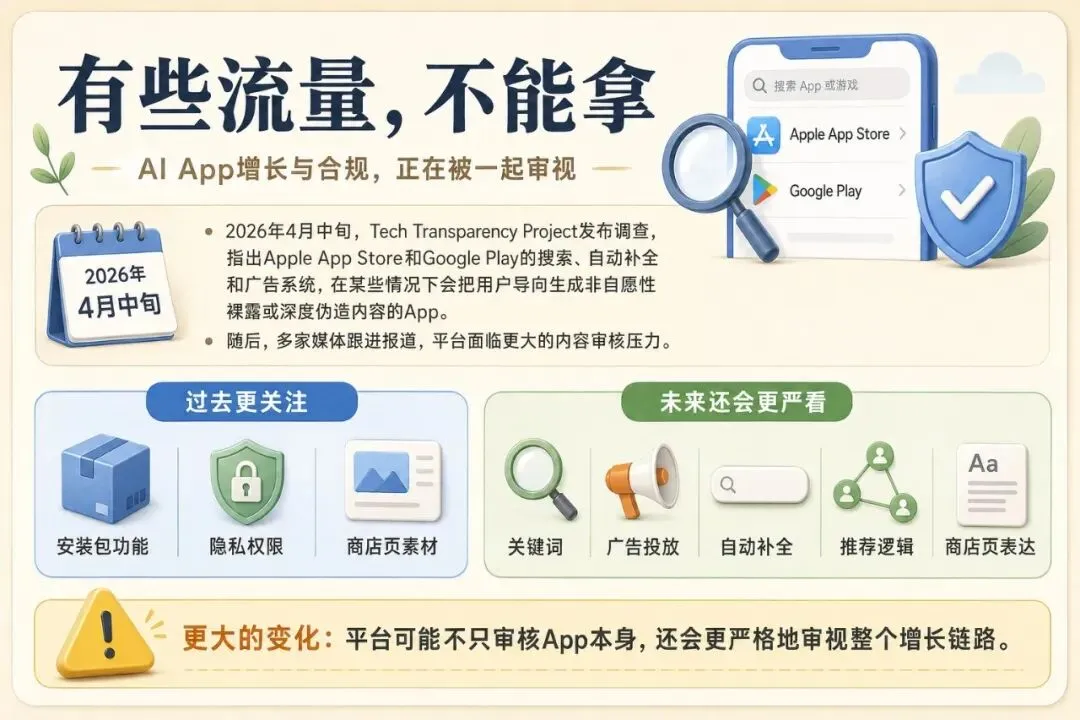

有些流量,不能拿。

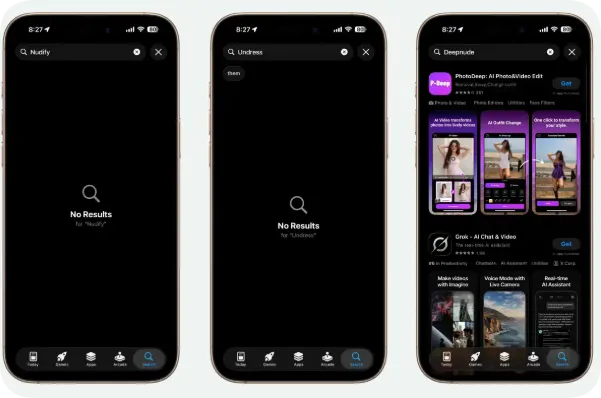

2026年4月中旬,Tech Transparency Project发布调查,指出Apple App Store和Google Play的搜索、自动补全和广告系统,在某些情况下会把用户导向生成非自愿性裸露或深度伪造内容的App。随后,多家媒体跟进报道,Apple和Google也面临更大的内容审核压力。

这类事件对普通ASO团队的提醒,不只是“违规App会被下架”。

更大的变化在于:应用商店未来可能不只审核App本身,还会更严格地审视关键词、广告投放、自动补全、推荐逻辑和商店页表达。尤其是AI图片、AI视频、AI聊天、换脸、虚拟伴侣、内容生成类App,合规边界正在变窄。

审核风险从产品扩散到增长链路

过去很多团队理解应用商店审核,主要盯三件事:安装包功能、隐私权限、商店页素材。

但这次争议,平台被质疑的不只是App存在,而是搜索和广告系统是否在放大风险内容。

这意味着,增长动作本身也会被纳入风险判断。你投了什么关键词?自动补全会联想到什么?截图是否暗示违规用途?广告文案是否鼓励不当生成?评论区是否大量出现高风险使用场景?

对AI应用来说,审核不再只看“你声称自己能做什么”,还会看“用户可能拿你做什么”。

ASO关键词也有红线

很多增长团队喜欢找灰色高流量词。短期看,搜索量大、竞争强、转化也可能不差。

但在AI生成内容领域,这种打法风险极高。

如果关键词本身指向非自愿深度伪造、色情化生成、未成年人相关内容、骚扰或欺骗用途,即使产品功能包装得更中性,也可能被平台判定为规避审核或诱导不当使用。

更麻烦的是,关键词风险不只存在于标题和副标题,也存在于Apple Search Ads、Google Ads、截图文案、评论回复、开发者网站落地页和社媒投放素材里。

一个合规App,如果增长素材不断暗示违规用途,也会把自己推向危险区。

AI类App商店页应该怎么写

第一,明确正当用途。

比如AI图片编辑,可以强调修复老照片、头像生成、商品图优化、背景替换、设计辅助。不要用模糊刺激性表达制造想象空间。

第二,写清限制。

如果产品涉及人脸、身体、声音、身份模拟,应在描述、隐私政策和用户协议中明确禁止未经同意的生成、冒充、骚扰和侵权用途。

第三,减少危险暗示。

截图、视频和广告素材不要靠擦边场景吸引点击。平台一旦加强审核,最先被处理的往往不是技术最危险的App,而是外部表达最明显的App。

第四,准备审核材料。

AI类App最好提前准备安全机制说明:内容过滤、用户举报、审核流程、年龄限制、数据处理方式、违规账号处置。被审核团队追问时,能快速给出清晰材料。

这会影响正常AI应用吗?

会,但不一定是坏事。

平台审核变严,会增加合规成本,也可能误伤一些边界产品。但长期看,它会把只靠危险关键词获量的应用挤出去,让真正有生产力、设计、营销、创作、教育价值的AI工具更容易建立信任。

对正规团队来说,现在要做的不是等平台发新规,而是先做一次“AI安全ASO体检”:

检查关键词是否含高风险暗示;

检查截图和视频是否可能被误读;

检查广告词是否夸大或诱导;

检查评论区是否暴露违规使用场景;

检查隐私政策和安全机制是否能支撑审核。

AI App出海,增长和合规不能再分开做。

未来应用商店不会只问“你的App有没有这个功能”,还会问“你是否在引导用户安全、合法、透明地使用这个功能”。这才是AI应用长期获量的底线。

专注海外营销领域的探索者

主攻 Google SEO 方向,兼修ASO、Ads、KOL、ORM及SNS的跨渠道整合。

添加微信时请至少备注:公司+岗位+事由。不然,你很可能无法通过。另外,不接广告,不做代运营,不开培训班,没有会员群。

如果你恰好符合以下任意场景:

手握海外创业蓝图,正在寻找懂流量生态的战略搭档

被某个行业共性难题困住,急需思维碰撞的火花

在海外实战中炼就独门秘技,渴望找到分享的锚点

夜雨聆风

夜雨聆风