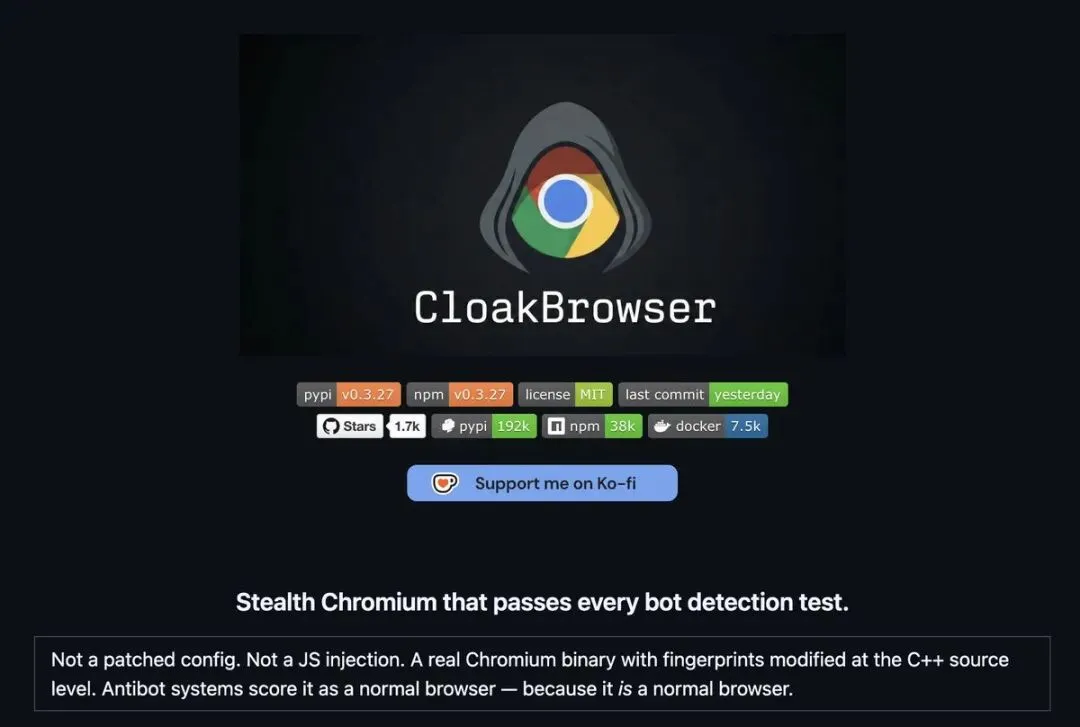

CloakBrowser 把 Chromium 源码打 49 处 C++ patch 后,反爬检测基本认不出它是自动化工具

爬虫项目做到一半,Cloudflare Turnstile 突然跳出来,reCAPTCHA v3 分数低到触发挑战,FingerprintJS 直接报高 entropy 异常。以前我们用 undetected-chromedriver、playwright-stealth、各种 JS hook 注入和启动参数魔改,每次 Chromium 大版本一更新就得跟着重写,维护成本像滚雪球一样越堆越高。

现在 CloakBrowser 直接在 Chromium 源码层改了指纹,编译出实打实的二进制。不是运行时遮掩,而是把 canvas、WebGL、音频上下文、字体枚举、GPU 字符串、WebRTC、硬件并发等底层行为从 C++ 层面调整。网站收到的信号来自修改后的真实浏览器引擎,所以检测系统容易把它当成普通用户浏览器放行。普通用户刷网页时几乎感觉不到区别,但写自动化采集的开发者用起来,采集成功率和稳定性直接上一个台阶。

源码级修改到底有多大差别?

先说最直接的结论:目前在 30 个主流检测站点上,它基本全绿,Cloudflare Turnstile 非交互模式能过,reCAPTCHA v3 能拿到接近 0.9 的真人级分数,BrowserScan 和 FingerprintJS 也显示正常。这不是绝对无敌——反检测始终是动态博弈,但它把传统方案里“运行时痕迹”这个老大难问题从根上绕开了。

对没写过爬虫的读者来说,想象一下你用手机刷抖音或淘宝,网站后台把你当成正常人,不会跳验证码也不会限流。传统自动化浏览器就像戴着口罩、动作僵硬的“可疑人员”,网站一眼就能认出来。CloakBrowser 相当于把整个浏览器底层“整容”成普通手机或电脑的模样,动作和信号都来自修改后的 Chromium 引擎,网站自然就不容易触发防御。

为什么这点重要?传统 stealth 库大多在 JS 层或启动参数层做文章,这些修改本身就可能成为新的检测向量。一旦被抓,IP 封禁、账号风控、整站拉黑跟着就来,项目直接卡死。源码级 patch 把指纹生成逻辑改在编译前,理论上更难被检测到,也更能扛住浏览器引擎更新。

技术细节上,项目 wrapper 很薄,主要工作在预编译的 Chromium 二进制里。目前提到有 49 处到 57 处 C++ patch(不同版本略有浮动),覆盖 canvas 指纹一致性、WebGL renderer 信息、音频指纹、字体加载行为、GPU vendor 和 device 报告、screen 属性、WebRTC 泄露、自动化信号移除、CDP(Chrome DevTools Protocol)输入行为模拟等。humanize 模式还会生成贝塞尔曲线鼠标轨迹、自然按键时序和滚动模式。启动时用随机种子生成一致性指纹,支持 proxy 自动适配时区和 locale。

我以前用 playwright-stealth 的时候,某个电商站点刚稳定跑了两天,Chromium 升级后 canvas 噪声生成逻辑一变,全军覆没。后来试过自己编译 Chromium 加 patch,编译时间长、平台适配麻烦,踩了不少坑。CloakBrowser 把二进制预编译好,pip install 或 npm install 后首次运行自动下载对应平台的包(Linux x64、macOS arm64/x64、Windows x64),后续基本零配置。这点让我认知上修正了一次:有时候往更底层改,反而让日常使用门槛更低。

实际替换现有代码有多简单?

核心卖点就是 drop-in 替换。原来用 Playwright 的项目,改动极小。

# 传统写法from playwright.sync_api import sync_playwrightwith sync_playwright() as pw: browser = pw.chromium.launch(headless=False) page = browser.new_page() page.goto("https://example.com")# 用 CloakBrowserfrom cloakbrowser import launchbrowser = launch(humanize=True) # 开启类人交互行为page = browser.new_page()page.goto("https://example.com")JS 端也一样,直接 import { launch } from 'cloakbrowser'。首次运行下载的二进制大概 200MB 左右,之后本地缓存。支持 persistent context 保持 cookies、localStorage 和会话状态,还能配合 proxy 使用。

⚠️ 注意:它主要解决“不触发检测”的问题,不是直接绕过需要人工介入的 CAPTCHA。复杂站点还是建议搭配高质量住宅代理使用,humanize 模式打开。测试可以用 Docker 一行命令跑验证环境。

跑完之后,检测站点通常显示 NORMAL 指纹,reCAPTCHA 分数高,Turnstile 顺利通过。实际项目里,我看到采集成功率提升明显,尤其是需要长时间维持会话的场景。

配套的 Profile Manager 解决多账号痛点

项目还开源了 CloakBrowser Manager,一个自托管的浏览器指纹管理工具。类似 Multilogin 或 GoLogin 的功能,但免费开源。Docker 部署后,通过网页界面(noVNC)创建、管理不同指纹的独立会话,每个 profile 有自己的指纹、cookies 和存储。

这部分之前我没太当回事,觉得多账号场景用 proxy + incognito 就够。实际用下来才发现,对于电商、社交、票务这类对会话一致性要求高的站点,persistent profile + 独立指纹的组合,比每次新开浏览器稳多了。会话不会莫名其妙丢失,长期维护成本低。

当然不是完美无缺。某些极端检测站点 WebDriver 相关信号还有少量残留,新 Chromium 版本发布后 patch 需要项目跟进维护。目前项目迭代挺快,社区反馈也在驱动更新。binary 是预编译的,有人担心安全问题,这点确实需要自己评估——项目 MIT 协议,源码开放,但二进制下载建议验证 SHA。

我原来以为源码级改动门槛高、维护重,现在看 wrapper 做好后,实际上手比拼凑各种 stealth 库还省心。这算又一次把“底层改动”想得太复杂了。

反爬和反反爬的猫鼠游戏不会停。CloakBrowser 提供了一个免费、开源、可自建的强力选项,适合有一定技术背景的团队或个人开发者。想试的直接去 GitHub 看文档,拉下来跑就行。

你最近的项目里,被哪个具体检测点卡得最久?换这个方案后通过率提升多少?💬

如果你觉得这篇内容对你有启发,欢迎在留言区聊聊你的看法。

关注我,我会持续分享高质量的技术与思考干货。👇

夜雨聆风

夜雨聆风